Towards Open-World Human Action Segmentation Using Graph Convolutional Networks

作者: Hao Xing, Kai Zhe Boey, Gordon Cheng

分类: cs.CV, cs.RO

发布日期: 2025-07-01 (更新: 2025-12-11)

备注: 8 pages, 3 figures, accepted in IROS25, Hangzhou, China

DOI: 10.1109/IROS60139.2025.11247257

💡 一句话要点

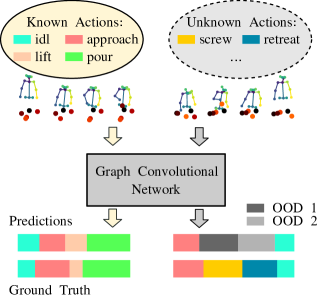

提出基于图卷积网络的开放世界人体行为分割框架,解决未知行为的检测与分割问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱五:交互与反应 (Interaction & Reaction) 支柱八:物理动画 (Physics-based Animation)

关键词: 开放世界学习 行为分割 图卷积网络 人体行为识别 分布外检测

📋 核心要点

- 现有行为分割方法在封闭世界表现良好,但在开放世界中泛化能力不足,难以处理未见过的行为。

- 提出基于图卷积网络的框架,利用Mixup合成未知行为数据,并设计时间聚类损失区分已知和未知行为。

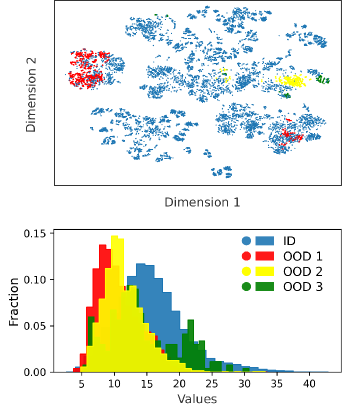

- 在两个数据集上验证了框架的有效性,在开放集分割和分布外检测上均取得了显著的性能提升。

📝 摘要(中文)

本文针对开放世界人体行为分割问题,即在存在未知行为类别的情况下进行行为分割,提出了一个结构化的框架。该框架包含三个关键创新:1) 增强型金字塔图卷积网络(EPGCN),具有用于鲁棒时空特征上采样的新型解码器模块;2) 基于Mixup的训练方法,用于合成分布外数据,无需手动标注;3) 新型时间聚类损失,用于聚集分布内行为,同时分离分布外样本。在Bimanual Actions和2 Hands and Object (H2O)数据集上的实验结果表明,该框架在多个开放集评估指标上显著优于最先进的行为分割模型,在开放集分割(F1@50)和分布外检测性能(AUROC)方面分别实现了16.9%和34.6%的相对提升。此外,还进行了深入的消融研究,以评估每个提出的组件的影响,从而确定了开放世界行为分割的最佳框架配置。

🔬 方法详解

问题定义:现有基于学习的行为分割方法在封闭世界中表现出色,但在开放世界场景中难以泛化,即无法处理训练集中未出现过的新行为。由于人类行为的多样性,收集所有可能的行为类别进行训练是不切实际的。因此,需要一种能够检测和分割分布外行为,而无需手动标注的模型。

核心思路:本文的核心思路是通过学习区分已知行为和未知行为的特征表示,从而实现开放世界行为分割。具体来说,通过Mixup方法合成分布外数据,模拟未知行为的特征,并利用时间聚类损失将已知行为聚集在一起,同时将未知行为推开。这样,模型就能够学习到区分已知和未知行为的判别性特征。

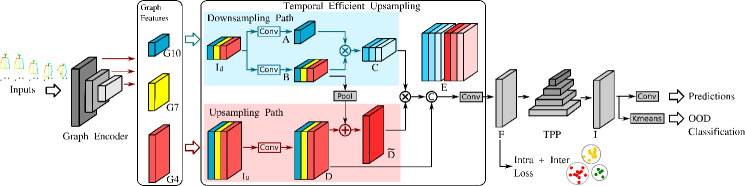

技术框架:该框架主要包含三个模块:1) 增强型金字塔图卷积网络(EPGCN),用于提取时空特征;2) 基于Mixup的训练模块,用于合成分布外数据;3) 时间聚类损失模块,用于优化特征表示。首先,EPGCN提取输入视频的时空特征。然后,Mixup模块将已知行为的特征进行混合,生成模拟的未知行为特征。最后,时间聚类损失将已知行为的特征聚集在一起,并将Mixup生成的未知行为特征推开。

关键创新:本文的关键创新在于:1) 提出了增强型金字塔图卷积网络(EPGCN),该网络具有用于鲁棒时空特征上采样的新型解码器模块;2) 提出了基于Mixup的训练方法,用于合成分布外数据,无需手动标注;3) 提出了新型时间聚类损失,用于聚集分布内行为,同时分离分布外样本。与现有方法相比,本文的方法能够有效地处理开放世界行为分割问题,而无需手动标注未知行为。

关键设计:EPGCN使用金字塔结构提取多尺度时空特征,并使用新型解码器模块进行特征上采样。Mixup模块随机选择两个已知行为的特征,并按照一定的比例进行混合,生成新的特征。时间聚类损失使用余弦相似度作为距离度量,将已知行为的特征聚集在一起,并将Mixup生成的未知行为特征推开。损失函数的具体形式为:L = L_cluster + λ * L_separation,其中L_cluster是聚类损失,L_separation是分离损失,λ是平衡系数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架在Bimanual Actions和2 Hands and Object (H2O)数据集上显著优于最先进的行为分割模型。在开放集分割(F1@50)和分布外检测性能(AUROC)方面分别实现了16.9%和34.6%的相对提升。消融研究表明,EPGCN、Mixup和时间聚类损失均对性能提升有贡献。

🎯 应用场景

该研究成果可应用于辅助机器人、医疗保健和自动驾驶系统等领域。例如,在辅助机器人中,可以帮助机器人识别用户正在执行的动作,并提供相应的帮助。在医疗保健中,可以用于监测患者的日常活动,并及时发现异常行为。在自动驾驶系统中,可以用于识别行人的行为,并做出相应的决策。

📄 摘要(原文)

Human-object interaction segmentation is a fundamental task of daily activity understanding, which plays a crucial role in applications such as assistive robotics, healthcare, and autonomous systems. Most existing learning-based methods excel in closed-world action segmentation, they struggle to generalize to open-world scenarios where novel actions emerge. Collecting exhaustive action categories for training is impractical due to the dynamic diversity of human activities, necessitating models that detect and segment out-of-distribution actions without manual annotation. To address this issue, we formally define the open-world action segmentation problem and propose a structured framework for detecting and segmenting unseen actions. Our framework introduces three key innovations: 1) an Enhanced Pyramid Graph Convolutional Network (EPGCN) with a novel decoder module for robust spatiotemporal feature upsampling. 2) Mixup-based training to synthesize out-of-distribution data, eliminating reliance on manual annotations. 3) A novel Temporal Clustering loss that groups in-distribution actions while distancing out-of-distribution samples. We evaluate our framework on two challenging human-object interaction recognition datasets: Bimanual Actions and 2 Hands and Object (H2O) datasets. Experimental results demonstrate significant improvements over state-of-the-art action segmentation models across multiple open-set evaluation metrics, achieving 16.9% and 34.6% relative gains in open-set segmentation (F1@50) and out-of-distribution detection performances (AUROC), respectively. Additionally, we conduct an in-depth ablation study to assess the impact of each proposed component, identifying the optimal framework configuration for open-world action segmentation.