Towards Explainable Bilingual Multimodal Misinformation Detection and Localization

作者: Yiwei He, Zhenglin Huang, Haiquan Wen, Tianxiao Li, Yi Dong, Hao Fei, Baoyuan Wu, Guangliang Cheng

分类: cs.CV

发布日期: 2025-06-28 (更新: 2025-12-09)

💡 一句话要点

提出BiMi框架,解决双语多模态信息误导检测与定位难题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 双语信息处理 虚假信息检测 跨模态一致性 跨语言一致性

📋 核心要点

- 现有方法难以有效检测新闻媒体中图像与双语字幕结合的虚假信息,尤其是在存在局部图像编辑和跨语言不一致的情况下。

- BiMi框架通过联合执行区域级定位、跨模态和跨语言一致性检测,并结合在线检索模块,实现更准确的虚假信息分析。

- 实验结果表明,BiMi在分类、定位和解释质量方面均优于现有方法,并在BiMiBench基准测试中取得了显著的性能提升。

📝 摘要(中文)

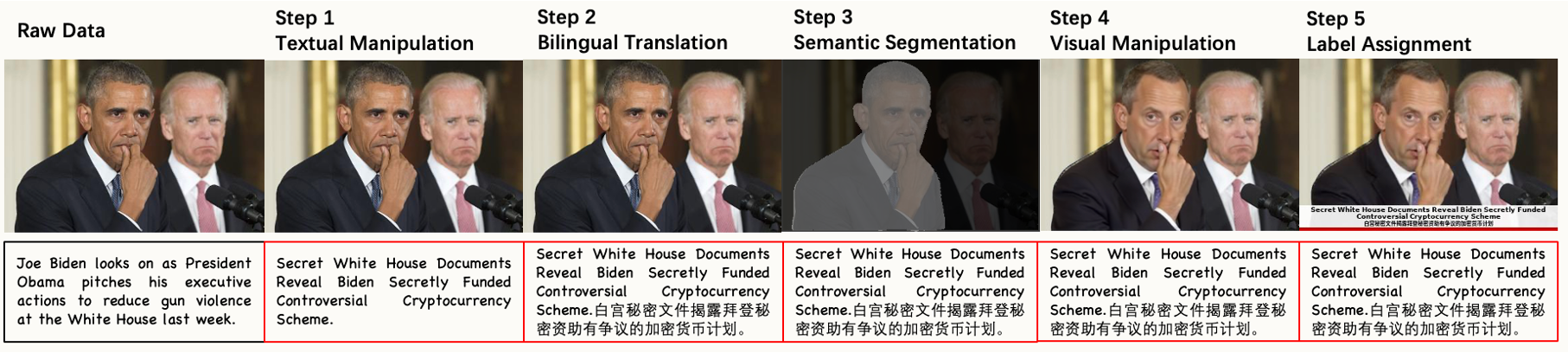

多模态内容的日益逼真使得虚假信息更加难以检测,尤其是在新闻媒体中,图像经常与双语(如中英文)字幕配对。此类内容通常包含局部图像编辑和跨语言不一致,这些因素共同扭曲含义,同时在表面上保持合理性。我们介绍BiMi,一个双语多模态框架,它联合执行区域级定位、跨模态和跨语言一致性检测,以及自然语言解释,用于虚假信息分析。为了支持泛化,BiMi集成了一个在线检索模块,用最新的外部上下文补充模型推理。我们进一步发布了BiMiBench,一个大规模和全面的基准,通过系统地编辑真实的新闻图像和字幕构建,包含104,000个样本,具有跨视觉和语言模态的真实操作。为了增强可解释性,我们应用Group Relative Policy Optimization (GRPO)来提高解释质量,这是GRPO在该领域的首次使用。广泛的实验表明,BiMi在分类准确率上优于强大的基线高达+8.9,在定位准确率上优于+15.9,在解释BERTScore上优于+2.5,从而提高了在真实的、多语言的虚假信息检测方面的最先进性能。代码、模型和数据集将被发布。

🔬 方法详解

问题定义:论文旨在解决双语(例如,中英文)新闻媒体中,图像与字幕结合时出现的虚假信息检测与定位问题。现有方法难以处理图像局部编辑和跨语言信息不一致的情况,导致检测准确率低,且缺乏可解释性。

核心思路:论文的核心思路是构建一个能够同时理解视觉信息、两种语言文本信息,并能进行跨模态和跨语言一致性推理的框架。通过联合学习图像区域定位、跨模态和跨语言一致性检测,以及生成自然语言解释,从而提高虚假信息检测的准确性和可解释性。

技术框架:BiMi框架包含以下主要模块:1) 图像区域定位模块,用于识别图像中被篡改的区域;2) 跨模态一致性检测模块,用于判断图像内容与对应语言文本描述是否一致;3) 跨语言一致性检测模块,用于判断两种语言文本描述是否一致;4) 在线检索模块,用于从外部知识库检索相关信息,辅助模型进行推理;5) 自然语言解释生成模块,用于生成对虚假信息判断的解释。

关键创新:论文的关键创新点在于:1) 提出了一个能够同时处理双语和多模态信息的虚假信息检测框架;2) 引入在线检索模块,利用外部知识提高模型的泛化能力;3) 首次将Group Relative Policy Optimization (GRPO)应用于虚假信息检测领域,提升了解释质量。

关键设计:论文中,图像区域定位模块可能采用了目标检测或显著性检测等技术;跨模态和跨语言一致性检测模块可能采用了对比学习或注意力机制等方法;在线检索模块的具体实现方式未知;自然语言解释生成模块可能采用了序列到序列模型或Transformer等技术。损失函数的设计可能包括分类损失、定位损失和一致性损失等,以联合优化各个模块的性能。具体网络结构和参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BiMi框架在BiMiBench基准测试中,分类准确率比现有方法提高了8.9%,定位准确率提高了15.9%,解释BERTScore提高了2.5%。这些结果表明,BiMi框架在双语多模态虚假信息检测和定位方面具有显著的优势,能够有效提高检测准确性和可解释性。

🎯 应用场景

该研究成果可应用于新闻媒体平台,自动检测和定位虚假信息,减少错误信息的传播。此外,该技术还可用于社交媒体内容审核、网络安全等领域,帮助用户识别和防范虚假信息,维护网络环境的健康和安全。未来,该研究可以扩展到更多语言和模态,例如视频和语音,以应对更加复杂的虚假信息挑战。

📄 摘要(原文)

The increasing realism of multimodal content has made misinformation more subtle and harder to detect, especially in news media where images are frequently paired with bilingual (e.g., Chinese-English) subtitles. Such content often includes localized image edits and cross-lingual inconsistencies that jointly distort meaning while remaining superficially plausible. We introduce BiMi, a bilingual multimodal framework that jointly performs region-level localization, cross-modal and cross-lingual consistency detection, and natural language explanation for misinformation analysis. To support generalization, BiMi integrates an online retrieval module that supplements model reasoning with up-to-date external context. We further release BiMiBench, a large-scale and comprehensive benchmark constructed by systematically editing real news images and subtitles, comprising 104,000 samples with realistic manipulations across visual and linguistic modalities. To enhance interpretability, we apply Group Relative Policy Optimization (GRPO) to improve explanation quality, marking the first use of GRPO in this domain. Extensive experiments demonstrate that BiMi outperforms strong baselines by up to +8.9 in classification accuracy, +15.9 in localization accuracy, and +2.5 in explanation BERTScore, advancing state-of-the-art performance in realistic, multilingual misinformation detection. Code, models, and datasets will be released.