RGE-GS: Reward-Guided Expansive Driving Scene Reconstruction via Diffusion Priors

作者: Sicong Du, Jiarun Liu, Qifeng Chen, Hao-Xiang Chen, Tai-Jiang Mu, Sheng Yang

分类: cs.CV

发布日期: 2025-06-28 (更新: 2025-07-25)

🔗 代码/项目: GITHUB

💡 一句话要点

RGE-GS:提出奖励引导的扩散先验扩展驾驶场景重建方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 驾驶场景重建 扩散模型 3D高斯溅射 奖励网络 自动驾驶仿真

📋 核心要点

- 现有方法难以从不完整的驾驶片段中重建完整的驾驶场景,直接应用扩散先验会引入物理不一致性并降低效率。

- RGE-GS通过奖励网络筛选扩散模型生成的结果,并采用差异化训练策略优化高斯参数,提升重建质量和训练效率。

- 在公开数据集上的实验表明,RGE-GS在驾驶场景重建质量上达到了当前最优水平。

📝 摘要(中文)

单次驾驶片段通常导致道路结构扫描不完整,因此重建场景扩展对于传感器模拟器有效回归驾驶行为至关重要。尽管当前3D高斯溅射(3DGS)技术实现了卓越的重建质量,但通过集成扩散先验直接扩展通常会引入累积的物理不一致性并降低训练效率。为了解决这些限制,我们提出了RGE-GS,一种新颖的扩展重建框架,它将基于扩散的生成与奖励引导的高斯积分相结合。RGE-GS框架包含两个关键创新:首先,我们提出了一个奖励网络,该网络学习在重建阶段之前识别并优先考虑一致生成的模式,从而能够选择性地保留扩散输出以实现空间稳定性。其次,在重建过程中,我们设计了一种差异化的训练策略,该策略根据场景收敛指标自动调整高斯优化进度,从而比基线方法实现更好的收敛。对公开数据集的广泛评估表明,RGE-GS在重建质量方面实现了最先进的性能。我们的源代码将在https://github.com/CN-ADLab/RGE-GS上公开。

🔬 方法详解

问题定义:论文旨在解决单次驾驶片段扫描不完整导致的驾驶场景重建不完整问题。现有方法,特别是直接将扩散先验集成到3D高斯溅射(3DGS)中,会引入累积的物理不一致性,并且训练效率较低。这些问题限制了传感器模拟器有效回归驾驶行为的能力。

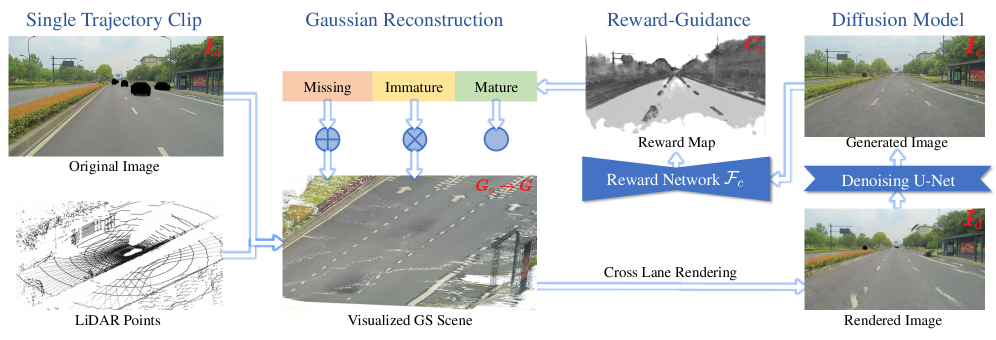

核心思路:论文的核心思路是将扩散模型生成的先验知识与3DGS的重建能力相结合,同时引入奖励机制来筛选扩散模型的输出,保证空间一致性。此外,通过差异化的训练策略,根据场景收敛情况动态调整高斯参数的优化过程,加速收敛并提升重建质量。

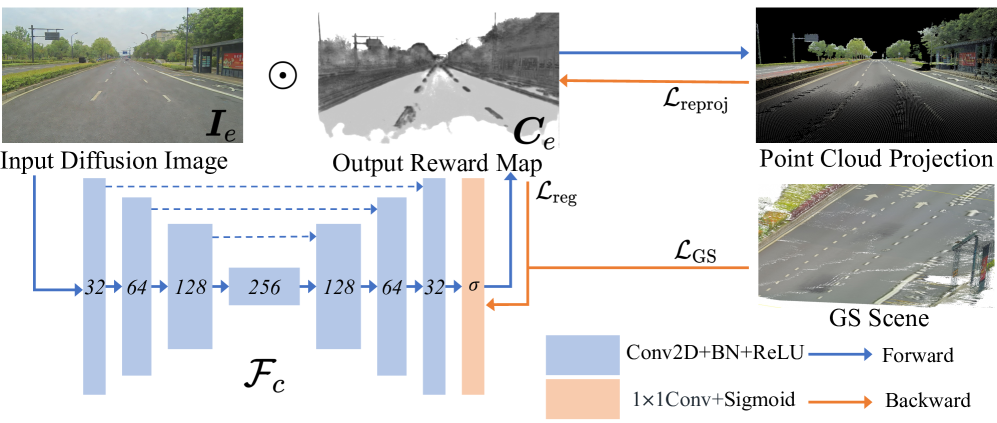

技术框架:RGE-GS框架主要包含两个关键模块:奖励网络和差异化训练策略。首先,利用扩散模型生成场景的扩展部分。然后,奖励网络评估生成结果的一致性,并选择性地保留高质量的生成结果。最后,通过差异化训练策略优化3DGS参数,将选择的生成结果融入到重建场景中。

关键创新:RGE-GS的关键创新在于:1) 引入奖励网络来评估和筛选扩散模型的生成结果,从而避免直接使用扩散模型带来的物理不一致性问题。2) 提出差异化的训练策略,根据场景收敛指标动态调整高斯参数的优化过程,提高训练效率和重建质量。

关键设计:奖励网络的设计细节未知,但其目标是评估生成结果与现有场景的一致性。差异化训练策略的关键在于定义合适的场景收敛指标,并根据这些指标调整高斯参数的优化步长或损失权重。具体的损失函数和网络结构细节在论文中应该有更详细的描述,但摘要中未提及。

🖼️ 关键图片

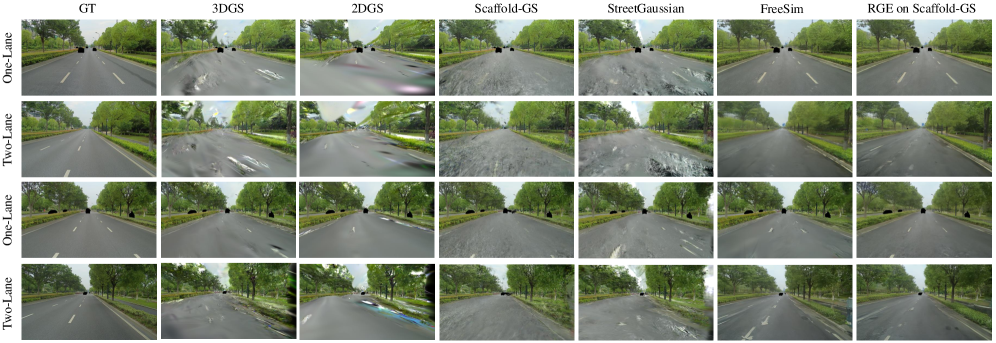

📊 实验亮点

RGE-GS在公开数据集上实现了最先进的重建质量,具体性能数据和对比基线需要在论文中查找。该方法通过奖励网络和差异化训练策略,有效解决了直接应用扩散先验带来的物理不一致性和训练效率问题,为驾驶场景重建提供了新的解决方案。

🎯 应用场景

RGE-GS可应用于自动驾驶仿真环境的构建,通过扩展不完整的驾驶场景,为自动驾驶算法提供更全面、更真实的训练数据。此外,该方法还可用于增强现实和虚拟现实应用,生成更逼真的虚拟驾驶环境,提升用户体验。该研究的未来影响在于提高自动驾驶系统的安全性和可靠性。

📄 摘要(原文)

A single-pass driving clip frequently results in incomplete scanning of the road structure, making reconstructed scene expanding a critical requirement for sensor simulators to effectively regress driving actions. Although contemporary 3D Gaussian Splatting (3DGS) techniques achieve remarkable reconstruction quality, their direct extension through the integration of diffusion priors often introduces cumulative physical inconsistencies and compromises training efficiency. To address these limitations, we present RGE-GS, a novel expansive reconstruction framework that synergizes diffusion-based generation with reward-guided Gaussian integration. The RGE-GS framework incorporates two key innovations: First, we propose a reward network that learns to identify and prioritize consistently generated patterns prior to reconstruction phases, thereby enabling selective retention of diffusion outputs for spatial stability. Second, during the reconstruction process, we devise a differentiated training strategy that automatically adjust Gaussian optimization progress according to scene converge metrics, which achieving better convergence than baseline methods. Extensive evaluations of publicly available datasets demonstrate that RGE-GS achieves state-of-the-art performance in reconstruction quality. Our source-code will be made publicly available at https://github.com/CN-ADLab/RGE-GS.