GroupNL: Low-Resource and Robust CNN Design over Cloud and Device

作者: Chuntao Ding, Jianhang Xie, Junna Zhang, Salman Raza, Shangguang Wang, Jiannong Cao

分类: cs.CV, cs.AI, cs.DC

发布日期: 2025-06-14 (更新: 2026-01-14)

备注: IEEE Transactions on Mobile Computing, accepted manuscript

💡 一句话要点

GroupNL:面向云边协同的低资源、高鲁棒性CNN设计

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 卷积神经网络 模型压缩 非线性变换 物联网 边缘计算 低资源 鲁棒性 云边协同

📋 核心要点

- 现有CNN加速方法通常使用多个轻量级操作替代标准卷积,但仍影响速度。本文针对这一问题,旨在降低资源消耗。

- GroupNL利用非线性变换函数(NLF)分组生成多样化特征图,无需额外卷积操作,从而减少计算量和参数量。

- 实验表明,GroupNL在图像分类任务中提升了模型准确率,并在资源受限设备上表现出良好的性能。

📝 摘要(中文)

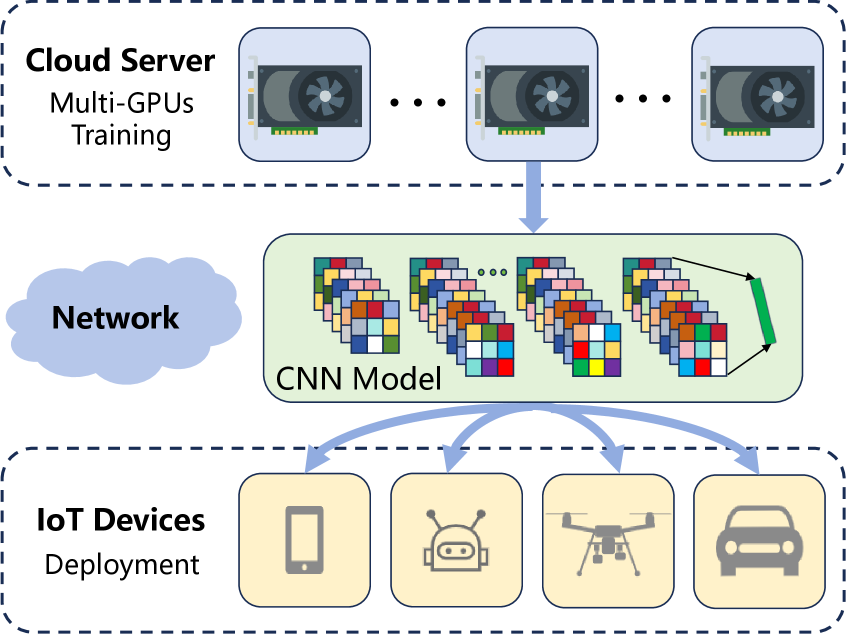

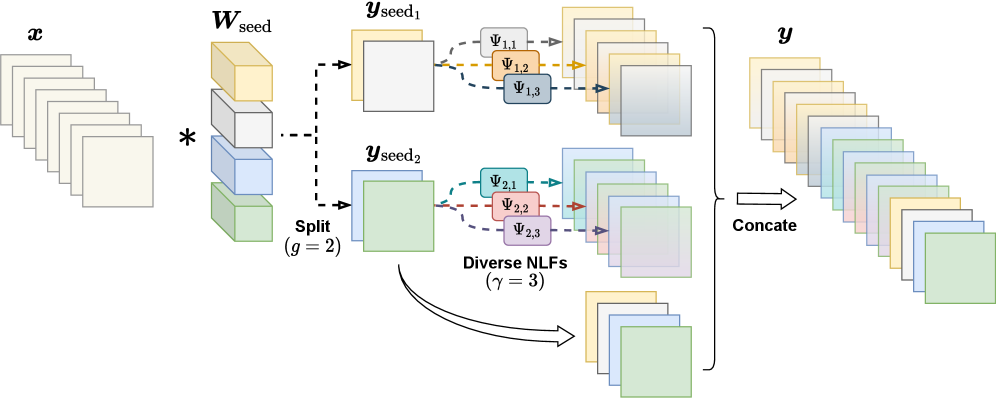

本文提出了一种分组非线性变换生成方法(GroupNL),旨在降低云辅助物联网(IoT)设备上卷积神经网络(CNN)模型的资源消耗并提高其鲁棒性。GroupNL利用数据无关、超参数固定且轻量级的非线性变换函数(NLF),通过分组按需生成多样化的特征图。在GroupNL卷积层中,首先基于种子卷积操作生成少量种子特征图。然后,将种子特征图分成若干组,每组应用不同的NLF,通过张量操作和非线性处理以轻量级方式生成所需数量的多样化特征图,无需额外的卷积操作。此外,还引入了稀疏GroupNL卷积,通过合理设计输入通道数和种子特征图之间的种子卷积组来加速运算。在基准数据集和设备资源测量上的实验表明,GroupNL卷积是基线模型中卷积层的有效替代方案。在Icons-50数据集上,GroupNL-ResNet-18的准确率比ResNet-18高2.86%;在ImageNet-C数据集上,GroupNL-EfficientNet-ES的准确率比EfficientNet-ES高约1.1%。

🔬 方法详解

问题定义:现有CNN模型在云边协同的物联网设备上部署时,为了加速模型训练和推理,通常采用减少卷积参数和FLOPs的方法。然而,这些方法往往使用多个轻量级操作(如深度可分离卷积、1x1卷积)来替代标准卷积,虽然减少了参数和计算量,但仍然会影响模型的实际加速效果,并且可能牺牲模型精度。

核心思路:GroupNL的核心思路是利用少量“种子”卷积生成的特征图,通过一系列轻量级的非线性变换函数(NLF)生成多样化的特征图,从而在不增加过多计算负担的情况下,提升模型的表达能力和鲁棒性。这种方法避免了直接堆叠多个卷积操作,降低了计算复杂度。

技术框架:GroupNL卷积层主要包含以下几个阶段:1) 种子卷积:使用少量的卷积核生成少量的种子特征图。2) 分组:将种子特征图分成若干组。3) 非线性变换:每组种子特征图应用不同的非线性变换函数(NLF),生成多样化的特征图。4) 特征图拼接:将所有组生成的特征图拼接起来,得到最终的输出特征图。此外,论文还提出了稀疏GroupNL卷积,通过优化种子卷积组的设计,进一步减少计算量。

关键创新:GroupNL的关键创新在于利用非线性变换函数(NLF)来生成多样化的特征图,而无需额外的卷积操作。与传统的轻量级CNN设计方法相比,GroupNL能够在减少计算量的同时,保持甚至提升模型的性能。此外,GroupNL的设计是数据无关的,超参数固定,易于部署和优化。

关键设计:GroupNL的关键设计包括:1) NLF的选择:论文中使用了多种非线性变换函数,例如ReLU、Sigmoid等,不同的NLF可以生成不同的特征图。2) 分组策略:如何将种子特征图分成不同的组,以及每组应用哪些NLF,都会影响最终的性能。3) 稀疏GroupNL卷积:通过合理设计输入通道数和种子特征图之间的种子卷积组,进一步减少计算量,同时保持模型的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GroupNL在多个数据集上都取得了显著的性能提升。在Icons-50数据集上,GroupNL-ResNet-18的准确率比ResNet-18高2.86%。在ImageNet-C数据集上,GroupNL-EfficientNet-ES的准确率比EfficientNet-ES高约1.1%。这些结果表明,GroupNL能够在降低资源消耗的同时,提高模型的准确率和鲁棒性。

🎯 应用场景

GroupNL适用于资源受限的物联网设备上的图像识别、目标检测等任务。例如,智能摄像头可以使用GroupNL来加速图像处理,提高识别准确率,同时降低功耗。该技术还可应用于自动驾驶、机器人等领域,提升设备在复杂环境下的感知能力和鲁棒性。

📄 摘要(原文)

Deploying Convolutional Neural Network (CNN) models on ubiquitous Internet of Things (IoT) devices in a cloud-assisted manner to provide users with a variety of high-quality services has become mainstream. Most existing studies speed up model cloud training/on-device inference by reducing the number of convolution (Conv) parameters and floating-point operations (FLOPs). However, they usually employ two or more lightweight operations (e.g., depthwise Conv, $1\times1$ cheap Conv) to replace a Conv, which can still affect the model's speedup even with fewer parameters and FLOPs. To this end, we propose the Grouped NonLinear transformation generation method (GroupNL), leveraging data-agnostic, hyperparameters-fixed, and lightweight Nonlinear Transformation Functions (NLFs) to generate diversified feature maps on demand via grouping, thereby reducing resource consumption while improving the robustness of CNNs. First, in a GroupNL Conv layer, a small set of feature maps, i.e., seed feature maps, are generated based on the seed Conv operation. Then, we split seed feature maps into several groups, each with a set of different NLFs, to generate the required number of diversified feature maps with tensor manipulation operators and nonlinear processing in a lightweight manner without additional Conv operations. We further introduce a sparse GroupNL Conv to speed up by reasonably designing the seed Conv groups between the number of input channels and seed feature maps. Experiments conducted on benchmarks and on-device resource measurements demonstrate that the GroupNL Conv is an impressive alternative to Conv layers in baseline models. Specifically, on Icons-50 dataset, the accuracy of GroupNL-ResNet-18 is 2.86% higher than ResNet-18; on ImageNet-C dataset, the accuracy of GroupNL-EfficientNet-ES achieves about 1.1% higher than EfficientNet-ES.