Gaussian Mapping for Evolving Scenes

作者: Vladimir Yugay, Thies Kersten, Luca Carlone, Theo Gevers, Martin R. Oswald, Lukas Schmid

分类: cs.CV

发布日期: 2025-06-07 (更新: 2025-11-19)

💡 一句话要点

提出基于高斯映射的动态场景建模方法,解决长期演变场景的重建问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景重建 高斯溅射 关键帧管理 场景自适应 新视点合成

📋 核心要点

- 现有基于3D高斯溅射的映射系统难以处理长期动态场景,场景随时间推移发生变化导致重建质量下降。

- 论文提出动态场景自适应机制,持续更新3DGS以反映最新变化,并设计关键帧管理机制丢弃过时观测。

- 实验结果表明,该方法在合成和真实数据集上均优于现有方法,PSNR提升显著,深度误差大幅降低。

📝 摘要(中文)

本文提出了一种用于演变场景的高斯映射方法,旨在解决现有方法在处理长期动态场景时的局限性。现有方法,如3D高斯溅射(3DGS),虽然在静态场景中表现出色,但在场景发生长期变化时效果不佳。为了克服这一限制,我们引入了一种动态场景自适应机制,该机制可以持续更新3DGS以反映最新的变化。由于保持一致性仍然具有挑战性,因为过时的观测会扰乱重建过程,因此我们提出了一种新颖的关键帧管理机制,该机制可以丢弃过时的观测,同时保留尽可能多的信息。我们在合成和真实世界数据集上彻底评估了所提出的高斯映射方法,与最具竞争力的基线相比,PSNR提高了29.7%,L1深度误差提高了3倍。

🔬 方法详解

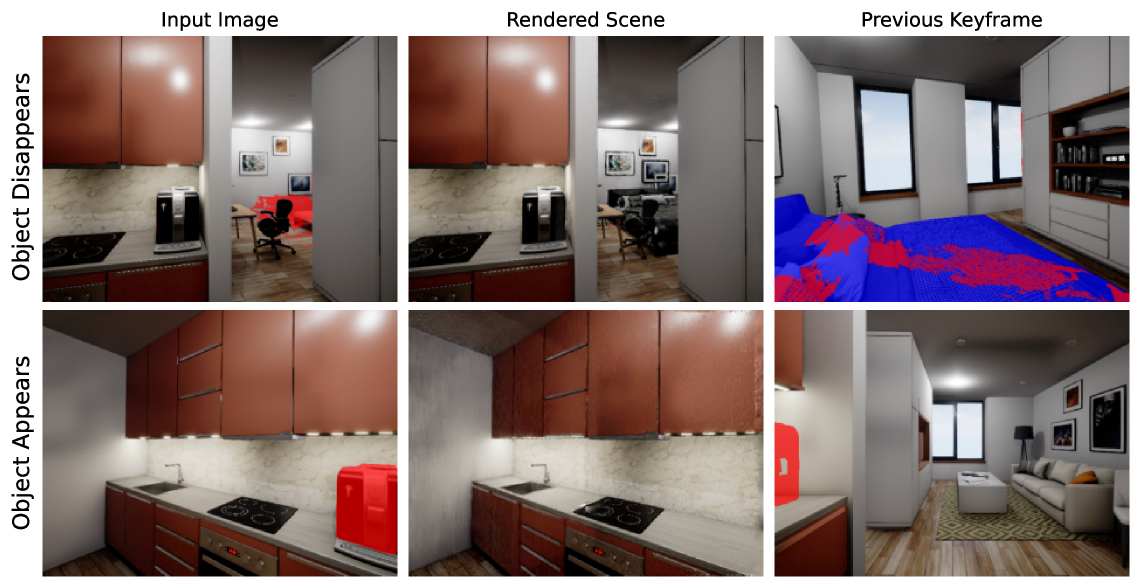

问题定义:论文旨在解决三维场景重建中,现有方法难以处理长期动态变化的问题。具体而言,当场景中的物体发生长时间、超出相机视野的变化时,例如物体被移除、移动或添加,传统的3DGS方法由于依赖过时的观测数据,会导致重建质量下降,出现伪影或不准确的几何结构。

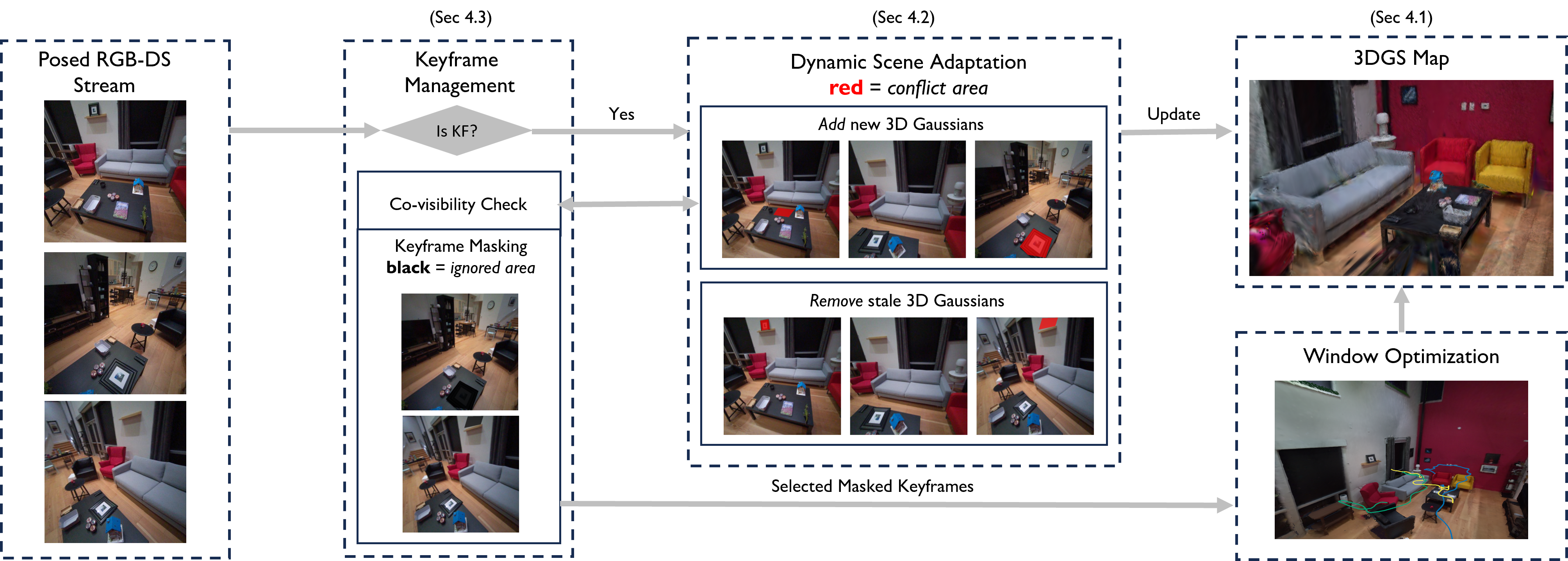

核心思路:论文的核心思路是通过动态更新3DGS模型来适应场景的变化。这包括两个关键部分:一是场景自适应机制,能够根据新的观测数据调整高斯分布的参数;二是关键帧管理机制,用于识别和丢弃过时的观测数据,避免其对重建过程产生负面影响。通过这种方式,模型能够持续学习和适应场景的演变。

技术框架:整体框架包含以下几个主要阶段:1) 使用新的图像序列进行场景观测;2) 利用场景自适应机制更新3DGS模型,调整高斯分布的参数以拟合新的观测数据;3) 通过关键帧管理机制评估和筛选关键帧,丢弃过时的观测数据;4) 使用更新后的3DGS模型进行新视点合成。整个过程循环进行,使模型能够持续适应场景的变化。

关键创新:论文的关键创新在于提出了一个完整的动态场景自适应框架,该框架能够有效地处理长期动态场景。与现有方法相比,该方法不仅能够处理短期的、相机视野内的运动,还能够处理场景中发生的长期变化,例如物体的增删和移动。关键帧管理机制是另一个重要的创新点,它能够有效地去除过时观测的影响,保证重建质量。

关键设计:关键帧管理机制的设计是重要的技术细节。该机制需要评估每个关键帧的有效性,判断其是否包含过时的信息。评估标准可能包括关键帧的年龄、观测到的场景变化程度等。此外,场景自适应机制的具体实现也需要仔细设计,例如如何选择合适的学习率、如何避免过度拟合等。损失函数的设计也至关重要,需要平衡重建精度和鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成和真实世界数据集上均取得了显著的性能提升。与最具竞争力的基线方法相比,PSNR指标提高了29.7%,L1深度误差降低了3倍。这些数据表明,该方法能够有效地处理长期动态场景,并生成高质量的三维重建结果。

🎯 应用场景

该研究成果可应用于增强现实、机器人导航、自动驾驶等领域。在增强现实中,可以实现对动态场景的实时建模和渲染,提供更逼真的用户体验。在机器人导航中,可以帮助机器人更好地理解和适应不断变化的环境,提高导航的准确性和鲁棒性。在自动驾驶中,可以提高车辆对周围环境的感知能力,从而提高驾驶安全性。

📄 摘要(原文)

Mapping systems with novel view synthesis (NVS) capabilities, most notably 3D Gaussian Splatting (3DGS), are widely used in computer vision and across various applications, including augmented reality, robotics, and autonomous driving. However, many current approaches are limited to static scenes. While recent works have begun addressing short-term dynamics (motion within the camera's view), long-term dynamics (the scene evolving through changes out of view) remain less explored. To overcome this limitation, we introduce a dynamic scene-adaptation mechanism that continuously updates 3DGS to reflect the latest changes. Since maintaining consistency remains challenging due to stale observations that disrupt the reconstruction process, we propose a novel keyframe management mechanism that discards outdated observations while preserving as much information as possible. We thoroughly evaluate Gaussian Mapping for Evolving Scenes (\ours) on both synthetic and real-world datasets, achieving a 29.7\% improvement in PSNR and a 3 times improvement in L1 depth error over the most competitive baseline.