Multi-StyleGS: Stylizing Gaussian Splatting with Multiple Styles

作者: Yangkai Lin, Jiabao Lei, Kui jia

分类: cs.CV

发布日期: 2025-06-07

备注: AAAI 2025

期刊: Proceedings of the AAAI Conference on Artificial Intelligence, 39(5), 5289-5297 (2025)

💡 一句话要点

Multi-StyleGS:提出多风格高斯溅射方法,实现高效且可控的3D场景风格化

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 3D高斯溅射 风格迁移 多风格 局部风格控制 语义分割 二分匹配 多视角一致性

📋 核心要点

- 现有3D场景风格化方法难以兼顾风格多样性、内存效率和局部风格控制,尤其是在高斯溅射框架下。

- Multi-StyleGS通过二分匹配建立风格图像与局部区域的对应关系,并设计语义风格损失函数实现局部风格迁移。

- 实验表明,Multi-StyleGS在风格化效果、内存效率和编辑灵活性方面优于现有方法,能生成更精细的纹理和更准确的颜色匹配。

📝 摘要(中文)

近年来,为了创意目的,将给定的3D场景风格化以匹配参考图像的艺术风格的需求日益增长。虽然3D高斯溅射(GS)已经成为一种有前途且高效的现实3D场景建模方法,但如何调整它以通过自动局部风格迁移或手动指定来风格化3D GS,同时保持风格化训练的内存效率仍然是一个挑战。在本文中,我们介绍了一种新颖的3D GS风格化解决方案,称为Multi-StyleGS,以应对这些挑战。特别地,我们采用二分匹配机制来自动识别风格图像和渲染图像的局部区域之间的对应关系。为了促进局部风格迁移,我们引入了一种新颖的语义风格损失函数,该函数采用分割网络将不同的风格应用于场景的各个对象,并提出了一种局部-全局特征匹配来增强多视图一致性。此外,该技术可以实现内存高效的训练,更多的纹理细节和更好的颜色匹配。为了更好地为每个高斯分配鲁棒的语义标签,我们提出了一些技术来规范分割网络。正如我们全面的实验所证明的那样,我们的方法在产生合理的风格化结果和提供灵活的编辑方面优于现有方法。

🔬 方法详解

问题定义:论文旨在解决3D高斯溅射(GS)场景的多风格风格化问题。现有方法在将3D GS与多种风格对齐时,面临内存效率低、难以进行局部风格控制以及风格迁移效果不佳等痛点。这些问题限制了3D场景风格化的灵活性和实用性。

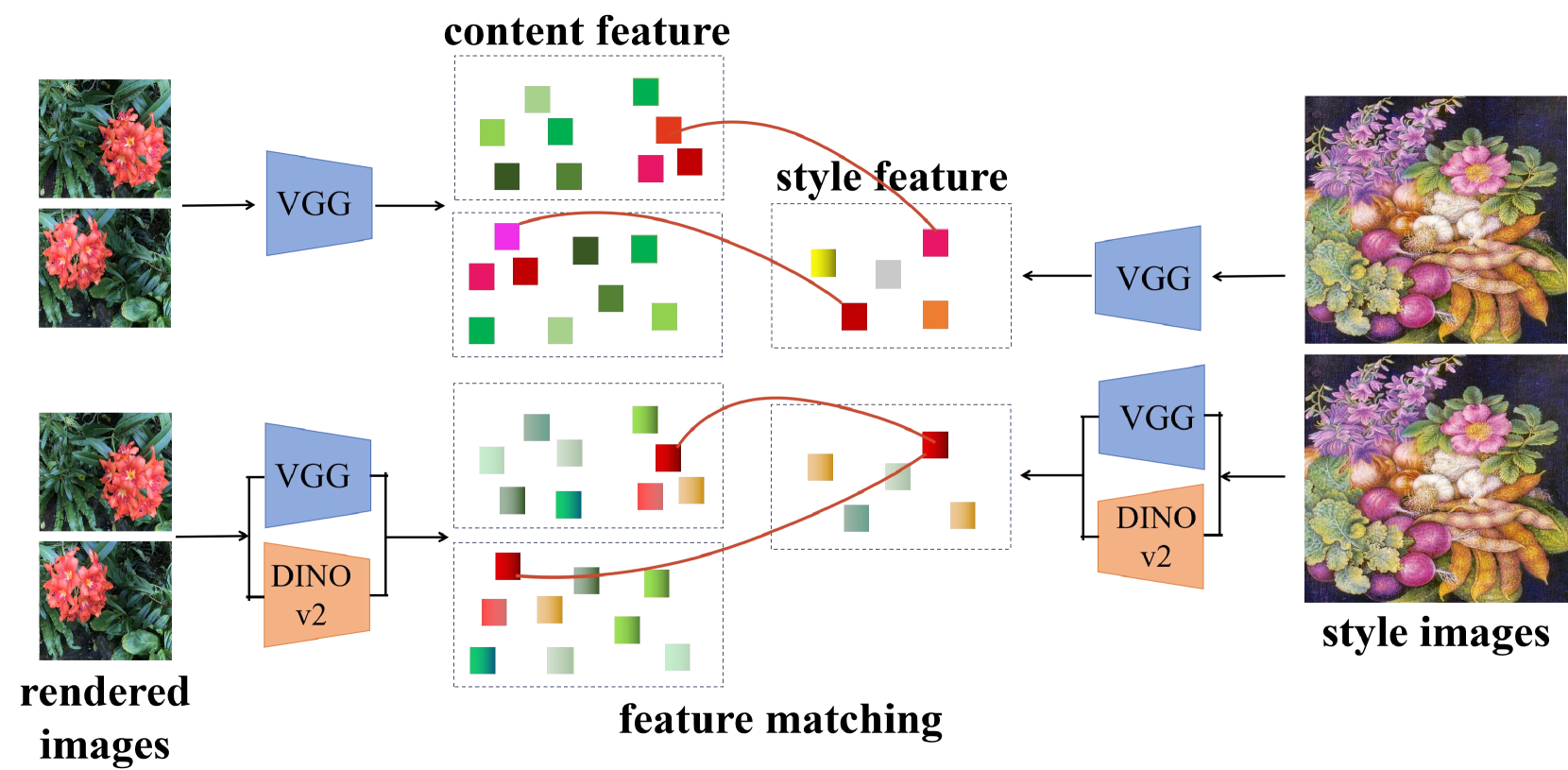

核心思路:论文的核心思路是利用二分匹配机制建立风格图像和渲染图像局部区域之间的对应关系,从而实现自动化的局部风格迁移。通过引入语义风格损失函数,可以针对场景中的不同对象应用不同的风格,并利用局部-全局特征匹配来增强多视角一致性,最终实现高效且可控的多风格3D GS风格化。

技术框架:Multi-StyleGS的技术框架主要包含以下几个模块:1) 二分匹配模块:自动建立风格图像和渲染图像局部区域的对应关系。2) 语义分割模块:利用分割网络为每个高斯分配语义标签,从而区分场景中的不同对象。3) 风格迁移模块:基于语义风格损失函数,将不同的风格应用于不同的对象。4) 多视角一致性增强模块:通过局部-全局特征匹配,增强风格化结果的多视角一致性。5) 高斯溅射渲染模块:利用风格化后的高斯参数,渲染最终的3D场景。

关键创新:论文的关键创新点在于:1) 提出了一种基于二分匹配的自动局部风格迁移方法,能够将不同的风格应用于场景的不同区域。2) 引入了一种语义风格损失函数,该函数利用分割网络来区分场景中的不同对象,并针对性地进行风格迁移。3) 提出了一种局部-全局特征匹配方法,用于增强风格化结果的多视角一致性。

关键设计:在关键设计方面,论文采用了以下策略:1) 使用预训练的分割网络来提取语义信息,并通过正则化技术来提高分割的准确性。2) 设计了一种新的语义风格损失函数,该函数基于分割结果,将不同的风格应用于不同的对象。3) 采用局部-全局特征匹配来增强多视角一致性,其中局部特征用于捕捉细节,全局特征用于保持整体结构。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Multi-StyleGS在风格化效果上优于现有方法,能够生成更精细的纹理和更准确的颜色匹配。此外,Multi-StyleGS在内存效率方面也具有优势,可以在有限的计算资源下进行训练。通过消融实验验证了各个模块的有效性,例如语义风格损失函数和局部-全局特征匹配对风格化效果和多视角一致性的提升。

🎯 应用场景

Multi-StyleGS在游戏开发、电影制作、广告设计等领域具有广泛的应用前景。它可以用于快速生成具有不同艺术风格的3D场景,例如将照片风格迁移到3D模型,或者将3D场景渲染成卡通风格。此外,该技术还可以用于虚拟现实和增强现实应用中,为用户提供更加个性化和沉浸式的体验。

📄 摘要(原文)

In recent years, there has been a growing demand to stylize a given 3D scene to align with the artistic style of reference images for creative purposes. While 3D Gaussian Splatting(GS) has emerged as a promising and efficient method for realistic 3D scene modeling, there remains a challenge in adapting it to stylize 3D GS to match with multiple styles through automatic local style transfer or manual designation, while maintaining memory efficiency for stylization training. In this paper, we introduce a novel 3D GS stylization solution termed Multi-StyleGS to tackle these challenges. In particular, we employ a bipartite matching mechanism to au tomatically identify correspondences between the style images and the local regions of the rendered images. To facilitate local style transfer, we introduce a novel semantic style loss function that employs a segmentation network to apply distinct styles to various objects of the scene and propose a local-global feature matching to enhance the multi-view consistency. Furthermore, this technique can achieve memory efficient training, more texture details and better color match. To better assign a robust semantic label to each Gaussian, we propose several techniques to regularize the segmentation network. As demonstrated by our comprehensive experiments, our approach outperforms existing ones in producing plausible stylization results and offering flexible editing.