Parallel Rescaling: Rebalancing Consistency Guidance for Personalized Diffusion Models

作者: JungWoo Chae, Jiyoon Kim, Sangheum Hwang

分类: cs.CV, cs.AI

发布日期: 2025-05-31

💡 一句话要点

提出并行重缩放方法,提升个性化扩散模型在少量样本下的prompt对齐度与图像质量

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 个性化扩散模型 一致性引导 无分类器引导 图像生成 prompt对齐

📋 核心要点

- 现有个性化扩散模型在少量样本下易过拟合,导致生成图像与prompt不一致,尤其在处理复杂或风格化prompt时。

- 论文提出并行重缩放技术,将一致性引导信号分解为平行和正交分量,通过重缩放平行分量减少对无分类器引导的干扰。

- 实验表明,该方法在prompt对齐和视觉保真度方面优于现有方法,无需额外训练数据或标注。

📝 摘要(中文)

个性化扩散模型以适应特定用户或概念仍然具有挑战性,尤其是在只有少量参考图像可用时。诸如DreamBooth和Textual Inversion等现有方法通常会过度拟合有限的数据,导致在尝试平衡身份保真度与prompt一致性时,生成的图像与文本prompt之间出现错位。虽然直接一致性优化(DCO)及其一致性引导采样在一定程度上缓解了这个问题,但它仍然难以处理复杂或风格化的prompt。在本文中,我们提出了一种用于个性化扩散模型的并行重缩放技术。我们的方法将一致性引导信号显式地分解为相对于无分类器引导(CFG)的并行和正交分量。通过重缩放并行分量,我们最大限度地减少了对CFG的破坏性干扰,同时保留了主体的身份。与先前的个性化方法不同,我们的技术不需要额外的训练数据或昂贵的注释。大量的实验表明,与基线方法相比,即使在具有挑战性的风格化prompt上,prompt对齐和视觉保真度也得到了改善。这些发现突出了并行重缩放引导在为不同的用户输入产生更稳定和准确的个性化方面的潜力。

🔬 方法详解

问题定义:现有个性化扩散模型,如DreamBooth和Textual Inversion,在仅有少量参考图像的情况下,容易出现过拟合现象。这导致模型在生成图像时,难以同时保持与参考图像的身份一致性,以及与文本prompt的语义一致性,尤其是在处理复杂或风格化的prompt时,prompt对齐度较低。

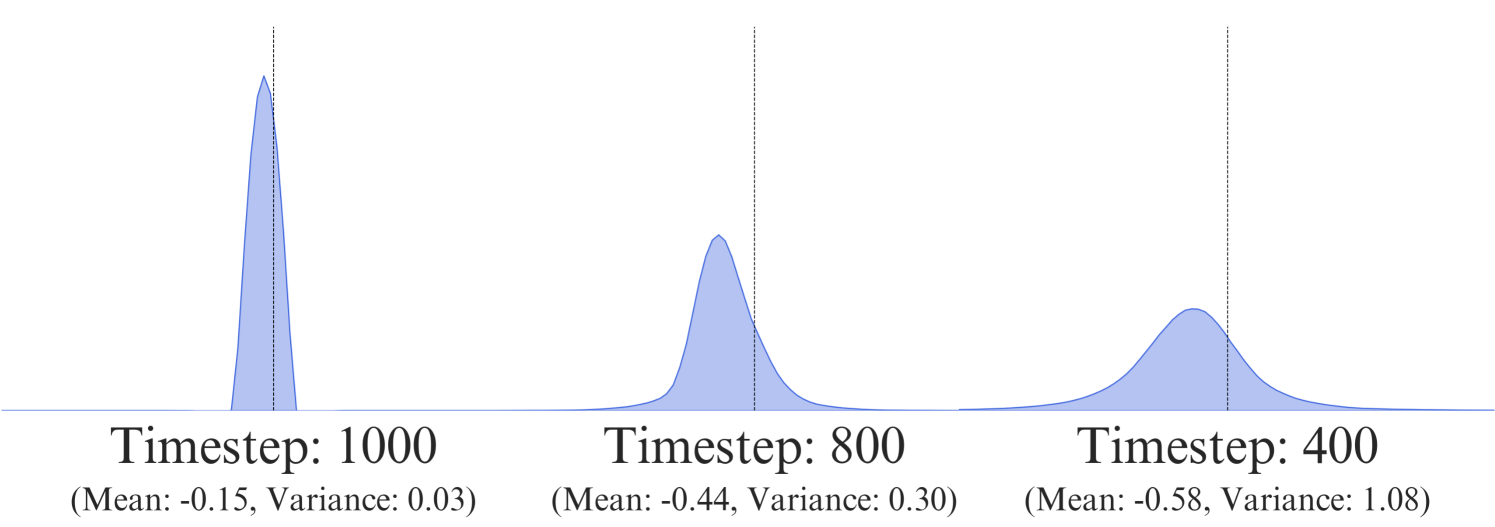

核心思路:论文的核心思路是将一致性引导信号分解为两个正交的分量:平行于无分类器引导(CFG)的分量和垂直于CFG的分量。作者认为,直接应用一致性引导会干扰CFG,导致prompt对齐度下降。因此,通过重缩放平行分量,可以减少这种干扰,同时保留参考图像的身份信息。

技术框架:该方法在现有的扩散模型框架上进行改进,主要包含以下步骤:1. 使用DCO(Direct Consistency Optimization)进行个性化训练。2. 在推理阶段,将一致性引导信号分解为平行和正交分量。3. 对平行分量进行重缩放,减小其对CFG的干扰。4. 将重缩放后的平行分量和正交分量重新组合,得到最终的引导信号。5. 使用该引导信号进行采样,生成图像。

关键创新:该方法最重要的创新点在于对一致性引导信号的分解和重缩放。通过将引导信号分解为平行和正交分量,并有选择性地调整平行分量的强度,可以更精细地控制身份保真度和prompt对齐度之间的平衡。与现有方法相比,该方法不需要额外的训练数据或标注,且能够更好地处理复杂和风格化的prompt。

关键设计:关键设计在于如何确定平行分量的重缩放比例。论文中可能采用了一种自适应的策略,根据prompt的复杂程度或风格化程度,动态地调整重缩放比例。具体的损失函数和网络结构细节未知,但整体框架是在现有扩散模型的基础上进行改进,没有引入全新的网络结构。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在prompt对齐度和视觉保真度方面均优于现有方法,尤其是在处理复杂和风格化的prompt时。具体性能提升数据未知,但论文强调了该方法在无需额外训练数据或标注的情况下,能够显著改善个性化扩散模型的生成效果。

🎯 应用场景

该研究成果可广泛应用于图像生成、风格迁移、虚拟形象定制等领域。例如,用户可以使用少量照片定制个性化的图像生成模型,生成具有特定风格或身份特征的图像。该技术在游戏、社交媒体、电商等领域具有潜在的应用价值,可以提升用户体验,降低内容创作成本。

📄 摘要(原文)

Personalizing diffusion models to specific users or concepts remains challenging, particularly when only a few reference images are available. Existing methods such as DreamBooth and Textual Inversion often overfit to limited data, causing misalignment between generated images and text prompts when attempting to balance identity fidelity with prompt adherence. While Direct Consistency Optimization (DCO) with its consistency-guided sampling partially alleviates this issue, it still struggles with complex or stylized prompts. In this paper, we propose a parallel rescaling technique for personalized diffusion models. Our approach explicitly decomposes the consistency guidance signal into parallel and orthogonal components relative to classifier free guidance (CFG). By rescaling the parallel component, we minimize disruptive interference with CFG while preserving the subject's identity. Unlike prior personalization methods, our technique does not require additional training data or expensive annotations. Extensive experiments show improved prompt alignment and visual fidelity compared to baseline methods, even on challenging stylized prompts. These findings highlight the potential of parallel rescaled guidance to yield more stable and accurate personalization for diverse user inputs.