SatDreamer360: Multiview-Consistent Generation of Ground-Level Scenes from Satellite Imagery

作者: Xianghui Ze, Beiyi Zhu, Zhenbo Song, Jianfeng Lu, Yujiao Shi

分类: cs.CV

发布日期: 2025-05-31 (更新: 2025-10-11)

💡 一句话要点

SatDreamer360:提出多视角一致的卫星图像到地面场景生成框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 卫星图像 地面全景图生成 多视角一致性 三平面表示 射线注意力

📋 核心要点

- 现有方法难以从卫星图像生成多视角一致的地面全景图,通常依赖辅助输入或手工设计的投影。

- SatDreamer360利用三平面表示和射线注意力机制处理视角差异,并引入全景极线约束注意力保持多帧一致性。

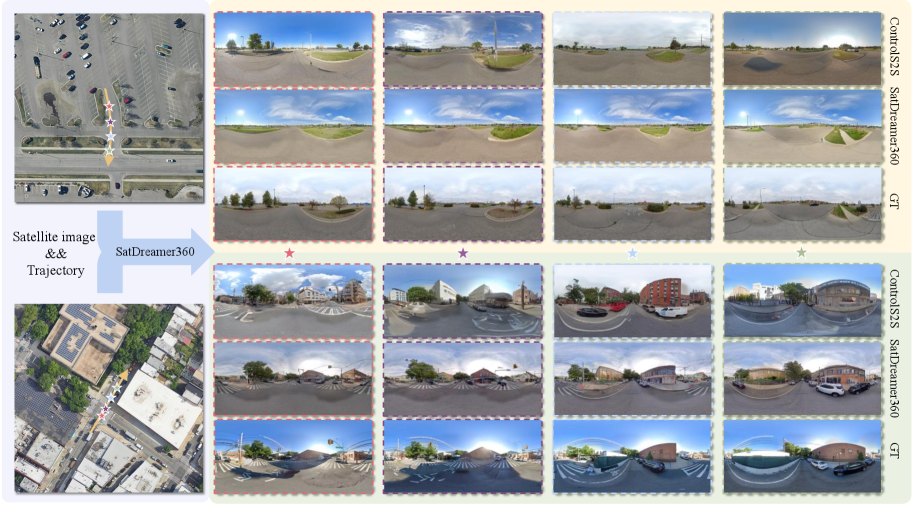

- 实验表明,SatDreamer360在卫星到地面场景对齐和多视角一致性方面均优于现有技术,并发布了VIGOR++数据集。

📝 摘要(中文)

本文提出SatDreamer360,一个从单张卫星图像生成几何一致的多视角地面全景图的框架,并给定预定义的姿态轨迹。为了解决地面和卫星图像之间的大视角差异,我们采用三平面表示来编码场景特征,并设计了一种基于射线的像素注意力机制,从三平面中检索特定视角的特征。为了保持多帧一致性,我们引入了一个全景极线约束注意力模块,该模块基于已知的相对姿态对齐跨帧的特征。为了支持评估,我们引入了{VIGOR++},这是一个大规模数据集,用于从卫星图像生成多视角地面全景图,通过用更多的地面视图图像及其姿态注释来扩充原始VIGOR数据集。实验表明,SatDreamer360在卫星到地面的对齐和多视角一致性方面优于现有方法。

🔬 方法详解

问题定义:现有方法在从卫星图像生成多视角一致的地面全景图时面临挑战。它们通常依赖于额外的输入(如高度图)或手工设计的投影,并且难以保证生成图像在不同视角下的一致性。视角差异大是另一个痛点。

核心思路:SatDreamer360的核心思路是利用三平面表示来编码场景特征,并设计一个基于射线的像素注意力机制,以便从三平面中检索特定视角的特征。此外,为了保持多帧之间的一致性,引入了全景极线约束注意力模块,利用已知的相对姿态来对齐不同帧之间的特征。

技术框架:SatDreamer360框架主要包含以下几个模块:1) 三平面特征编码器:将卫星图像编码为三平面特征表示。2) 射线像素注意力模块:基于射线和像素注意力机制,从三平面特征中提取特定视角的特征。3) 全景极线约束注意力模块:利用全景极线约束,对齐不同帧之间的特征,保证多视角一致性。4) 图像生成器:将提取的特征解码为地面全景图像。

关键创新:SatDreamer360的关键创新在于:1) 提出了基于射线的像素注意力机制,能够有效地处理卫星图像和地面图像之间的视角差异。2) 引入了全景极线约束注意力模块,利用已知的相机姿态信息,保证生成图像在不同视角下的一致性。3) 构建了大规模数据集VIGOR++,为该领域的研究提供了数据支持。

关键设计:射线像素注意力模块的设计中,射线方向的选择和像素注意力权重的计算是关键。全景极线约束注意力模块中,极线约束的精确计算和特征对齐策略至关重要。损失函数的设计需要同时考虑图像质量和多视角一致性。具体参数设置和网络结构细节在论文中有详细描述,此处未知。

🖼️ 关键图片

📊 实验亮点

SatDreamer360在VIGOR++数据集上进行了实验,结果表明,该方法在卫星到地面场景对齐和多视角一致性方面均优于现有方法。具体性能数据和对比基线在论文中给出,但此处未知。VIGOR++数据集的发布也为该领域的研究提供了重要的资源。

🎯 应用场景

SatDreamer360具有广泛的应用前景,包括:1) 模拟环境生成,可用于自动驾驶和机器人导航的训练。2) 城市数字孪生,可以从卫星图像快速生成城市的三维模型。3) 游戏和虚拟现实,可以用于创建逼真的地面场景。该研究有助于降低三维场景重建的成本,并提高生成场景的真实感和一致性。

📄 摘要(原文)

Generating multiview-consistent $360^\circ$ ground-level scenes from satellite imagery is a challenging task with broad applications in simulation, autonomous navigation, and digital twin cities. Existing approaches primarily focus on synthesizing individual ground-view panoramas, often relying on auxiliary inputs like height maps or handcrafted projections, and struggle to produce multiview consistent sequences. In this paper, we propose SatDreamer360, a framework that generates geometrically consistent multi-view ground-level panoramas from a single satellite image, given a predefined pose trajectory. To address the large viewpoint discrepancy between ground and satellite images, we adopt a triplane representation to encode scene features and design a ray-based pixel attention mechanism that retrieves view-specific features from the triplane. To maintain multi-frame consistency, we introduce a panoramic epipolar-constrained attention module that aligns features across frames based on known relative poses. To support the evaluation, we introduce {VIGOR++}, a large-scale dataset for generating multi-view ground panoramas from a satellite image, by augmenting the original VIGOR dataset with more ground-view images and their pose annotations. Experiments show that SatDreamer360 outperforms existing methods in both satellite-to-ground alignment and multiview consistency.