ACM-UNet: Adaptive Integration of CNNs and Mamba for Efficient Medical Image Segmentation

作者: Jing Huang, Yongkang Zhao, Yuhan Li, Zhitao Dai, Cheng Chen, Qiying Lai

分类: cs.CV

发布日期: 2025-05-30

备注: 10 pages, 3 figures, 5 tables

🔗 代码/项目: GITHUB

💡 一句话要点

ACM-UNet:自适应融合CNN与Mamba,高效医学图像分割

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 医学图像分割 U-Net 卷积神经网络 状态空间模型 Mamba 特征融合 预训练模型

📋 核心要点

- 现有医学图像分割方法难以充分利用预训练视觉骨干网络,存在结构不匹配问题。

- ACM-UNet通过轻量级适配器融合CNN和Mamba,结合局部细节提取和长程依赖建模的优势。

- 实验表明,ACM-UNet在Synapse和ACDC数据集上实现了SOTA性能,并保持了计算效率。

📝 摘要(中文)

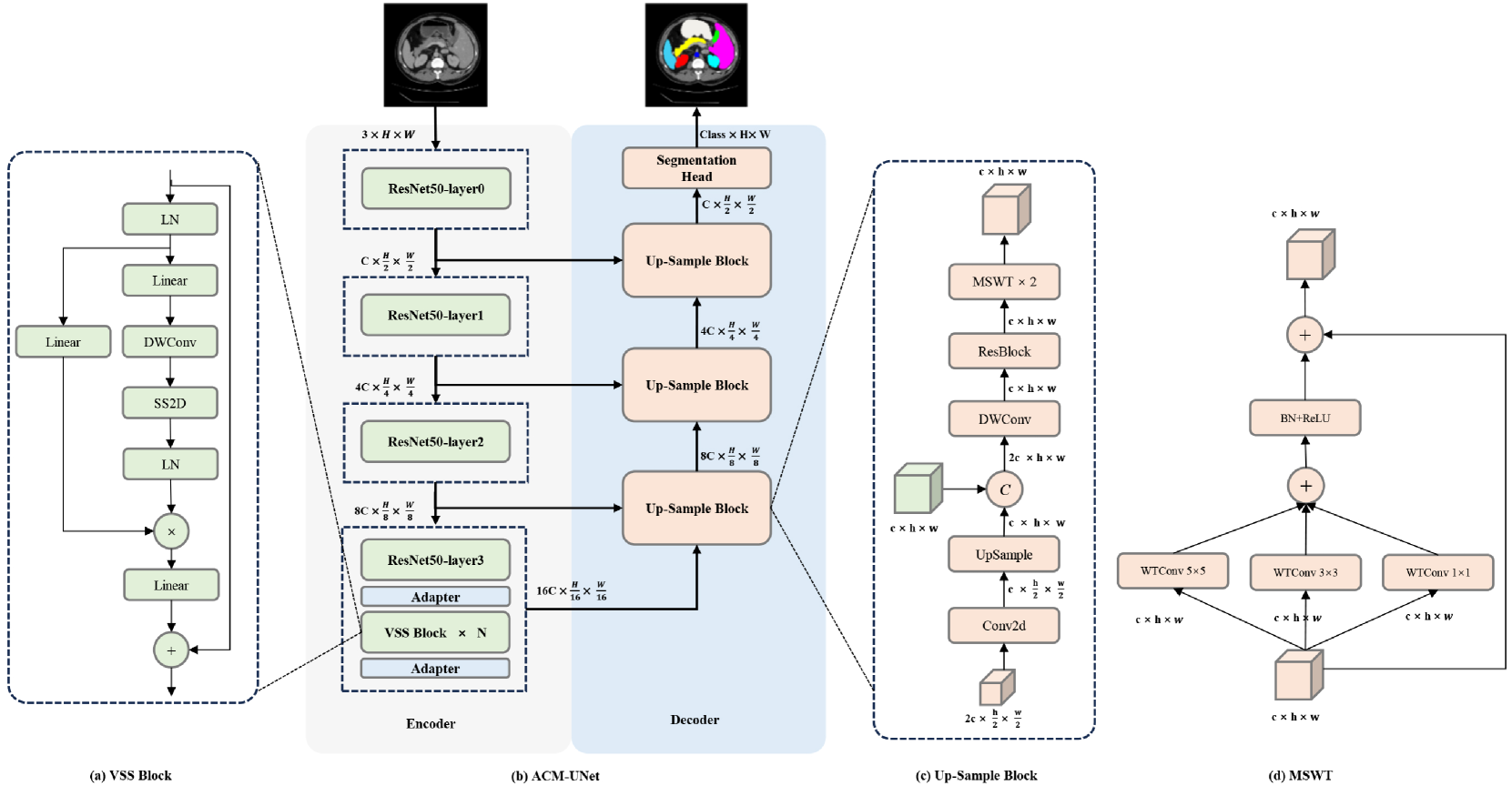

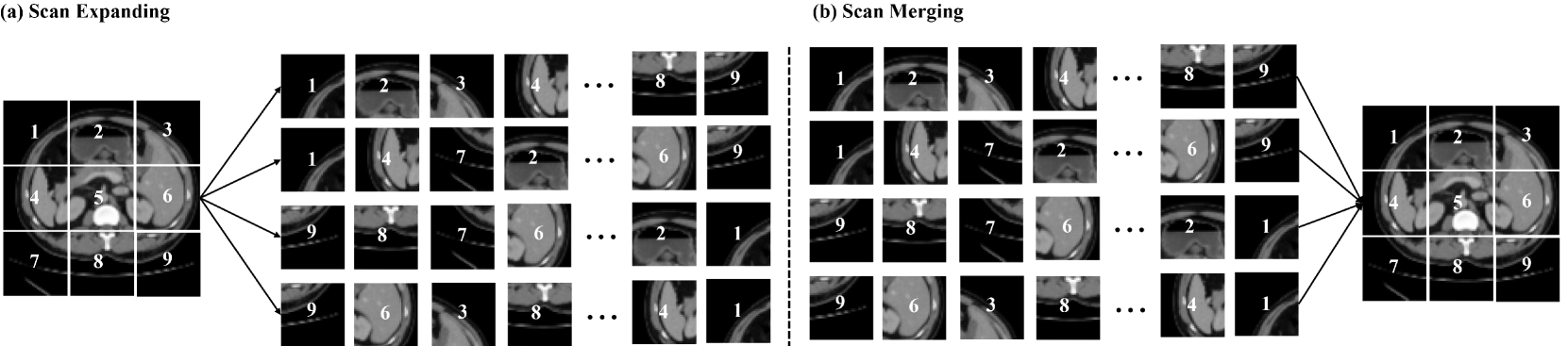

本文提出了一种名为ACM-UNet的通用分割框架,旨在解决医学图像分割中U型编码器-解码器架构难以充分利用预训练视觉骨干网络(如ResNet、ViT、VMamba)的问题。ACM-UNet保留了类似UNet的简单设计,并通过轻量级的适配器机制有效地整合了预训练的CNN和Mamba模型。该适配器解决了架构不兼容的问题,使模型能够利用CNN和SSM的互补优势,即细粒度的局部细节提取和长程依赖建模。此外,在解码器中提出了一种分层多尺度小波变换模块,以增强特征融合和重建保真度。在Synapse和ACDC基准数据集上的大量实验表明,ACM-UNet在保持计算效率的同时,实现了最先进的性能。特别是在Synapse数据集上,以17.93G FLOPs达到了85.12%的Dice Score和13.89mm的HD95,展示了其有效性和可扩展性。

🔬 方法详解

问题定义:医学图像分割任务中,U型网络结构被广泛应用,但如何有效利用预训练的CNN和State Space Models (SSMs) 骨干网络是一个挑战。现有方法由于结构差异,难以充分发挥预训练模型的优势,导致分割精度受限,且计算成本较高。

核心思路:ACM-UNet的核心在于通过一个轻量级的适配器模块,弥合CNN和Mamba等SSM之间的结构差异,从而能够无缝地将预训练的CNN和Mamba模型集成到UNet框架中。这种设计旨在结合CNN强大的局部特征提取能力和Mamba模型对长程依赖关系建模的优势,提升分割性能。

技术框架:ACM-UNet整体采用U型编码器-解码器架构。编码器部分可以灵活选择预训练的CNN(如ResNet)或Mamba模型作为骨干网络。适配器模块位于编码器和解码器之间,负责将不同骨干网络提取的特征进行转换和融合。解码器部分引入了分层多尺度小波变换模块,用于增强特征融合和重建图像细节。跳跃连接将编码器和解码器对应层级的特征连接起来,进一步提升分割精度。

关键创新:ACM-UNet的关键创新在于轻量级适配器模块的设计,它能够有效地解决CNN和Mamba等SSM之间的结构不兼容问题,使得预训练模型能够更好地应用于医学图像分割任务。此外,分层多尺度小波变换模块的引入,也增强了特征融合和重建能力。

关键设计:适配器模块采用轻量级卷积层和注意力机制,用于特征转换和融合。分层多尺度小波变换模块通过不同尺度的小波变换提取图像的多尺度特征,并进行融合。损失函数采用Dice Loss和Cross-Entropy Loss的组合,以平衡分割精度和类别不平衡问题。

🖼️ 关键图片

📊 实验亮点

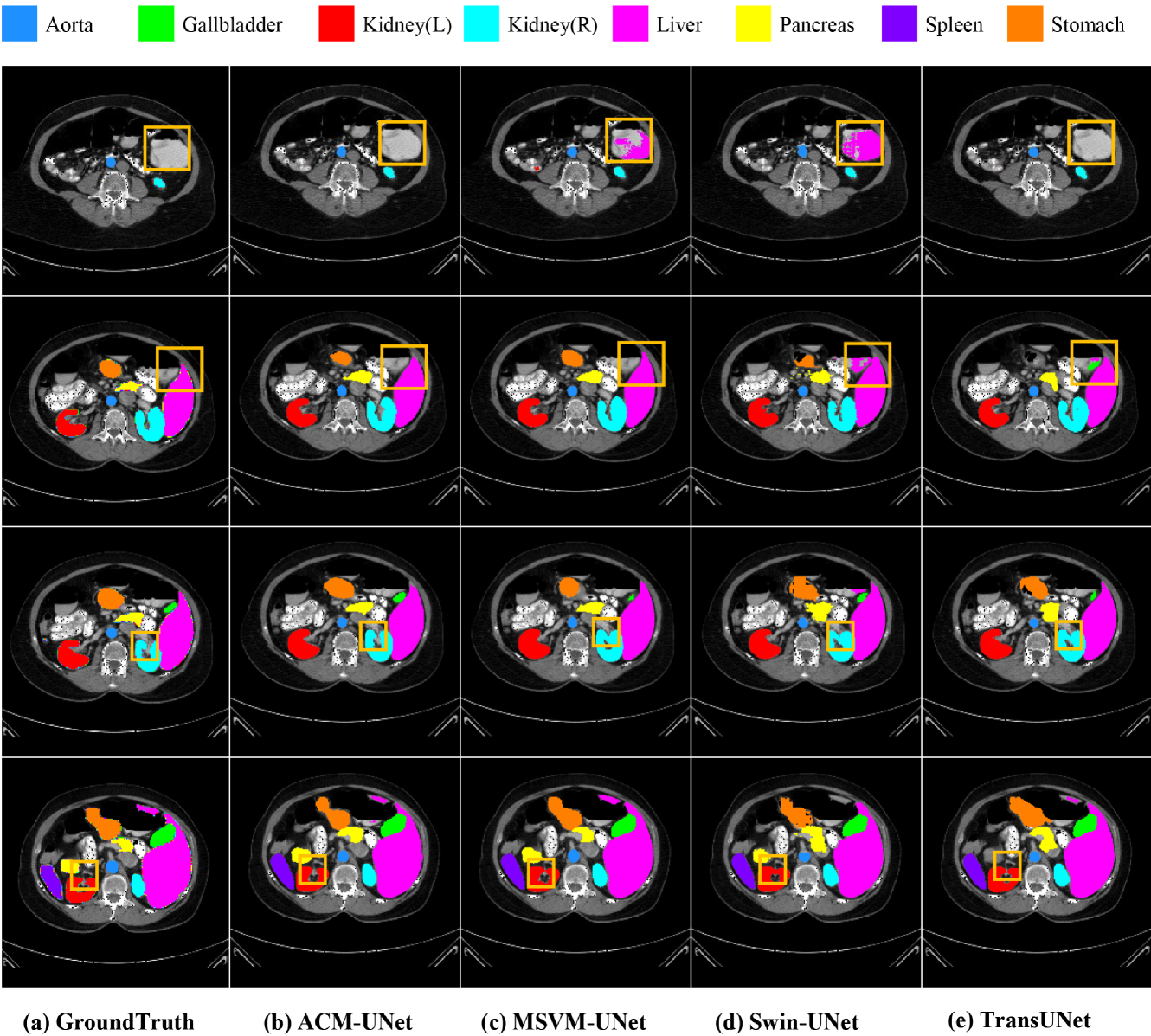

ACM-UNet在Synapse数据集上取得了显著的性能提升,Dice Score达到85.12%,HD95为13.89mm,超越了现有SOTA方法。同时,该模型保持了较低的计算复杂度,FLOPs仅为17.93G,表明其在保证分割精度的同时,具有较高的计算效率。在ACDC数据集上也取得了具有竞争力的结果,验证了其泛化能力。

🎯 应用场景

ACM-UNet具有广泛的应用前景,可用于各种医学图像分割任务,例如器官分割、肿瘤分割、病灶分割等。该研究成果有助于提高医学图像分析的准确性和效率,辅助医生进行疾病诊断和治疗计划制定,具有重要的临床应用价值。未来,该方法可以扩展到其他图像分割领域,例如遥感图像分析、自动驾驶等。

📄 摘要(原文)

The U-shaped encoder-decoder architecture with skip connections has become a prevailing paradigm in medical image segmentation due to its simplicity and effectiveness. While many recent works aim to improve this framework by designing more powerful encoders and decoders, employing advanced convolutional neural networks (CNNs) for local feature extraction, Transformers or state space models (SSMs) such as Mamba for global context modeling, or hybrid combinations of both, these methods often struggle to fully utilize pretrained vision backbones (e.g., ResNet, ViT, VMamba) due to structural mismatches. To bridge this gap, we introduce ACM-UNet, a general-purpose segmentation framework that retains a simple UNet-like design while effectively incorporating pretrained CNNs and Mamba models through a lightweight adapter mechanism. This adapter resolves architectural incompatibilities and enables the model to harness the complementary strengths of CNNs and SSMs-namely, fine-grained local detail extraction and long-range dependency modeling. Additionally, we propose a hierarchical multi-scale wavelet transform module in the decoder to enhance feature fusion and reconstruction fidelity. Extensive experiments on the Synapse and ACDC benchmarks demonstrate that ACM-UNet achieves state-of-the-art performance while remaining computationally efficient. Notably, it reaches 85.12% Dice Score and 13.89mm HD95 on the Synapse dataset with 17.93G FLOPs, showcasing its effectiveness and scalability. Code is available at: https://github.com/zyklcode/ACM-UNet.