Leadership Assessment in Pediatric Intensive Care Unit Team Training

作者: Liangyang Ouyang, Yuki Sakai, Ryosuke Furuta, Hisataka Nozawa, Hikoro Matsui, Yoichi Sato

分类: cs.CV

发布日期: 2025-05-30 (更新: 2025-08-28)

备注: This paper is accepted by EgoVis Workshop at CVPR 2025

💡 一句话要点

提出基于第一视角视频的PICU团队领导力自动评估框架

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 第一视角视觉 领导力评估 PICU团队培训 多模态分析 行为识别

📋 核心要点

- 现有PICU团队领导力评估依赖人工观察,效率低且主观性强,缺乏客观量化方法。

- 利用第一视角视频,结合注视、眼神交流和对话等多模态信息,构建自动化评估框架。

- 实验结果表明,该框架提取的行为指标与领导力技能显著相关,验证了其有效性。

📝 摘要(中文)

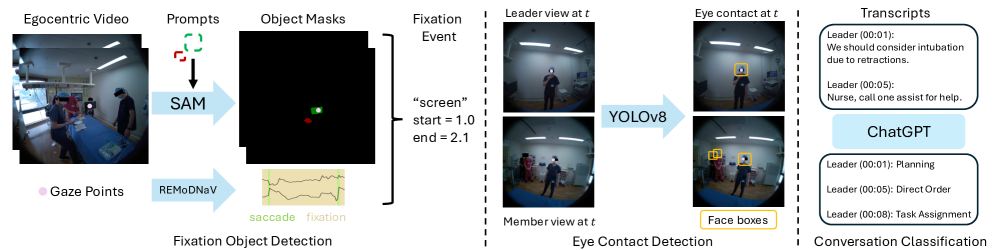

本文旨在通过开发基于第一视角视觉的自动化分析框架,评估儿科重症监护病房(PICU)团队的领导力。我们确定了关键的行为线索,包括注视对象、眼神交流和对话模式,作为领导力评估的重要指标。为了捕捉这些多模态信号,我们使用Aria眼镜记录第一视角视频、音频、视线和头部运动数据。我们收集了四场模拟会话的一小时视频,这些会话涉及不同角色和级别的医生。为了自动化数据处理,我们提出了一种利用REMoDNaV、SAM、YOLO和ChatGPT的方法,用于注视对象检测、眼神交流检测和对话分类。实验表明,领导力技能与行为指标(即我们提出的方法的输出)之间存在显著相关性,例如注视时间、转换模式和语音中的直接指令。这些结果表明,我们提出的数据收集和分析框架可以有效地解决PICU团队培训的技能评估问题。

🔬 方法详解

问题定义:论文旨在解决儿科重症监护病房(PICU)团队培训中领导力技能评估的问题。现有方法主要依赖人工观察和评估,存在效率低下、主观性强、难以量化等痛点。缺乏一种客观、自动化的评估方法来有效评估和提升PICU团队的领导力。

核心思路:论文的核心思路是利用第一视角(Egocentric)视觉技术,捕捉团队成员在模拟场景中的行为数据,并结合多模态信息(视频、音频、视线、头部运动),提取与领导力相关的行为特征。通过分析这些特征,实现对领导力技能的自动化评估。这样设计的目的是为了更客观、更全面地了解团队成员的行为模式,从而更准确地评估其领导力。

技术框架:整体框架包括数据采集、数据处理和领导力评估三个主要阶段。 1. 数据采集:使用Aria眼镜记录参与者在模拟PICU场景中的第一视角视频、音频、视线和头部运动数据。 2. 数据处理:利用REMoDNaV、SAM、YOLO和ChatGPT等模型,分别进行注视对象检测、眼神交流检测和对话分类。 3. 领导力评估:分析提取的行为指标(如注视时间、转换模式、语音中的指令等),并将其与领导力技能进行关联分析,从而实现领导力评估。

关键创新:论文的关键创新在于将第一视角视觉技术应用于PICU团队领导力评估,并结合多种深度学习模型实现多模态信息的自动化处理。与传统的人工评估方法相比,该方法更加客观、高效,并且能够提供更细粒度的行为分析。此外,利用ChatGPT进行对话分类,能够更准确地识别语音中的指令和沟通模式。

关键设计:在数据处理阶段,论文采用了以下关键设计: 1. 使用REMoDNaV进行头部运动和环境重建,为后续的注视对象检测提供基础。 2. 使用SAM和YOLO进行注视对象检测,识别参与者关注的对象。 3. 使用ChatGPT进行对话分类,识别语音中的指令、提问等关键信息。 4. 通过统计注视时间、转换模式、眼神交流频率、指令数量等行为指标,构建领导力评估模型。具体参数设置和损失函数等细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架提取的行为指标与领导力技能之间存在显著相关性。例如,注视时间、转换模式和语音中的直接指令等指标与领导力评估结果呈正相关。这些结果验证了该框架的有效性,表明其能够客观地评估PICU团队的领导力。

🎯 应用场景

该研究成果可应用于医疗团队培训、领导力发展、人机协作等领域。通过客观评估团队成员的行为,可以有针对性地改进培训方案,提升团队协作效率和患者安全。此外,该技术还可扩展到其他需要团队合作的领域,如航空、军事等。

📄 摘要(原文)

This paper addresses the task of assessing PICU team's leadership skills by developing an automated analysis framework based on egocentric vision. We identify key behavioral cues, including fixation object, eye contact, and conversation patterns, as essential indicators of leadership assessment. In order to capture these multimodal signals, we employ Aria Glasses to record egocentric video, audio, gaze, and head movement data. We collect one-hour videos of four simulated sessions involving doctors with different roles and levels. To automate data processing, we propose a method leveraging REMoDNaV, SAM, YOLO, and ChatGPT for fixation object detection, eye contact detection, and conversation classification. In the experiments, significant correlations are observed between leadership skills and behavioral metrics, i.e., the output of our proposed methods, such as fixation time, transition patterns, and direct orders in speech. These results indicate that our proposed data collection and analysis framework can effectively solve skill assessment for training PICU teams.