Learning Hierarchical Sparse Transform Coding of 3DGS

作者: Hao Xu, Xiaolin Wu, Xi Zhang

分类: cs.CV, eess.IV

发布日期: 2025-05-28 (更新: 2025-11-25)

备注: Our code will be released at \href{https://github.com/hxu160/SHTC_for_3DGS_compression}{here}

🔗 代码/项目: GITHUB

💡 一句话要点

提出SHTC:一种稀疏引导的分层变换编码方法,用于高效压缩3DGS模型。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 压缩编码 神经变换编码 稀疏编码 分层编码

📋 核心要点

- 现有3DGS压缩方法依赖锚点架构和熵编码,忽略了分析-合成变换,导致冗余信息未被有效去除,熵编码负担过重。

- SHTC方法通过引入稀疏引导的分层变换编码,利用KLT和场景自适应神经变换,实现更高效的冗余去除和压缩。

- 实验表明,SHTC在R-D性能上优于现有方法,同时提升了解码速度,并具有参数效率高的优点。

📝 摘要(中文)

3D高斯溅射(3DGS)支持快速、高质量的新视角合成,但内存占用量大,因此压缩其模型至关重要。目前最先进的(SOTA) 3DGS压缩方法采用基于锚点的架构,将Scaffold-GS表示与条件熵编码配对。然而,这些方法放弃了分析-合成变换,这是视觉数据压缩中的一个重要机制。因此,冗余仍然存在于信号中,并且其消除留给熵编码器,这在计算上加重了熵编码模块的负担,增加了编码延迟。即使增加了复杂性,彻底消除冗余也是熵编码器不适合的任务。为了解决这个关键的遗漏,我们引入了一种稀疏引导的分层变换编码(SHTC)方法,这是对3DGS的端到端学习神经变换编码的首次研究。SHTC应用KLT来解相关锚点内的属性,然后进行量化和熵编码,然后使用低复杂度的、场景自适应的神经变换来压缩KLT残差。在稀疏先验和深度展开技术的帮助下,学习到的变换仅使用少量可训练的参数,从而减少了内存使用。总的来说,SHTC实现了明显改进的R-D性能,同时比SOTA具有更高的解码速度。其先验引导的、参数高效的设计也可能启发低复杂度的神经图像和视频编解码器。我们的代码将在https://github.com/hxu160/SHTC_for_3DGS_compression上发布。

🔬 方法详解

问题定义:现有3DGS压缩方法,如基于锚点的Scaffold-GS,主要依赖条件熵编码来去除冗余。这种方法忽略了分析-合成变换,导致信号中的冗余信息无法充分去除,增加了熵编码器的计算负担,降低了编码效率。现有方法在冗余去除方面存在不足,影响了压缩性能。

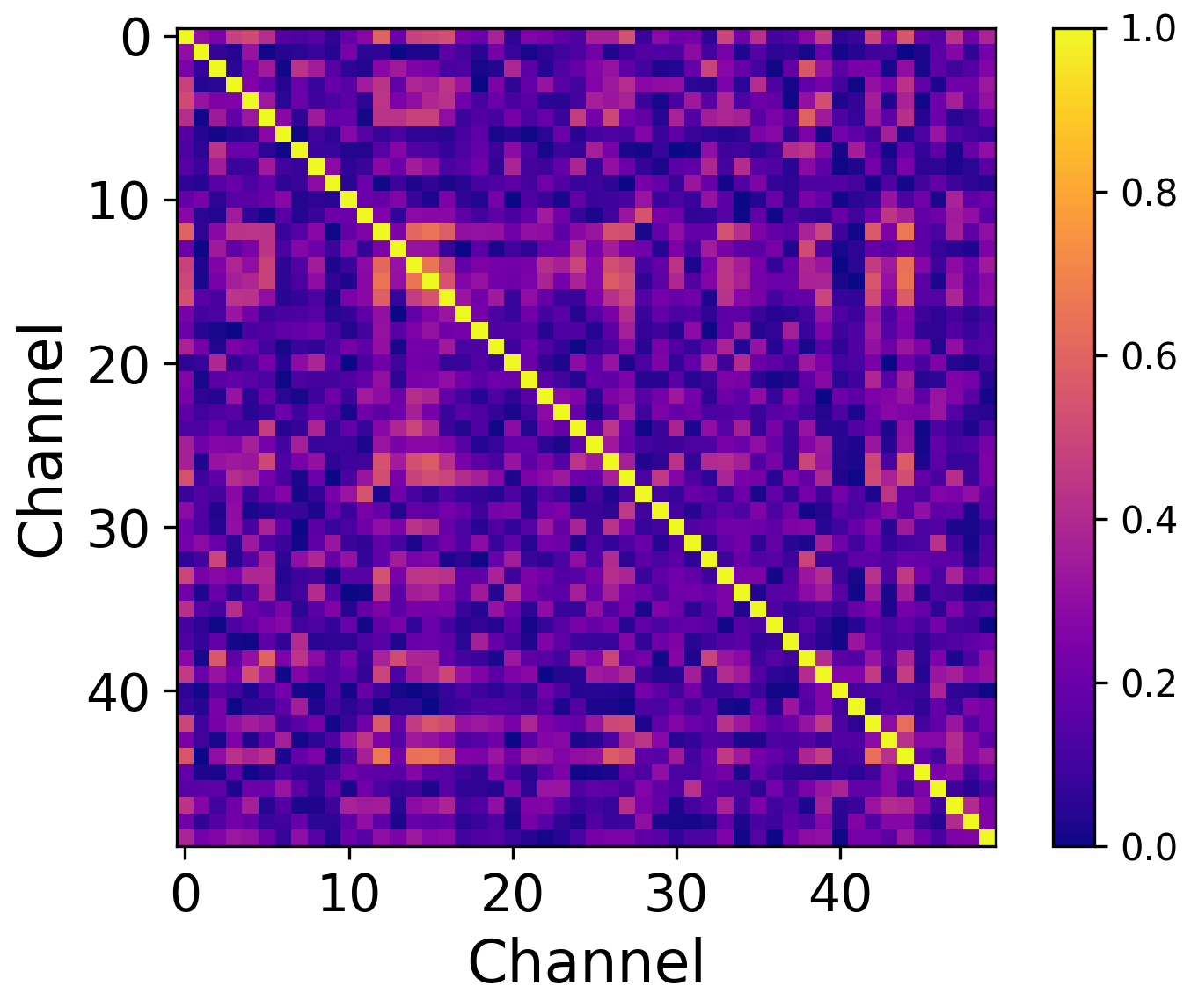

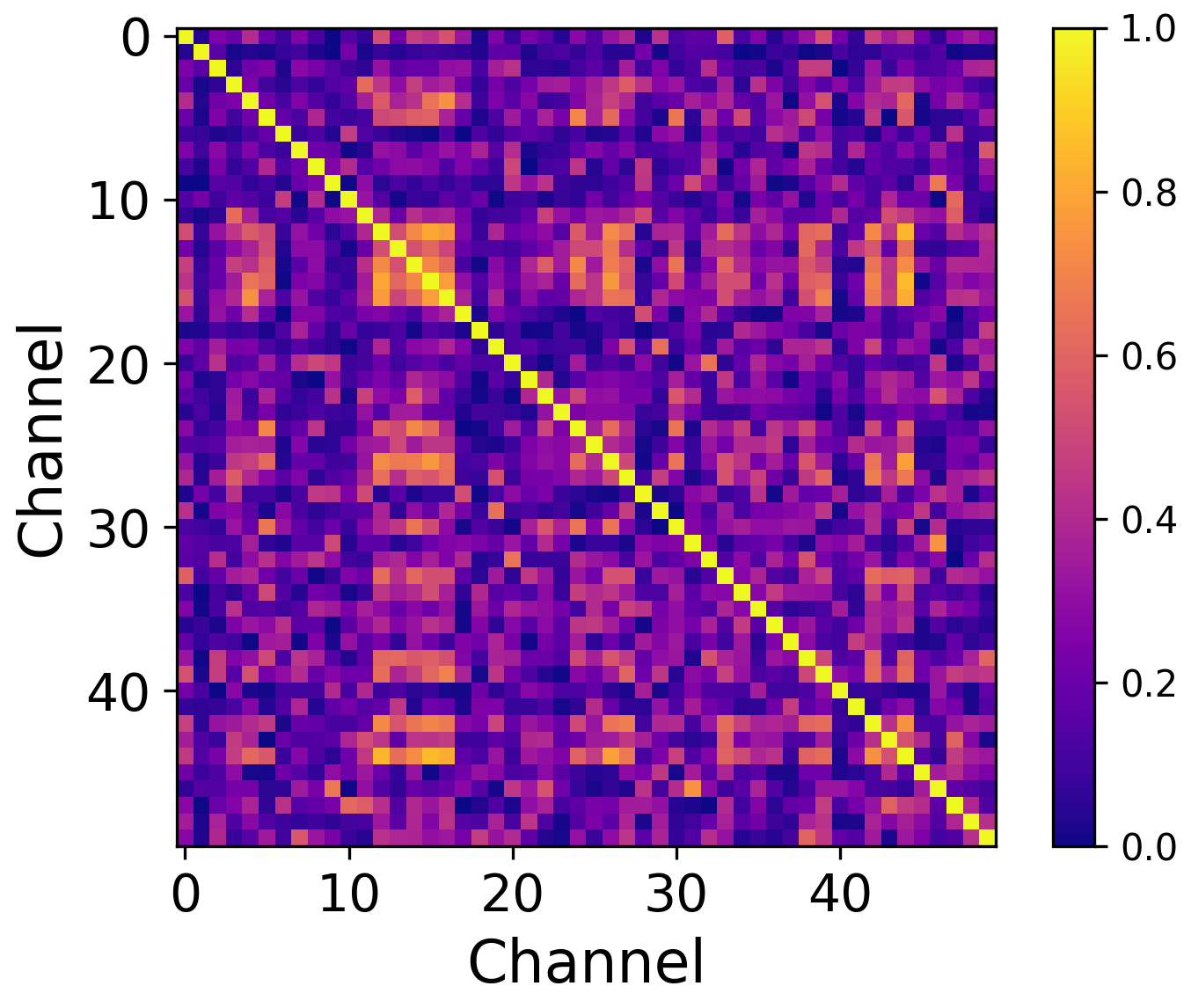

核心思路:SHTC的核心思路是引入稀疏引导的分层变换编码,通过分析-合成变换更有效地去除3DGS模型中的冗余。首先使用KLT对锚点内的属性进行解相关,然后利用场景自适应的神经变换来压缩KLT残差。这种分层结构能够更有效地利用信号的稀疏性,降低编码复杂度。

技术框架:SHTC的整体框架包括以下几个主要阶段:1) KLT变换:对锚点内的属性进行KLT变换,以解相关属性之间的关系。2) 量化和熵编码:对KLT变换后的系数进行量化和熵编码。3) 神经变换编码:使用低复杂度的场景自适应神经变换来压缩KLT残差。4) 解码:执行与编码过程相反的操作,包括神经逆变换、反量化和反KLT变换,最终重建3DGS模型。

关键创新:SHTC最重要的创新点在于引入了稀疏引导的神经变换编码,并将其应用于3DGS压缩。与传统的基于熵编码的方法不同,SHTC通过学习到的变换来显式地去除冗余,从而降低了熵编码器的负担。此外,SHTC利用深度展开技术,使得学习到的变换具有参数效率高的优点。

关键设计:SHTC的关键设计包括:1) 稀疏先验:利用3DGS模型的稀疏性,设计稀疏约束来引导神经变换的学习。2) 深度展开:使用深度展开技术来构建低复杂度的神经变换,减少参数数量。3) 场景自适应:神经变换是场景自适应的,可以根据不同的3DGS模型进行调整。4) 损失函数:使用率失真(R-D)损失函数来优化整个编码器-解码器系统。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SHTC在R-D性能上明显优于现有的SOTA方法。具体来说,SHTC在相同码率下能够获得更高的PSNR和SSIM值,或者在相同的PSNR和SSIM下能够实现更低的码率。此外,SHTC还具有更高的解码速度,这使得它更适合于实时应用。SHTC的参数效率也得到了验证,其模型大小远小于其他基于深度学习的压缩方法。

🎯 应用场景

SHTC方法可应用于各种需要高效存储和传输3DGS模型的场景,例如:虚拟现实/增强现实(VR/AR)、游戏开发、3D地图构建、远程协作等。该方法能够显著降低3DGS模型的存储空间和传输带宽需求,从而提升用户体验,并降低部署成本。未来,SHTC的设计思想可以推广到其他视觉数据的压缩领域,例如图像和视频编码。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) supports fast, high quality, novel view synthesis but has a heavy memory footprint, making the compression of its model crucial. Current state-of-the-art (SOTA) 3DGS compression methods adopt an anchor-based architecture that pairs the Scaffold-GS representation with conditional entropy coding. However, these methods forego the analysis-synthesis transform, a vital mechanism in visual data compression. As a result, redundancy remains intact in the signal and its removal is left to the entropy coder, which computationally overburdens the entropy coding module, increasing coding latency. Even with added complexity thorough redundancy removal is a task unsuited to an entropy coder. To fix this critical omission, we introduce a Sparsity-guided Hierarchical Transform Coding (SHTC) method, the first study on the end-to-end learned neural transform coding of 3DGS. SHTC applies KLT to decorrelate intra-anchor attributes, followed by quantization and entropy coding, and then compresses KLT residuals with a low-complexity, scene-adaptive neural transform. Aided by the sparsity prior and deep unfolding technique, the learned transform uses only a few trainable parameters, reducing the memory usage. Overall, SHTC achieves an appreciably improved R-D performance and at the same time higher decoding speed over SOTA. Its prior-guided, parameter-efficient design may also inspire low-complexity neural image and video codecs. Our code will be released at https://github.com/hxu160/SHTC_for_3DGS_compression.