Task-Driven Implicit Representations for Automated Design of LiDAR Systems

作者: Nikhil Behari, Aaron Young, Tzofi Klinghoffer, Akshat Dave, Ramesh Raskar

分类: cs.CV, cs.RO

发布日期: 2025-05-28 (更新: 2025-11-17)

💡 一句话要点

提出任务驱动的隐式表达方法,用于激光雷达系统的自动化设计

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 激光雷达系统设计 自动化设计 隐式表达 生成模型 任务驱动 期望最大化 三维视觉

📋 核心要点

- 现有激光雷达系统设计流程复杂、耗时,且依赖手动调整,难以满足特定任务的需求。

- 论文提出一种基于隐式表达和生成模型的自动化设计框架,通过学习任务相关的设计空间密度来优化激光雷达配置。

- 实验表明,该方法在人脸扫描、机器人跟踪和目标检测等任务上能够自动设计出满足性能要求的激光雷达系统。

📝 摘要(中文)

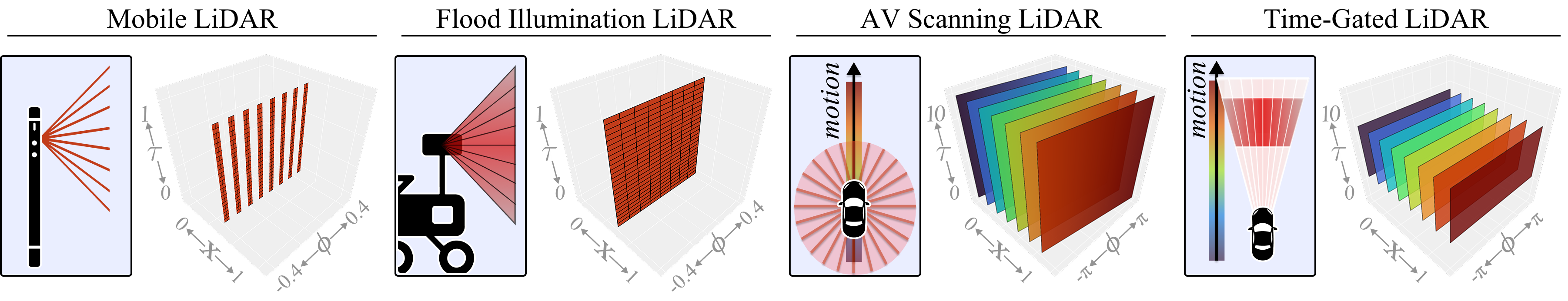

成像系统设计是一个复杂、耗时且很大程度上是手动的过程。激光雷达设计在移动设备、自动驾驶汽车和航空成像平台中无处不在,它通过独特的空间和时间采样要求增加了复杂性。本文提出了一种在任意约束下进行自动化、任务驱动的激光雷达系统设计的框架。为了实现这一目标,我们在连续的六维设计空间中表示激光雷达配置,并通过基于流的生成模型学习该空间中特定于任务的隐式密度。然后,我们通过将传感器建模为6D空间中的参数分布,并使用期望最大化算法将这些分布拟合到我们学习到的隐式密度,从而合成新的激光雷达系统,从而实现高效的、约束感知的激光雷达系统设计。我们在3D视觉中的各种任务上验证了我们的方法,从而能够在人脸扫描、机器人跟踪和目标检测等受现实世界启发的应用中实现自动化的激光雷达系统设计。

🔬 方法详解

问题定义:激光雷达系统设计是一个复杂且耗时的过程,传统方法依赖于人工经验和试错,难以在满足特定任务需求的同时,兼顾成本、功耗等约束条件。现有方法缺乏自动化和任务驱动的设计流程,无法充分利用设计空间中的潜在优化方案。

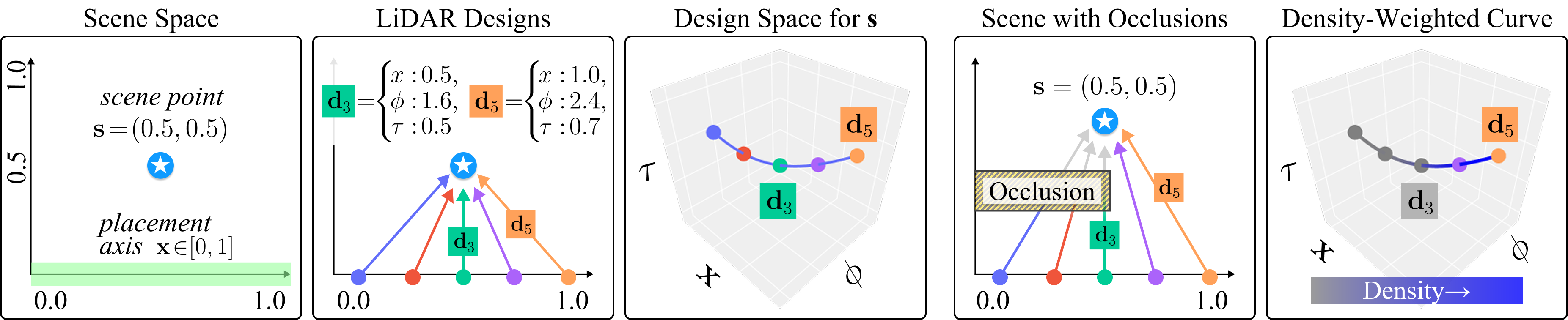

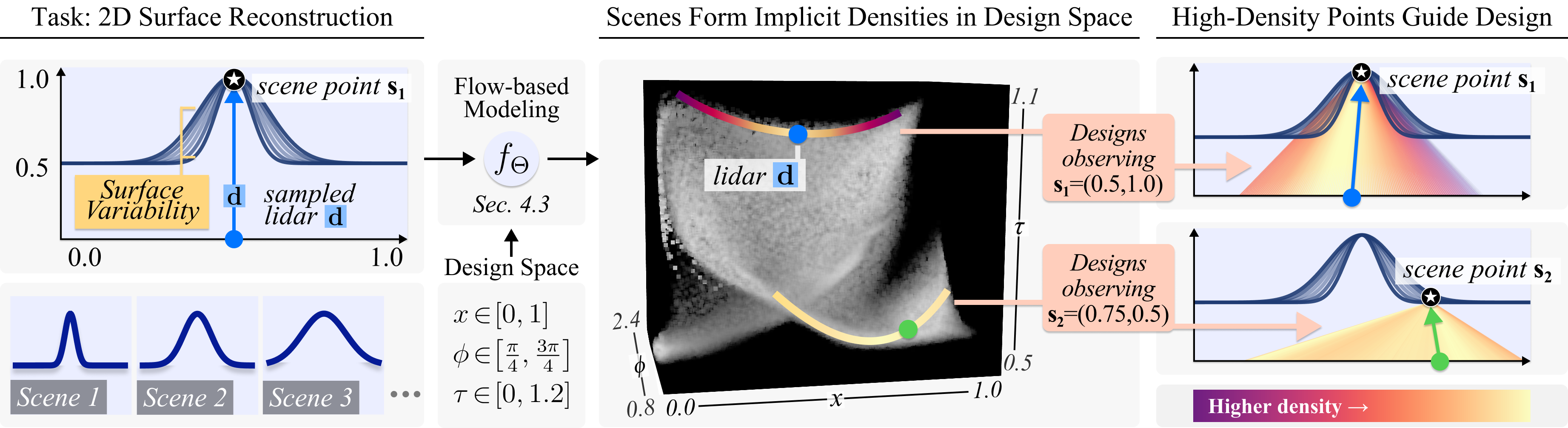

核心思路:论文的核心思路是将激光雷达系统配置表示为一个连续的六维设计空间,并利用生成模型学习该空间中特定于任务的隐式密度。通过将传感器建模为参数分布,并拟合到学习到的隐式密度,可以高效地生成满足任务需求的激光雷达系统配置。这种方法将设计问题转化为一个优化问题,可以通过机器学习方法进行求解。

技术框架:该框架包含以下主要模块:1) 设计空间表示:将激光雷达配置参数化为一个六维向量,包括位置、角度等信息。2) 隐式密度学习:使用基于流的生成模型,学习设计空间中特定于任务的隐式密度。该密度反映了不同配置对任务性能的贡献。3) 传感器建模:将激光雷达传感器建模为6D空间中的参数分布,例如高斯分布。4) 配置优化:使用期望最大化(EM)算法,将传感器分布拟合到学习到的隐式密度,从而生成新的激光雷达系统配置。

关键创新:该方法最重要的创新在于将激光雷达系统设计问题转化为一个基于隐式表达的生成建模问题。与传统的手动设计或基于规则的设计方法相比,该方法能够自动学习任务相关的设计空间,并生成满足特定约束的优化配置。此外,使用基于流的生成模型能够有效地学习高维设计空间的复杂分布。

关键设计:论文使用基于流的生成模型(例如RealNVP)来学习隐式密度。损失函数包括重构损失和正则化项,以保证生成配置的质量和多样性。在配置优化阶段,使用EM算法迭代地更新传感器分布的参数,直到收敛。关键参数包括生成模型的网络结构、学习率、正则化系数等。

🖼️ 关键图片

📊 实验亮点

论文在人脸扫描、机器人跟踪和目标检测等任务上验证了该方法的有效性。实验结果表明,该方法能够自动设计出性能优于人工设计的激光雷达系统。例如,在人脸扫描任务中,该方法能够生成具有更高分辨率和更少噪声的扫描结果。在目标检测任务中,该方法能够提高检测精度和召回率。

🎯 应用场景

该研究成果可应用于各种需要定制化激光雷达系统的场景,例如:自动驾驶汽车、机器人导航、三维扫描、人脸识别、工业检测等。通过自动化设计流程,可以快速生成满足特定任务需求的激光雷达系统,降低开发成本,提高系统性能。未来,该方法可以扩展到其他类型的传感器系统设计,例如相机、雷达等。

📄 摘要(原文)

Imaging system design is a complex, time-consuming, and largely manual process; LiDAR design, ubiquitous in mobile devices, autonomous vehicles, and aerial imaging platforms, adds further complexity through unique spatial and temporal sampling requirements. In this work, we propose a framework for automated, task-driven LiDAR system design under arbitrary constraints. To achieve this, we represent LiDAR configurations in a continuous six-dimensional design space and learn task-specific implicit densities in this space via flow-based generative modeling. We then synthesize new LiDAR systems by modeling sensors as parametric distributions in 6D space and fitting these distributions to our learned implicit density using expectation-maximization, enabling efficient, constraint-aware LiDAR system design. We validate our method on diverse tasks in 3D vision, enabling automated LiDAR system design across real-world-inspired applications in face scanning, robotic tracking, and object detection.