A Survey on Training-free Open-Vocabulary Semantic Segmentation

作者: Naomi Kombol, Ivan Martinović, Siniša Šegvić

分类: cs.CV

发布日期: 2025-05-28

💡 一句话要点

综述:免训练开放词汇语义分割方法研究进展

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语义分割 开放词汇 免训练 CLIP 多模态学习 零样本学习 视觉基础模型

📋 核心要点

- 传统语义分割模型依赖大量标注数据,难以泛化到未见类别,开放词汇语义分割旨在解决这一难题。

- 免训练方法利用预训练的多模态模型(如CLIP)的知识,无需额外训练即可实现开放词汇语义分割。

- 综述总结了基于CLIP、视觉基础模型和生成式方法的三大研究方向,并探讨了现有方法的局限性。

📝 摘要(中文)

语义分割是图像理解领域的基础任务之一,拥有悠久的研究历史和众多的方法。传统方法需要从头训练模型,消耗大量的计算资源和标注数据。为了解决开放词汇语义分割问题,即模型能够分类超出已学习类别的物体,获取大量精细标注数据的成本将非常高昂。因此,研究人员转向免训练方法,利用现有的、更容易获取数据的任务模型。本综述将涵盖免训练开放词汇语义分割的历史、细微差别、思想发展和最新技术,重点关注利用现有多模态分类模型的方法。首先,给出任务定义的初步介绍,然后概述流行的模型架构,并重点介绍30多种方法,将其分为更广泛的研究分支:纯粹基于CLIP的方法、利用辅助视觉基础模型的方法以及依赖生成式方法的方法。随后,讨论当前研究的局限性和潜在问题,并为未来的研究提供一些未充分探索的想法。我们相信这篇综述将成为新研究人员的良好入门读物,并激发人们对该领域日益增长的兴趣。

🔬 方法详解

问题定义:开放词汇语义分割旨在将图像中的每个像素分配到预定义类别之外的类别,而无需针对这些新类别进行任何训练。现有方法通常需要针对特定类别进行训练,泛化能力有限,且标注成本高昂。免训练方法旨在解决这些问题,利用预训练模型的知识,避免了对新类别进行额外标注和训练的需要。

核心思路:核心思路是利用预训练的多模态模型(如CLIP)的强大视觉和语言理解能力,将图像像素与文本描述进行匹配。通过将像素嵌入到与文本嵌入相同的空间中,可以根据文本描述对像素进行分类,从而实现开放词汇语义分割。这种方法避免了对新类别的训练,提高了泛化能力。

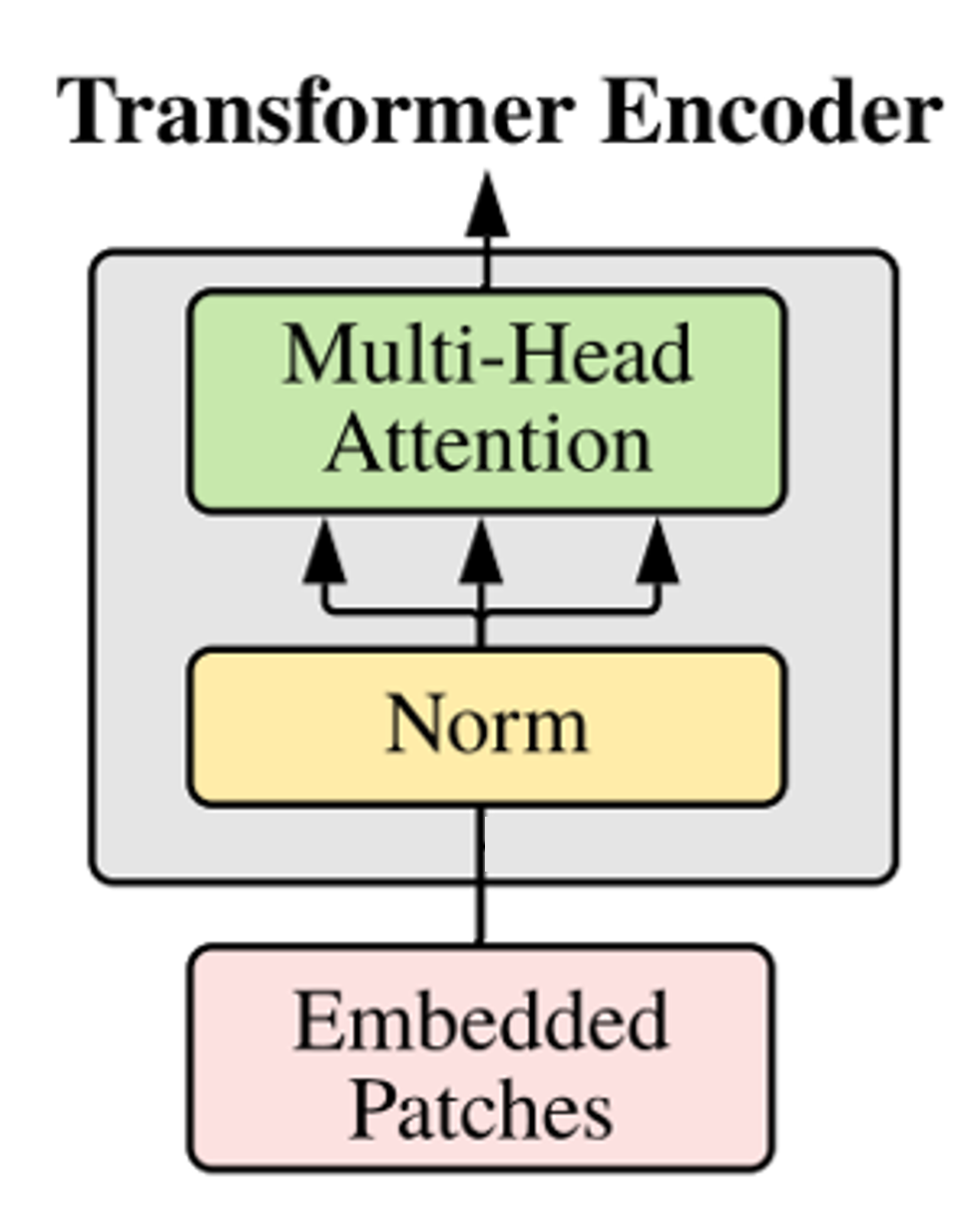

技术框架:整体框架通常包括以下几个阶段:1) 特征提取:使用预训练的视觉模型(如CLIP的图像编码器或其它视觉基础模型)提取图像像素的视觉特征。2) 文本编码:使用预训练的文本模型(如CLIP的文本编码器)将类别名称或描述编码为文本特征。3) 特征匹配:将像素的视觉特征与文本特征进行匹配,例如计算余弦相似度。4) 分类:根据匹配结果,将像素分配到最相似的类别。一些方法还可能包含后处理步骤,例如平滑分割结果或利用生成模型进行图像修复。

关键创新:最重要的技术创新点在于利用预训练的多模态模型进行零样本或少样本学习,避免了对新类别的训练。与传统方法相比,这种方法具有更强的泛化能力和更低的标注成本。此外,一些方法还通过引入辅助视觉基础模型或生成模型来提高分割精度和鲁棒性。

关键设计:关键设计包括:1) 如何选择合适的预训练模型,例如CLIP、DINO等。2) 如何有效地提取像素特征,例如使用滑动窗口、超像素分割等。3) 如何设计匹配策略,例如使用余弦相似度、对比学习等。4) 如何利用辅助信息,例如图像先验、文本描述等。5) 如何进行后处理,例如使用条件随机场(CRF)或其它平滑算法。

🖼️ 关键图片

📊 实验亮点

该综述总结了30多种免训练开放词汇语义分割方法,并将其分为三大研究分支:纯粹基于CLIP的方法、利用辅助视觉基础模型的方法以及依赖生成式方法的方法。论文还讨论了当前研究的局限性和潜在问题,并为未来的研究提供了有价值的思路。

🎯 应用场景

该研究在自动驾驶、机器人导航、医学图像分析等领域具有广泛的应用前景。例如,自动驾驶系统可以利用开放词汇语义分割来识别道路上的各种物体,包括行人、车辆、交通标志等,从而提高驾驶安全性。在医学图像分析中,可以用于分割病灶区域,辅助医生进行诊断。

📄 摘要(原文)

Semantic segmentation is one of the most fundamental tasks in image understanding with a long history of research, and subsequently a myriad of different approaches. Traditional methods strive to train models up from scratch, requiring vast amounts of computational resources and training data. In the advent of moving to open-vocabulary semantic segmentation, which asks models to classify beyond learned categories, large quantities of finely annotated data would be prohibitively expensive. Researchers have instead turned to training-free methods where they leverage existing models made for tasks where data is more easily acquired. Specifically, this survey will cover the history, nuance, idea development and the state-of-the-art in training-free open-vocabulary semantic segmentation that leverages existing multi-modal classification models. We will first give a preliminary on the task definition followed by an overview of popular model archetypes and then spotlight over 30 approaches split into broader research branches: purely CLIP-based, those leveraging auxiliary visual foundation models and ones relying on generative methods. Subsequently, we will discuss the limitations and potential problems of current research, as well as provide some underexplored ideas for future study. We believe this survey will serve as a good onboarding read to new researchers and spark increased interest in the area.