Diffusion-Denoised Hyperspectral Gaussian Splatting

作者: Sunil Kumar Narayanan, Lingjun Zhao, Lu Gan, Yongsheng Chen

分类: cs.CV

发布日期: 2025-05-28 (更新: 2025-11-25)

备注: Accepted to 3DV 2026

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于扩散去噪的高光谱高斯溅射方法,实现高光谱场景的三维重建。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱五:交互与反应 (Interaction & Reaction)

关键词: 高光谱成像 三维重建 高斯溅射 扩散模型 神经辐射场

📋 核心要点

- 现有NeRF方法在高光谱场景三维重建中存在训练时间长、渲染速度慢的问题。

- DD-HGS通过引入波长感知球谐函数、KL散度光谱损失和扩散去噪器来增强3DGS方法。

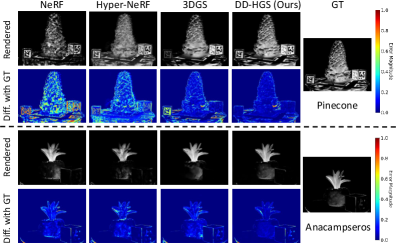

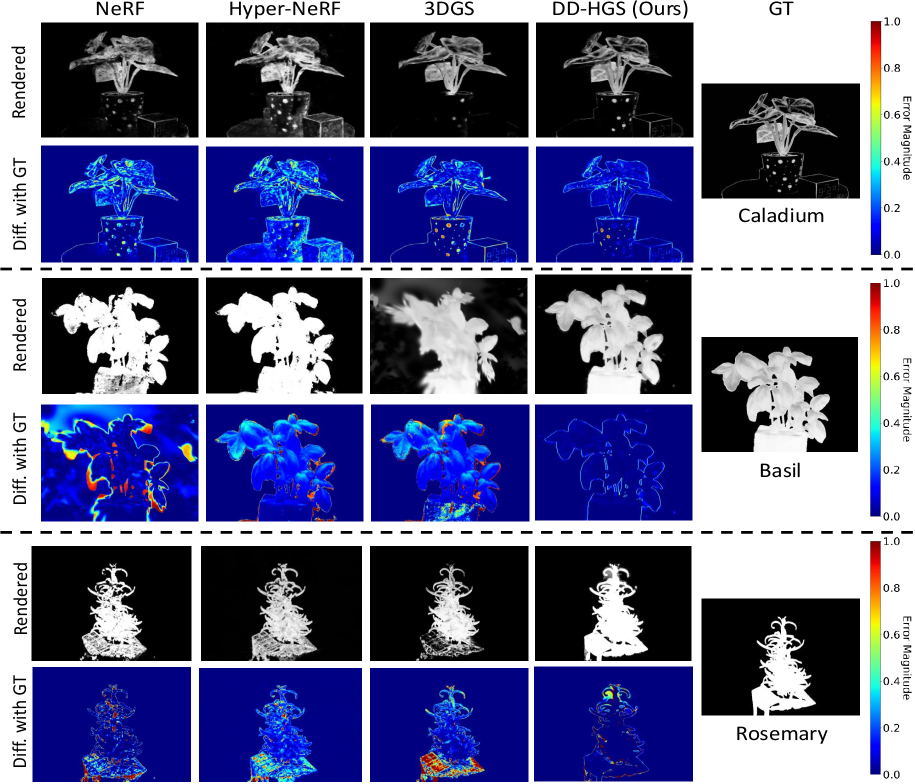

- 在Hyper-NeRF数据集上的实验表明,DD-HGS达到了目前最优的性能。

📝 摘要(中文)

高光谱成像(HSI)已广泛应用于农业领域,用于植物养分成分的无损估计和样品营养元素的精确量化。 近年来,神经辐射场(NeRF)等三维重建方法已被用于创建HSI场景的隐式神经表示。 这种能力使得能够在每个空间位置渲染高光谱通道组合,从而有助于在空间和光谱上定位目标对象的养分成分。 然而,它在训练时间和渲染速度方面面临限制。 本文提出了一种基于扩散去噪的高光谱高斯溅射(DD-HGS)方法,该方法通过波长感知的球谐函数、基于Kullback-Leibler散度的光谱损失和基于扩散的去噪器来增强最先进的3D高斯溅射(3DGS)方法,从而实现整个光谱范围内高光谱场景的3D显式重建。 我们在Hyper-NeRF数据集中的各种真实高光谱场景上进行了广泛的评估,以展示DD-HGS的有效性。 结果表明,与所有先前发布的方法相比,DD-HGS实现了新的最先进的性能。

🔬 方法详解

问题定义:论文旨在解决高光谱图像场景的三维重建问题,现有NeRF方法虽然可以重建高光谱场景,但训练和渲染速度较慢,限制了其在高光谱数据处理中的应用。此外,如何有效地利用高光谱数据的光谱信息也是一个挑战。

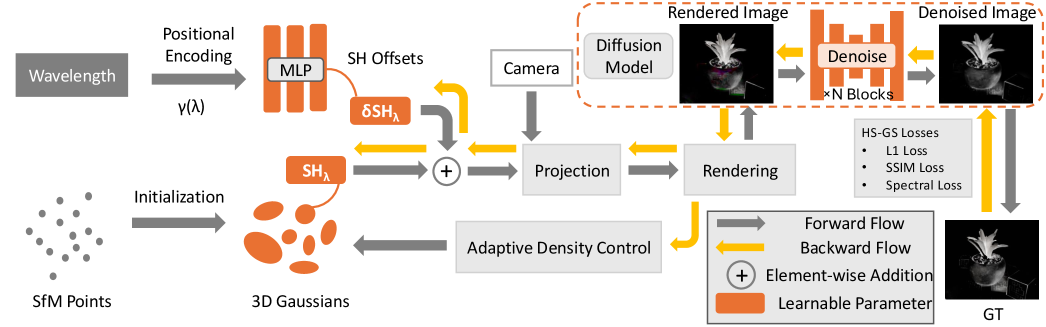

核心思路:论文的核心思路是利用3D高斯溅射(3DGS)的快速渲染能力,并结合扩散模型进行去噪,同时引入波长感知的球谐函数和光谱损失,从而实现快速且高质量的高光谱场景三维重建。通过显式地建模三维高斯分布,并优化其参数,可以有效地表示场景的几何和辐射属性。

技术框架:DD-HGS的技术框架主要包括以下几个模块:1) 3D高斯溅射模块,用于显式地表示场景的几何和辐射属性;2) 波长感知球谐函数模块,用于建模高光谱数据的光谱信息;3) Kullback-Leibler散度光谱损失模块,用于约束重建光谱的准确性;4) 扩散去噪模块,用于去除重建过程中的噪声。整体流程是,首先使用3DGS初始化场景表示,然后通过优化高斯参数、球谐函数系数等参数来拟合高光谱数据,最后使用扩散模型对重建结果进行去噪。

关键创新:该论文的关键创新在于将扩散模型引入到高光谱高斯溅射中,用于去除重建过程中的噪声。此外,波长感知的球谐函数和KL散度光谱损失也是重要的创新点,它们能够更好地利用高光谱数据的光谱信息,提高重建质量。与传统的NeRF方法相比,DD-HGS具有更快的训练和渲染速度,并且能够更好地处理高光谱数据。

关键设计:在关键设计方面,论文采用了波长感知的球谐函数来表示每个高斯分布的光谱辐射,这使得模型能够更好地捕捉高光谱数据的光谱特征。此外,论文还设计了一个基于KL散度的光谱损失函数,用于约束重建光谱与真实光谱之间的差异。扩散去噪模块采用预训练的扩散模型,用于去除重建结果中的噪声。具体的参数设置和网络结构在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DD-HGS在Hyper-NeRF数据集上取得了state-of-the-art的性能,相较于之前的NeRF方法,在训练速度和渲染速度上均有显著提升。具体的性能数据和对比基线在论文中有详细展示,证明了DD-HGS在高光谱场景三维重建方面的有效性。

🎯 应用场景

该研究成果可广泛应用于农业领域,例如植物养分成分的无损估计、作物生长监测和病虫害检测。此外,该方法还可应用于遥感、环境监测、文物保护等领域,为高光谱数据的三维重建和分析提供了一种新的解决方案,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

Hyperspectral imaging (HSI) has been widely used in agricultural applications for non-destructive estimation of plant nutrient composition and precise quantification of sample nutritional elements. Recently, 3D reconstruction methods, such as Neural Radiance Field (NeRF), have been used to create implicit neural representations of HSI scenes. This capability enables the rendering of hyperspectral channel compositions at every spatial location, thereby helping localize the target object's nutrient composition both spatially and spectrally. However, it faces limitations in training time and rendering speed. In this paper, we propose Diffusion-Denoised Hyperspectral Gaussian Splatting (DD-HGS), which enhances the state-of-the-art 3D Gaussian Splatting (3DGS) method with wavelength-aware spherical harmonics, a Kullback-Leibler divergence-based spectral loss, and a diffusion-based denoiser to enable 3D explicit reconstruction of the hyperspectral scenes for the entire spectral range. We present extensive evaluations on diverse real-world hyperspectral scenes from the Hyper-NeRF dataset to show the effectiveness of our DD-HGS. The results demonstrate that DD-HGS achieves the new state-of-the-art performance compared to all the previously published methods. Project page: https://dragonpg2000.github.io/DDHGS-website/