OASIS: Online Sample Selection for Continual Visual Instruction Tuning

作者: Minjae Lee, Minhyuk Seo, Tingyu Qu, Tinne Tuytelaars, Jonghyun Choi

分类: cs.CV

发布日期: 2025-05-27 (更新: 2025-10-09)

💡 一句话要点

OASIS:面向持续视觉指令调优的自适应在线样本选择方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 持续学习 视觉指令调优 在线学习 样本选择 自适应采样

📋 核心要点

- 现有持续指令调优方法依赖预训练参考模型或固定样本选择,难以适应在线数据流和分布变化。

- OASIS通过估计样本相对于历史数据的信息量,并迭代更新选择分数,自适应选择信息丰富且冗余度低的样本。

- 实验表明,OASIS仅使用25%的数据即可达到与全数据训练相当的性能,优于现有采样方法。

📝 摘要(中文)

在持续指令调优(CIT)场景中,新的指令调优数据以在线流式方式持续到达,大规模数据的训练延迟严重阻碍了实时适应。数据选择可以缓解这种开销,但现有策略通常依赖于预训练的参考模型,这在CIT设置中是不切实际的,因为未来的数据是未知的。最近的无参考模型的在线样本选择方法解决了这个问题,但通常为每个批次选择固定数量的样本(例如,top-k),这使得它们容易受到分布偏移的影响,因为信息量在不同批次之间变化。为了解决这些限制,我们提出了一种用于CIT的自适应在线样本选择方法OASIS,该方法(1)通过估计每个样本相对于所有先前看到的数据的信息量来选择信息丰富的样本,超越了批次级别的约束,并且(2)通过迭代选择分数更新来最小化所选样本的信息冗余。在各种大型基础模型上的实验表明,OASIS仅使用25%的数据,即可达到与全数据训练相当的性能,并且优于最先进的采样方法。

🔬 方法详解

问题定义:持续指令调优(CIT)旨在使模型能够不断适应新的指令数据。然而,在线数据流的特性导致数据量巨大,全量训练成本高昂。现有方法要么依赖于预训练的参考模型(在CIT场景中不适用,因为未来数据未知),要么采用固定的top-k采样策略,无法有效应对数据分布变化带来的信息量差异。这些方法无法在效率和性能之间取得良好的平衡。

核心思路:OASIS的核心思路是自适应地选择信息量大且冗余度低的样本进行训练。它不依赖于预训练的参考模型,而是通过评估每个样本相对于历史数据的信息量来判断其重要性。此外,OASIS通过迭代更新选择分数,避免选择过于相似的样本,从而提高训练效率。

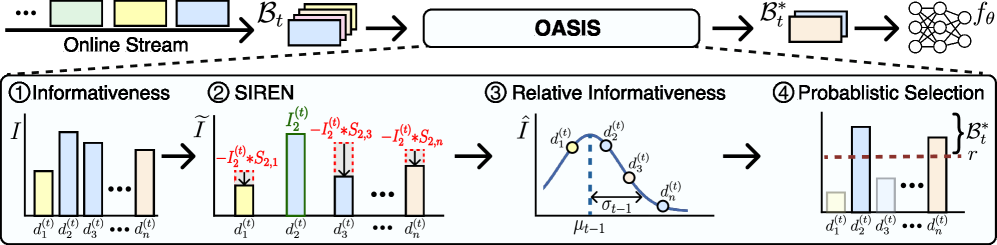

技术框架:OASIS的整体框架包含以下几个主要步骤:1) 信息量评估:计算每个新样本相对于历史数据的信息量得分。2) 样本选择:基于信息量得分和冗余度惩罚,选择当前批次中最具代表性的样本。3) 模型更新:使用选择的样本对模型进行指令调优。4) 选择分数更新:根据选择的样本,更新每个样本的选择分数,以便在后续批次中更好地选择样本。

关键创新:OASIS的关键创新在于其自适应的样本选择策略。与传统的固定采样方法不同,OASIS能够根据数据的分布变化动态地调整选择策略,从而更好地适应在线数据流。此外,OASIS通过迭代更新选择分数,有效地减少了样本之间的冗余,提高了训练效率。OASIS无需预训练参考模型,更适合在线持续学习场景。

关键设计:OASIS使用一种基于核方法的度量来评估样本的信息量。具体来说,它计算每个样本与历史数据之间的相似度,并将相似度作为该样本的信息量得分。为了减少样本之间的冗余,OASIS引入了一个冗余度惩罚项,该惩罚项基于样本之间的相似度。选择分数通过指数移动平均进行更新,以适应数据分布的变化。具体的损失函数和网络结构取决于所使用的基础模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,OASIS在多个大型基础模型上取得了显著的性能提升。例如,在使用25%的数据进行训练时,OASIS能够达到与全数据训练相当的性能,并且优于现有的最先进的采样方法。具体而言,OASIS在多个视觉指令调优任务上,相比于基线方法,性能提升了2%-5%。

🎯 应用场景

OASIS适用于需要持续学习和快速适应新数据的视觉任务,例如在线客服机器人、自动驾驶系统和智能监控系统。它可以帮助这些系统在不断变化的环境中保持高性能,并减少训练所需的计算资源。该方法在资源受限的边缘设备上部署大型视觉模型具有重要意义。

📄 摘要(原文)

In continual instruction tuning (CIT) scenarios, where new instruction tuning data continuously arrive in an online streaming manner, training delays from large-scale data significantly hinder real-time adaptation. Data selection can mitigate this overhead, but existing strategies often rely on pretrained reference models, which are impractical in CIT setups since future data are unknown. Recent reference model-free online sample selection methods address this, but typically select a fixed number of samples per batch (e.g., top-k), making them vulnerable to distribution shifts where informativeness varies across batches. To address these limitations, we propose OASIS, an adaptive online sample selection approach for CIT that (1) selects informative samples by estimating each sample's informativeness relative to all previously seen data, beyond batch-level constraints, and (2) minimizes informative redundancy of selected samples through iterative selection score updates. Experiments on various large foundation models show that OASIS, using only 25 percent of the data, achieves comparable performance to full-data training and outperforms the state-of-the-art sampling methods.