Generalizable and Relightable Gaussian Splatting for Human Novel View Synthesis

作者: Yipengjing Sun, Shengping Zhang, Chenyang Wang, Shunyuan Zheng, Zonglin Li, Xiangyang Ji

分类: cs.CV

发布日期: 2025-05-27 (更新: 2025-11-21)

备注: Project Webpage: https://sypj-98.github.io/grgs/

💡 一句话要点

提出GRGS,实现通用且可重光照的人体新视角合成

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 新视角合成 3D高斯溅射 神经渲染 光照鲁棒性 几何细化 物理渲染 人体建模

📋 核心要点

- 现有方法在新视角合成中依赖单角色优化或忽略物理约束,导致泛化性差,光照效果不真实。

- GRGS通过前馈网络将多视角2D信息投影到3D高斯表示,并结合光照鲁棒的几何细化和物理基础的神经渲染。

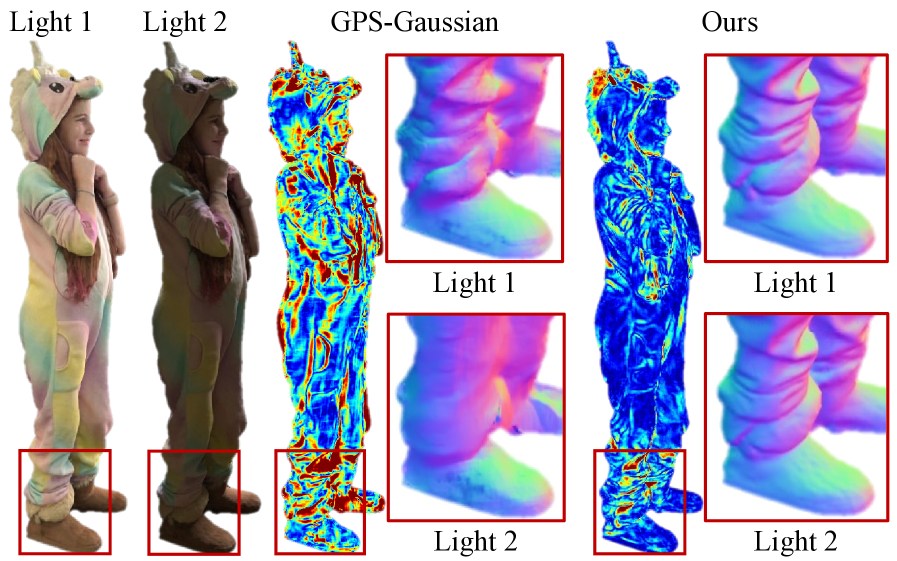

- 实验表明,GRGS在视觉质量、几何一致性和跨角色、跨光照的泛化能力上均优于现有技术。

📝 摘要(中文)

我们提出了GRGS,一个通用且可重光照的3D高斯框架,用于在各种光照条件下进行高保真的人体新视角合成。与依赖于单角色优化或忽略物理约束的现有方法不同,GRGS采用前馈、全监督策略,将来自多视角2D观测的几何、材质和光照线索投影到3D高斯表示中。为了在不同的光照条件下恢复精确的几何形状,我们引入了一个光照鲁棒的几何细化(LGR)模块,该模块在合成重光照数据上进行训练,以预测精确的深度和表面法线。基于高质量的几何形状,进一步提出了一个物理基础的神经渲染(PGNR)模块,将神经预测与基于物理的着色相结合,支持具有阴影和间接光照的可编辑重光照。此外,我们设计了一种2D到3D的投影训练方案,利用来自环境光遮蔽、直接和间接光照图的可微监督,减轻了光线追踪的计算成本。大量的实验表明,GRGS在角色和光照条件下的视觉质量、几何一致性和泛化能力方面都优于现有方法。

🔬 方法详解

问题定义:论文旨在解决人体新视角合成问题,即在给定多视角图像的情况下,生成任意视角下的人体图像。现有方法通常需要针对每个角色进行单独优化,泛化性较差,并且难以处理复杂的光照效果,例如阴影和间接光照。

核心思路:论文的核心思路是将2D图像信息投影到3D高斯表示中,并利用神经渲染技术生成新视角图像。通过引入光照鲁棒的几何细化模块和物理基础的神经渲染模块,提高几何形状的准确性和光照效果的真实性。

技术框架:GRGS框架包含以下几个主要模块:1) 2D特征提取模块,用于从多视角图像中提取特征;2) 2D到3D投影模块,将2D特征投影到3D高斯表示中;3) 光照鲁棒的几何细化(LGR)模块,用于优化3D高斯表示的几何形状;4) 物理基础的神经渲染(PGNR)模块,用于生成新视角图像,并支持可编辑的重光照。

关键创新:论文的关键创新在于:1) 提出了光照鲁棒的几何细化模块,能够有效提高在复杂光照条件下几何形状的准确性;2) 提出了物理基础的神经渲染模块,能够生成具有真实阴影和间接光照的新视角图像;3) 设计了一种2D到3D的投影训练方案,利用可微渲染技术,减轻了光线追踪的计算负担。

关键设计:LGR模块使用合成重光照数据进行训练,预测深度和表面法线。PGNR模块将神经预测与基于物理的着色模型相结合,实现可编辑的重光照效果。2D到3D投影训练方案利用环境光遮蔽、直接和间接光照图的可微监督信号,避免了昂贵的光线追踪计算。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GRGS在视觉质量、几何一致性和泛化能力方面均优于现有方法。例如,在跨角色和跨光照的测试中,GRGS能够生成更加逼真和一致的新视角图像,显著减少了伪影和失真。具体性能数据未知,但摘要强调了其优越性。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、游戏、电影制作等领域,例如创建逼真的虚拟化身、生成高质量的虚拟内容、实现交互式的光照编辑等。该技术能够提升用户体验,降低内容制作成本,并为相关产业带来新的发展机遇。

📄 摘要(原文)

We propose GRGS, a generalizable and relightable 3D Gaussian framework for high-fidelity human novel view synthesis under diverse lighting conditions. Unlike existing methods that rely on per-character optimization or ignore physical constraints, GRGS adopts a feed-forward, fully supervised strategy projecting geometry, material, and illumination cues from multi-view 2D observations into 3D Gaussian representations. To recover accurate geometry under diverse lighting conditions, we introduce a Lighting-robust Geometry Refinement (LGR) module trained on synthetically relit data to predict precise depth and surface normals. Based on the high-quality geometry, a Physically Grounded Neural Rendering (PGNR) module is further proposed to integrate neural prediction with physics-based shading, supporting editable relighting with shadows and indirect illumination. Moreover, we design a 2D-to-3D projection training scheme leveraging differentiable supervision from ambient occlusion, direct, and indirect lighting maps, alleviating the computational cost of ray tracing. Extensive experiments demonstrate that GRGS achieves superior visual quality, geometric consistency, and generalization across characters and lighting conditions.