Active-O3: Empowering Multimodal Large Language Models with Active Perception via GRPO

作者: Muzhi Zhu, Hao Zhong, Canyu Zhao, Zongze Du, Zheng Huang, Mingyu Liu, Hao Chen, Cheng Zou, Jingdong Chen, Ming Yang, Chunhua Shen

分类: cs.CV, cs.AI

发布日期: 2025-05-27

备注: Project Page: https://aim-uofa.github.io/ACTIVE-o3

💡 一句话要点

提出ACTIVE-O3框架,通过强化学习赋能多模态大语言模型主动感知能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 主动感知 多模态大语言模型 强化学习 机器人 计算机视觉 目标检测 零样本学习

📋 核心要点

- 现有MLLM缺乏有效的主动感知能力,导致在复杂场景下信息获取效率低,难以准确定位目标。

- ACTIVE-O3利用强化学习训练MLLM,使其能够主动选择观察位置和方式,从而更有效地获取任务相关信息。

- 实验表明,ACTIVE-O3在多个基准测试中表现出色,包括小物体检测、密集物体定位和零样本推理。

📝 摘要(中文)

本文旨在研究如何赋予多模态大语言模型(MLLMs)主动感知能力。首先,论文系统地定义了基于MLLM的主动感知任务。指出GPT-o3模型的放大搜索策略是主动感知的一个特例,但存在搜索效率低和区域选择不准确的问题。为了解决这些问题,论文提出了ACTIVE-O3,这是一个纯粹基于强化学习的训练框架,建立在GRPO之上,旨在赋予MLLM主动感知能力。论文还建立了一个全面的基准测试套件,用于评估ACTIVE-O3在通用开放世界任务(如小物体和密集物体定位)以及特定领域场景(包括遥感和自动驾驶中的小物体检测,以及精细交互分割)中的性能。此外,ACTIVE-O3还在V*基准测试中展示了强大的零样本推理能力,无需任何显式推理数据。希望这项工作能够提供一个简单的代码库和评估协议,以促进未来对MLLM中主动感知的研究。

🔬 方法详解

问题定义:现有基于MLLM的方法在主动感知方面存在不足,例如GPT-o3的放大搜索策略效率低下,且区域选择不够准确。这限制了MLLM在复杂环境中的应用,尤其是在需要精确定位和识别小物体或密集物体时。因此,需要一种更有效的主动感知方法来提升MLLM的性能。

核心思路:ACTIVE-O3的核心思路是通过强化学习训练MLLM,使其能够根据当前状态和任务目标,主动选择下一步的观察动作(例如,移动视角、调整焦距等)。通过与环境的交互,MLLM可以学习到最佳的观察策略,从而更有效地获取任务相关的信息。这种主动感知的方式可以显著提高信息获取的效率和准确性。

技术框架:ACTIVE-O3的整体框架基于GRPO(未知具体含义,原文未展开),采用强化学习算法训练MLLM。该框架包含以下主要模块:1) 状态表示模块:将当前环境信息(例如,图像、文本描述等)编码为状态向量;2) 动作选择模块:根据当前状态,MLLM输出下一步的观察动作;3) 环境交互模块:执行MLLM选择的动作,并更新环境状态;4) 奖励函数模块:根据MLLM的动作和环境反馈,计算奖励值,用于指导MLLM的学习。

关键创新:ACTIVE-O3的关键创新在于将强化学习与MLLM相结合,使其能够学习到主动感知策略。与传统的被动感知方法相比,ACTIVE-O3能够根据任务需求,主动选择观察位置和方式,从而更有效地获取信息。此外,ACTIVE-O3还建立了一个全面的基准测试套件,用于评估主动感知算法的性能。

关键设计:ACTIVE-O3的具体参数设置、损失函数和网络结构等技术细节在论文中未详细展开。但可以推测,奖励函数的设计至关重要,需要能够准确反映MLLM的感知效果。此外,可能采用了特定的网络结构来处理多模态输入,并学习状态与动作之间的映射关系。具体实现细节未知。

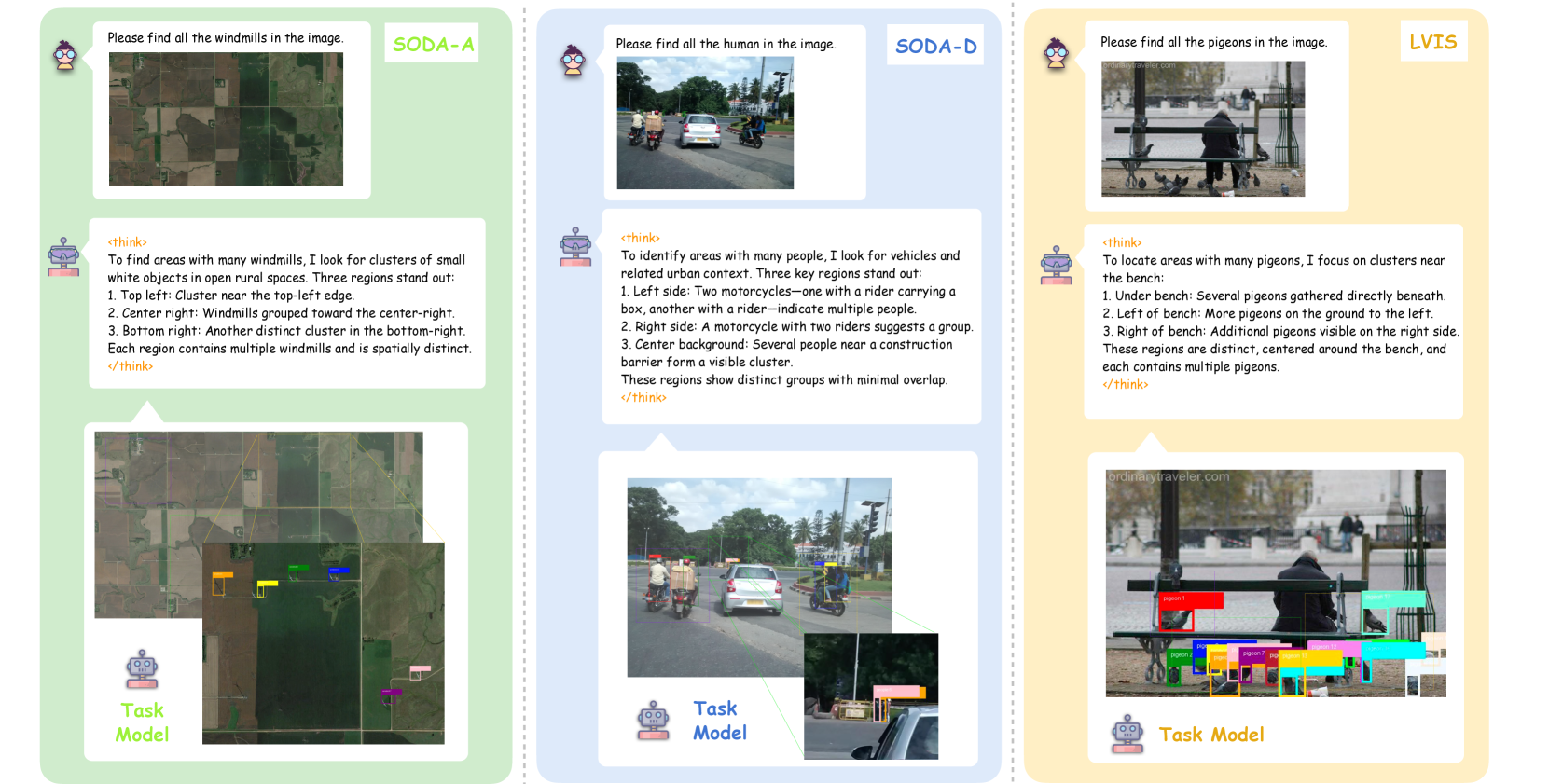

🖼️ 关键图片

📊 实验亮点

ACTIVE-O3在多个基准测试中取得了显著成果,包括小物体和密集物体定位、遥感图像中的小物体检测以及精细交互分割。此外,ACTIVE-O3还在V*基准测试中展示了强大的零样本推理能力,无需任何显式推理数据,表明其具有良好的泛化能力。具体的性能数据和提升幅度在论文中未详细给出。

🎯 应用场景

ACTIVE-O3具有广泛的应用前景,包括机器人导航、自动驾驶、遥感图像分析、智能监控等领域。通过赋予MLLM主动感知能力,可以使其在复杂环境中更有效地完成各种任务,例如目标搜索、环境探索、异常检测等。该研究有望推动人工智能技术在实际场景中的应用。

📄 摘要(原文)

Active vision, also known as active perception, refers to the process of actively selecting where and how to look in order to gather task-relevant information. It is a critical component of efficient perception and decision-making in humans and advanced embodied agents. Recently, the use of Multimodal Large Language Models (MLLMs) as central planning and decision-making modules in robotic systems has gained extensive attention. However, despite the importance of active perception in embodied intelligence, there is little to no exploration of how MLLMs can be equipped with or learn active perception capabilities. In this paper, we first provide a systematic definition of MLLM-based active perception tasks. We point out that the recently proposed GPT-o3 model's zoom-in search strategy can be regarded as a special case of active perception; however, it still suffers from low search efficiency and inaccurate region selection. To address these issues, we propose ACTIVE-O3, a purely reinforcement learning based training framework built on top of GRPO, designed to equip MLLMs with active perception capabilities. We further establish a comprehensive benchmark suite to evaluate ACTIVE-O3 across both general open-world tasks, such as small-object and dense object grounding, and domain-specific scenarios, including small object detection in remote sensing and autonomous driving, as well as fine-grained interactive segmentation. In addition, ACTIVE-O3 also demonstrates strong zero-shot reasoning abilities on the V* Benchmark, without relying on any explicit reasoning data. We hope that our work can provide a simple codebase and evaluation protocol to facilitate future research on active perception in MLLMs.