AgriFM: A Multi-source Temporal Remote Sensing Foundation Model for Agriculture Mapping

作者: Wenyuan Li, Shunlin Liang, Keyan Chen, Yongzhe Chen, Han Ma, Jianglei Xu, Yichuan Ma, Shikang Guan, Husheng Fang, Zhenwei Shi

分类: cs.CV, cs.LG

发布日期: 2025-05-27 (更新: 2026-01-15)

DOI: 10.1016/j.rse.2026.115234

🔗 代码/项目: GITHUB

💡 一句话要点

AgriFM:面向农业制图的多源时序遥感基础模型

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感基础模型 农业制图 多源数据融合 时空特征提取 Video Swin Transformer

📋 核心要点

- 现有遥感基础模型在作物制图中表现不佳,主要原因是它们无法有效处理作物系统固有的多尺度时空特性,要么忽略时间信息,要么使用固定的时空窗口。

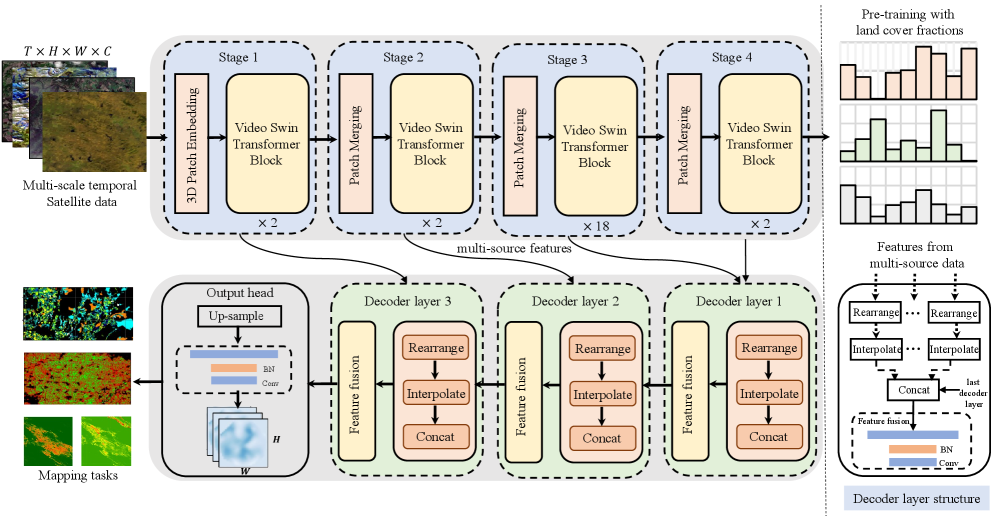

- AgriFM通过改进Video Swin Transformer架构,实现了时间下采样与空间缩放的同步,从而能够统一处理长时间序列卫星数据,有效提取分层时空特征。

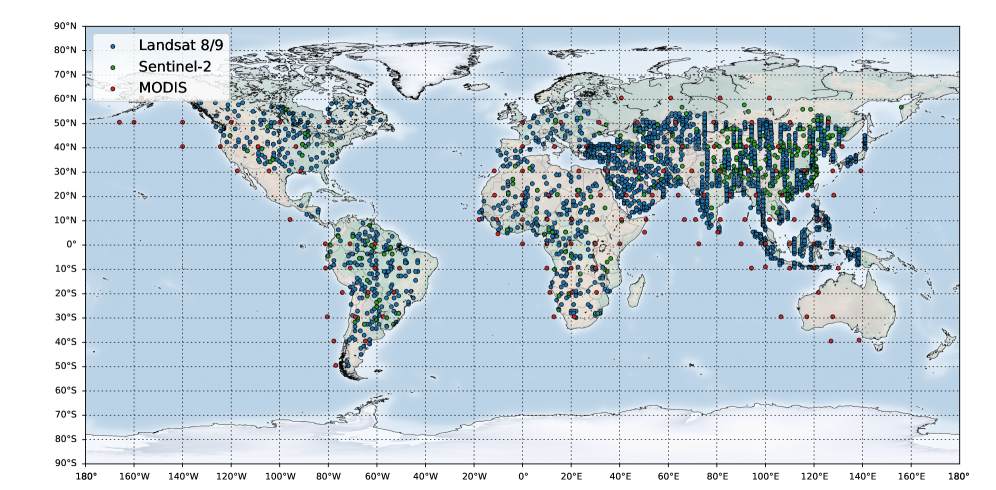

- AgriFM利用来自MODIS、Landsat-8/9和Sentinel-2的多源数据进行预训练,并在全球代表性数据集上进行了验证,结果表明其性能优于传统方法和现有遥感基础模型。

📝 摘要(中文)

精确的作物制图根本上依赖于建模多尺度的时空模式,其中空间尺度范围从个体田地纹理到景观层面的上下文,时间尺度捕捉短期物候过渡和完整的生长季动态。基于Transformer的遥感基础模型(RSFM)由于其统一时空处理的内在能力,为作物制图提供了有希望的潜力。然而,当前的RSFM在作物制图方面仍然不是最优的:它们要么采用固定的时空窗口,忽略了作物系统的多尺度性质,要么完全忽略时间信息,只关注空间模式。为了弥合这些差距,我们提出了AgriFM,一个专门为农业作物制图设计的多源遥感基础模型。我们的方法首先确定了同时进行分层时空特征提取的必要性,从而开发了一种改进的Video Swin Transformer架构,其中时间下采样与空间缩放操作同步。这种改进的骨干网络能够有效统一地处理长时间序列卫星输入。AgriFM利用来自三个卫星源(包括MODIS、Landsat-8/9和Sentinel-2)的时间丰富的的数据流,并在一个具有代表性的全球数据集上进行预训练,该数据集包含超过2500万个图像样本,并由土地覆盖产品进行监督。由此产生的框架包含一个通用的解码器架构,该架构动态地融合这些学习到的时空表示,支持各种下游任务。全面的评估表明,在所有下游任务中,AgriFM的性能优于传统的深度学习方法和最先进的通用RSFM。

🔬 方法详解

问题定义:现有的遥感基础模型在作物制图任务中存在不足。它们要么采用固定的时空窗口,无法捕捉作物系统多尺度的特性;要么完全忽略时间信息,仅关注空间模式,导致无法有效建模作物的生长季动态。这些局限性阻碍了模型在复杂农业场景下的泛化能力。

核心思路:AgriFM的核心思路是设计一个能够同时进行分层时空特征提取的遥感基础模型。通过同步时间下采样和空间缩放操作,模型可以有效地处理长时间序列卫星数据,并捕捉不同尺度的时空信息。这种设计旨在克服现有模型在处理作物系统多尺度特性方面的不足。

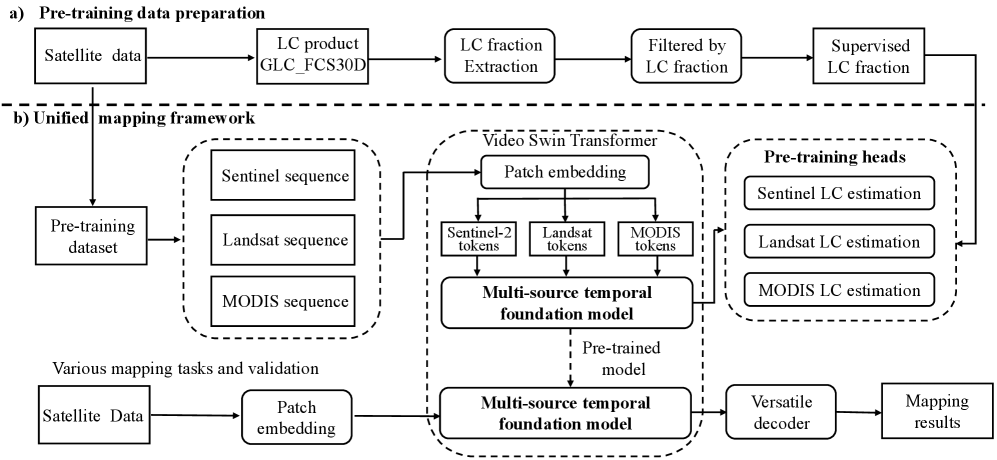

技术框架:AgriFM的整体架构基于改进的Video Swin Transformer。该架构包含一个用于提取时空特征的骨干网络和一个用于下游任务的通用解码器。骨干网络负责处理来自MODIS、Landsat-8/9和Sentinel-2等多源卫星数据,并提取分层时空特征。解码器则负责将这些特征融合,并用于各种下游任务,如作物分类和土地覆盖制图。

关键创新:AgriFM的关键创新在于其改进的Video Swin Transformer架构,该架构实现了时间下采样与空间缩放的同步。这种同步操作使得模型能够有效地处理长时间序列卫星数据,并捕捉不同尺度的时空信息。此外,AgriFM还利用多源卫星数据进行预训练,从而提高了模型的泛化能力。

关键设计:AgriFM的关键设计包括:1) 改进的Video Swin Transformer架构,其中时间下采样与空间缩放同步;2) 多源卫星数据融合策略,利用MODIS、Landsat-8/9和Sentinel-2的数据;3) 基于土地覆盖产品的全球代表性数据集,用于预训练模型;4) 通用解码器架构,支持各种下游任务。

🖼️ 关键图片

📊 实验亮点

AgriFM在多个下游任务中表现出优越的性能,显著优于传统的深度学习方法和现有的遥感基础模型。具体性能数据在论文中给出,表明AgriFM在作物制图方面具有显著的优势,能够更准确地识别和分类不同的作物类型。

🎯 应用场景

AgriFM在农业领域具有广泛的应用前景,可用于精准农业、作物长势监测、产量预测、土地利用规划和农业保险等。通过提供更准确的作物分布和生长信息,AgriFM可以帮助农民优化种植管理,提高产量和效益,同时为政府和企业提供决策支持,促进农业可持续发展。

📄 摘要(原文)

Accurate crop mapping fundamentally relies on modeling multi-scale spatiotemporal patterns, where spatial scales range from individual field textures to landscape-level context, and temporal scales capture both short-term phenological transitions and full growing-season dynamics. Transformer-based remote sensing foundation models (RSFMs) offer promising potential for crop mapping due to their innate ability for unified spatiotemporal processing. However, current RSFMs remain suboptimal for crop mapping: they either employ fixed spatiotemporal windows that ignore the multi-scale nature of crop systems or completely disregard temporal information by focusing solely on spatial patterns. To bridge these gaps, we present AgriFM, a multi-source remote sensing foundation model specifically designed for agricultural crop mapping. Our approach begins by establishing the necessity of simultaneous hierarchical spatiotemporal feature extraction, leading to the development of a modified Video Swin Transformer architecture where temporal down-sampling is synchronized with spatial scaling operations. This modified backbone enables efficient unified processing of long time-series satellite inputs. AgriFM leverages temporally rich data streams from three satellite sources including MODIS, Landsat-8/9 and Sentinel-2, and is pre-trained on a global representative dataset comprising over 25 million image samples supervised by land cover products. The resulting framework incorporates a versatile decoder architecture that dynamically fuses these learned spatiotemporal representations, supporting diverse downstream tasks. Comprehensive evaluations demonstrate AgriFM's superior performance over conventional deep learning approaches and state-of-the-art general-purpose RSFMs across all downstream tasks. Codes will be available at https://github.com/flyakon/AgriFM.