HCQA-1.5 @ Ego4D EgoSchema Challenge 2025

作者: Haoyu Zhang, Yisen Feng, Qiaohui Chu, Meng Liu, Weili Guan, Yaowei Wang, Liqiang Nie

分类: cs.CV, cs.AI

发布日期: 2025-05-27

备注: The third-place solution for the Ego4D EgoSchema Challenge at the CVPR EgoVis Workshop 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于多源聚合与置信度过滤的HCQA扩展框架,提升第一人称视角视频问答的准确性。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 第一人称视角视频问答 Ego4D 多源聚合 置信度过滤 细粒度推理

📋 核心要点

- 现有第一人称视角视频问答方法在答案预测的可靠性方面存在不足,需要更有效的框架。

- 论文提出一种HCQA框架的扩展,采用多源聚合和置信度过滤机制,提升答案预测的准确性。

- 实验结果表明,该方法在EgoSchema数据集上取得了77%的准确率,优于现有方法。

📝 摘要(中文)

本报告介绍了一种在CVPR 2025 Ego4D EgoSchema挑战赛中获得第三名的方法。为了提高第一人称视角视频问答中答案预测的可靠性,我们对先前提出的HCQA框架进行了有效的扩展。我们的方法引入了一种多源聚合策略来生成多样化的预测,然后采用基于置信度的过滤机制直接选择高置信度的答案。对于低置信度的情况,我们结合了一个细粒度的推理模块,执行额外的视觉和上下文分析来改进预测。在EgoSchema盲测数据集上的评估表明,我们的方法在超过5000个人工标注的多项选择题上实现了77%的准确率,优于去年的获胜方案和大多数参赛团队。我们的代码将在https://github.com/Hyu-Zhang/HCQA上公开。

🔬 方法详解

问题定义:论文旨在解决第一人称视角视频问答(Egocentric Video Question Answering)中答案预测可靠性不足的问题。现有方法在处理复杂场景和需要细粒度推理的问题时,容易产生低置信度或错误的答案,影响整体性能。因此,如何提高答案预测的准确性和可靠性是本研究的关键挑战。

核心思路:论文的核心思路是结合多源聚合和置信度过滤机制,以提高答案预测的可靠性。首先,通过多源聚合生成多样化的预测结果,然后利用置信度过滤机制筛选出高置信度的答案。对于低置信度的答案,则采用细粒度的推理模块进行进一步的视觉和上下文分析,以提升预测的准确性。

技术框架:整体框架包括以下几个主要模块:1) 多源聚合模块:用于生成多样化的答案预测;2) 置信度过滤模块:根据预测的置信度选择高置信度的答案;3) 细粒度推理模块:针对低置信度答案,进行额外的视觉和上下文分析,以优化预测结果。整个流程首先通过多源聚合生成多个候选答案,然后通过置信度过滤选择置信度高的答案,对于置信度低的答案,再通过细粒度推理模块进行优化。

关键创新:论文的关键创新在于将多源聚合和置信度过滤机制相结合,并针对低置信度情况引入了细粒度推理模块。这种方法能够有效地提高答案预测的可靠性,尤其是在处理复杂场景和需要细粒度推理的问题时,能够显著提升性能。与现有方法相比,该方法能够更有效地利用多源信息,并根据置信度自适应地调整推理策略。

关键设计:多源聚合模块的具体实现方式未知,可能涉及不同的模型或特征提取方法。置信度过滤模块可能采用阈值或其他置信度评估方法来选择高置信度答案。细粒度推理模块的具体实现方式也未知,可能包括注意力机制、图神经网络等技术,用于进行更深入的视觉和上下文分析。损失函数和网络结构等细节未在摘要中提及,具体实现未知。

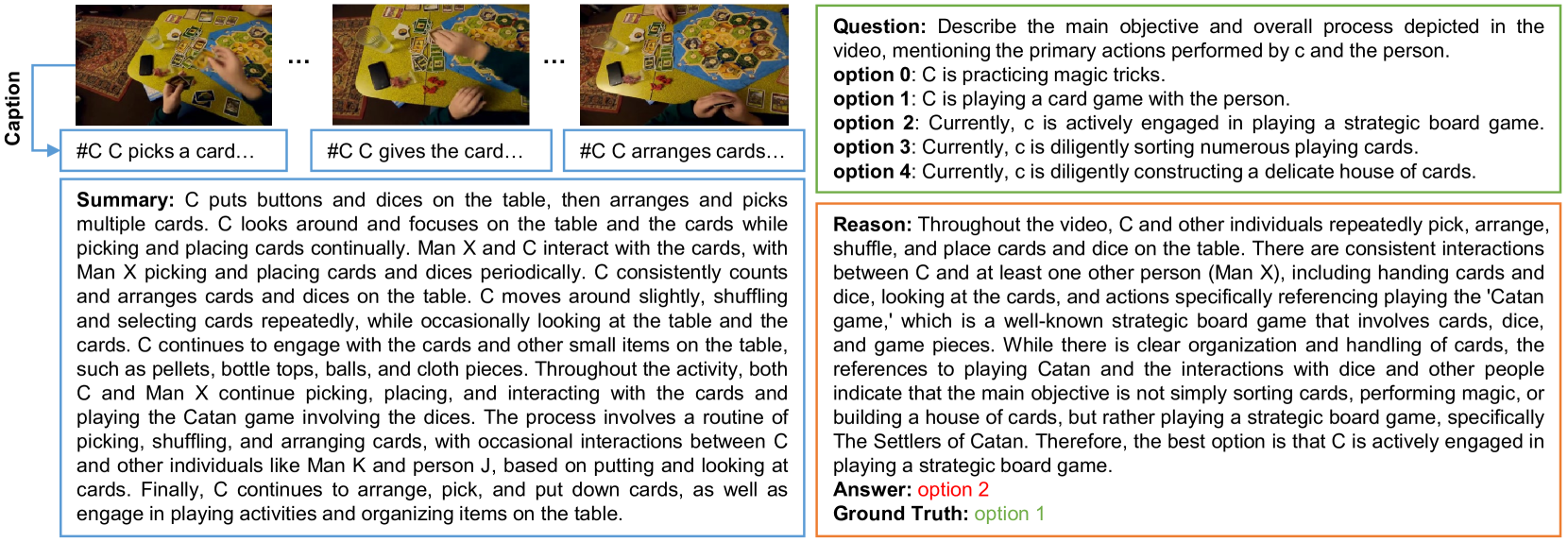

🖼️ 关键图片

📊 实验亮点

该方法在EgoSchema盲测数据集上取得了77%的准确率,超过了去年的获胜方案和大多数参赛团队。这一结果表明,该方法在第一人称视角视频问答任务中具有显著的优势,能够有效地提高答案预测的准确性和可靠性。具体的提升幅度未知,需要参考完整的论文。

🎯 应用场景

该研究成果可应用于智能助手、监控系统、机器人导航等领域。通过提升第一人称视角视频问答的准确性,可以使机器更好地理解人类的意图和行为,从而提供更智能、更可靠的服务。例如,在智能家居场景中,可以帮助用户更方便地控制家电设备;在医疗领域,可以辅助医生进行诊断和治疗。

📄 摘要(原文)

In this report, we present the method that achieves third place for Ego4D EgoSchema Challenge in CVPR 2025. To improve the reliability of answer prediction in egocentric video question answering, we propose an effective extension to the previously proposed HCQA framework. Our approach introduces a multi-source aggregation strategy to generate diverse predictions, followed by a confidence-based filtering mechanism that selects high-confidence answers directly. For low-confidence cases, we incorporate a fine-grained reasoning module that performs additional visual and contextual analysis to refine the predictions. Evaluated on the EgoSchema blind test set, our method achieves 77% accuracy on over 5,000 human-curated multiple-choice questions, outperforming last year's winning solution and the majority of participating teams. Our code will be added at https://github.com/Hyu-Zhang/HCQA.