InstructPart: Task-Oriented Part Segmentation with Instruction Reasoning

作者: Zifu Wan, Yaqi Xie, Ce Zhang, Zhiqiu Lin, Zihan Wang, Simon Stepputtis, Deva Ramanan, Katia Sycara

分类: cs.CV, cs.CL, cs.RO

发布日期: 2025-05-23

备注: Accepted by ACL 2025 Main. Project page: https://zifuwan.github.io/InstructPart/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

InstructPart:提出指令推理的任务导向部件分割基准与方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 部件分割 任务导向 视觉-语言模型 指令推理 数据集 机器人 虚拟现实

📋 核心要点

- 现有视觉-语言模型通常忽略物体的组成部分,限制了其在需要理解部件功能的任务中的应用。

- InstructPart通过引入包含部件分割注释和任务指令的数据集,促进模型学习部件级别的任务理解和执行。

- 实验表明,现有VLM在InstructPart基准上表现不佳,而通过微调的基线模型可以显著提升性能。

📝 摘要(中文)

大型多模态基础模型在语言和视觉领域取得了显著进展,广泛应用于机器人、自动驾驶、信息检索和目标定位等任务。然而,许多模型将对象视为不可分割的整体,忽略了其组成部分。理解这些组成部分及其相关功能对于执行各种任务至关重要。本文提出了一个新的真实世界基准InstructPart,包含手工标注的部件分割注释和任务导向的指令,用于评估当前模型在日常环境中理解和执行部件级任务的能力。实验表明,即使对于最先进的视觉-语言模型(VLM),任务导向的部件分割仍然是一个具有挑战性的问题。此外,本文还提出了一个简单的基线方法,通过在InstructPart数据集上进行微调,性能提升了两倍。该数据集和基准旨在促进任务导向部件分割的研究,并增强VLM在机器人、虚拟现实、信息检索等领域的适用性。

🔬 方法详解

问题定义:论文旨在解决视觉-语言模型在任务导向的部件分割方面的不足。现有模型通常将物体视为一个整体,无法理解物体由哪些部件组成,以及这些部件的功能和作用。这限制了模型在需要细粒度物体理解的任务中的应用,例如机器人操作、虚拟现实交互等。现有方法的痛点在于缺乏高质量的、包含部件分割信息和任务指令的数据集,以及有效的模型训练策略。

核心思路:论文的核心思路是构建一个包含部件分割注释和任务指令的数据集InstructPart,并利用该数据集对视觉-语言模型进行微调,使其能够更好地理解和执行任务导向的部件分割。通过任务指令的引导,模型可以学习到不同部件的功能和作用,从而提高分割的准确性和实用性。

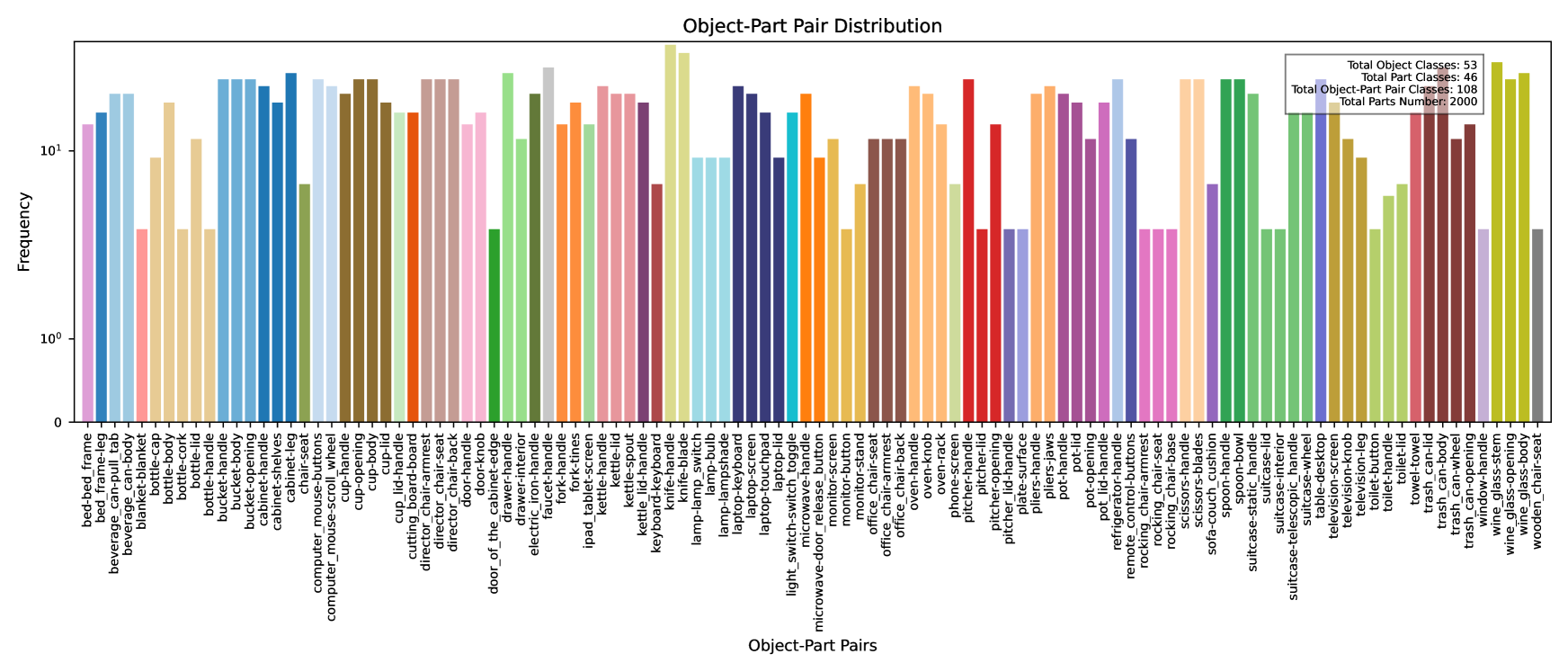

技术框架:InstructPart数据集包含真实世界场景下的图像,以及手工标注的部件分割信息和任务导向的指令。论文提出的基线方法是基于现有的视觉-语言模型,例如CLIP或类似的模型,并在InstructPart数据集上进行微调。微调过程旨在使模型能够根据输入的图像和任务指令,预测出正确的部件分割结果。整体流程包括数据预处理、模型微调和性能评估三个阶段。

关键创新:论文的关键创新在于提出了InstructPart数据集,该数据集是首个包含任务导向指令的部件分割数据集。与以往的部件分割数据集相比,InstructPart数据集更加注重部件的功能和作用,以及部件与任务之间的关系。此外,论文还提出了一个简单的基线方法,证明了通过在InstructPart数据集上进行微调,可以显著提升视觉-语言模型在任务导向部件分割方面的性能。

关键设计:InstructPart数据集的标注过程采用了精细的手工标注,保证了部件分割的准确性。任务指令的设计涵盖了各种常见的任务场景,例如抓取、放置、组装等。在模型微调方面,论文采用了交叉熵损失函数来衡量预测分割结果与真实分割结果之间的差异。具体的网络结构和参数设置取决于所使用的基础视觉-语言模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使对于最先进的视觉-语言模型,在InstructPart基准上的性能仍然有待提高。通过在InstructPart数据集上进行微调,论文提出的基线方法可以将性能提升两倍,证明了InstructPart数据集的有效性和价值。这些结果表明,任务导向的部件分割是一个具有挑战性但有前景的研究方向。

🎯 应用场景

该研究成果可广泛应用于机器人、虚拟现实、信息检索等领域。在机器人领域,可以帮助机器人更好地理解物体及其部件的功能,从而实现更智能的操作和交互。在虚拟现实领域,可以提高虚拟环境的真实感和交互性,使用户能够更自然地与虚拟物体进行交互。在信息检索领域,可以实现基于部件的图像搜索和检索,提高检索的准确性和效率。

📄 摘要(原文)

Large multimodal foundation models, particularly in the domains of language and vision, have significantly advanced various tasks, including robotics, autonomous driving, information retrieval, and grounding. However, many of these models perceive objects as indivisible, overlooking the components that constitute them. Understanding these components and their associated affordances provides valuable insights into an object's functionality, which is fundamental for performing a wide range of tasks. In this work, we introduce a novel real-world benchmark, InstructPart, comprising hand-labeled part segmentation annotations and task-oriented instructions to evaluate the performance of current models in understanding and executing part-level tasks within everyday contexts. Through our experiments, we demonstrate that task-oriented part segmentation remains a challenging problem, even for state-of-the-art Vision-Language Models (VLMs). In addition to our benchmark, we introduce a simple baseline that achieves a twofold performance improvement through fine-tuning with our dataset. With our dataset and benchmark, we aim to facilitate research on task-oriented part segmentation and enhance the applicability of VLMs across various domains, including robotics, virtual reality, information retrieval, and other related fields. Project website: https://zifuwan.github.io/InstructPart/.