InstructSAM: A Training-Free Framework for Instruction-Oriented Remote Sensing Object Recognition

作者: Yijie Zheng, Weijie Wu, Qingyun Li, Xuehui Wang, Xu Zhou, Aiai Ren, Jun Shen, Long Zhao, Guoqing Li, Xue Yang

分类: cs.CV

发布日期: 2025-05-21 (更新: 2025-10-13)

备注: Accepted to NeurIPS 2025

💡 一句话要点

提出InstructSAM,一个免训练的遥感图像指令驱动目标识别框架。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感图像 目标识别 指令驱动 视觉-语言模型 免训练学习

📋 核心要点

- 现有遥感目标识别方法依赖显式类别信息,难以处理复杂指令和高级推理。

- InstructSAM利用大型视觉-语言模型理解指令,结合SAM2进行掩码生成,并通过二元整数规划进行掩码-标签分配。

- 实验表明,InstructSAM在多个任务上性能优于或匹配特定基线,并显著降低了计算成本。

📝 摘要(中文)

本文提出了一种用于遥感图像中指令导向目标识别的新框架InstructSAM。现有方法依赖于显式的类别线索,难以处理需要高级推理的复杂或隐式查询。为了解决这个问题,作者构建了一个新的任务套件InstructCDS,包括指令导向的目标计数、检测和分割,涵盖了开放词汇、开放式和开放子类场景。同时,构建了首个地球观测InstructCDS基准EarthInstruct,该基准由两个具有不同空间分辨率和注释规则的遥感数据集组成,包含20个类别,要求模型能够解释特定于数据集的指令。InstructSAM利用大型视觉-语言模型解释用户指令并估计目标计数,采用SAM2进行掩码提议,并将掩码-标签分配问题建模为二元整数规划问题。通过整合语义相似性和计数约束,InstructSAM无需依赖置信度阈值即可有效地将类别分配给预测的掩码。实验表明,InstructSAM在多个任务中匹配或超过了专门的基线,同时保持了近乎恒定的推理时间,并减少了89%的输出tokens和超过32%的总体运行时间。

🔬 方法详解

问题定义:现有遥感图像目标识别方法依赖于明确的类别信息,无法有效处理需要复杂推理的指令性查询,例如“找出机场附近的五个大型建筑物”。此外,缺乏针对遥感图像的指令驱动目标识别的基准数据集。

核心思路:InstructSAM的核心思路是利用大型视觉-语言模型(VLM)的强大语义理解能力,直接根据用户指令进行目标识别,而无需针对特定任务进行训练。通过结合VLM的语义信息和SAM(Segment Anything Model)的分割能力,实现高效且灵活的遥感图像目标识别。

技术框架:InstructSAM框架主要包含三个阶段:1) 指令解析与计数估计:利用VLM解析用户指令,并估计图像中目标的数量。2) 掩码提议:使用SAM2(一种改进的SAM版本)生成候选目标掩码。3) 掩码-标签分配:将掩码-标签分配问题建模为二元整数规划问题,通过优化语义相似性和计数约束,将类别分配给预测的掩码。

关键创新:InstructSAM的关键创新在于其免训练的特性,以及将掩码-标签分配问题建模为二元整数规划问题。免训练特性使其能够快速适应新的任务和数据集,而二元整数规划则能够有效地利用语义信息和计数约束,提高识别精度。

关键设计:在掩码-标签分配阶段,InstructSAM使用余弦相似度来衡量掩码和标签之间的语义相似性。目标函数旨在最大化整体的语义相似度,同时满足计数约束,即分配给每个类别的掩码数量应与VLM估计的目标数量相匹配。二元整数规划求解器用于找到最优的掩码-标签分配方案。

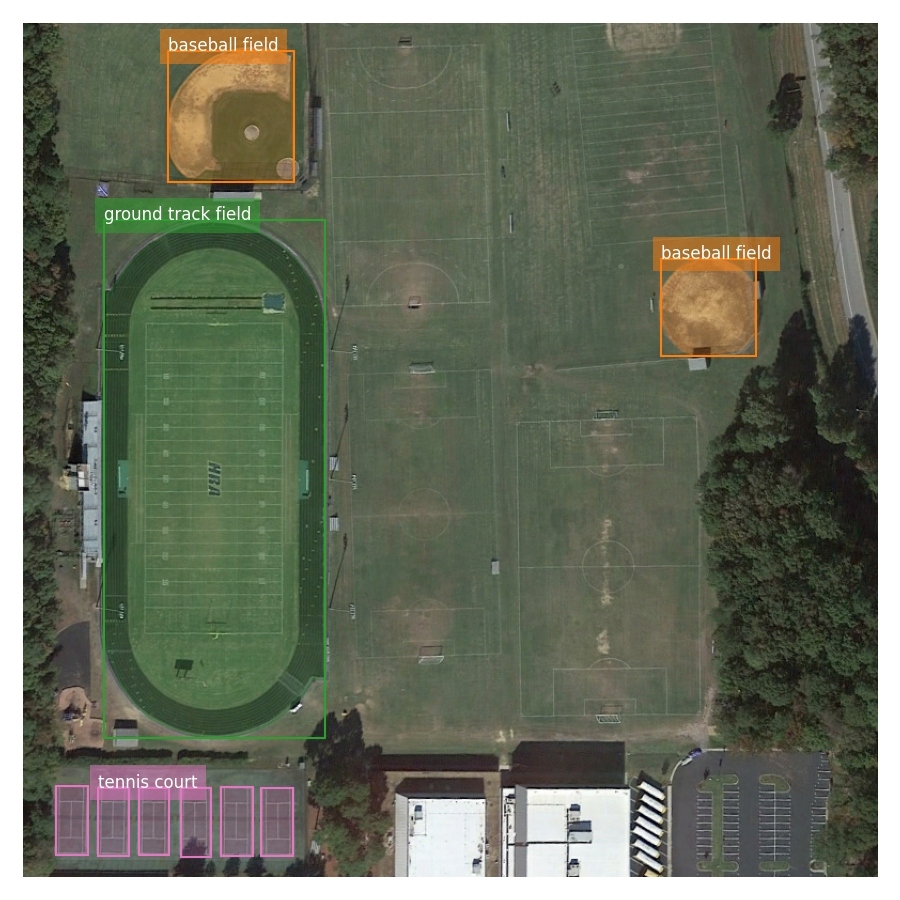

🖼️ 关键图片

📊 实验亮点

InstructSAM在多个指令驱动的目标识别任务中取得了显著的成果。实验结果表明,InstructSAM在性能上可以与或超过专门训练的基线模型,同时显著降低了计算成本。具体来说,InstructSAM减少了89%的输出tokens和超过32%的总体运行时间,并且推理时间几乎与目标数量无关。

🎯 应用场景

InstructSAM在遥感图像分析领域具有广泛的应用前景,例如大规模地图绘制、自动化数据标注、灾害监测、城市规划和环境监测等。该方法能够根据用户指令快速识别和定位感兴趣的目标,从而提高遥感图像分析的效率和准确性,并为决策提供支持。

📄 摘要(原文)

Language-Guided object recognition in remote sensing imagery is crucial for large-scale mapping and automated data annotation. However, existing open-vocabulary and visual grounding methods rely on explicit category cues, limiting their ability to handle complex or implicit queries that require advanced reasoning. To address this issue, we introduce a new suite of tasks, including Instruction-Oriented Object Counting, Detection, and Segmentation (InstructCDS), covering open-vocabulary, open-ended, and open-subclass scenarios. We further present EarthInstruct, the first InstructCDS benchmark for earth observation. It is constructed from two diverse remote sensing datasets with varying spatial resolutions and annotation rules across 20 categories, necessitating models to interpret dataset-specific instructions. Given the scarcity of semantically rich labeled data in remote sensing, we propose InstructSAM, a training-free framework for instruction-driven object recognition. InstructSAM leverages large vision-language models to interpret user instructions and estimate object counts, employs SAM2 for mask proposal, and formulates mask-label assignment as a binary integer programming problem. By integrating semantic similarity with counting constraints, InstructSAM efficiently assigns categories to predicted masks without relying on confidence thresholds. Experiments demonstrate that InstructSAM matches or surpasses specialized baselines across multiple tasks while maintaining near-constant inference time regardless of object count, reducing output tokens by 89% and overall runtime by over 32% compared to direct generation approaches. We believe the contributions of the proposed tasks, benchmark, and effective approach will advance future research in developing versatile object recognition systems.