Can VLMs Detect and Localize Fine-Grained AI-Edited Images?

作者: Zhen Sun, Ziyi Zhang, Zeren Luo, Zhiyuan Zhong, Zeyang Sha, Tianshuo Cong, Zheng Li, Shiwen Cui, Weiqiang Wang, Jiaheng Wei, Xinlei He, Qi Li, Qian Wang

分类: cs.CV, cs.AI, cs.CR

发布日期: 2025-05-21 (更新: 2025-12-03)

备注: 14pages,19 figures

💡 一句话要点

提出FragFake基准,研究视觉语言模型在AI编辑图像检测与定位中的能力。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI编辑图像检测 视觉语言模型 图像篡改定位 FragFake基准 多模态学习

📋 核心要点

- 现有AIGC检测器只能给出图像真伪的全局标签,缺乏对编辑区域的精确定位能力。

- 构建大规模AI编辑图像基准FragFake,并探索微调视觉语言模型(VLMs)进行编辑区域检测与定位。

- 实验表明,微调后的VLMs(如Qwen2.5-VL)在编辑图像分类和定位任务上表现出色,显著优于预训练模型。

📝 摘要(中文)

针对AI编辑图像的精细检测与定位问题,本文提出FragFake基准,旨在评估内容真实性。该基准包含多个来源数据集、编辑模型和编辑类型,解决了现有AIGC检测器仅提供全局真伪标签、传统方法依赖昂贵像素级标注以及缺乏大规模现代基准的问题。本文首次系统性地研究了视觉语言模型(VLMs)在编辑图像分类和编辑区域定位中的能力。实验表明,预训练VLMs(如GPT4o)性能较差,而微调模型(如Qwen2.5-VL)在所有设置中均实现了高精度和显著更高的对象精确度。此外,探索了基于GRPO的RLVR训练,在提高模型输出可解释性的同时,获得了适度的指标提升。消融和迁移分析揭示了数据平衡、训练规模、LoRA秩和训练域如何影响性能,并突出了跨编辑器和跨数据集泛化的潜力和局限性。这项工作为多模态内容真实性领域的后续研究奠定了基础。

🔬 方法详解

问题定义:论文旨在解决AI编辑图像的精细检测与定位问题。现有AIGC检测器通常只能提供全局的真伪标签,无法指出图像中哪些区域被编辑过。传统计算机视觉方法虽然可以进行编辑区域定位,但需要昂贵的像素级标注,难以扩展到大规模数据集。此外,缺乏专门针对现代AI编辑图像的大规模基准数据集,限制了相关研究的进展。

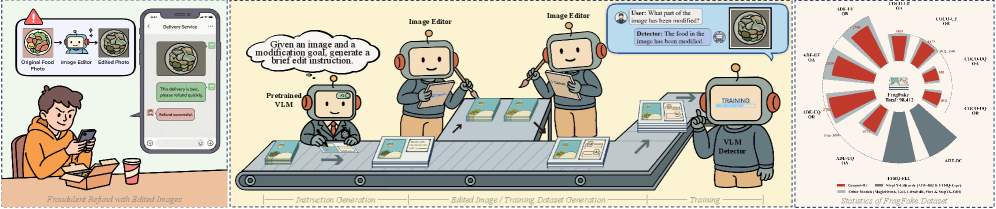

核心思路:论文的核心思路是利用视觉语言模型(VLMs)的强大能力,通过构建大规模的AI编辑图像数据集FragFake,并对VLMs进行微调,使其能够同时进行编辑图像的分类和编辑区域的定位。这种方法避免了对像素级标注的依赖,并能够充分利用VLMs的预训练知识。

技术框架:整体框架包括数据生成pipeline和模型训练pipeline。数据生成pipeline负责自动生成大规模的AI编辑图像数据集FragFake,该pipeline涵盖多个来源数据集、编辑模型和编辑类型。模型训练pipeline则使用FragFake数据集对VLMs进行微调,使其能够进行编辑图像的分类和编辑区域的定位。此外,论文还探索了基于GRPO的RLVR训练方法,以提高模型输出的可解释性。

关键创新:论文的关键创新在于以下几点:一是构建了大规模的AI编辑图像基准数据集FragFake,填补了该领域的空白;二是首次系统性地研究了VLMs在编辑图像检测与定位中的能力,并证明了微调VLMs的有效性;三是探索了基于GRPO的RLVR训练方法,以提高模型输出的可解释性。

关键设计:在数据生成方面,论文设计了一个自动化的数据生成pipeline,可以高效地生成大规模的AI编辑图像数据集。在模型训练方面,论文采用了LoRA(Low-Rank Adaptation)技术,以减少微调VLMs的计算成本。此外,论文还对数据平衡、训练规模、LoRA秩和训练域等因素进行了消融实验,以分析其对模型性能的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,微调后的Qwen2.5-VL模型在FragFake基准上取得了显著的性能提升,在编辑图像分类和定位任务上均优于预训练的GPT4o等模型。具体而言,Qwen2.5-VL在对象精确度方面获得了显著提升,表明其能够更准确地定位图像中的编辑区域。此外,基于GRPO的RLVR训练方法在提高模型输出可解释性的同时,也带来了适度的性能提升。

🎯 应用场景

该研究成果可应用于内容审核、版权保护、新闻真实性验证等领域。通过自动检测和定位AI编辑图像,可以有效防止虚假信息的传播,维护网络空间的健康。未来,该技术有望集成到各种图像处理和分析系统中,为用户提供更加可靠的内容真实性评估服务。

📄 摘要(原文)

Fine-grained detection and localization of localized image edits is crucial for assessing content authenticity, especially as modern diffusion models and image editors can produce highly realistic manipulations. However, this problem faces three key challenges: (1) most AIGC detectors produce only a global real-or-fake label without indicating where edits occur; (2) traditional computer vision methods for edit localization typically rely on costly pixel-level annotations; and (3) there is no large-scale, modern benchmark specifically targeting edited-image detection. To address these gaps, we develop an automated data-generation pipeline and construct FragFake, a large-scale benchmark of AI-edited images spanning multiple source datasets, diverse editing models, and several common edit types. Building on FragFake, we are the first to systematically study vision language models (VLMs) for edited-image classification and edited-region localization. Our experiments show that pretrained VLMs, including GPT4o, perform poorly on this task, whereas fine-tuned models such as Qwen2.5-VL achieve high accuracy and substantially higher object precision across all settings. We further explore GRPO-based RLVR training, which yields modest metric gains while improving the interpretability of model outputs. Ablation and transfer analyses reveal how data balancing, training size, LoRA rank, and training domain affect performance, and highlight both the potential and the limitations of cross-editor and cross-dataset generalization. We anticipate that this work will establish a solid foundation to facilitate and inspire subsequent research endeavors in the domain of multimodal content authenticity.