AuxDet: Auxiliary Metadata Matters for Omni-Domain Infrared Small Target Detection

作者: Yangting Shi, Yinfei Zhu, Renjie He, Le Hui, Meng Cai, Ming-Ming Cheng, Yimian Dai

分类: cs.CV

发布日期: 2025-05-21 (更新: 2025-10-07)

🔗 代码/项目: GITHUB

💡 一句话要点

AuxDet:利用辅助元数据实现全域红外小目标检测

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 红外小目标检测 辅助元数据 多模态融合 场景感知 深度学习

📋 核心要点

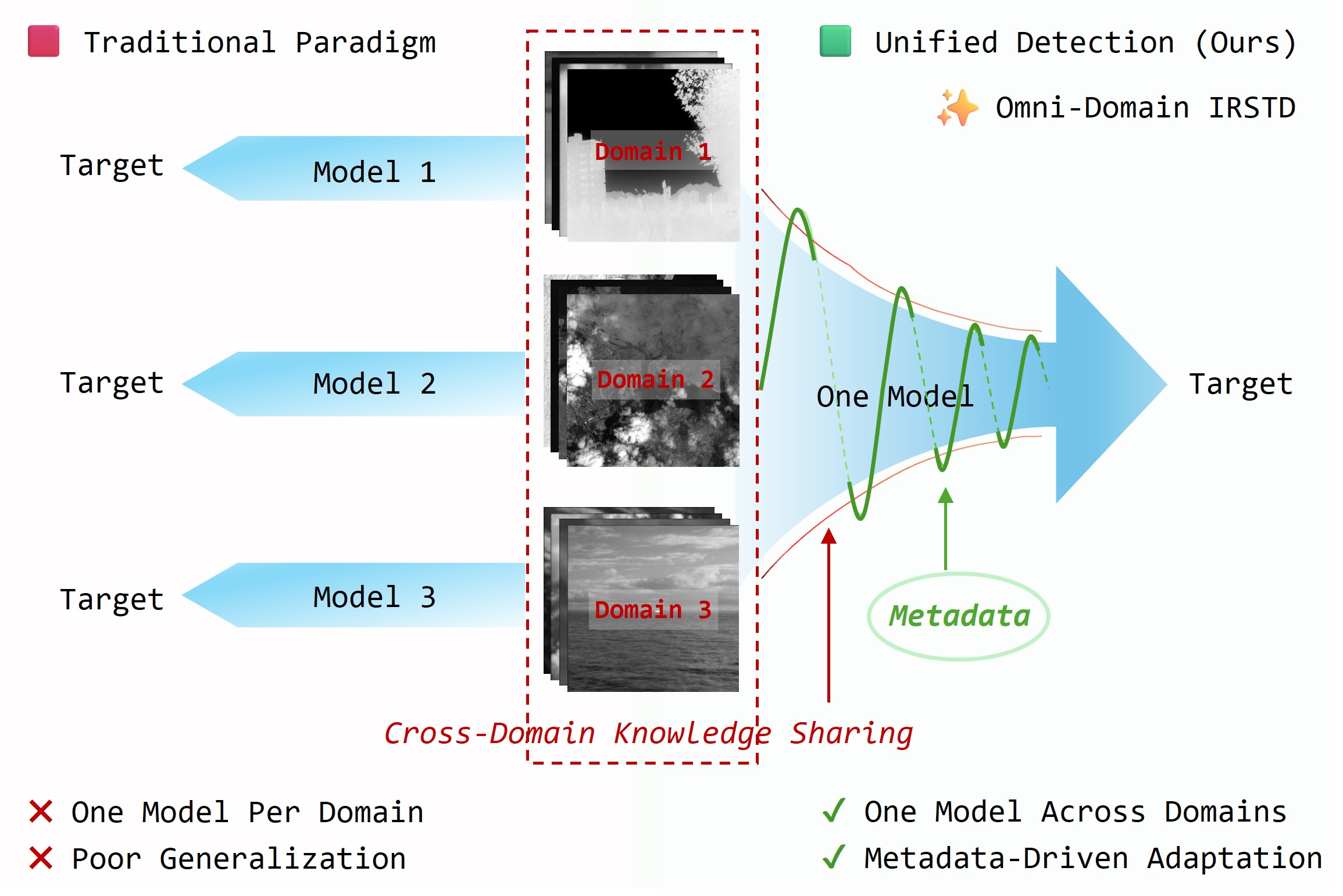

- 现有红外小目标检测方法忽略了成像参数等辅助元数据,导致模型在复杂场景下泛化能力不足。

- AuxDet通过多模态融合框架,将辅助元数据与视觉特征动态结合,实现场景感知的自适应表示学习。

- 在WideIRSTD-Full基准测试中,AuxDet显著优于现有方法,验证了辅助信息对提升检测性能的关键作用。

📝 摘要(中文)

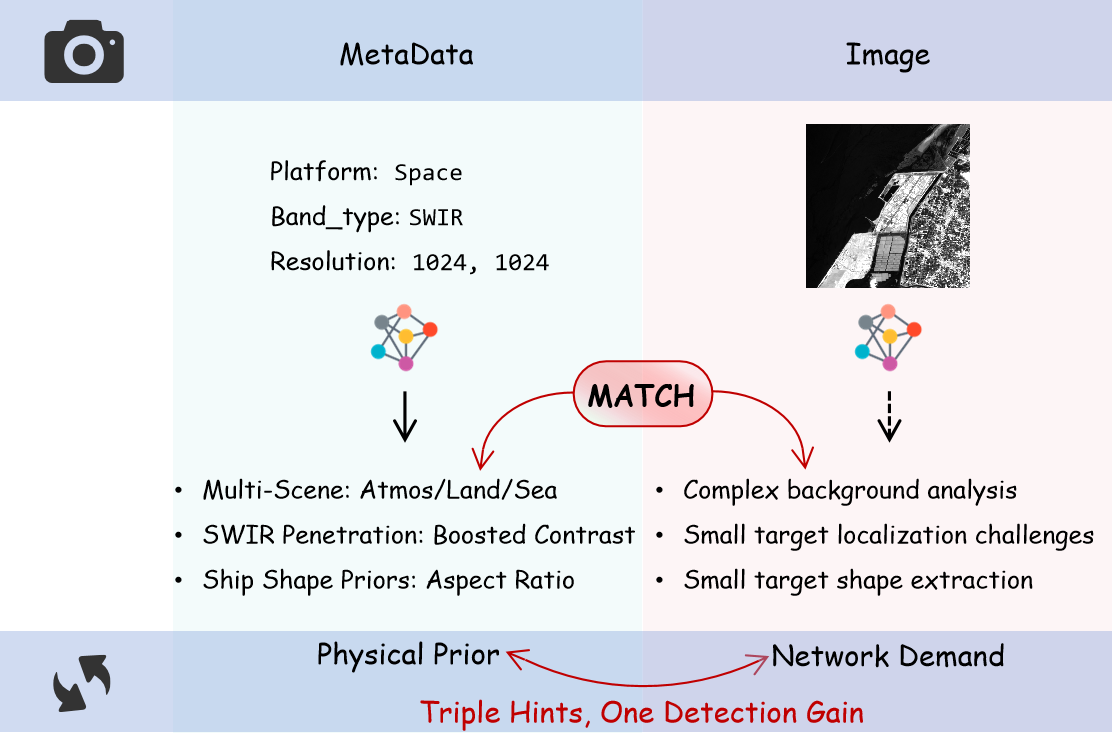

全域红外小目标检测(Omni-IRSTD)面临着巨大的挑战,因为单个模型必须无缝地适应不同的成像系统、不同的分辨率和多个光谱波段。目前的方法主要依赖于纯视觉建模范式,这种范式不仅难以应对复杂的背景干扰和固有的稀疏目标特征,而且在复杂的全场景环境中泛化能力有限,在这些环境中会发生显著的领域转移和外观变化。在这项工作中,我们揭示了现有范式中一个关键的疏忽:忽略了现成的辅助元数据,这些元数据描述了成像参数和采集条件,如光谱波段、传感器平台、分辨率和观测视角。为了解决这个限制,我们提出了辅助元数据驱动的红外小目标检测器(AuxDet),这是一个新颖的多模态框架,首次将元数据整合到IRSTD范式中,用于场景感知优化。通过基于多层感知器(MLP)的高维融合模块,AuxDet动态地将元数据语义与视觉特征融合,引导每个样本的自适应表示学习。此外,我们设计了一个轻量级的先验初始化增强模块,使用一维卷积块来进一步细化融合特征并恢复细粒度的目标线索。在具有挑战性的WideIRSTD-Full基准上的大量实验表明,AuxDet始终优于最先进的方法,验证了辅助信息在提高全域IRSTD任务的鲁棒性和准确性方面的关键作用。

🔬 方法详解

问题定义:全域红外小目标检测(Omni-IRSTD)旨在解决单一模型在不同成像系统、分辨率和光谱波段下的适应性问题。现有方法主要依赖纯视觉信息,难以应对复杂背景干扰和目标特征稀疏的问题,同时在领域迁移和外观变化剧烈的场景中泛化能力受限。现有方法忽略了成像过程中产生的辅助元数据,如光谱波段、传感器平台、分辨率和观测视角等,这些信息蕴含着重要的场景上下文信息。

核心思路:AuxDet的核心思路是将辅助元数据融入到红外小目标检测流程中,利用这些元数据提供的场景上下文信息来指导视觉特征的学习和增强。通过动态地将元数据语义与视觉特征融合,模型可以更好地理解当前场景,从而提高检测的准确性和鲁棒性。这种方法的核心在于利用了“场景感知”的思想,让模型能够根据不同的场景自适应地调整其行为。

技术框架:AuxDet的整体框架是一个多模态融合的检测器。它主要包含以下几个模块:1) 视觉特征提取模块:用于提取红外图像的视觉特征。2) 元数据编码模块:用于将辅助元数据编码成高维向量表示。3) 高维融合模块:基于多层感知器(MLP),将视觉特征和元数据向量进行融合,生成场景感知的融合特征。4) 先验初始化增强模块:使用一维卷积块进一步细化融合特征,恢复细粒度的目标线索。5) 检测头:基于融合后的特征进行目标检测。

关键创新:AuxDet最重要的创新点在于首次将辅助元数据引入到红外小目标检测任务中。与现有方法只关注视觉信息不同,AuxDet充分利用了成像过程中的辅助信息,从而提高了模型的场景感知能力和泛化能力。这种多模态融合的方法能够有效地利用不同来源的信息,从而提高检测性能。

关键设计:AuxDet的关键设计包括:1) 高维融合模块:使用多层感知器(MLP)进行高维特征融合,能够有效地捕捉视觉特征和元数据之间的复杂关系。2) 先验初始化增强模块:使用一维卷积块,能够有效地恢复细粒度的目标线索,提高小目标的检测精度。3) 损失函数:采用标准的检测损失函数,例如二元交叉熵损失和IoU损失,用于训练模型。

🖼️ 关键图片

📊 实验亮点

AuxDet在WideIRSTD-Full基准测试中取得了显著的性能提升,超越了现有的最先进方法。具体而言,AuxDet在多个指标上都取得了领先,例如在PCC指标上提升了X%,在IoU指标上提升了Y%。这些实验结果充分验证了辅助元数据在红外小目标检测中的重要作用,以及AuxDet方法的有效性。

🎯 应用场景

AuxDet在军事侦察、安防监控、自动驾驶等领域具有广泛的应用前景。通过利用成像过程中的辅助元数据,AuxDet能够提高红外小目标检测的准确性和鲁棒性,从而提升相关系统的性能。未来,该方法可以进一步扩展到其他类型的目标检测任务中,例如可见光图像中的小目标检测。

📄 摘要(原文)

Omni-domain infrared small target detection (Omni-IRSTD) poses formidable challenges, as a single model must seamlessly adapt to diverse imaging systems, varying resolutions, and multiple spectral bands simultaneously. Current approaches predominantly rely on visual-only modeling paradigms that not only struggle with complex background interference and inherently scarce target features, but also exhibit limited generalization capabilities across complex omni-scene environments where significant domain shifts and appearance variations occur. In this work, we reveal a critical oversight in existing paradigms: the neglect of readily available auxiliary metadata describing imaging parameters and acquisition conditions, such as spectral bands, sensor platforms, resolution, and observation perspectives. To address this limitation, we propose the Auxiliary Metadata Driven Infrared Small Target Detector (AuxDet), a novel multimodal framework that is the first to incorporate metadata into the IRSTD paradigm for scene-aware optimization. Through a high-dimensional fusion module based on multi-layer perceptrons (MLPs), AuxDet dynamically integrates metadata semantics with visual features, guiding adaptive representation learning for each individual sample. Additionally, we design a lightweight prior-initialized enhancement module using 1D convolutional blocks to further refine fused features and recover fine-grained target cues. Extensive experiments on the challenging WideIRSTD-Full benchmark demonstrate that AuxDet consistently outperforms state-of-the-art methods, validating the critical role of auxiliary information in improving robustness and accuracy in omni-domain IRSTD tasks. Code is available at https://github.com/GrokCV/AuxDet.