Coarse Attribute Prediction with Task Agnostic Distillation for Real World Clothes Changing ReID

作者: Priyank Pathak, Yogesh S Rawat

分类: cs.CV

发布日期: 2025-05-19 (更新: 2025-11-03)

备注: The 36th British Machine Vision Conference (BMVC)

💡 一句话要点

提出RLQ框架,通过粗粒度属性预测和任务无关蒸馏提升真实场景下服饰变换ReID的鲁棒性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 服饰变换ReID 低质量图像 粗粒度属性预测 任务无关蒸馏 行人重识别 鲁棒性 自监督学习

📋 核心要点

- 现有服饰变换ReID方法在低质量图像上性能显著下降,原因是图像伪影引入噪声,破坏了特征表示。

- RLQ框架通过粗粒度属性预测(CAP)增强模型对外部属性的感知,并通过任务无关蒸馏(TAD)提升内部特征的鲁棒性。

- 实验结果表明,RLQ在多个真实世界数据集上显著优于现有方法,尤其是在低质量图像上性能提升明显。

📝 摘要(中文)

本文关注真实场景下的服饰变换行人重识别(CC-ReID)问题。现有方法在高分辨率(HQ)图像上表现良好,但在低分辨率(LQ)图像上表现不佳,因为LQ图像存在像素化、失焦模糊和运动模糊等伪影。这些伪影不仅对外部生物特征属性(如姿势、体型等)引入噪声,还会破坏模型的内部特征表示。模型通常将LQ图像特征聚集在一起,难以区分,导致错误的匹配。我们提出了一种新的框架——低质量鲁棒性(RLQ),以提高CC-ReID模型在真实世界数据上的性能。RLQ依赖于粗粒度属性预测(CAP)和任务无关蒸馏(TAD),并在一种新颖的训练机制中交替运行。CAP通过粗略预测来丰富模型与外部细粒度属性的关联,从而减少噪声输入的影响。另一方面,TAD通过任务无关的自监督和蒸馏,利用外部数据集来弥合HQ和LQ特征之间的差距,从而增强模型的内部特征表示。在LaST和DeepChange等真实世界数据集上,RLQ的Top-1准确率优于现有方法1.6%-2.9%,在PRCC上表现出5.3%-6%的持续提升,并在LTCC上具有竞争力的性能。代码即将公开。

🔬 方法详解

问题定义:论文旨在解决真实场景下服饰变换行人重识别(CC-ReID)在低质量图像上的性能瓶颈。现有方法在处理包含像素化、模糊等伪影的低质量图像时,特征表示容易受到噪声干扰,导致识别精度显著下降。现有方法未能有效区分低质量图像的细微差异,导致聚类效果差,匹配错误率高。

核心思路:论文的核心思路是通过引入外部知识和增强内部特征表示来提高模型对低质量图像的鲁棒性。具体而言,利用粗粒度属性预测(CAP)来显式地建模外部属性信息,减少噪声的影响;利用任务无关蒸馏(TAD)来弥合高质量和低质量图像特征之间的差距,提升特征表示的泛化能力。

技术框架:RLQ框架包含两个主要模块:粗粒度属性预测(CAP)和任务无关蒸馏(TAD)。这两个模块在新颖的训练机制中交替运行。CAP模块利用额外的属性信息来指导特征学习,TAD模块利用外部数据集进行自监督学习和知识蒸馏,从而提升模型对低质量图像的鲁棒性。整体流程是先利用CAP进行属性预测,然后利用TAD进行特征蒸馏,交替迭代优化。

关键创新:论文的关键创新在于将粗粒度属性预测和任务无关蒸馏相结合,用于解决低质量图像上的服饰变换ReID问题。CAP模块通过引入外部属性信息来减少噪声的影响,TAD模块通过利用外部数据集进行自监督学习和知识蒸馏来提升特征表示的泛化能力。这种结合方式能够有效地提高模型对低质量图像的鲁棒性。

关键设计:CAP模块的关键设计在于如何选择合适的粗粒度属性以及如何将属性信息融入到特征学习过程中。TAD模块的关键设计在于如何选择合适的外部数据集以及如何设计自监督学习任务和蒸馏策略。具体的损失函数和网络结构细节在论文中未详细说明,属于未知信息。

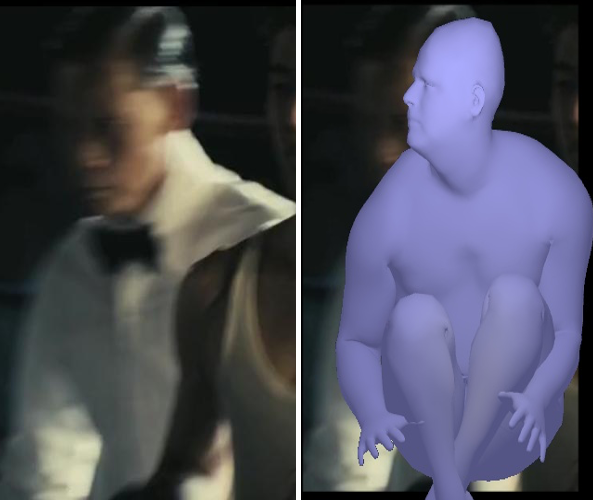

🖼️ 关键图片

📊 实验亮点

RLQ框架在LaST和DeepChange等真实世界数据集上,Top-1准确率优于现有方法1.6%-2.9%,在PRCC数据集上表现出5.3%-6%的持续提升,并在LTCC数据集上具有竞争力的性能。这些结果表明,RLQ框架能够有效地提高模型在真实场景下,尤其是在低质量图像上的服饰变换ReID性能。

🎯 应用场景

该研究成果可应用于智能安防、智慧零售等领域,例如在监控视频中识别穿着不同服装的嫌疑人,或在商场中追踪顾客的购物行为。通过提高低质量图像上的ReID精度,可以扩展ReID技术的应用范围,提升实际应用价值,并为未来的智能监控系统提供更可靠的技术支持。

📄 摘要(原文)

This work focuses on Clothes Changing Re-IDentification (CC-ReID) for the real world. Existing works perform well with high-quality (HQ) images, but struggle with low-quality (LQ) where we can have artifacts like pixelation, out-of-focus blur, and motion blur. These artifacts introduce noise to not only external biometric attributes (e.g. pose, body shape, etc.) but also corrupt the model's internal feature representation. Models usually cluster LQ image features together, making it difficult to distinguish between them, leading to incorrect matches. We propose a novel framework Robustness against Low-Quality (RLQ) to improve CC-ReID model on real-world data. RLQ relies on Coarse Attributes Prediction (CAP) and Task Agnostic Distillation (TAD) operating in alternate steps in a novel training mechanism. CAP enriches the model with external fine-grained attributes via coarse predictions, thereby reducing the effect of noisy inputs. On the other hand, TAD enhances the model's internal feature representation by bridging the gap between HQ and LQ features, via an external dataset through task-agnostic self-supervision and distillation. RLQ outperforms the existing approaches by 1.6%-2.9% Top-1 on real-world datasets like LaST, and DeepChange, while showing consistent improvement of 5.3%-6% Top-1 on PRCC with competitive performance on LTCC. The code will be made public soon.