A Survey of 3D Reconstruction with Event Cameras

作者: Chuanzhi Xu, Haoxian Zhou, Langyi Chen, Haodong Chen, Zeke Zexi Hu, Zhicheng Lu, Ying Zhou, Vera Chung, Qiang Qu, Weidong Cai

分类: cs.CV, cs.AI

发布日期: 2025-05-13 (更新: 2025-12-22)

备注: This survey has been accepted for publication in the Computational Visual Media Journal

💡 一句话要点

首个事件相机三维重建综述,系统梳理方法并展望未来方向。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事件相机 三维重建 深度学习 神经渲染 立体视觉

📋 核心要点

- 传统相机在高速、低光照等场景下三维重建效果差,事件相机数据稀疏但时间分辨率高,更具优势。

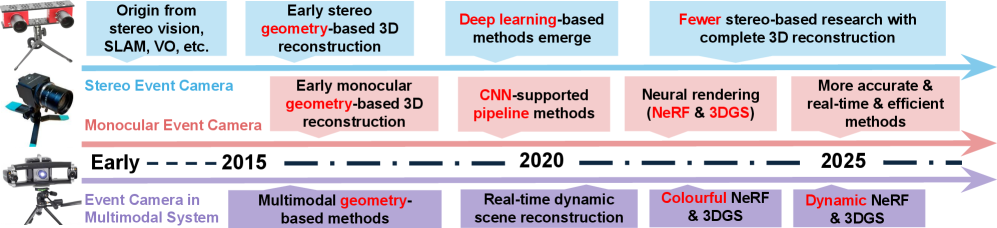

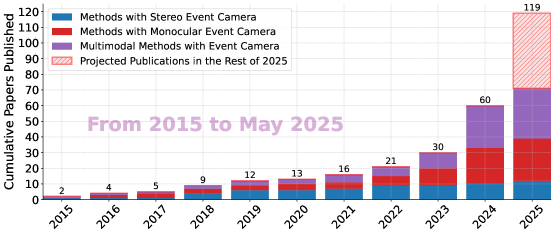

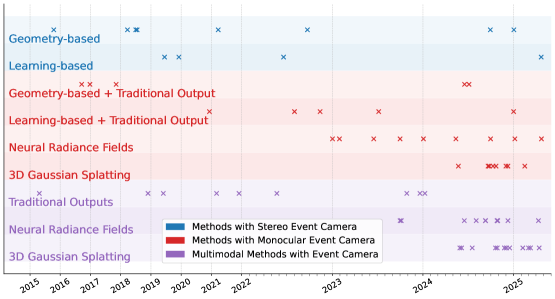

- 论文对基于事件相机的三维重建方法进行系统分类,包括立体、单目和多模态,以及几何、深度学习和神经渲染等。

- 总结了公开数据集,并指出了数据集、评估、表示和动态场景重建等方面的挑战和未来研究方向。

📝 摘要(中文)

本文对基于事件相机的三维重建技术进行了首次全面综述。事件相机能够异步捕获每个像素的亮度变化,与传统相机相比,即使在高速运动、低照度、高动态范围等挑战性条件下,也能产生稀疏但时间密度高的数据流,从而实现鲁棒和精确的三维重建。这种能力为自动驾驶、机器人、空中导航和沉浸式虚拟现实等领域的变革性应用提供了巨大的潜力。本文根据输入模态将现有方法系统地分为立体视觉、单目视觉和多模态系统,并根据重建方法进一步分类,包括基于几何的技术、深度学习方法以及神经渲染技术,如神经辐射场(NeRF)和3D高斯溅射(3DGS)。在每个类别中,方法按时间顺序组织,以突出关键概念和进展的演变。此外,我们还详细总结了专门适用于基于事件重建任务的公开数据集。最后,我们讨论了数据集可用性、标准化评估、有效表示和动态场景重建方面的重大开放挑战,概述了未来研究的有见地的方向。本综述旨在作为重要的参考,并为推进事件驱动三维重建的最新技术水平提供清晰而有力的路线图。

🔬 方法详解

问题定义:传统相机在高速运动、低光照和高动态范围等场景下进行三维重建时面临诸多挑战,例如运动模糊、曝光不足或过度曝光等。事件相机通过异步捕获像素级别的亮度变化,生成时间分辨率极高的数据流,从而克服了传统相机的局限性。然而,如何有效地利用事件相机的稀疏数据进行精确的三维重建仍然是一个难题。现有方法在处理动态场景、缺乏标准化评估以及数据表示方面存在不足。

核心思路:本文的核心思路是对现有的基于事件相机的三维重建方法进行系统性的梳理和分类,并分析其优缺点。通过对不同输入模态(立体、单目、多模态)和重建方法(几何、深度学习、神经渲染)进行归纳,旨在为研究人员提供一个全面的参考框架,并指出未来的研究方向。

技术框架:本文的整体框架主要包括以下几个部分:1) 介绍事件相机的基本原理和优势;2) 根据输入模态对现有方法进行分类,包括立体视觉、单目视觉和多模态系统;3) 根据重建方法对现有方法进行分类,包括基于几何的技术、深度学习方法和神经渲染技术(NeRF、3DGS);4) 总结公开数据集;5) 讨论开放挑战和未来方向。

关键创新:本文的主要创新在于它是首个专门针对事件相机三维重建的全面综述。与以往的综述不同,本文不仅对现有方法进行了分类和总结,还深入分析了各种方法的优缺点,并指出了未来研究的潜在方向。此外,本文还详细总结了公开数据集,为研究人员提供了便利。

关键设计:本文的关键设计在于其分类体系。通过将现有方法按照输入模态和重建方法进行双重分类,可以更清晰地了解不同方法的特点和适用场景。此外,本文还对每种方法的关键技术细节进行了描述,例如使用的损失函数、网络结构等。

🖼️ 关键图片

📊 实验亮点

本文总结了现有事件相机三维重建方法,并对公开数据集进行了整理。通过对不同方法的性能进行比较,指出了现有方法的局限性,并提出了未来研究的潜在方向。例如,在动态场景重建方面,现有方法的鲁棒性仍然有待提高;在标准化评估方面,缺乏统一的评估指标和数据集;在数据表示方面,如何有效地表示事件数据仍然是一个挑战。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、无人机飞行、虚拟现实等领域。事件相机在这些领域具有独特的优势,例如在高速运动场景下进行精确的三维重建,在低光照环境下进行鲁棒的视觉感知,以及在高动态范围场景下进行清晰的图像捕捉。这些能力将有助于提高系统的安全性、可靠性和智能化水平。

📄 摘要(原文)

Event cameras are rapidly emerging as powerful vision sensors for 3D reconstruction, uniquely capable of asynchronously capturing per-pixel brightness changes. Compared to traditional frame-based cameras, event cameras produce sparse yet temporally dense data streams, enabling robust and accurate 3D reconstruction even under challenging conditions such as high-speed motion, low illumination, and extreme dynamic range scenarios. These capabilities offer substantial promise for transformative applications across various fields, including autonomous driving, robotics, aerial navigation, and immersive virtual reality. In this survey, we present the first comprehensive review exclusively dedicated to event-based 3D reconstruction. Existing approaches are systematically categorised based on input modality into stereo, monocular, and multimodal systems, and further classified according to reconstruction methodologies, including geometry-based techniques, deep learning approaches, and neural rendering techniques such as Neural Radiance Fields (NeRF) and 3D Gaussian Splatting (3DGS). Within each category, methods are chronologically organised to highlight the evolution of key concepts and advancements. Furthermore, we provide a detailed summary of publicly available datasets specifically suited to event-based reconstruction tasks. Finally, we discuss significant open challenges in dataset availability, standardised evaluation, effective representation, and dynamic scene reconstruction, outlining insightful directions for future research. This survey aims to serve as an essential reference and provides a clear and motivating roadmap toward advancing the state of the art in event-driven 3D reconstruction.