Web2Grasp: Learning Functional Grasps from Web Images of Hand-Object Interactions

作者: Hongyi Chen, Yunchao Yao, Yufei Ye, Zhixuan Xu, Homanga Bharadhwaj, Jiashun Wang, Shubham Tulsiani, Zackory Erickson, Jeffrey Ichnowski

分类: cs.CV, cs.LG, cs.RO

发布日期: 2025-05-07 (更新: 2025-05-13)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

Web2Grasp:从网络图像学习功能性抓取,提升机器人操作能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱五:交互与反应 (Interaction & Reaction)

关键词: 机器人抓取 功能性抓取 网络图像 人手-物体交互 3D重建

📋 核心要点

- 现有机器人抓取研究主要集中于简单的力量抓取,或依赖昂贵的遥操作机器人演示,缺乏对功能性抓取的有效学习。

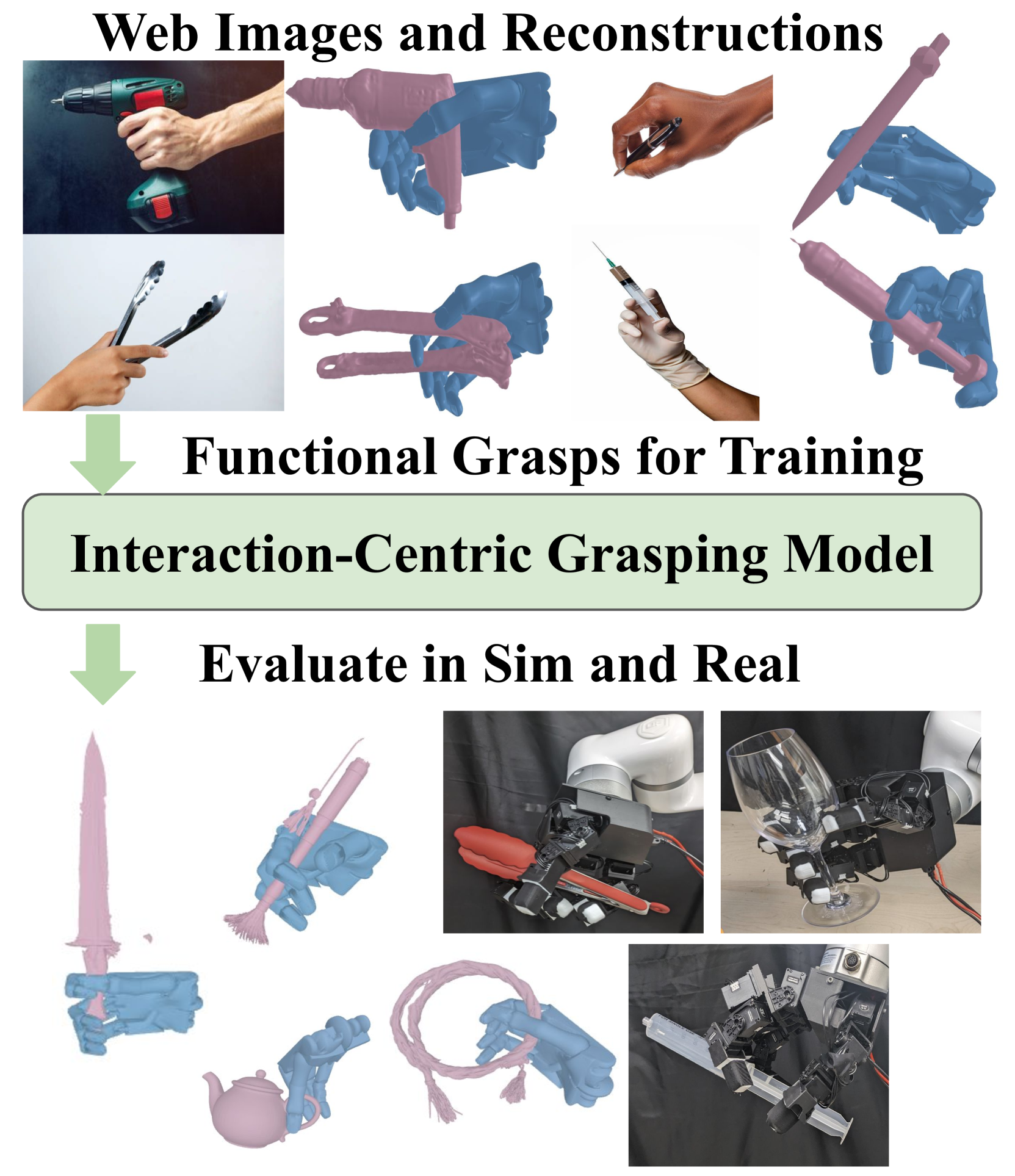

- Web2Grasp从网络图像中提取人手-物体交互信息,通过3D重建、姿态迁移和数据增强,训练机器人学习功能性抓取。

- 实验表明,该方法在模拟和真实机器人上均取得了显著的抓取成功率,尤其是在处理复杂和未见过的物体时。

📝 摘要(中文)

本文提出了一种从网络图像中提取人类抓取信息,用于训练机器人功能性抓取模型的方法。该方法通过重建RGB图像中的人手-物体交互(HOI) 3D网格,将人手姿态迁移到多指机器人手上,并将噪声物体网格与精确的3D形状对齐,从而利用低质量的网络HOI数据训练抓取模型。为了进一步扩充数据集,该方法使用初始训练的抓取策略在IsaacGym模拟器中生成物理上可行的抓取。实验表明,在10个物体类别上训练的模型在9个未见过的物体上取得了良好的抓取效果,在模拟环境中,对于已见物体成功率为75.8%,所有物体成功率为61.8%,相比基线方法,成功率提升了6.7%,功能性评分提高了1.8倍。通过模拟器增强数据,性能从61.8%提升至83.4%。Sim-to-real迁移到LEAP Hand上实现了85%的成功率。

🔬 方法详解

问题定义:现有机器人抓取方法主要集中在力量抓取,即简单地握住物体,而忽略了功能性抓取,即为了实现特定任务而进行的抓取。此外,获取功能性抓取数据通常需要昂贵的遥操作机器人演示,成本高昂且难以扩展。因此,如何低成本地获取功能性抓取数据,并训练机器人进行功能性抓取是一个关键问题。

核心思路:本文的核心思路是从互联网图像中学习人类的功能性抓取。互联网图像包含了大量人类与物体交互的自然场景,这些图像蕴含了丰富的功能性抓取信息。通过从这些图像中提取人手和物体的3D信息,并将人手的抓取姿态迁移到机器人手上,可以有效地训练机器人学习功能性抓取。

技术框架:Web2Grasp的整体框架包含以下几个主要阶段:1) 数据收集与重建:从网络图像中收集包含人手-物体交互的图像,并使用现有的3D重建技术重建人手和物体的3D网格模型。2) 姿态迁移:将重建的人手姿态迁移到多指机器人手上,生成机器人的抓取姿态。3) 物体对齐:将重建的物体网格与精确的3D形状对齐,提高物体模型的准确性。4) 数据增强:使用IsaacGym模拟器,利用初始训练的抓取策略生成更多物理上可行的抓取数据。5) 模型训练:使用收集和增强的数据训练抓取模型。

关键创新:该方法最重要的创新点在于利用互联网图像作为功能性抓取数据的来源。与传统的遥操作机器人演示相比,互联网图像数据获取成本低廉,数据量大,覆盖范围广。此外,该方法还通过3D重建、姿态迁移和数据增强等技术,有效地利用了这些低质量的数据。

关键设计:在数据增强阶段,使用初始训练的抓取策略在IsaacGym模拟器中生成抓取数据,并使用物理引擎进行验证,确保抓取的物理可行性。损失函数的设计考虑了抓取的成功率和功能性,鼓励模型学习能够完成特定任务的抓取姿态。具体的网络结构未知。

🖼️ 关键图片

📊 实验亮点

Web2Grasp在模拟环境中取得了显著的性能提升。在10个已见物体类别上训练的模型,在9个未见过的物体上实现了61.8%的抓取成功率,相比基线方法提升了6.7%,功能性评分提高了1.8倍。通过模拟器增强数据,性能进一步提升至83.4%。Sim-to-real迁移到LEAP Hand上实现了85%的成功率,验证了该方法在真实机器人上的有效性。

🎯 应用场景

该研究成果可广泛应用于机器人操作领域,例如家庭服务机器人、工业机器人和医疗机器人等。通过学习人类的功能性抓取,机器人可以更好地完成各种任务,例如物品整理、工具使用和手术辅助等。该方法降低了机器人抓取学习的成本,加速了机器人智能化进程,具有重要的实际应用价值和广阔的未来发展前景。

📄 摘要(原文)

Functional grasp is essential for enabling dexterous multi-finger robot hands to manipulate objects effectively. However, most prior work either focuses on power grasping, which simply involves holding an object still, or relies on costly teleoperated robot demonstrations to teach robots how to grasp each object functionally. Instead, we propose extracting human grasp information from web images since they depict natural and functional object interactions, thereby bypassing the need for curated demonstrations. We reconstruct human hand-object interaction (HOI) 3D meshes from RGB images, retarget the human hand to multi-finger robot hands, and align the noisy object mesh with its accurate 3D shape. We show that these relatively low-quality HOI data from inexpensive web sources can effectively train a functional grasping model. To further expand the grasp dataset for seen and unseen objects, we use the initially-trained grasping policy with web data in the IsaacGym simulator to generate physically feasible grasps while preserving functionality. We train the grasping model on 10 object categories and evaluate it on 9 unseen objects, including challenging items such as syringes, pens, spray bottles, and tongs, which are underrepresented in existing datasets. The model trained on the web HOI dataset, achieving a 75.8% success rate on seen objects and 61.8% across all objects in simulation, with a 6.7% improvement in success rate and a 1.8x increase in functionality ratings over baselines. Simulator-augmented data further boosts performance from 61.8% to 83.4%. The sim-to-real transfer to the LEAP Hand achieves a 85% success rate. Project website is at: https://web2grasp.github.io/.