ViDRiP-LLaVA: A Dataset and Benchmark for Diagnostic Reasoning from Pathology Videos

作者: Trinh T. L. Vuong, Jin Tae Kwak

分类: cs.CV, cs.AI, cs.CL

发布日期: 2025-05-07 (更新: 2025-10-13)

🔗 代码/项目: GITHUB

💡 一句话要点

ViDRiP-LLaVA:病理视频诊断推理的多模态数据集与基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 病理视频分析 多模态学习 诊断推理 知识迁移 临床决策支持

📋 核心要点

- 现有方法缺乏对病理视频的有效诊断推理能力,限制了AI在临床决策中的辅助作用。

- ViDRiP-LLaVA通过整合多种病理图像场景,并结合思维链教学,提升模型诊断推理能力。

- ViDRiP-LLaVA构建了新的病理视频分析基准,为未来AI辅助临床决策系统奠定基础。

📝 摘要(中文)

本文提出了ViDRiP-LLaVA,这是计算病理学中首个大型多模态模型(LMM),它整合了三种不同的图像场景:单张病理切片图像、自动分割的病理视频片段和手动分割的病理视频。这种整合紧密地模拟了病理学家的自然诊断过程。通过生成详细的组织学描述并最终得出明确的诊断结果,ViDRiP-LLaVA将视觉叙事与诊断推理联系起来。该方法的核心是ViDRiP-Instruct数据集,它包含4278个视频和诊断相关的思维链教学对,这些数据来源于YouTube上的教育性组织病理学视频。为了克服高质量数据创建耗时且数量有限的挑战,本文将知识从现有的单图像指令数据集迁移到弱标注的关键帧提取片段上进行训练,然后对人工分割的视频进行微调。ViDRiP-LLaVA在病理视频分析中建立了一个新的基准,并为未来通过整合视觉和诊断推理来支持临床决策的人工智能系统提供了一个有希望的基础。代码、数据和模型已公开。

🔬 方法详解

问题定义:现有计算病理学模型主要集中于单张图像的分析,缺乏对病理视频中时序信息的利用,难以模拟病理学家基于视频进行诊断的自然过程。此外,高质量的病理视频标注数据获取困难,限制了相关模型的发展。

核心思路:本文的核心思路是构建一个包含多种病理图像场景(单张图像、自动分割视频片段、手动分割视频)的大型多模态数据集ViDRiP-Instruct,并利用知识迁移的方法,将单图像数据集的知识迁移到视频数据上,从而训练出具有诊断推理能力的ViDRiP-LLaVA模型。这样设计的目的是为了更贴近病理学家的实际工作流程,并克服数据标注的难题。

技术框架:ViDRiP-LLaVA的整体框架包括以下几个主要阶段:1) 数据收集与处理:从YouTube上收集教育性组织病理学视频,并进行自动和手动分割;2) 数据集构建:构建包含视频和诊断相关的思维链教学对的ViDRiP-Instruct数据集;3) 知识迁移:利用单图像指令数据集进行预训练,然后对弱标注的关键帧提取片段进行训练;4) 微调:在手动分割的视频上进行微调,提升模型性能。

关键创新:该论文的关键创新点在于:1) 提出了首个针对病理视频诊断推理的大型多模态数据集ViDRiP-Instruct;2) 提出了基于知识迁移的训练方法,有效利用了单图像数据集的知识,克服了病理视频数据标注的难题;3) 构建了ViDRiP-LLaVA模型,实现了视觉叙事与诊断推理的结合。与现有方法相比,ViDRiP-LLaVA更贴近病理学家的实际工作流程,并具有更强的诊断推理能力。

关键设计:ViDRiP-Instruct数据集包含4278个视频和诊断相关的思维链教学对。知识迁移过程中,使用了弱标注的关键帧提取片段进行训练,以降低标注成本。微调阶段,使用了手动分割的视频,以提升模型性能。具体的网络结构和损失函数等技术细节在论文中未详细说明,属于未知信息。

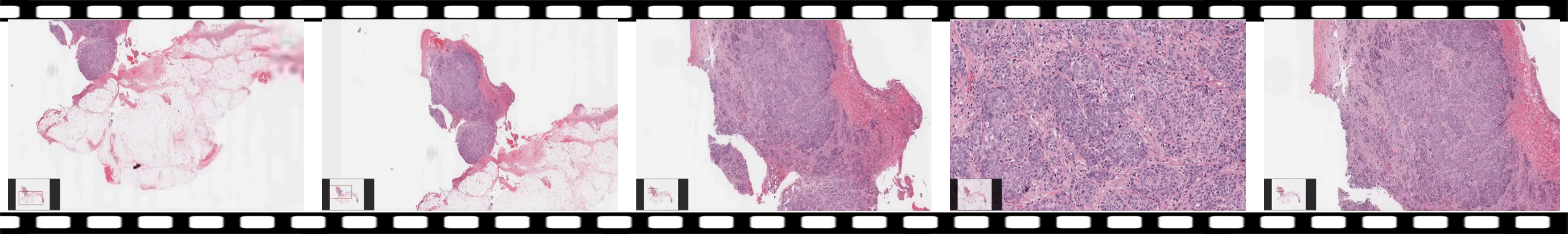

🖼️ 关键图片

📊 实验亮点

ViDRiP-LLaVA在病理视频分析中建立了一个新的基准。虽然论文中没有给出具体的性能数据和对比基线,但它为未来AI系统通过整合视觉和诊断推理来支持临床决策提供了一个有希望的基础。该模型能够生成详细的组织学描述并最终得出明确的诊断结果,展示了其在病理诊断领域的潜力。

🎯 应用场景

ViDRiP-LLaVA在临床诊断、病理学教育和药物研发等领域具有广泛的应用前景。它可以辅助病理学家进行诊断,提高诊断效率和准确性;可以作为教学工具,帮助学生理解病理学知识;可以用于药物研发,加速新药的开发过程。未来,ViDRiP-LLaVA有望成为临床决策支持系统的重要组成部分。

📄 摘要(原文)

We present ViDRiP-LLaVA, the first large multimodal model (LMM) in computational pathology that integrates three distinct image scenarios, including single patch images, automatically segmented pathology video clips, and manually segmented pathology videos. This integration closely mirrors the natural diagnostic process of pathologists. By generating detailed histological descriptions and culminating in a definitive sign-out diagnosis, ViDRiP-LLaVA bridges visual narratives with diagnostic reasoning. Central to our approach is the ViDRiP-Instruct dataset, comprising 4278 video and diagnosis-specific chain-of-thought instructional pairs sourced from educational histopathology videos on YouTube. Although high-quality data is critical for enhancing diagnostic reasoning, its creation is time-intensive and limited in volume. To overcome this challenge, we transfer knowledge from existing single-image instruction datasets to train on weakly annotated, keyframe-extracted clips, followed by fine-tuning on manually segmented videos. ViDRiP-LLaVA establishes a new benchmark in pathology video analysis and offers a promising foundation for future AI systems that support clinical decision-making through integrated visual and diagnostic reasoning. Our code, data, and model are publicly available at: https://github.com/QuIIL/ViDRiP-LLaVA.