OS-W2S: An Automatic Labeling Engine for Language-Guided Open-Set Aerial Object Detection

作者: Guoting Wei, Yu Liu, Xia Yuan, Xizhe Xue, Linlin Guo, Yifan Yang, Chunxia Zhao, Zongwen Bai, Haokui Zhang, Rong Xiao

分类: cs.CV, cs.DB

发布日期: 2025-05-06 (更新: 2025-09-26)

🔗 代码/项目: GITHUB

💡 一句话要点

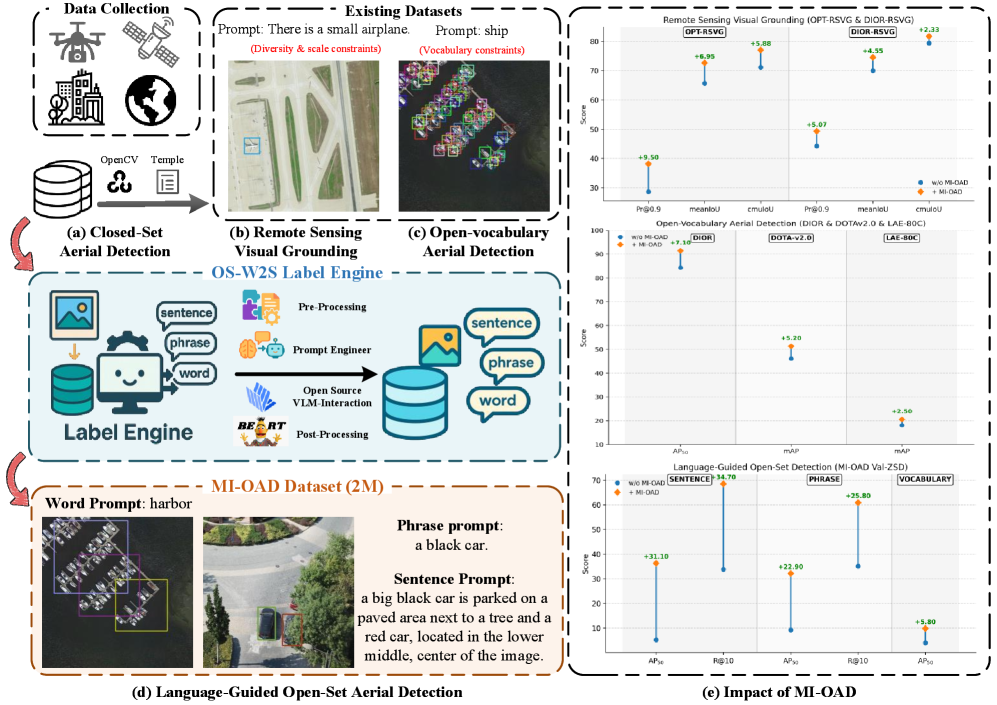

提出OS-W2S自动标注引擎,构建大规模语言引导的开放集航拍目标检测数据集MI-OAD。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 航拍目标检测 语言引导 开放集学习 自动标注 视觉-语言模型

📋 核心要点

- 现有语言引导的航拍目标检测数据集规模有限,且主要集中在词汇级别描述,无法满足细粒度开放世界检测需求。

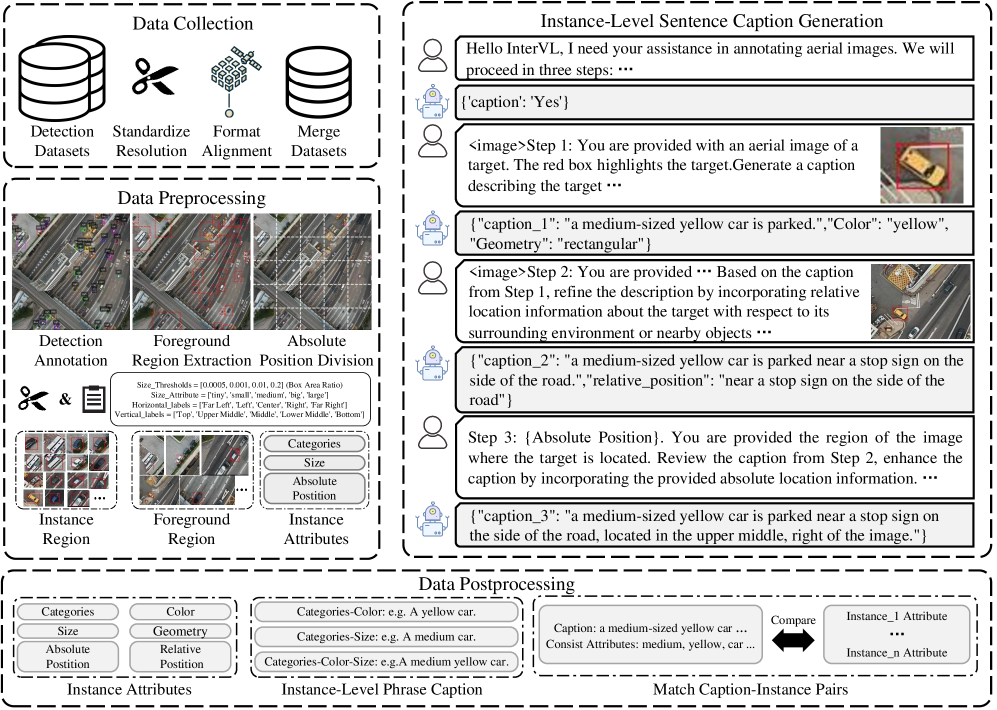

- 提出OS-W2S自动标注引擎,结合图像操作预处理和BERT后处理,高效生成大规模、多层次语言引导的航拍图像标注。

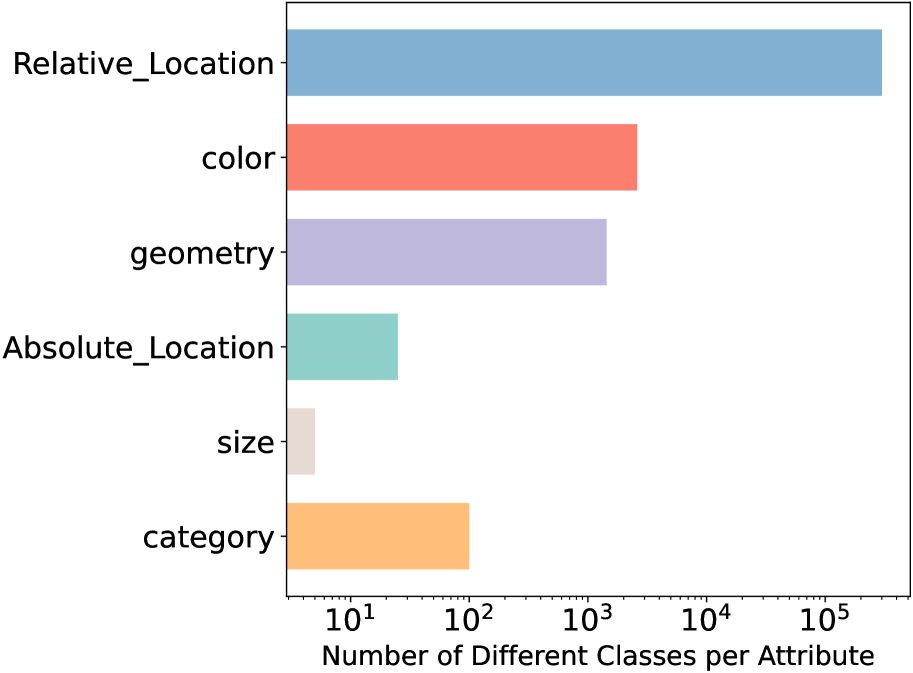

- 构建了包含16万余张图像和200万图像-文本对的MI-OAD数据集,并在多个任务上验证了其有效性和标注质量。

📝 摘要(中文)

近年来,语言引导的开放集航拍目标检测因其更符合实际应用需求而备受关注。然而,由于数据集的限制,现有方法主要集中在词汇级别的描述,无法满足细粒度的开放世界检测需求。为了解决这一问题,我们提出构建一个大规模的语言引导开放集航拍检测数据集,涵盖从词到短语再到句子的三个语言引导级别。我们提出了OS-W2S标签引擎,这是一个基于开源大型视觉-语言模型,并结合基于图像操作的预处理和基于BERT的后处理的自动标注流程,能够处理航拍图像的各种场景标注。利用该标签引擎,我们使用丰富的文本标注扩展了现有的航拍检测数据集,并构建了一个名为MI-OAD的新基准数据集,解决了当前遥感 grounding 数据的局限性,并实现了有效的语言引导开放集航拍检测。MI-OAD包含163,023张图像和200万个图像-标题对,大约是同类数据集的40倍。为了证明MI-OAD的有效性和质量,我们评估了三个代表性任务。在语言引导的开放集航拍检测中,在MI-OAD上训练使Grounding DINO在零样本迁移下,句子级别输入时AP$_{50}$提升+31.1,Recall@10提升+34.7。此外,使用MI-OAD进行预训练在多个现有的开放词汇航拍检测和遥感视觉 grounding 基准测试中产生了最先进的性能,验证了数据集的有效性和OS-W2S标注的高质量。

🔬 方法详解

问题定义:现有语言引导的航拍目标检测方法受限于数据集规模和标注粒度,难以实现细粒度的开放世界目标检测。现有数据集主要集中在词汇级别的描述,缺乏短语和句子级别的语义信息,限制了模型对复杂场景的理解和泛化能力。

核心思路:论文的核心思路是构建一个大规模、多层次语言引导的航拍目标检测数据集MI-OAD,并提出一个自动标注引擎OS-W2S来高效生成高质量的标注。通过引入图像操作预处理和BERT后处理,OS-W2S能够处理各种复杂的航拍场景,并生成词、短语和句子级别的文本描述。

技术框架:OS-W2S标签引擎的整体框架包含以下几个主要模块:1) 基于图像操作的预处理模块,用于增强图像的多样性,例如旋转、缩放、裁剪等;2) 基于开源大型视觉-语言模型(例如CLIP)的图像特征提取模块,用于提取图像的视觉特征;3) 基于BERT的后处理模块,用于生成高质量的文本描述,包括词、短语和句子级别;4) 数据过滤和清洗模块,用于去除低质量的标注数据。

关键创新:论文的关键创新在于提出了OS-W2S自动标注引擎,该引擎能够高效地生成大规模、多层次语言引导的航拍图像标注。与传统的人工标注方法相比,OS-W2S能够显著降低标注成本,并提高标注效率。此外,MI-OAD数据集的构建也为语言引导的开放集航拍目标检测研究提供了新的基准。

关键设计:OS-W2S的关键设计包括:1) 图像操作预处理的多样性,例如随机旋转角度、缩放比例等;2) BERT后处理模块的微调策略,例如使用特定的损失函数和优化器;3) 数据过滤和清洗模块的阈值设置,例如设定图像质量和文本描述的相关性阈值。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在MI-OAD数据集上训练的Grounding DINO模型,在零样本迁移到语言引导的开放集航拍目标检测任务中,句子级别输入时AP$_{50}$提升了31.1%,Recall@10提升了34.7%。此外,使用MI-OAD进行预训练的模型在多个现有开放词汇航拍检测和遥感视觉 grounding 基准测试中取得了state-of-the-art的性能。

🎯 应用场景

该研究成果可广泛应用于智慧城市、环境监测、灾害预警等领域。通过语言引导的航拍目标检测,可以实现对特定目标的快速定位和识别,例如搜索特定类型的车辆、建筑物或植被,从而提高城市管理效率,辅助环境监测和灾害救援工作。

📄 摘要(原文)

In recent years, language-guided open-set aerial object detection has gained significant attention due to its better alignment with real-world application needs. However, due to limited datasets, most existing language-guided methods primarily focus on vocabulary-level descriptions, which fail to meet the demands of fine-grained open-world detection. To address this limitation, we propose constructing a large-scale language-guided open-set aerial detection dataset, encompassing three levels of language guidance: from words to phrases, and ultimately to sentences. Centered around an open-source large vision-language model and integrating image-operation-based preprocessing with BERT-based postprocessing, we present the OS-W2S Label Engine, an automatic annotation pipeline capable of handling diverse scene annotations for aerial images. Using this label engine, we expand existing aerial detection datasets with rich textual annotations and construct a novel benchmark dataset, called MI-OAD, addressing the limitations of current remote sensing grounding data and enabling effective language-guided open-set aerial detection. Specifically, MI-OAD contains 163,023 images and 2 million image-caption pairs, approximately 40 times larger than comparable datasets. To demonstrate the effectiveness and quality of MI-OAD, we evaluate three representative tasks. On language-guided open-set aerial detection, training on MI-OAD lifts Grounding DINO by +31.1 AP$_{50}$ and +34.7 Recall@10 with sentence-level inputs under zero-shot transfer. Moreover, using MI-OAD for pre-training yields state-of-the-art performance on multiple existing open-vocabulary aerial detection and remote sensing visual grounding benchmarks, validating both the effectiveness of the dataset and the high quality of its OS-W2S annotations. More details are available at https://github.com/GT-Wei/MI-OAD.