Sparfels: Fast Reconstruction from Sparse Unposed Imagery

作者: Shubhendu Jena, Amine Ouasfi, Mae Younes, Adnane Boukhayma

分类: cs.CV

发布日期: 2025-05-04 (更新: 2025-07-31)

备注: ICCV 2025. Project page : https://shubhendu-jena.github.io/Sparfels-web/

💡 一句话要点

提出Sparfels,利用3D基础模型快速重建稀疏无姿态图像

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 三维重建 稀疏视图 无姿态图像 高斯溅射 3D基础模型

📋 核心要点

- 现有方法在稀疏无姿态图像重建中,形状恢复效果不佳,且计算效率较低,难以满足实际应用需求。

- 利用3D基础模型的先验知识,结合2D高斯溅射(2DGS)技术,通过优化颜色方差来提升形状重建的准确性。

- 实验表明,该方法在稀疏无姿态图像重建和新视角合成任务上,取得了优于现有技术的性能。

📝 摘要(中文)

本文提出了一种基于表面元素splatting的稀疏视图重建方法,该方法可以在消费级GPU上在3分钟内运行。虽然有一些方法解决了来自噪声或无姿态稀疏相机的稀疏辐射场学习问题,但在此设置中,形状恢复仍然相对未被探索。一些辐射和形状学习的测试时优化方法通过学习数据先验或使用外部单目几何先验的组合来解决稀疏姿态设置。不同的是,我们提出了一个高效而简单的pipeline,利用了一个最新的3D基础模型。我们利用它的各种任务头,特别是点图和相机初始化,来实例化一个bundle adjusting 2D Gaussian Splatting (2DGS)模型,并利用图像对应关系来指导2DGS训练中的相机优化。我们贡献的关键是一种新的沿光线splatted颜色方差的公式,可以有效地计算。在训练中减少这种矩可以得到更准确的形状重建。我们在基于已建立的多视图数据集的重建和新视角合成基准测试中,展示了在稀疏未校准设置下的最先进性能。

🔬 方法详解

问题定义:论文旨在解决从稀疏的、未标定姿态的图像中进行快速且准确的三维重建问题。现有方法在处理这种具有挑战性的场景时,通常面临形状恢复不准确、计算效率低下的问题,难以在消费级硬件上实现实时重建。

核心思路:论文的核心思路是利用预训练的3D基础模型提供的先验知识,结合2D高斯溅射(2DGS)技术,通过优化splatted颜色方差来提升形状重建的准确性。这种方法旨在克服传统方法对初始姿态估计的依赖,并提高重建速度。

技术框架:整体流程包括以下几个主要阶段:1) 利用3D基础模型进行相机初始化和点云生成;2) 构建基于2DGS的场景表示;3) 利用图像对应关系和提出的颜色方差损失函数进行相机姿态优化和2DGS参数优化。该框架将3D基础模型的全局先验知识与2DGS的局部优化能力相结合。

关键创新:论文的关键创新在于提出了一个新颖的splatted颜色方差公式,用于指导相机姿态优化和形状重建。通过最小化沿光线的颜色方差,可以有效地减少重建过程中的模糊和噪声,从而提高形状的准确性。

关键设计:论文的关键设计包括:1) 使用预训练的3D基础模型(具体模型未知)来初始化相机姿态和生成初始点云;2) 采用bundle adjusting 2DGS模型进行场景表示;3) 设计了基于splatted颜色方差的损失函数,用于优化相机姿态和2DGS参数。具体参数设置和网络结构细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

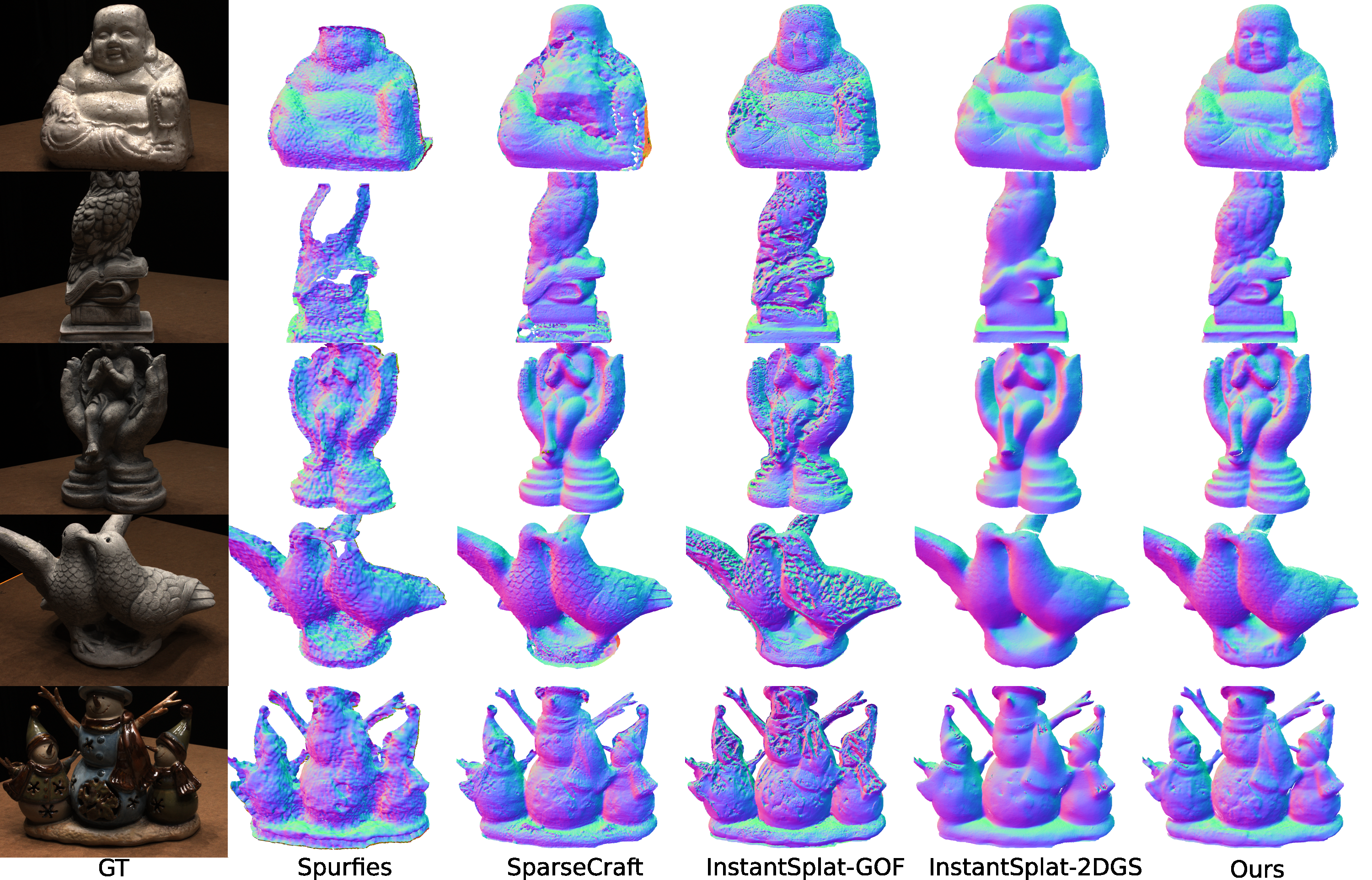

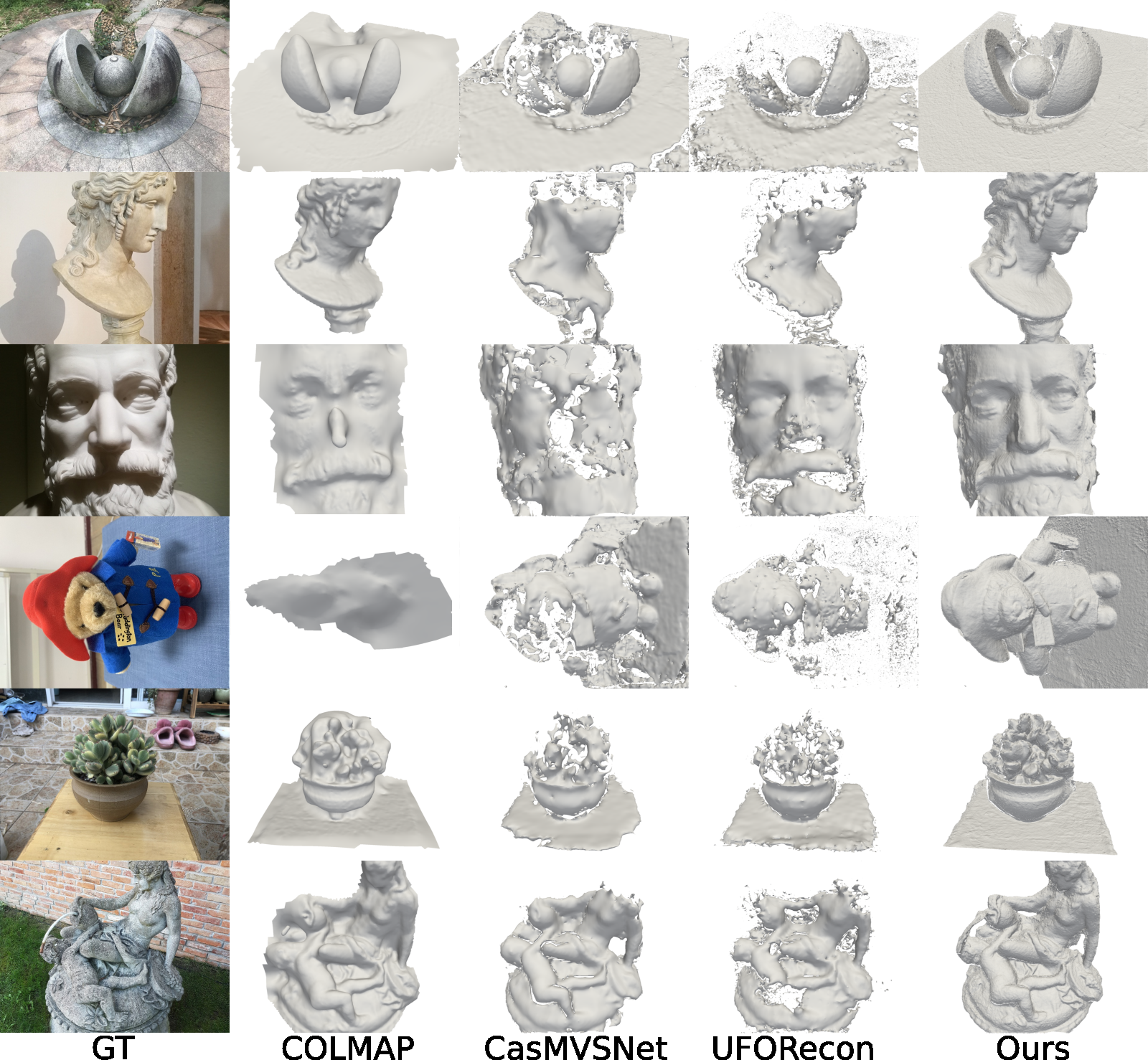

📊 实验亮点

该方法在稀疏无姿态图像重建任务上取得了state-of-the-art的性能。具体而言,在重建质量和新视角合成方面,该方法优于现有的稀疏重建方法。更重要的是,该方法能够在消费级GPU上在3分钟内完成重建,显著提高了重建效率。

🎯 应用场景

该研究成果可应用于机器人导航、增强现实、虚拟现实、自动驾驶等领域。在这些场景中,快速且准确的三维重建对于环境感知和交互至关重要。该方法能够处理稀疏和无姿态的图像数据,降低了对传感器配置和标定精度的要求,具有广泛的应用前景。

📄 摘要(原文)

We present a method for Sparse view reconstruction with surface element splatting that runs within 3 minutes on a consumer grade GPU. While few methods address sparse radiance field learning from noisy or unposed sparse cameras, shape recovery remains relatively underexplored in this setting. Several radiance and shape learning test-time optimization methods address the sparse posed setting by learning data priors or using combinations of external monocular geometry priors. Differently, we propose an efficient and simple pipeline harnessing a single recent 3D foundation model. We leverage its various task heads, notably point maps and camera initializations to instantiate a bundle adjusting 2D Gaussian Splatting (2DGS) model, and image correspondences to guide camera optimization midst 2DGS training. Key to our contribution is a novel formulation of splatted color variance along rays, which can be computed efficiently. Reducing this moment in training leads to more accurate shape reconstructions. We demonstrate state-of-the-art performances in the sparse uncalibrated setting in reconstruction and novel view benchmarks based on established multi-view datasets.