GarmentDiffusion: 3D Garment Sewing Pattern Generation with Multimodal Diffusion Transformers

作者: Xinyu Li, Qi Yao, Yuanda Wang

分类: cs.CV, cs.AI

发布日期: 2025-04-30 (更新: 2025-09-22)

备注: The 34th International Joint Conference on Artificial Intelligence (IJCAI 2025)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

GarmentDiffusion:基于多模态扩散Transformer的3D服装缝纫纸样生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 服装纸样生成 扩散模型 Transformer 多模态学习 3D服装 边缘token表示 服装设计

📋 核心要点

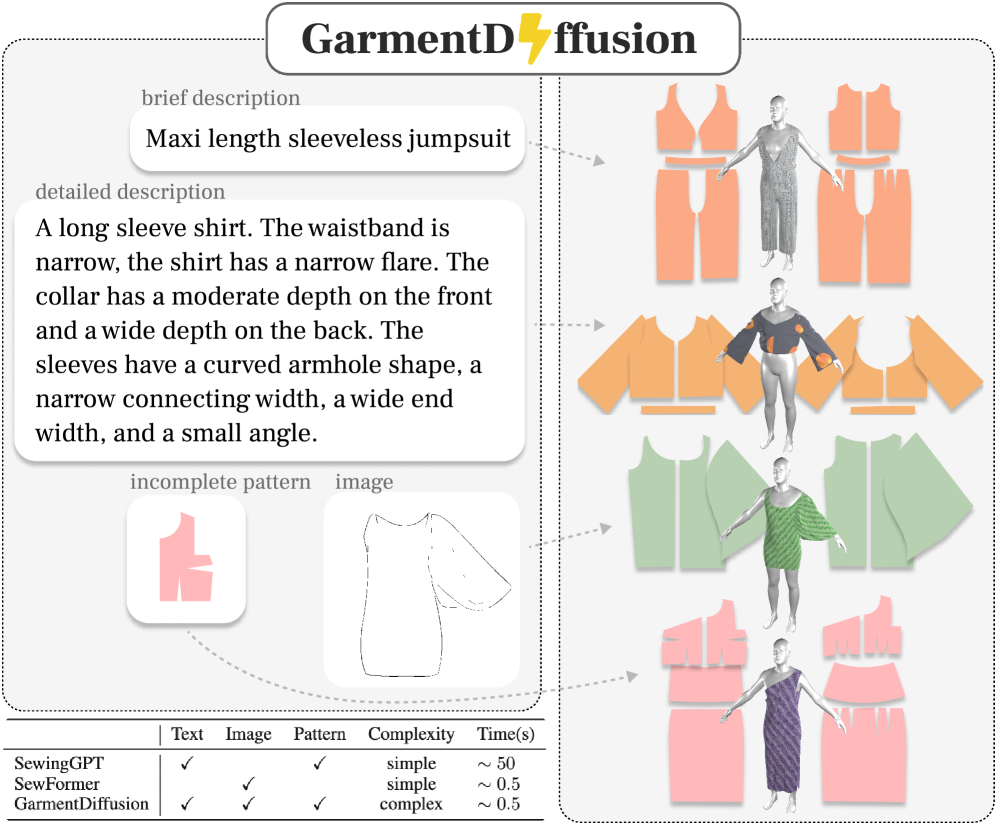

- 现有服装纸样生成方法依赖单一输入模态或生成效率低下,限制了多样化服装的创造。

- GarmentDiffusion通过扩散Transformer同时去噪所有边缘token,并采用紧凑的边缘token表示,提高了生成效率。

- 实验表明,GarmentDiffusion在DressCodeData和GarmentCodeData上均取得了state-of-the-art结果,生成速度提升显著。

📝 摘要(中文)

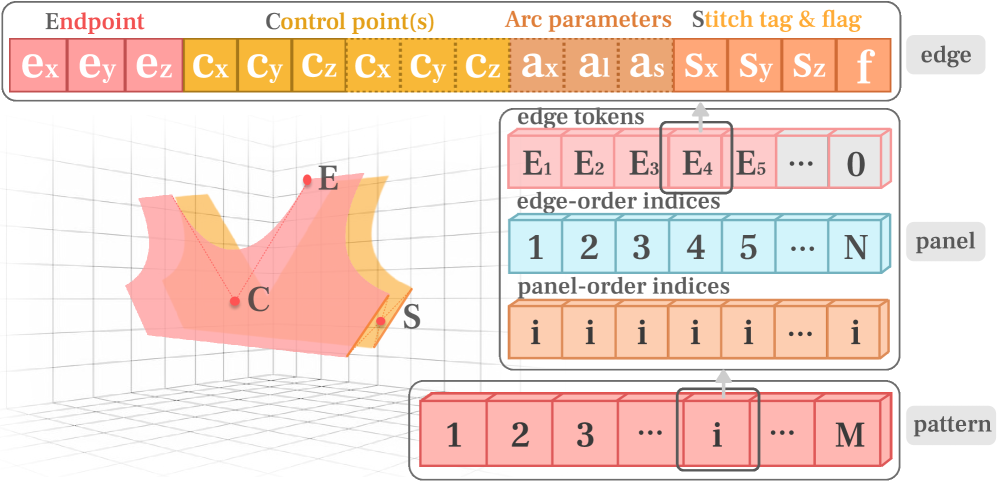

本文提出GarmentDiffusion,一种新型生成模型,能够从多模态输入(文本、图像和不完整的缝纫纸样)生成厘米级精度、矢量化的3D缝纫纸样。该方法将3D缝纫纸样参数高效地编码为紧凑的边缘token表示,实现的序列长度比DressCode中的自回归SewingGPT短10倍。通过采用扩散Transformer,模型沿时间轴同时对所有边缘token进行去噪,而无需考虑数据集特定的边缘和面板统计信息,保持恒定的去噪步骤数。与SewingGPT相比,该模型的所有设计组合使缝纫纸样生成速度提高了100倍。在DressCodeData以及最大的缝纫纸样数据集GarmentCodeData上,均取得了新的state-of-the-art结果。

🔬 方法详解

问题定义:现有服装纸样生成方法主要存在两个痛点:一是依赖单一模态的输入(例如仅文本或仅图像),无法充分利用多模态信息进行更灵活的设计;二是生成效率较低,特别是对于复杂的服装纸样,生成速度难以满足实际应用需求。SewingGPT虽然在一定程度上解决了生成问题,但其自回归的生成方式导致序列长度较长,效率仍然有待提升。

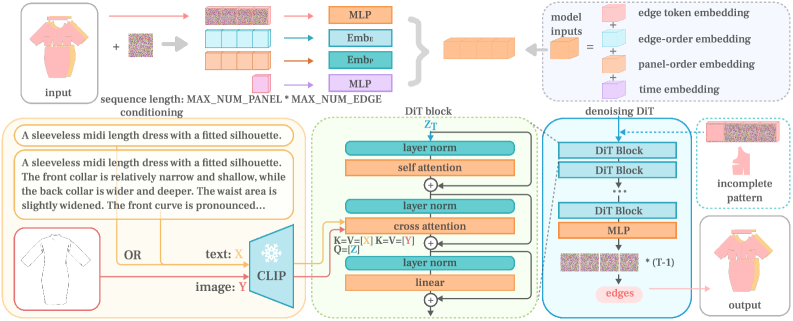

核心思路:GarmentDiffusion的核心思路是利用扩散模型强大的生成能力,并结合Transformer架构对服装纸样进行建模。通过将服装纸样参数编码为紧凑的边缘token表示,显著缩短了序列长度,从而提高了生成效率。同时,采用多模态输入,允许模型从文本、图像和不完整的纸样中学习,实现更灵活的控制。

技术框架:GarmentDiffusion的整体框架包括以下几个主要模块:1) 多模态编码器:用于提取文本、图像和不完整纸样的特征表示;2) 边缘token编码器:将3D缝纫纸样参数编码为紧凑的边缘token序列;3) 扩散Transformer:作为核心生成模块,通过扩散过程对边缘token进行去噪,生成完整的纸样;4) 边缘token解码器:将生成的边缘token序列解码为3D缝纫纸样参数。整个流程首先将多模态输入编码为特征向量,然后利用扩散Transformer逐步生成纸样的边缘token,最后解码得到完整的3D缝纫纸样。

关键创新:GarmentDiffusion的关键创新在于以下几个方面:1) 提出了基于边缘token的纸样表示方法,有效缩短了序列长度,提高了生成效率;2) 采用了扩散Transformer架构,能够同时对所有边缘token进行去噪,避免了自回归生成方式的效率瓶颈;3) 支持多模态输入,允许模型从文本、图像和不完整的纸样中学习,提高了生成的灵活性和可控性。与SewingGPT相比,GarmentDiffusion在生成速度和精度上均有显著提升。

关键设计:在边缘token编码方面,论文设计了一种紧凑的表示方法,将纸样的几何信息和连接关系编码为一系列token。在扩散Transformer方面,采用了标准的Transformer架构,并针对纸样生成的特点进行了优化,例如调整了注意力机制的权重,以更好地捕捉边缘之间的依赖关系。损失函数方面,采用了标准的扩散模型损失函数,并加入了一些正则化项,以提高生成纸样的质量。

🖼️ 关键图片

📊 实验亮点

GarmentDiffusion在DressCodeData和GarmentCodeData两个数据集上均取得了state-of-the-art的结果。与SewingGPT相比,GarmentDiffusion的生成速度提高了100倍,同时保持了厘米级的精度。实验结果表明,GarmentDiffusion能够生成高质量、多样化的服装纸样,具有很强的实用价值。

🎯 应用场景

GarmentDiffusion具有广泛的应用前景,例如服装设计辅助工具、虚拟试衣、定制服装生产等。它可以帮助设计师快速生成各种款式的服装纸样,提高设计效率和创造力。同时,也可以用于生成个性化的定制服装,满足消费者的个性化需求。未来,该技术有望应用于服装行业的各个环节,推动服装产业的智能化和数字化转型。

📄 摘要(原文)

Garment sewing patterns are fundamental design elements that bridge the gap between design concepts and practical manufacturing. The generative modeling of sewing patterns is crucial for creating diversified garments. However, existing approaches are limited either by reliance on a single input modality or by suboptimal generation efficiency. In this work, we present GarmentDiffusion, a new generative model capable of producing centimeter-precise, vectorized 3D sewing patterns from multimodal inputs (text, image, and incomplete sewing pattern). Our method efficiently encodes 3D sewing pattern parameters into compact edge token representations, achieving a sequence length that is 10 times shorter than that of the autoregressive SewingGPT in DressCode. By employing a diffusion transformer, we simultaneously denoise all edge tokens along the temporal axis, while maintaining a constant number of denoising steps regardless of dataset-specific edge and panel statistics. With all combination of designs of our model, the sewing pattern generation speed is accelerated by 100 times compared to SewingGPT. We achieve new state-of-the-art results on DressCodeData, as well as on the largest sewing pattern dataset, namely GarmentCodeData. The project website is available at https://shenfu-research.github.io/Garment-Diffusion/.