DeepAndes: A Self-Supervised Vision Foundation Model for Multi-Spectral Remote Sensing Imagery of the Andes

作者: Junlin Guo, James R. Zimmer-Dauphinee, Jordan M. Nieusma, Siqi Lu, Quan Liu, Ruining Deng, Can Cui, Jialin Yue, Yizhe Lin, Tianyuan Yao, Juming Xiong, Junchao Zhu, Chongyu Qu, Yuechen Yang, Mitchell Wilkes, Xiao Wang, Parker VanValkenburgh, Steven A. Wernke, Yuankai Huo

分类: cs.CV

发布日期: 2025-04-28 (更新: 2025-11-09)

期刊: 10.1109/JSTARS.2025.3619423

🔗 代码/项目: GITHUB

💡 一句话要点

DeepAndes:面向安第斯山脉多光谱遥感影像的自监督视觉基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感影像 自监督学习 视觉基础模型 多光谱数据 考古学 Transformer DINOv2

📋 核心要点

- 传统监督学习方法难以标注大规模精细考古特征,限制了遥感技术在考古领域的应用。

- DeepAndes 采用定制的 DINOv2 自监督学习算法,针对安第斯山脉的 8 波段多光谱遥感影像进行优化。

- 实验表明,DeepAndes 在少样本学习中显著优于其他模型,验证了大规模自监督预训练的有效性。

📝 摘要(中文)

考古学家通过遥感数据进行大规模的遗址测绘,能够深入了解长期人口趋势、区域间社会网络以及过去对气候变化的适应情况。遥感调查是对实地考察的补充,结合深度学习和计算机视觉技术,其作用将更加显著。然而,传统的监督深度学习方法在对大规模精细考古特征进行标注时面临挑战。虽然最近的视觉基础模型在学习大规模遥感数据方面表现出色,但大多数现成的解决方案是为RGB图像设计的,而不是为多光谱卫星图像设计的,例如我们研究中使用的8波段数据。本文介绍了DeepAndes,一个基于Transformer的视觉基础模型,在三百万张多光谱卫星图像上进行训练,专门为安第斯考古学量身定制。DeepAndes 结合了一种定制的 DINOv2 自监督学习算法,该算法针对 8 波段多光谱图像进行了优化,标志着第一个专门为安第斯地区设计的的基础模型。我们通过不平衡图像分类、图像实例检索和像素级语义分割任务评估了其图像理解性能。实验表明,DeepAndes 在少样本学习场景中实现了卓越的 F1 分数、平均精度均值和 Dice 分数,显著优于从头开始训练或在较小数据集上预训练的模型。这突出了大规模自监督预训练在考古遥感中的有效性。

🔬 方法详解

问题定义:论文旨在解决考古遥感领域中,针对安第斯山脉地区多光谱遥感影像,缺乏有效的基础模型的问题。现有方法,特别是为RGB图像设计的模型,无法充分利用多光谱信息的优势,且标注考古特征的成本高昂。

核心思路:论文的核心思路是利用自监督学习,在大规模未标注的多光谱遥感影像上预训练一个通用的视觉基础模型。该模型能够学习到安第斯山脉地区遥感影像的丰富特征表示,从而在下游任务中实现更好的性能,尤其是在少样本学习场景下。

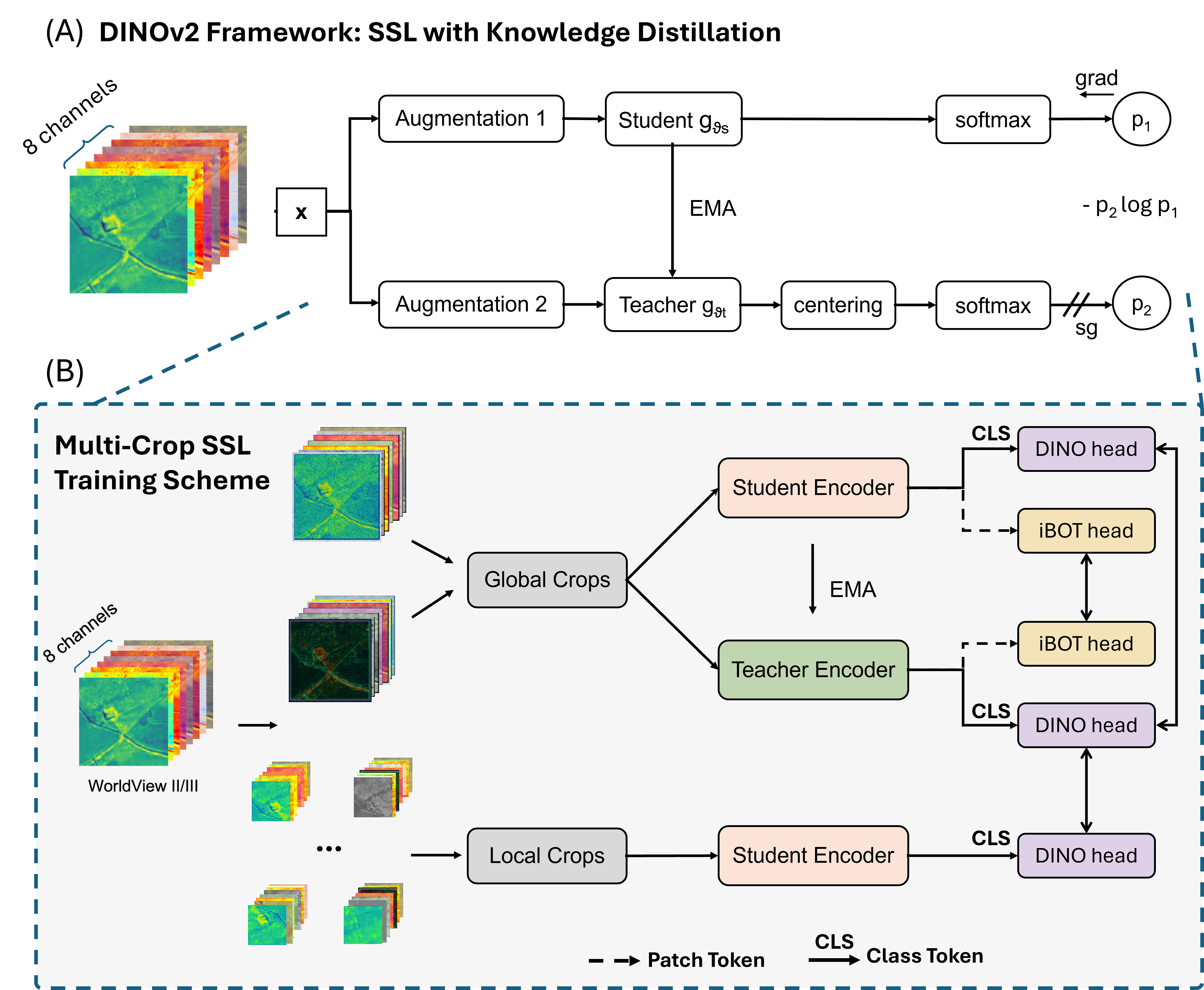

技术框架:DeepAndes 的整体框架基于 Transformer 架构,并采用 DINOv2 自监督学习算法进行预训练。具体流程包括:1) 收集安第斯山脉地区的大规模多光谱遥感影像数据集;2) 使用定制的 DINOv2 算法对 Transformer 模型进行预训练,使其学习图像的内在结构和特征;3) 在下游任务(如图像分类、实例检索和语义分割)上对预训练模型进行微调或直接应用。

关键创新:DeepAndes 的关键创新在于:1) 它是第一个专门为安第斯山脉地区多光谱遥感影像设计的视觉基础模型;2) 它定制了 DINOv2 自监督学习算法,使其能够更好地处理 8 波段多光谱数据;3) 通过大规模自监督预训练,显著提升了模型在少样本学习场景下的性能。

关键设计:DeepAndes 使用了 Transformer 作为其核心架构,并采用了 DINOv2 的自监督学习策略。DINOv2 通过对比学习的方式,使模型学习到图像的不同视角和变换之间的不变性。针对 8 波段多光谱数据,论文可能对 DINOv2 的输入层和特征提取模块进行了调整,以更好地利用多光谱信息。具体的损失函数和训练参数等细节需要在论文原文中查找。

🖼️ 关键图片

📊 实验亮点

DeepAndes 在少样本学习场景中表现出色,在图像分类任务中,F1 分数显著优于从头开始训练的模型和在较小数据集上预训练的模型。在图像实例检索任务中,平均精度均值 (mAP) 得到显著提升。在像素级语义分割任务中,Dice 系数也优于其他基线模型。这些结果表明,DeepAndes 能够有效地学习多光谱遥感影像的特征表示,并在下游任务中实现更好的泛化能力。

🎯 应用场景

DeepAndes 可广泛应用于安第斯山脉地区的考古研究,例如遗址识别、文物定位、古代农业景观重建等。该模型能够帮助考古学家更高效地分析遥感数据,发现新的考古遗址,并深入了解古代文明的社会、经济和环境适应策略。未来,DeepAndes 可以扩展到其他地区和领域,为遥感影像分析提供更强大的支持。

📄 摘要(原文)

By mapping sites at large scales using remotely sensed data, archaeologists can generate unique insights into long-term demographic trends, inter-regional social networks, and past adaptations to climate change. Remote sensing surveys complement field-based approaches, and their reach can be especially great when combined with deep learning and computer vision techniques. However, conventional supervised deep learning methods face challenges in annotating fine-grained archaeological features at scale. While recent vision foundation models have shown remarkable success in learning large-scale remote sensing data with minimal annotations, most off-the-shelf solutions are designed for RGB images rather than multi-spectral satellite imagery, such as the 8-band data used in our study. In this paper, we introduce DeepAndes, a transformer-based vision foundation model trained on three million multi-spectral satellite images, specifically tailored for Andean archaeology. DeepAndes incorporates a customized DINOv2 self-supervised learning algorithm optimized for 8-band multi-spectral imagery, marking the first foundation model designed explicitly for the Andes region. We evaluate its image understanding performance through imbalanced image classification, image instance retrieval, and pixel-level semantic segmentation tasks. Our experiments show that DeepAndes achieves superior F1 scores, mean average precision, and Dice scores in few-shot learning scenarios, significantly outperforming models trained from scratch or pre-trained on smaller datasets. This underscores the effectiveness of large-scale self-supervised pre-training in archaeological remote sensing. Codes will be available on https://github.com/geopacha/DeepAndes.