Mesh-Learner: Texturing Mesh with Spherical Harmonics

作者: Yunfei Wan, Jianheng Liu, Chunran Zheng, Jiarong Lin, Fu Zhang

分类: cs.CV, cs.RO

发布日期: 2025-04-28 (更新: 2025-08-25)

备注: IROS2025 Accepted

🔗 代码/项目: GITHUB

💡 一句话要点

Mesh-Learner:利用球谐函数纹理实现可微分的网格渲染与重建

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经渲染 网格重建 球谐函数 栅格化渲染 视角相关渲染

📋 核心要点

- 现有神经渲染方法在处理大规模场景时,常常面临内存占用高和渲染速度慢的挑战。

- Mesh-Learner通过结合网格结构和球谐函数纹理,实现了高效的视角相关辐射率学习和渲染。

- 实验表明,该方法在真实数据集上取得了优于现有SOTA方法的渲染质量,并降低了GPU内存占用。

📝 摘要(中文)

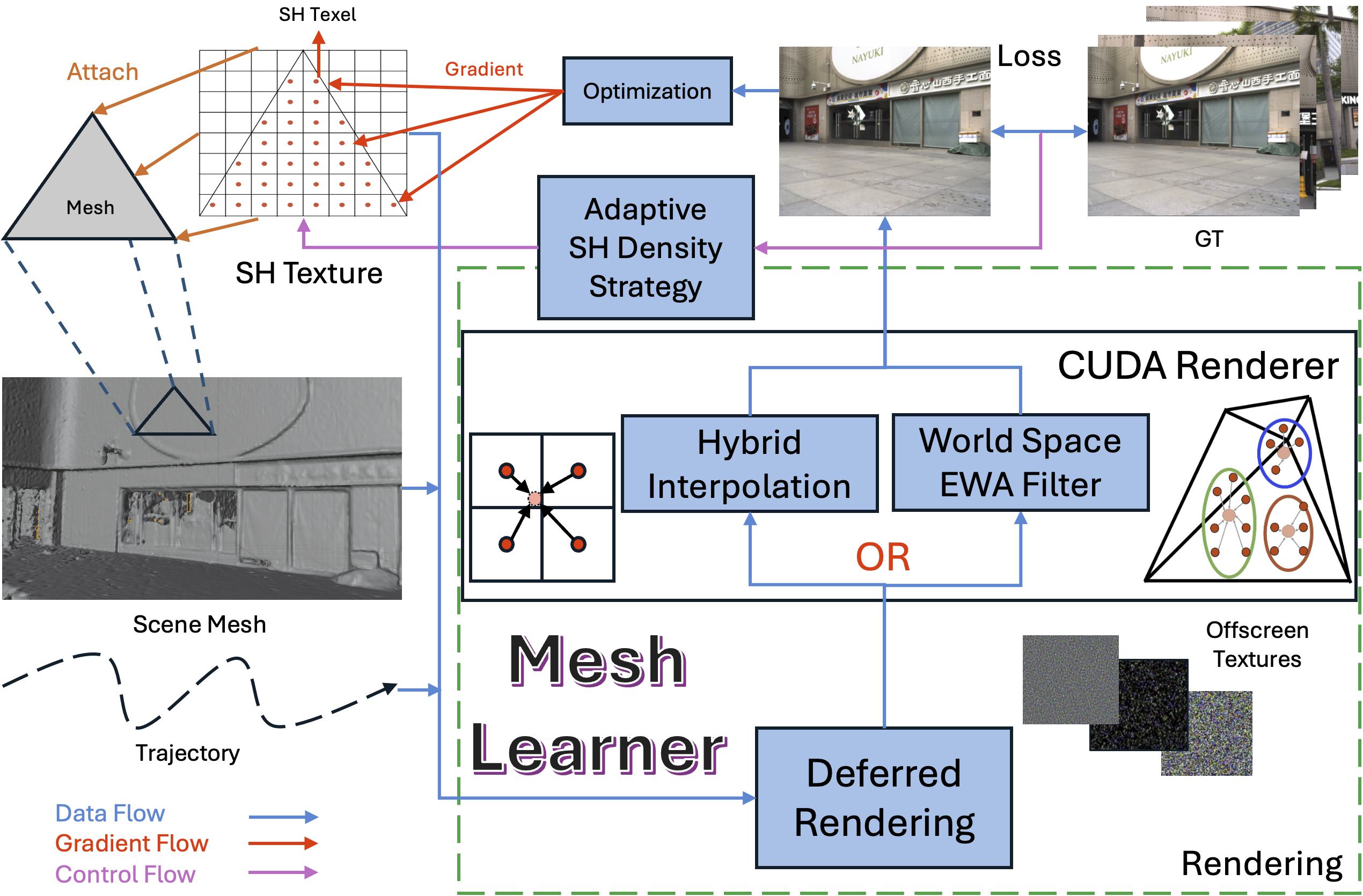

本文提出了一种名为Mesh-Learner的3D重建和渲染框架,它与传统的栅格化渲染管线原生兼容。该框架将网格和球谐函数(SH)纹理(即填充了SH系数的纹理)集成到学习过程中,以端到端的方式学习每个网格的视角相关的辐射率。图像通过使用一种新颖的插值方法,在每个像素的采样点插值周围的SH纹素来渲染。反之,来自每个像素的梯度反向传播到SH纹理中相关的SH纹素。Mesh-Learner利用栅格化渲染管线的图形特性(纹理采样、延迟渲染)进行渲染,这使得Mesh-Learner自然地与基于栅格化管线的工具(例如Blender)和任务(例如3D重建、场景渲染、机器人强化学习)兼容。我们的系统可以训练庞大的、无限的场景,因为我们仅将视锥体内的SH纹理传输到GPU进行训练。在其他时间,SH纹理存储在CPU RAM中,从而降低了GPU内存使用率。在Replica和FAST-LIVO2数据集上的插值和外推序列的渲染结果与现有的最先进方法(例如3D Gaussian Splatting和M2-Mapping)相比,实现了最先进的性能。为了回馈社会,代码将在https://github.com/hku-mars/Mesh-Learner上提供。

🔬 方法详解

问题定义:现有神经渲染方法,如NeRF及其变体,虽然在渲染质量上表现出色,但在大规模场景下,需要存储大量的体素或神经场参数,导致内存占用过高,渲染速度较慢。此外,这些方法与传统的栅格化渲染管线兼容性较差,难以直接应用于现有的3D工具和工作流程中。

核心思路:Mesh-Learner的核心思路是将场景表示为网格结构,并使用球谐函数(SH)系数来表示网格表面的纹理信息。通过学习每个网格面片上SH系数,可以有效地捕捉视角相关的辐射率变化。同时,利用栅格化渲染管线的优势,可以实现高效的渲染和反向传播。

技术框架:Mesh-Learner的整体框架包括以下几个主要模块:1) 网格表示:使用传统的三角形网格来表示场景的几何结构。2) SH纹理:将每个网格面片关联一个SH纹理,用于存储该面片的视角相关辐射率信息。3) 渲染模块:利用栅格化渲染管线,对网格进行渲染,并在像素采样点插值周围的SH纹素,计算最终的像素颜色。4) 优化模块:通过反向传播梯度,优化SH纹理中的SH系数,从而提高渲染质量。

关键创新:Mesh-Learner的关键创新在于将SH纹理与网格结构相结合,并利用栅格化渲染管线进行渲染。这种方法既可以有效地表示视角相关的辐射率变化,又可以充分利用GPU的并行计算能力,实现高效的渲染和优化。此外,该方法与传统的3D工具和工作流程兼容性更好。

关键设计:在Mesh-Learner中,SH纹理的分辨率是一个重要的参数,它决定了辐射率表示的精度。此外,损失函数的设计也至关重要,需要平衡渲染质量和训练稳定性。论文中采用了一种基于L1和L2损失的混合损失函数,并加入了一些正则化项,以防止过拟合。在渲染过程中,采用了一种新颖的插值方法,以减少插值误差。

🖼️ 关键图片

📊 实验亮点

Mesh-Learner在Replica和FAST-LIVO2数据集上进行了评估,实验结果表明,该方法在插值和外推序列上的渲染质量均优于现有的SOTA方法,如3D Gaussian Splatting和M2-Mapping。此外,Mesh-Learner的GPU内存占用较低,可以处理大规模场景。

🎯 应用场景

Mesh-Learner具有广泛的应用前景,包括:1) 3D重建:可以用于从多视角图像中重建高质量的3D模型。2) 场景渲染:可以用于渲染逼真的虚拟场景,例如游戏和电影。3) 机器人强化学习:可以用于训练机器人在复杂环境中的导航和操作技能。该方法与现有工具的兼容性使其易于集成到现有工作流程中,具有很高的实际应用价值。

📄 摘要(原文)

In this paper, we present a 3D reconstruction and rendering framework termed Mesh-Learner that is natively compatible with traditional rasterization pipelines. It integrates mesh and spherical harmonic (SH) texture (i.e., texture filled with SH coefficients) into the learning process to learn each mesh s view-dependent radiance end-to-end. Images are rendered by interpolating surrounding SH Texels at each pixel s sampling point using a novel interpolation method. Conversely, gradients from each pixel are back-propagated to the related SH Texels in SH textures. Mesh-Learner exploits graphic features of rasterization pipeline (texture sampling, deferred rendering) to render, which makes Mesh-Learner naturally compatible with tools (e.g., Blender) and tasks (e.g., 3D reconstruction, scene rendering, reinforcement learning for robotics) that are based on rasterization pipelines. Our system can train vast, unlimited scenes because we transfer only the SH textures within the frustum to the GPU for training. At other times, the SH textures are stored in CPU RAM, which results in moderate GPU memory usage. The rendering results on interpolation and extrapolation sequences in the Replica and FAST-LIVO2 datasets achieve state-of-the-art performance compared to existing state-of-the-art methods (e.g., 3D Gaussian Splatting and M2-Mapping). To benefit the society, the code will be available at https://github.com/hku-mars/Mesh-Learner.