LiDAR-Guided Monocular 3D Object Detection for Long-Range Railway Monitoring

作者: Raul David Dominguez Sanchez, Xavier Diaz Ortiz, Xingcheng Zhou, Max Peter Ronecker, Michael Karner, Daniel Watzenig, Alois Knoll

分类: cs.CV, cs.LG

发布日期: 2025-04-25

备注: Accepted for the Data-Driven Learning for Intelligent Vehicle Applications Workshop at the 36th IEEE Intelligent Vehicles Symposium (IV) 2025

💡 一句话要点

提出LiDAR引导的单目3D目标检测方法,用于远距离铁路监控

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目3D目标检测 远距离感知 铁路监控 LiDAR引导 深度估计 自主列车 YOLOv9

📋 核心要点

- 现有铁路系统面临基础设施老化和交通流量增加的挑战,需要高水平的自动化,而远距离感知是实现安全的关键。

- 该方法利用单目图像,结合LiDAR数据进行深度估计,并设计了短程和远程3D检测头,以实现远距离目标检测。

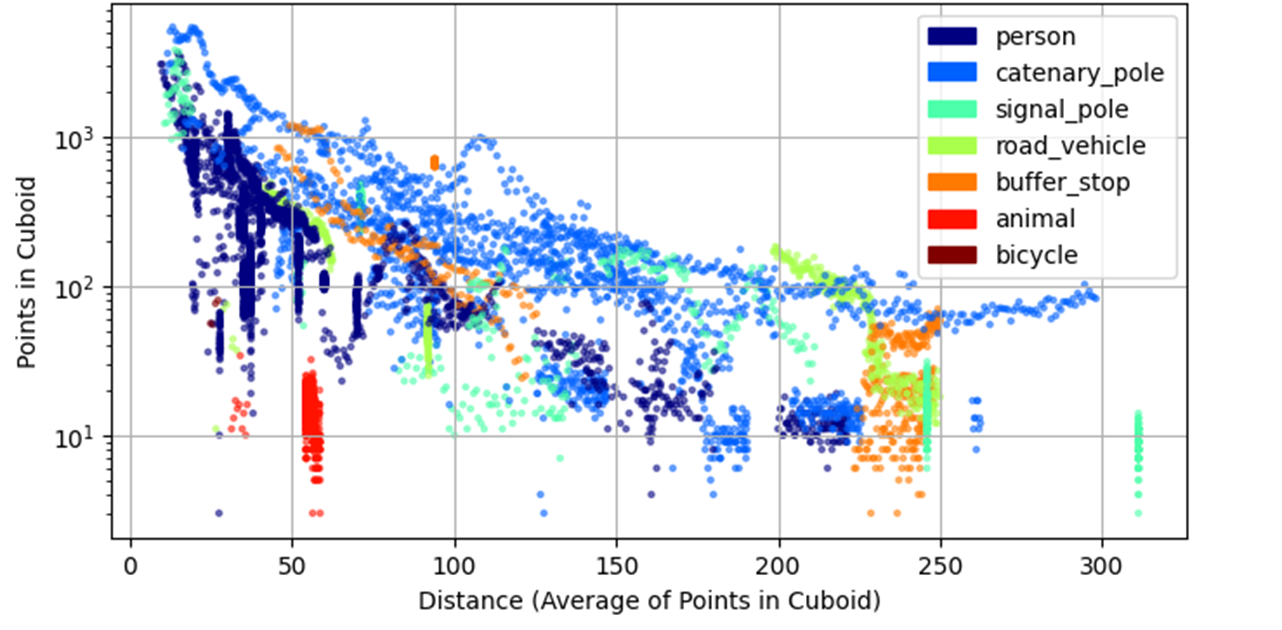

- 在OSDaR23数据集上的实验表明,该方法能够有效检测远至250米的目标,验证了其在铁路自动化中的潜力。

📝 摘要(中文)

本文提出了一种基于深度学习的远距离3D目标检测方法,专为自主列车设计。该方法仅依赖单目图像,并借鉴了Faraway-Frustum方法,在训练过程中融入LiDAR数据以提升深度估计的准确性。提出的流程包含四个关键模块:(1)改进的YOLOv9用于2.5D目标检测,(2)深度估计网络,(3-4)专门设计的短程和远程3D检测头。在OSDaR23数据集上的评估结果表明,该方法能够有效检测远至250米的目标。研究结果突显了其在铁路自动化领域的潜力,并指出了未来改进的方向。

🔬 方法详解

问题定义:论文旨在解决铁路场景下远距离3D目标检测问题。现有方法在远距离感知方面存在不足,尤其是在单目视觉条件下,深度估计的准确性是关键瓶颈。传统的基于图像的3D目标检测方法难以满足铁路系统对感知距离的需求,而纯LiDAR方案成本较高,单目视觉结合LiDAR数据是一种更具性价比的方案。

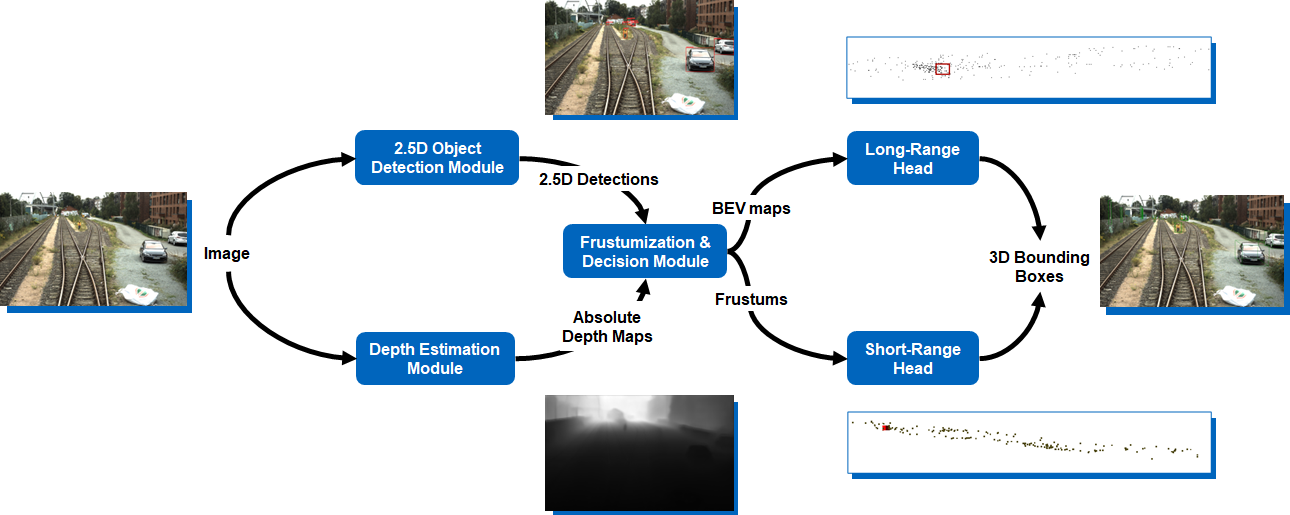

核心思路:论文的核心思路是利用LiDAR数据辅助单目视觉进行深度估计,从而提高远距离3D目标检测的准确性。借鉴Faraway-Frustum方法,针对铁路场景的特点,设计了专门的短程和远程3D检测头,以适应不同距离的目标检测需求。通过融合2.5D目标检测结果和深度估计,实现精确的3D目标定位。

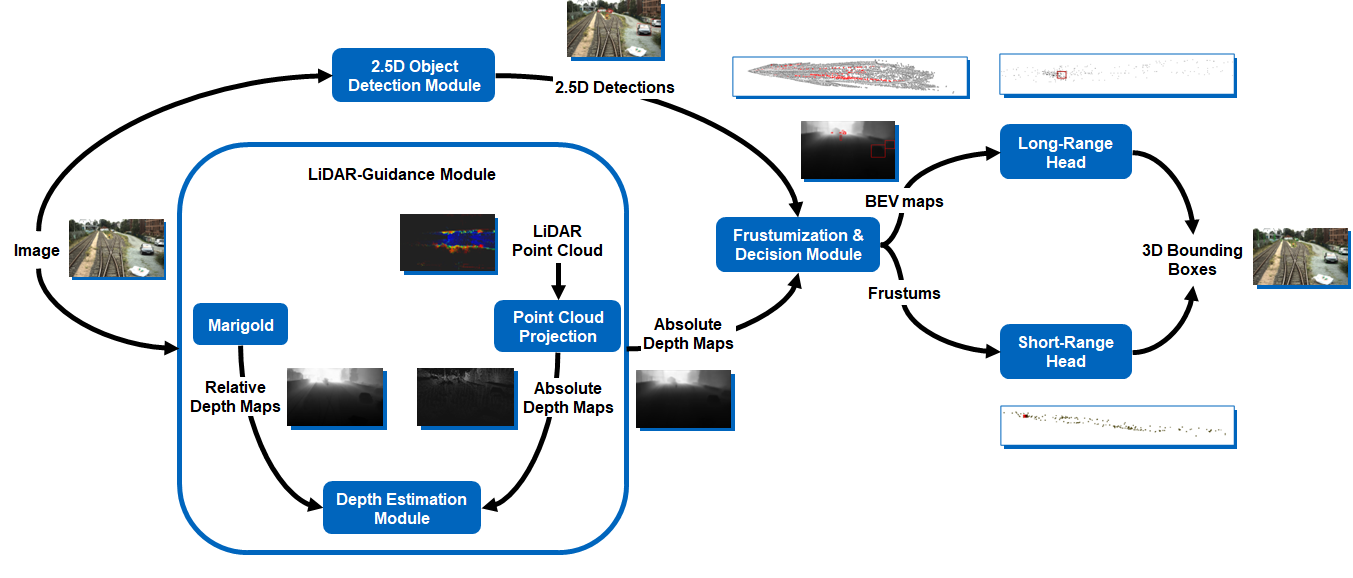

技术框架:整体框架包含四个主要模块:1) 改进的YOLOv9用于2.5D目标检测,提供目标的位置和类别信息;2) 深度估计网络,用于预测场景的深度图,该网络在训练阶段利用LiDAR数据进行监督;3) 短程3D检测头,用于检测近距离目标;4) 远程3D检测头,用于检测远距离目标。2.5D检测结果和深度估计结果被输入到3D检测头中,最终输出3D目标检测结果。

关键创新:该方法的主要创新点在于将LiDAR数据融入到单目3D目标检测的训练过程中,从而提高了深度估计的准确性。此外,针对铁路场景的特点,设计了专门的短程和远程3D检测头,以适应不同距离的目标检测需求。通过改进YOLOv9,提升了2.5D目标检测的性能,为后续的3D目标检测提供了更准确的先验信息。

关键设计:论文中使用了改进的YOLOv9作为2.5D目标检测器,具体改进细节未知。深度估计网络的具体结构未知,但其损失函数应该包含LiDAR深度信息作为监督信号。短程和远程3D检测头的具体结构也未知,但其设计目标是分别优化近距离和远距离目标的检测性能。论文中可能使用了特定的数据增强策略,以提高模型的鲁棒性。

🖼️ 关键图片

📊 实验亮点

该方法在OSDaR23数据集上进行了评估,结果表明其能够有效检测远至250米的目标。虽然论文中没有提供具体的性能指标和对比基线,但实验结果验证了该方法在远距离铁路目标检测方面的潜力。未来的工作可以进一步优化网络结构和训练策略,以提高检测精度和鲁棒性。

🎯 应用场景

该研究成果可应用于自主列车、铁路安全监控、轨道交通智能巡检等领域。通过提高远距离目标检测的准确性,可以有效预防铁路事故,提升铁路运输的安全性和效率。未来,该技术有望集成到铁路自动化系统中,实现更高级别的自主运行。

📄 摘要(原文)

Railway systems, particularly in Germany, require high levels of automation to address legacy infrastructure challenges and increase train traffic safely. A key component of automation is robust long-range perception, essential for early hazard detection, such as obstacles at level crossings or pedestrians on tracks. Unlike automotive systems with braking distances of ~70 meters, trains require perception ranges exceeding 1 km. This paper presents an deep-learning-based approach for long-range 3D object detection tailored for autonomous trains. The method relies solely on monocular images, inspired by the Faraway-Frustum approach, and incorporates LiDAR data during training to improve depth estimation. The proposed pipeline consists of four key modules: (1) a modified YOLOv9 for 2.5D object detection, (2) a depth estimation network, and (3-4) dedicated short- and long-range 3D detection heads. Evaluations on the OSDaR23 dataset demonstrate the effectiveness of the approach in detecting objects up to 250 meters. Results highlight its potential for railway automation and outline areas for future improvement.