PICO: Reconstructing 3D People In Contact with Objects

作者: Alpár Cseke, Shashank Tripathi, Sai Kumar Dwivedi, Arjun Lakshmipathy, Agniv Chatterjee, Michael J. Black, Dimitrios Tzionas

分类: cs.CV

发布日期: 2025-04-24

备注: Accepted in CVPR'25. Project Page: https://pico.is.tue.mpg.de

💡 一句话要点

PICO:重建与物体接触的3D人体,解决自然图像中HOI的深度歧义问题。

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction) 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D人体重建 人-物交互 HOI 数据集构建 接触估计 视觉基础模型 SMPL-X

📋 核心要点

- 现有3D人-物交互方法在自然图像中面临深度歧义、遮挡和物体多样性等挑战,泛化能力不足。

- PICO通过构建包含密集3D接触信息的新数据集PICO-db,并提出PICO-fit拟合方法,迭代优化人体和物体网格。

- PICO-fit在多种物体类别上表现良好,优于现有方法,为HOI理解在实际场景中的应用奠定基础。

📝 摘要(中文)

从单张彩色图像中恢复3D人-物交互(HOI)极具挑战,因为存在深度歧义、遮挡以及物体形状和外观的巨大差异。因此,过去的工作需要受控设置,例如已知的物体形状和接触,并且只处理有限的物体类别。我们需要能够推广到自然图像和新颖物体类别的方法。本文通过两种主要方式解决这个问题:(1)收集了一个新的数据集PICO-db,其中包含与身体和物体网格上的密集3D接触配对的自然图像。为此,我们使用了来自最近的DAMON数据集的图像,这些图像与接触配对,但这些接触仅在规范的3D身体上进行注释。相反,我们寻求身体和物体上的接触标签。为了在给定图像的情况下推断这些标签,我们利用视觉基础模型从数据库中检索合适的3D物体网格。然后,我们通过一种新颖的方法将DAMON的身体接触补丁投影到物体上,每个补丁只需要两次点击。这种最小的人工输入建立了身体和物体之间丰富的接触对应关系。(2)我们在一种新颖的渲染和比较拟合方法(称为PICO-fit)中利用我们的接触对应关系新数据集来恢复交互中的3D身体和物体网格。PICO-fit推断SMPL-X身体的接触,从PICO-db中检索该物体的可能3D物体网格和接触,并使用该接触通过优化将3D身体和物体网格迭代地拟合到图像证据。独特的是,PICO-fit适用于许多现有方法无法处理的物体类别。这对于使HOI理解能够在野外扩展至关重要。我们的数据和代码可在https://pico.is.tue.mpg.de获得。

🔬 方法详解

问题定义:论文旨在解决从单张自然图像中准确重建与物体交互的3D人体和物体网格的问题。现有方法通常依赖于受控环境、已知物体形状或有限的物体类别,难以泛化到真实场景。这些方法无法处理深度歧义、遮挡以及物体形状和外观的巨大差异,导致重建精度低,适用范围窄。

核心思路:论文的核心思路是利用视觉基础模型和人工交互,构建包含密集3D接触信息的数据集,并基于此设计一种渲染和比较的拟合方法。通过检索相似物体并利用接触信息,约束人体和物体的姿态和形状,从而提高重建的准确性和鲁棒性。这种方法的核心在于利用接触信息作为桥梁,连接人体和物体,从而解决深度歧义和遮挡问题。

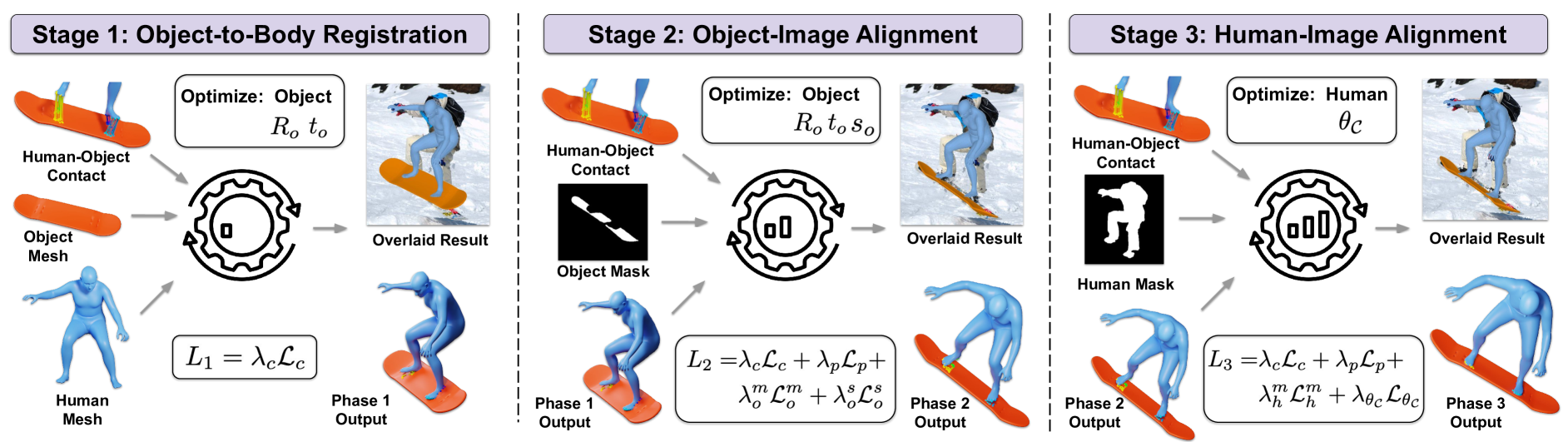

技术框架:PICO的整体框架包含两个主要部分:数据集构建和模型拟合。首先,利用DAMON数据集的图像,通过视觉基础模型检索相似的3D物体网格,并使用少量人工标注(每个接触补丁两次点击)将人体接触信息投影到物体上,构建PICO-db数据集。然后,PICO-fit方法基于PICO-db中的接触信息,迭代地拟合3D人体(SMPL-X)和物体网格到图像证据。该过程包括人体接触推断、物体检索和接触估计、以及基于渲染和比较的优化。

关键创新:论文的关键创新在于:(1)构建了包含密集3D接触信息(人体和物体)的PICO-db数据集,为HOI研究提供了新的数据资源。(2)提出了PICO-fit方法,该方法利用接触信息作为约束,实现了在自然图像中对多种物体类别进行准确的3D人体和物体重建。与现有方法相比,PICO-fit具有更强的泛化能力和更高的重建精度。

关键设计:PICO-fit的关键设计包括:(1)使用SMPL-X人体模型进行人体姿态和形状估计。(2)利用视觉基础模型(具体模型未知)进行物体检索。(3)设计了基于渲染和比较的损失函数,用于优化人体和物体网格。损失函数可能包括图像重投影误差、接触约束误差等。具体的参数设置和网络结构在论文中可能有所描述,但摘要中未提供详细信息。

🖼️ 关键图片

📊 实验亮点

PICO-fit在多种物体类别上取得了显著的成果,能够处理现有方法无法处理的复杂场景。虽然摘要中没有提供具体的性能数据,但强调了PICO-fit在泛化能力方面的优势,能够更好地处理自然图像中的HOI问题。PICO-db数据集的构建也为未来的研究提供了宝贵的数据资源。

🎯 应用场景

该研究成果可应用于人机交互、虚拟现实、增强现实、机器人等领域。例如,可以帮助机器人理解人类的动作和意图,从而实现更自然的人机协作。在虚拟现实和增强现实中,可以创建更逼真的人-物交互体验。此外,该技术还可以用于运动分析、游戏开发等领域,具有广泛的应用前景。

📄 摘要(原文)

Recovering 3D Human-Object Interaction (HOI) from single color images is challenging due to depth ambiguities, occlusions, and the huge variation in object shape and appearance. Thus, past work requires controlled settings such as known object shapes and contacts, and tackles only limited object classes. Instead, we need methods that generalize to natural images and novel object classes. We tackle this in two main ways: (1) We collect PICO-db, a new dataset of natural images uniquely paired with dense 3D contact on both body and object meshes. To this end, we use images from the recent DAMON dataset that are paired with contacts, but these contacts are only annotated on a canonical 3D body. In contrast, we seek contact labels on both the body and the object. To infer these given an image, we retrieve an appropriate 3D object mesh from a database by leveraging vision foundation models. Then, we project DAMON's body contact patches onto the object via a novel method needing only 2 clicks per patch. This minimal human input establishes rich contact correspondences between bodies and objects. (2) We exploit our new dataset of contact correspondences in a novel render-and-compare fitting method, called PICO-fit, to recover 3D body and object meshes in interaction. PICO-fit infers contact for the SMPL-X body, retrieves a likely 3D object mesh and contact from PICO-db for that object, and uses the contact to iteratively fit the 3D body and object meshes to image evidence via optimization. Uniquely, PICO-fit works well for many object categories that no existing method can tackle. This is crucial to enable HOI understanding to scale in the wild. Our data and code are available at https://pico.is.tue.mpg.de.