DiMeR: Disentangled Mesh Reconstruction Model

作者: Lutao Jiang, Jiantao Lin, Kanghao Chen, Wenhang Ge, Xin Yang, Yifan Jiang, Yuanhuiyi Lyu, Xu Zheng, Yinchuan Li, Yingcong Chen

分类: cs.CV

发布日期: 2025-04-24 (更新: 2025-05-26)

备注: Project Page: https://lutao2021.github.io/DiMeR_page/

💡 一句话要点

DiMeR:提出解耦的网格重建模型,用于稀疏视角下的三维重建。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 三维重建 网格重建 几何纹理解耦 法线贴图 深度学习

📋 核心要点

- 现有方法在几何和纹理混合解空间中存在多个模糊优化目标,导致重建结果不准确。

- DiMeR通过将几何和纹理解耦,并使用法线贴图作为几何预测的唯一输入,从而简化了优化过程。

- 实验结果表明,DiMeR在稀疏视角、单图像和文本到3D的任务中均优于现有方法,Chamfer距离降低超过30%。

📝 摘要(中文)

我们提出了DiMeR,一种新颖的几何-纹理解耦前馈模型,具有3D监督,用于稀疏视角的网格重建。现有方法面临两个持续的障碍:(i)纹理可以掩盖几何误差,即,即使几何形状错误,也可以渲染出视觉上合理的图像,从而在相似对象的几何-纹理混合解空间中产生多个模糊的优化目标;(ii)流行的网格提取方法是冗余的、不稳定的,并且缺乏3D监督。为了解决这些挑战,我们重新思考了网格重建的归纳偏置。首先,我们将统一的几何-纹理解空间(其中单个输入允许多个可行的解决方案)解耦为单独的几何和纹理空间。具体来说,鉴于法线贴图与几何形状严格一致并准确捕获表面变化,因此法线贴图用作DiMeR中几何预测的唯一输入,而纹理则从RGB图像估计。其次,我们通过消除性能/成本比率低的模块并重新设计具有3D监督的正则化损失来简化网格提取算法。值得注意的是,DiMeR仍然可以通过利用基础模型进行法线预测来接受原始RGB图像作为输入。大量实验表明,DiMeR可以推广到稀疏视角、单图像和文本到3D的任务,始终优于基线。在GSO和OmniObject3D数据集上,DiMeR显着降低了超过30%的Chamfer距离。

🔬 方法详解

问题定义:现有三维网格重建方法常常将几何和纹理耦合在一起优化,导致纹理可以掩盖几何误差,使得即使几何形状不准确,渲染出的图像在视觉上也可能合理。这使得优化目标变得模糊,难以得到准确的几何形状。此外,现有的网格提取方法通常是冗余且不稳定的,缺乏有效的3D监督。

核心思路:DiMeR的核心思路是将几何和纹理解耦,分别进行优化。具体来说,利用法线贴图与几何形状的强一致性,将法线贴图作为几何预测的唯一输入,避免纹理对几何形状的影响。同时,纹理则直接从RGB图像中估计。通过这种解耦的方式,可以有效地解决优化目标模糊的问题,提高重建精度。

技术框架:DiMeR的整体框架包含两个主要部分:几何预测和纹理预测。首先,通过预训练的基础模型(如Stable Diffusion)从RGB图像中预测法线贴图。然后,将法线贴图输入到几何预测模块,预测三维网格的几何形状。同时,纹理预测模块直接从RGB图像中估计纹理。最后,将预测的几何形状和纹理进行组合,得到最终的三维重建结果。

关键创新:DiMeR最重要的创新点在于几何和纹理的解耦。与现有方法不同,DiMeR不再将几何和纹理放在一起优化,而是分别进行预测。这种解耦的方式可以有效地避免纹理对几何形状的影响,提高重建精度。此外,DiMeR还简化了网格提取算法,并引入了3D监督,进一步提高了重建质量。

关键设计:DiMeR的关键设计包括:(1) 使用预训练的基础模型进行法线预测,从而可以接受原始RGB图像作为输入;(2) 设计了专门的几何预测模块,用于从法线贴图中预测三维网格的几何形状;(3) 设计了纹理预测模块,用于直接从RGB图像中估计纹理;(4) 引入了3D监督,例如Chamfer Distance,用于约束重建结果的准确性。

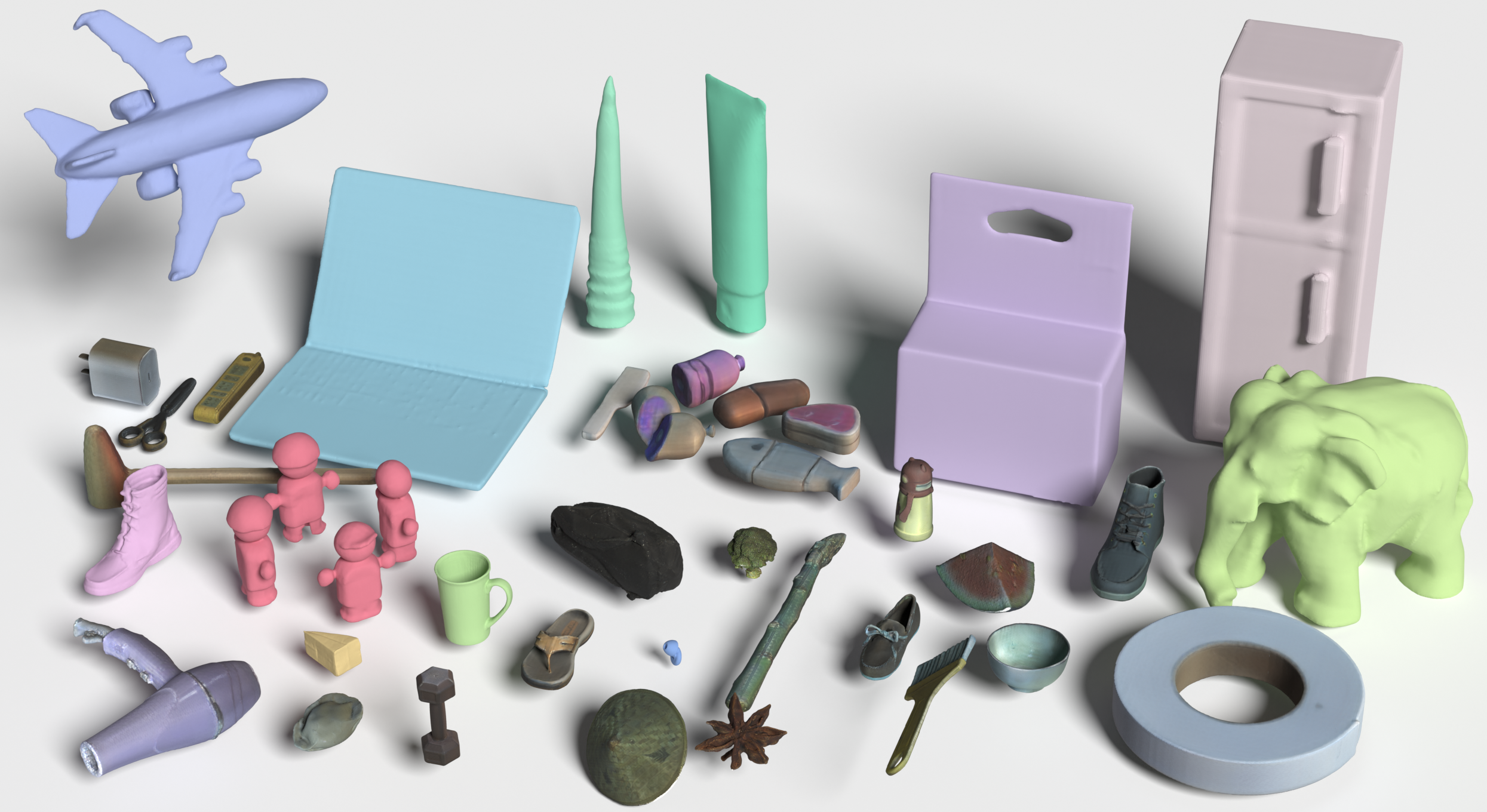

🖼️ 关键图片

📊 实验亮点

DiMeR在GSO和OmniObject3D数据集上取得了显著的性能提升,Chamfer距离降低了超过30%。这表明DiMeR在三维重建的精度方面具有明显的优势。此外,实验还表明DiMeR可以很好地泛化到稀疏视角、单图像和文本到3D的任务,证明了其鲁棒性和通用性。

🎯 应用场景

DiMeR在三维重建领域具有广泛的应用前景,例如虚拟现实、增强现实、游戏开发、机器人导航等。它可以用于从稀疏的图像中重建出高质量的三维模型,从而为这些应用提供更真实、更精确的三维场景。此外,DiMeR还可以应用于单图像三维重建和文本到三维模型的生成,进一步拓展了其应用范围。

📄 摘要(原文)

We propose DiMeR, a novel geometry-texture disentangled feed-forward model with 3D supervision for sparse-view mesh reconstruction. Existing methods confront two persistent obstacles: (i) textures can conceal geometric errors, i.e., visually plausible images can be rendered even with wrong geometry, producing multiple ambiguous optimization objectives in geometry-texture mixed solution space for similar objects; and (ii) prevailing mesh extraction methods are redundant, unstable, and lack 3D supervision. To solve these challenges, we rethink the inductive bias for mesh reconstruction. First, we disentangle the unified geometry-texture solution space, where a single input admits multiple feasible solutions, into geometry and texture spaces individually. Specifically, given that normal maps are strictly consistent with geometry and accurately capture surface variations, the normal maps serve as the sole input for geometry prediction in DiMeR, while the texture is estimated from RGB images. Second, we streamline the algorithm of mesh extraction by eliminating modules with low performance/cost ratios and redesigning regularization losses with 3D supervision. Notably, DiMeR still accepts raw RGB images as input by leveraging foundation models for normal prediction. Extensive experiments demonstrate that DiMeR generalises across sparse-view-, single-image-, and text-to-3D tasks, consistently outperforming baselines. On the GSO and OmniObject3D datasets, DiMeR significantly reduces Chamfer Distance by more than 30%.