Spectral Dictionary Learning for Generative Image Modeling

作者: Andrew Kiruluta

分类: cs.CV

发布日期: 2025-04-21

💡 一句话要点

提出基于谱字典学习的图像生成模型,实现可控图像合成。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 谱字典学习 生成模型 图像合成 频率域分析 短时傅里叶变换

📋 核心要点

- 现有生成模型(如GAN、VAE、Diffusion)存在训练不稳定、可解释性差等问题,难以直接控制图像的频率成分。

- 提出一种基于谱字典学习的生成模型,将图像表示为谱基函数的线性组合,通过控制谱成分实现图像生成。

- 在CIFAR-10上取得了有竞争力的性能,同时提高了训练稳定性和计算效率,并提供了更好的可解释性。

📝 摘要(中文)

本文提出了一种新颖的谱生成模型用于图像合成,该模型与常见的变分、对抗和扩散范式截然不同。在该方法中,图像被展平为一维信号后,被重构为一组学习到的谱基函数的线性组合,其中每个基函数都通过频率、相位和幅度进行显式参数化。该模型联合学习一个具有时变调制的全局谱字典和每个图像的混合系数,这些混合系数量化了每个谱分量的贡献。随后,一个简单的概率模型被拟合到这些混合系数上,从而可以通过从潜在空间采样来确定性地生成新图像。与依赖随机推断或对抗训练的方法相比,该框架利用确定性字典学习,提供了一种高度可解释且具有物理意义的表示。此外,通过短时傅里叶变换(STFT)计算的频域损失函数的加入,确保了合成图像能够捕捉到全局结构和精细的谱细节,例如纹理和边缘信息。在CIFAR-10基准上的实验评估表明,该方法不仅在重建质量和感知逼真度方面取得了具有竞争力的性能,而且还提供了改进的训练稳定性和计算效率。这种新型生成模型为可控合成开辟了有希望的途径,因为学习到的谱字典可以直接控制图像的内在频率内容,从而提供增强的可解释性和在图像处理和分析中的潜在应用。

🔬 方法详解

问题定义:现有生成模型,如GAN、VAE和扩散模型,在图像合成方面取得了显著进展,但它们通常涉及复杂的随机推断或对抗训练过程,导致训练不稳定,可解释性差,并且难以直接控制生成图像的频率成分。因此,需要一种更稳定、可解释且可控的图像生成方法。

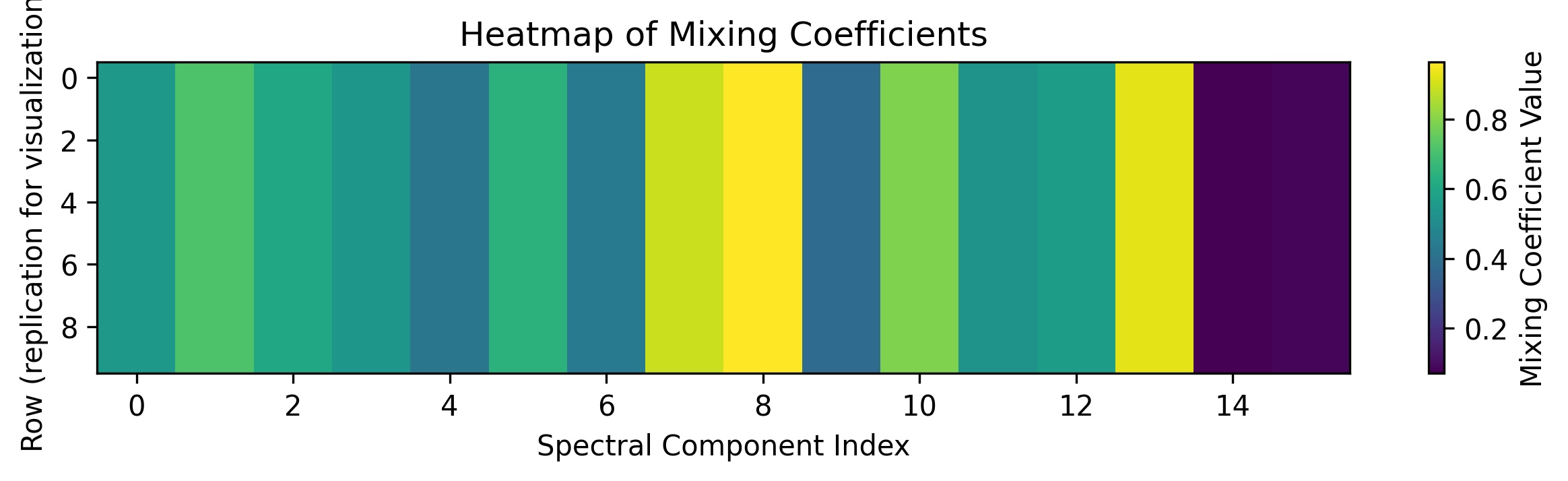

核心思路:本文的核心思路是将图像视为一组谱基函数的线性组合,通过学习一个全局谱字典和每个图像的混合系数来表示图像。通过显式地参数化每个谱基函数的频率、相位和幅度,可以实现对图像频率成分的直接控制。通过对混合系数进行建模,可以实现从潜在空间到图像的确定性生成。

技术框架:该方法包含以下主要模块:1) 图像展平:将图像展平为一维信号。2) 谱字典学习:联合学习一个全局谱字典和每个图像的混合系数。3) 混合系数建模:对混合系数进行概率建模。4) 图像生成:从潜在空间采样,生成新的混合系数,并使用学习到的谱字典重构图像。该框架使用短时傅里叶变换(STFT)计算频域损失函数,以确保合成图像捕捉到全局结构和精细的谱细节。

关键创新:该方法最重要的技术创新点在于使用谱字典学习来表示图像,从而实现对图像频率成分的直接控制。与现有方法相比,该方法提供了一种更可解释、更稳定且更可控的图像生成方式。此外,使用确定性字典学习避免了随机推断或对抗训练,提高了训练效率和稳定性。

关键设计:该方法使用L1损失和频域损失(基于STFT)来优化谱字典和混合系数。谱字典中的每个基函数都通过频率、相位和幅度进行参数化。混合系数使用高斯混合模型进行建模。在CIFAR-10实验中,使用了Adam优化器,学习率为0.001,batch size为64。

🖼️ 关键图片

📊 实验亮点

在CIFAR-10数据集上的实验表明,该方法在重建质量和感知逼真度方面取得了具有竞争力的性能。与现有方法相比,该方法具有更好的训练稳定性和计算效率。此外,该方法还提供了更好的可解释性,可以通过控制谱成分来生成具有特定频率特征的图像。

🎯 应用场景

该研究成果可应用于图像编辑、图像修复、纹理合成等领域。通过控制谱成分,可以实现对图像内容更精细的操控,例如改变图像的纹理、增强图像的边缘等。此外,该方法还可以用于图像分析,例如识别图像中的主要频率成分,从而实现图像分类和检索。

📄 摘要(原文)

We propose a novel spectral generative model for image synthesis that departs radically from the common variational, adversarial, and diffusion paradigms. In our approach, images, after being flattened into one-dimensional signals, are reconstructed as linear combinations of a set of learned spectral basis functions, where each basis is explicitly parameterized in terms of frequency, phase, and amplitude. The model jointly learns a global spectral dictionary with time-varying modulations and per-image mixing coefficients that quantify the contributions of each spectral component. Subsequently, a simple probabilistic model is fitted to these mixing coefficients, enabling the deterministic generation of new images by sampling from the latent space. This framework leverages deterministic dictionary learning, offering a highly interpretable and physically meaningful representation compared to methods relying on stochastic inference or adversarial training. Moreover, the incorporation of frequency-domain loss functions, computed via the short-time Fourier transform (STFT), ensures that the synthesized images capture both global structure and fine-grained spectral details, such as texture and edge information. Experimental evaluations on the CIFAR-10 benchmark demonstrate that our approach not only achieves competitive performance in terms of reconstruction quality and perceptual fidelity but also offers improved training stability and computational efficiency. This new type of generative model opens up promising avenues for controlled synthesis, as the learned spectral dictionary affords a direct handle on the intrinsic frequency content of the images, thus providing enhanced interpretability and potential for novel applications in image manipulation and analysis.