Adversarial Attack for RGB-Event based Visual Object Tracking

作者: Qiang Chen, Xiao Wang, Haowen Wang, Bo Jiang, Lin Zhu, Dawei Zhang, Yonghong Tian, Jin Tang

分类: cs.CV, cs.AI

发布日期: 2025-04-19

🔗 代码/项目: GITHUB

💡 一句话要点

提出一种跨模态对抗攻击算法,用于降低RGB-Event视觉目标跟踪的鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对抗攻击 视觉目标跟踪 RGB-Event 跨模态学习 计算机视觉

📋 核心要点

- RGB-Event视觉跟踪算法在追求高精度和效率的同时,缺乏有效的对抗攻击和防御方法研究。

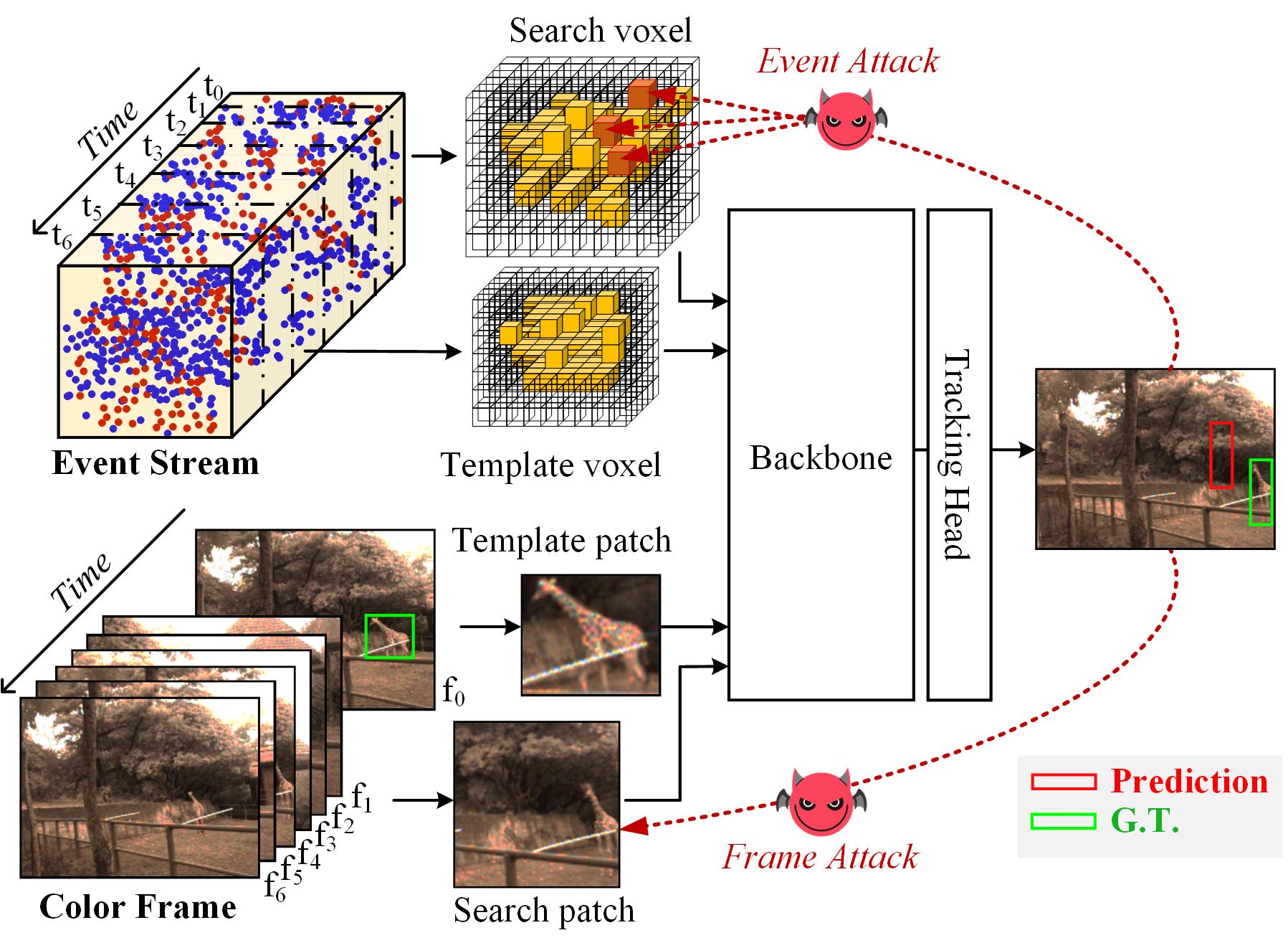

- 提出一种跨模态对抗攻击算法,分别针对RGB-Event体素和帧两种表示形式进行攻击。

- 在COESOT、FE108和VisEvent等数据集上的实验表明,该方法能显著降低跟踪器的性能。

📝 摘要(中文)

视觉目标跟踪是计算机视觉和多模态融合领域中的一个关键研究课题。在各种方法中,结合RGB帧和Event流的鲁棒视觉跟踪越来越受到研究人员的关注。在追求高精度和高效率的跟踪的同时,探索如何有效地对RGB-Event流跟踪算法进行对抗攻击和防御也很重要,但该领域的研究仍然相对匮乏。为了弥补这一差距,本文提出了一种用于RGB-Event视觉跟踪的跨模态对抗攻击算法。考虑到Event流的多样化表示,并且Event体素和帧更常用,本文将重点关注这两种表示进行深入研究。具体而言,对于RGB-Event体素,我们首先通过对抗损失优化扰动,以生成RGB帧对抗样本。对于离散Event体素表示,我们提出了一种两步攻击策略,更详细地说,我们首先将Event体素注入到目标区域作为初始化的对抗样本,然后,通过扰动Event体素的空间位置来进行梯度引导的优化。对于基于RGB-Event帧的跟踪,我们通过整合来自多模态数据的梯度信息来优化跨模态通用扰动。我们针对三种广泛使用的RGB-Event跟踪数据集(即COESOT、FE108和VisEvent)评估了所提出的攻击方法。大量的实验表明,我们的方法显著降低了跟踪器在单模态和多模态场景中在多个数据集上的性能。

🔬 方法详解

问题定义:现有的RGB-Event视觉目标跟踪算法缺乏对抗攻击和防御机制的研究,容易受到恶意攻击,导致跟踪性能下降。针对RGB-Event两种主流表示形式(体素和帧),如何设计有效的对抗攻击方法是一个关键问题。现有方法难以有效利用跨模态信息进行攻击,且针对离散的Event体素表示的攻击策略不足。

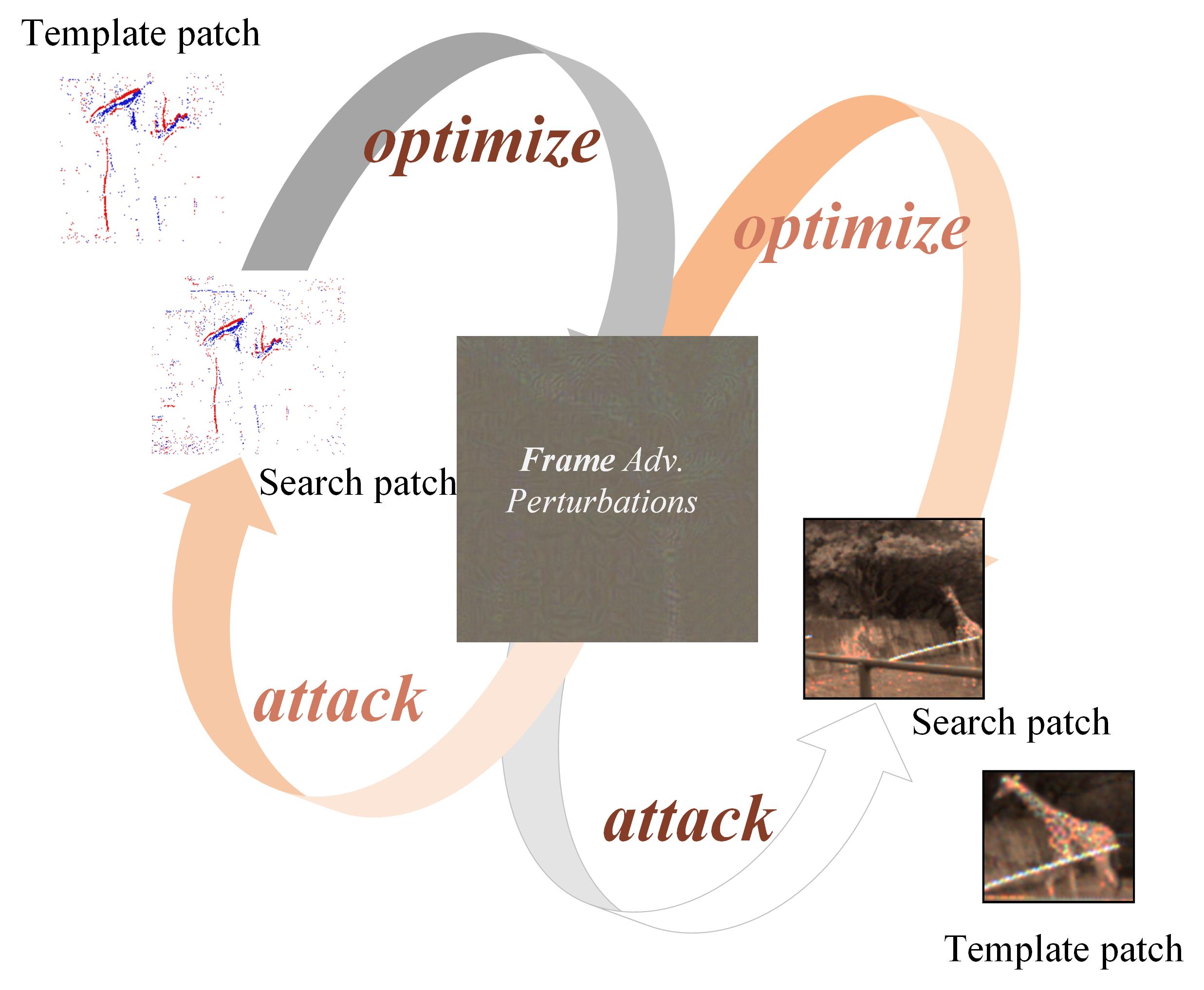

核心思路:针对RGB-Event体素表示,通过优化对抗损失生成RGB帧对抗样本。针对离散Event体素表示,采用两步攻击策略:首先注入Event体素作为初始化对抗样本,然后通过梯度引导优化Event体素的空间位置。针对RGB-Event帧表示,通过整合多模态数据的梯度信息优化跨模态通用扰动。这样设计的目的是充分利用跨模态信息,并针对不同表示形式设计特定的攻击策略,从而更有效地降低跟踪器的性能。

技术框架:该对抗攻击算法主要包含三个部分:针对RGB-Event体素的攻击、针对离散Event体素的攻击和针对RGB-Event帧的攻击。针对RGB-Event体素的攻击直接优化RGB帧的扰动。针对离散Event体素的攻击包含Event体素注入和梯度引导优化两个步骤。针对RGB-Event帧的攻击则通过整合多模态梯度信息优化通用扰动。

关键创新:该论文的关键创新在于提出了针对RGB-Event视觉跟踪的跨模态对抗攻击算法,并针对不同的数据表示形式(体素和帧)设计了特定的攻击策略。针对离散Event体素,提出了两步攻击策略,有效解决了离散数据难以直接进行梯度优化的难题。与现有方法相比,该方法更充分地利用了跨模态信息,并能更有效地降低跟踪器的性能。

关键设计:针对RGB-Event体素的攻击,对抗损失函数的设计需要平衡攻击效果和扰动幅度。针对离散Event体素的攻击,Event体素注入的位置和数量需要仔细选择,梯度引导优化的步长和迭代次数也需要调整。针对RGB-Event帧的攻击,如何有效地整合来自RGB和Event流的梯度信息是一个关键问题。具体参数设置和网络结构的选择取决于具体的跟踪器和数据集。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在COESOT、FE108和VisEvent等数据集上显著降低了RGB-Event跟踪器的性能。具体而言,在某些数据集上,跟踪器的成功率和精确度下降了超过20%。该方法在单模态和多模态场景下均表现出有效的攻击能力,证明了其通用性和有效性。

🎯 应用场景

该研究成果可应用于评估和提升RGB-Event视觉跟踪算法的鲁棒性,也可用于开发更安全的视觉跟踪系统。在自动驾驶、机器人导航、视频监控等安全攸关的应用场景中,对抗攻击防御技术至关重要,可以有效防止恶意攻击导致的系统失效。

📄 摘要(原文)

Visual object tracking is a crucial research topic in the fields of computer vision and multi-modal fusion. Among various approaches, robust visual tracking that combines RGB frames with Event streams has attracted increasing attention from researchers. While striving for high accuracy and efficiency in tracking, it is also important to explore how to effectively conduct adversarial attacks and defenses on RGB-Event stream tracking algorithms, yet research in this area remains relatively scarce. To bridge this gap, in this paper, we propose a cross-modal adversarial attack algorithm for RGB-Event visual tracking. Because of the diverse representations of Event streams, and given that Event voxels and frames are more commonly used, this paper will focus on these two representations for an in-depth study. Specifically, for the RGB-Event voxel, we first optimize the perturbation by adversarial loss to generate RGB frame adversarial examples. For discrete Event voxel representations, we propose a two-step attack strategy, more in detail, we first inject Event voxels into the target region as initialized adversarial examples, then, conduct a gradient-guided optimization by perturbing the spatial location of the Event voxels. For the RGB-Event frame based tracking, we optimize the cross-modal universal perturbation by integrating the gradient information from multimodal data. We evaluate the proposed approach against attacks on three widely used RGB-Event Tracking datasets, i.e., COESOT, FE108, and VisEvent. Extensive experiments show that our method significantly reduces the performance of the tracker across numerous datasets in both unimodal and multimodal scenarios. The source code will be released on https://github.com/Event-AHU/Adversarial_Attack_Defense