Towards Explainable Fake Image Detection with Multi-Modal Large Language Models

作者: Yikun Ji, Yan Hong, Jiahui Zhan, Haoxing Chen, jun lan, Huijia Zhu, Weiqiang Wang, Liqing Zhang, Jianfu Zhang

分类: cs.CV, cs.CL

发布日期: 2025-04-19 (更新: 2025-11-07)

备注: Accepted to ACM MM 2025; 14 pages including Appendix

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于多模态大语言模型的AI生成图像可解释性检测框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 虚假图像检测 可解释性AI 提示工程 AI生成内容

📋 核心要点

- 现有虚假图像检测方法缺乏透明性和可解释性,难以满足公共安全需求。

- 利用多模态大语言模型(MLLM)的推理能力,设计提示工程框架,提升检测的鲁棒性和可解释性。

- 通过实验对比MLLM与传统方法及人工评估,验证了MLLM在可解释性虚假图像检测方面的潜力。

📝 摘要(中文)

图像生成技术的进步引发了严重的公共安全问题。我们认为,虚假图像检测不应以“黑盒”方式运行。相反,理想的方法必须确保强大的泛化能力和透明度。多模态大语言模型(MLLM)的最新进展为基于推理的AI生成图像检测提供了新的机会。在这项工作中,我们评估了MLLM的能力,并将其与传统检测方法和人工评估员进行了比较,突出了它们的优势和局限性。此外,我们设计了六种不同的提示,并提出了一个集成这些提示的框架,以开发更强大、可解释和推理驱动的检测系统。代码已在https://github.com/Gennadiyev/mllm-defake上发布。

🔬 方法详解

问题定义:当前的AI生成图像检测方法通常是黑盒模型,缺乏可解释性,难以让用户理解判断依据,也难以应对不断涌现的新的生成技术。因此,需要一种既能保证检测精度,又能提供可解释性的方法。

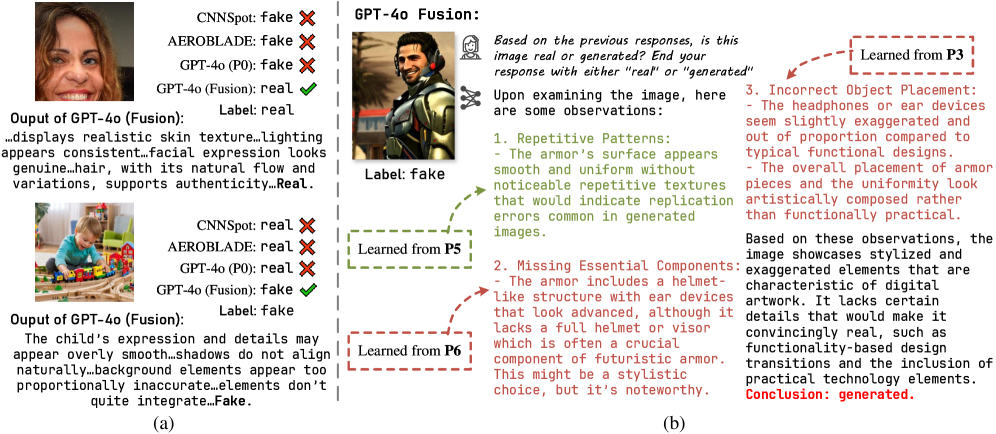

核心思路:利用多模态大语言模型(MLLM)的强大推理能力,将图像检测问题转化为一个推理问题。通过精心设计的提示(Prompt),引导MLLM分析图像内容,并给出判断依据,从而实现可解释的检测。

技术框架:该框架的核心是多模态大语言模型(MLLM)和提示工程。首先,将待检测图像输入MLLM。然后,通过六种不同的提示(Prompt)引导MLLM从不同角度分析图像,例如,图像的真实性、是否存在异常、是否由AI生成等。最后,将MLLM的输出结果进行整合,得到最终的检测结果和解释。

关键创新:该方法的核心创新在于将多模态大语言模型(MLLM)引入到虚假图像检测领域,并利用提示工程来提升检测的可解释性。与传统的黑盒模型相比,该方法能够提供判断依据,增强了用户的信任度。

关键设计:六种提示(Prompt)的设计是关键。这些提示分别从不同的角度引导MLLM分析图像,例如:1) 询问图像是否真实;2) 询问图像中是否存在异常;3) 询问图像是否由AI生成;4) 要求MLLM解释其判断依据;5) 提供一些已知的AI生成图像的特征,让MLLM进行对比;6) 综合以上信息,给出最终的判断结果。具体提示内容未知。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出的基于MLLM的虚假图像检测框架的有效性。实验结果表明,该框架在检测精度上与传统方法相当,但在可解释性方面具有显著优势。与人工评估相比,MLLM在某些情况下甚至能够提供更准确和更全面的解释。具体性能数据未知。

🎯 应用场景

该研究成果可应用于社交媒体平台、新闻媒体机构等,用于检测和识别AI生成的虚假图像,从而维护网络安全,防止虚假信息传播,提升公众对信息的信任度。未来可扩展到视频、音频等其他多媒体内容的真伪鉴别。

📄 摘要(原文)

Progress in image generation raises significant public security concerns. We argue that fake image detection should not operate as a "black box". Instead, an ideal approach must ensure both strong generalization and transparency. Recent progress in Multi-modal Large Language Models (MLLMs) offers new opportunities for reasoning-based AI-generated image detection. In this work, we evaluate the capabilities of MLLMs in comparison to traditional detection methods and human evaluators, highlighting their strengths and limitations. Furthermore, we design six distinct prompts and propose a framework that integrates these prompts to develop a more robust, explainable, and reasoning-driven detection system. The code is available at https://github.com/Gennadiyev/mllm-defake.