Leveraging Automatic CAD Annotations for Supervised Learning in 3D Scene Understanding

作者: Yuchen Rao, Stefan Ainetter, Sinisa Stekovic, Vincent Lepetit, Friedrich Fraundorfer

分类: cs.CV

发布日期: 2025-04-18 (更新: 2025-05-16)

备注: Project page: https://stefan-ainetter.github.io/SCANnotatepp; CVPR'25 Workshop

💡 一句话要点

利用自动CAD标注提升3D场景理解的监督学习性能

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D场景理解 自动标注 CAD模型检索 深度学习 点云补全

📋 核心要点

- 现有3D场景理解方法依赖于耗时且昂贵的手动标注,限制了深度学习模型的训练和泛化能力。

- 本文提出利用自动CAD模型检索技术,为3D场景自动生成高质量的标注数据,作为监督学习的ground truth。

- 实验表明,使用自动标注数据训练的模型在点云补全和单视图CAD模型检索任务上,性能超越了手动标注数据训练的模型。

📝 摘要(中文)

高层次的3D场景理解在许多应用中至关重要。然而,生成精确的3D标注面临挑战,这使得深度学习模型的开发变得困难。本文利用自动检索合成CAD模型的最新进展,展示了由此类方法生成的数据可以作为高质量的ground truth,用于训练监督深度学习模型。具体来说,本文采用类似于先前用于自动标注ScanNet场景中物体的9D姿势和CAD模型的流程。这次,将其应用于最新的ScanNet++ v1数据集,该数据集之前缺乏此类标注。研究结果表明,不仅可以使用这些自动获得的标注来训练深度学习模型,而且由此产生的模型优于在手动标注数据上训练的模型。本文在两个不同的任务上验证了这一点:点云补全和单视图CAD模型检索与对齐。结果强调了自动3D标注在提高模型性能同时显著降低标注成本的潜力。为了支持未来在3D场景理解方面的研究,本文将发布标注数据(SCANnotate++)以及训练好的模型。

🔬 方法详解

问题定义:现有3D场景理解任务,如点云补全和CAD模型检索,依赖于大量的带标注数据。手动标注3D数据成本高昂且耗时,限制了模型训练的规模和泛化能力。因此,如何获取高质量且低成本的3D场景标注数据是一个关键问题。

核心思路:本文的核心思路是利用自动CAD模型检索技术,自动为3D场景中的物体匹配合适的CAD模型,并将其姿态作为标注信息。这种方法可以大规模生成标注数据,且标注质量较高,从而降低了对人工标注的依赖。

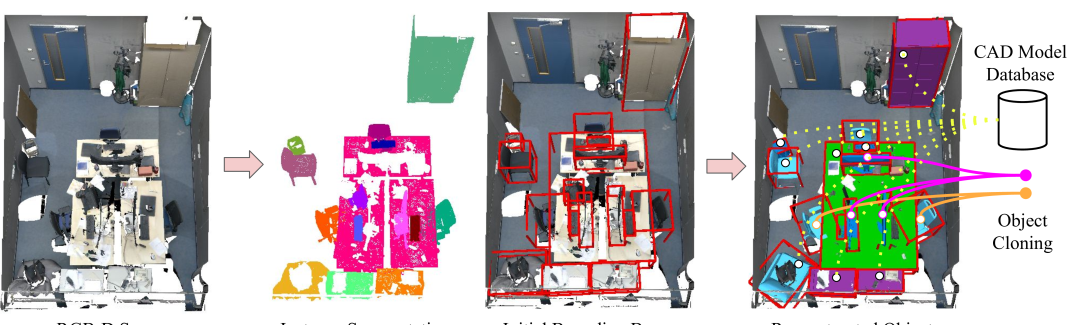

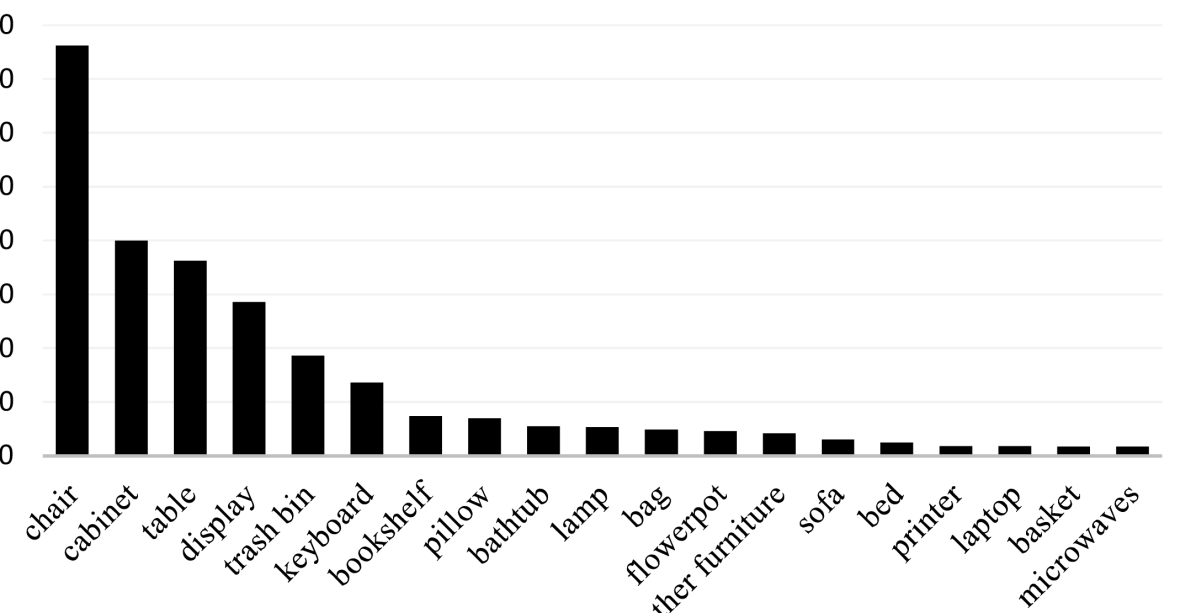

技术框架:本文采用的整体框架类似于之前用于ScanNet场景自动标注的流程。首先,利用现有的3D场景重建技术获取场景的点云数据。然后,使用CAD模型检索算法,从CAD模型库中为场景中的每个物体检索最匹配的CAD模型。接着,估计CAD模型在场景中的9D姿态(3D位置和3D旋转)。最后,将检索到的CAD模型及其姿态作为标注信息,用于训练深度学习模型。

关键创新:本文的关键创新在于将自动CAD模型检索技术应用于ScanNet++ v1数据集,并验证了使用自动标注数据训练的深度学习模型在3D场景理解任务上的有效性。与以往依赖手动标注的方法相比,本文的方法可以显著降低标注成本,并提高模型性能。

关键设计:本文使用了现有的CAD模型检索和姿态估计算法,并针对ScanNet++数据集进行了优化。具体的网络结构和损失函数根据不同的任务(点云补全和单视图CAD模型检索)进行选择和调整。此外,本文还公开了自动生成的标注数据SCANnotate++,以促进该领域的研究。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在点云补全和单视图CAD模型检索与对齐任务上,使用自动标注数据(SCANnotate++)训练的深度学习模型,性能优于使用手动标注数据训练的模型。这表明自动标注数据不仅可以降低标注成本,还可以提高模型性能。具体提升幅度未知,但论文强调了超越手动标注的性能。

🎯 应用场景

该研究成果可广泛应用于机器人导航、自动驾驶、增强现实、虚拟现实等领域。自动生成的3D场景标注数据可以用于训练更鲁棒、更精确的3D场景理解模型,从而提升这些应用的用户体验和性能。例如,在机器人导航中,可以利用该技术帮助机器人更好地理解周围环境,从而实现更安全、更高效的导航。

📄 摘要(原文)

High-level 3D scene understanding is essential in many applications. However, the challenges of generating accurate 3D annotations make development of deep learning models difficult. We turn to recent advancements in automatic retrieval of synthetic CAD models, and show that data generated by such methods can be used as high-quality ground truth for training supervised deep learning models. More exactly, we employ a pipeline akin to the one previously used to automatically annotate objects in ScanNet scenes with their 9D poses and CAD models. This time, we apply it to the recent ScanNet++ v1 dataset, which previously lacked such annotations. Our findings demonstrate that it is not only possible to train deep learning models on these automatically-obtained annotations but that the resulting models outperform those trained on manually annotated data. We validate this on two distinct tasks: point cloud completion and single-view CAD model retrieval and alignment. Our results underscore the potential of automatic 3D annotations to enhance model performance while significantly reducing annotation costs. To support future research in 3D scene understanding, we will release our annotations, which we call SCANnotate++, along with our trained models.