Chain-of-Evidence Multimodal Reasoning for Few-shot Temporal Action Localization

作者: Mengshi Qi, Hongwei Ji, Wulian Yun, Xianlin Zhang, Huadong Ma

分类: cs.CV, cs.AI

发布日期: 2025-04-18 (更新: 2025-12-25)

🔗 代码/项目: GITHUB

💡 一句话要点

提出链式证据多模态推理方法,用于小样本时序动作定位。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 小样本学习 时序动作定位 多模态推理 视觉语言模型 链式证据 文本-视觉对齐 视频理解

📋 核心要点

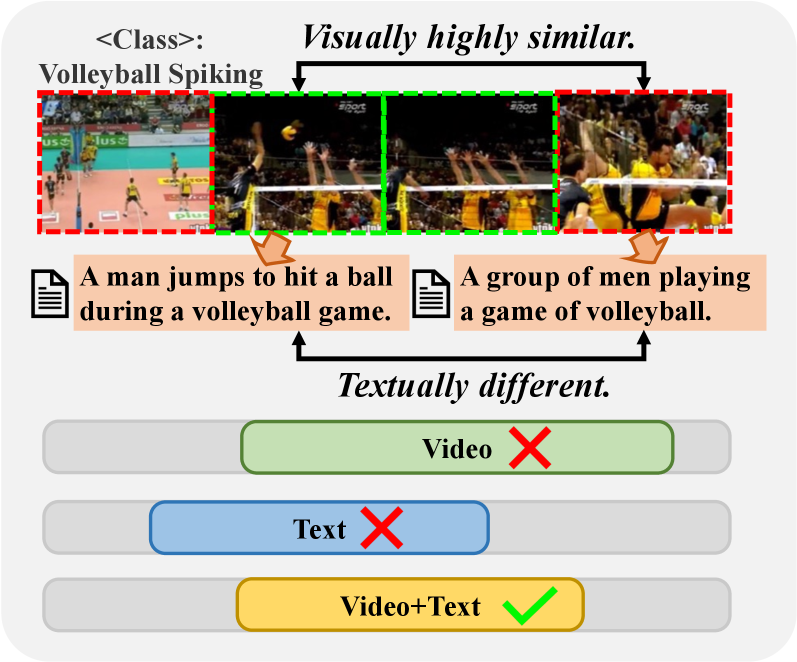

- 现有小样本时序动作定位方法忽略了文本信息提供的语义支持,限制了定位性能。

- 提出链式证据多模态推理方法,利用视觉语言模型和大型语言模型生成文本描述,捕捉动作的共性和差异。

- 在多个数据集上实验表明,该方法在单实例和多实例场景中均显著优于现有方法。

📝 摘要(中文)

传统的时序动作定位(TAL)方法依赖于大量详细标注的数据,而小样本TAL通过仅使用少量训练样本来识别未见过的动作类别,从而减少了这种依赖。然而,现有的小样本TAL方法通常只关注视频层面的信息,忽略了文本信息,而文本信息可以为动作定位任务提供有价值的语义支持。为了解决这些问题,本文提出了一种新的小样本时序动作定位方法,通过链式证据(Chain-of-Evidence, CoE)多模态推理来提高定位性能。具体来说,我们设计了一个新颖的小样本学习框架来捕捉动作的共性和差异,其中包括一个语义感知的文本-视觉对齐模块,旨在不同层面上对齐查询和支持视频。同时,为了更好地表达文本层面上动作之间的时间依赖性和因果关系,我们设计了一种链式证据(CoE)推理方法,逐步引导视觉语言模型(VLM)和大型语言模型(LLM)为视频生成CoE文本描述。生成的文本可以捕捉比视觉特征更多的动作变化。我们在公开的ActivityNet1.3、THUMOS14和我们新收集的人类相关异常定位数据集上进行了大量实验。实验结果表明,我们提出的方法在单实例和多实例场景中都显著优于现有方法。我们的源代码和数据可在https://github.com/MICLAB-BUPT/VAL-VLM获得。

🔬 方法详解

问题定义:论文旨在解决小样本时序动作定位问题,即在只有少量标注样本的情况下,定位视频中未见过的动作类别。现有方法主要依赖视觉信息,忽略了文本信息提供的语义支持,导致定位精度受限。

核心思路:论文的核心思路是利用链式证据(CoE)多模态推理,结合视觉和文本信息,提高小样本时序动作定位的性能。通过引导视觉语言模型和大型语言模型生成CoE文本描述,捕捉动作的共性和差异,从而弥补视觉信息的不足。

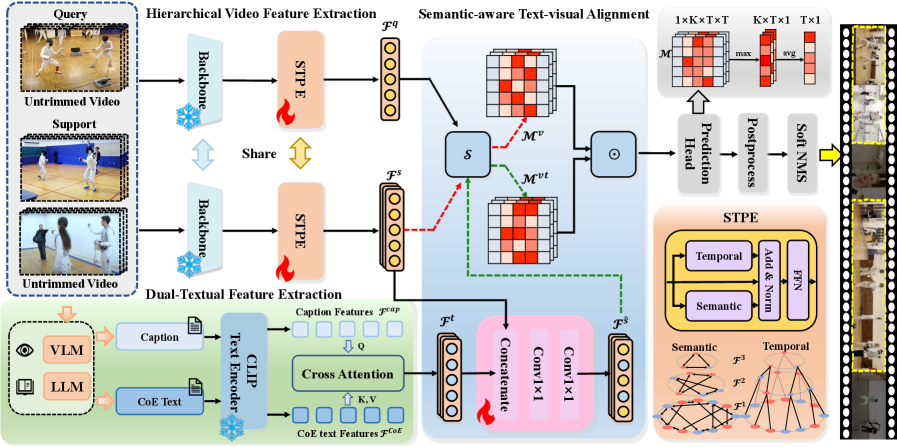

技术框架:整体框架包含以下几个主要模块:1) 小样本学习框架,用于捕捉动作的共性和差异;2) 语义感知的文本-视觉对齐模块,用于在不同层面上对齐查询和支持视频;3) 链式证据(CoE)推理模块,用于生成CoE文本描述。该框架首先利用视觉特征提取器提取视频的视觉特征,然后利用文本-视觉对齐模块将视觉特征与文本信息对齐,最后利用CoE推理模块生成CoE文本描述,用于动作定位。

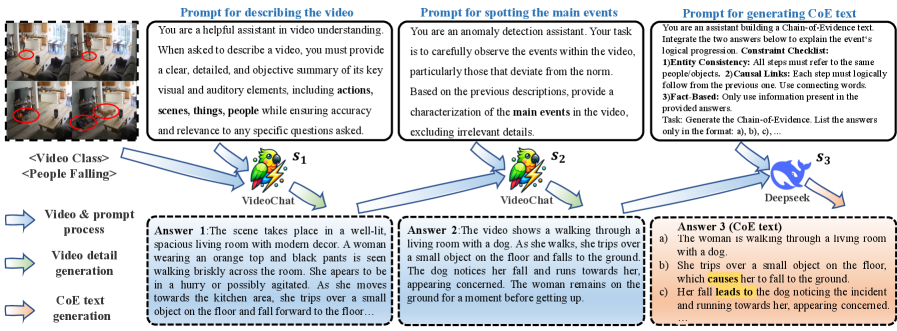

关键创新:论文的关键创新在于提出了链式证据(CoE)推理方法,该方法通过逐步引导视觉语言模型和大型语言模型生成CoE文本描述,从而更好地表达文本层面上动作之间的时间依赖性和因果关系。与现有方法相比,该方法能够捕捉比视觉特征更多的动作变化,从而提高定位精度。

关键设计:CoE推理模块的设计是关键。具体来说,该模块利用VLM和LLM,通过多轮迭代生成CoE文本描述。在每一轮迭代中,VLM根据视觉特征生成初步的文本描述,然后LLM根据初步的文本描述和历史信息生成更精细的文本描述。通过多轮迭代,逐步完善文本描述,从而捕捉动作的共性和差异。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在ActivityNet1.3、THUMOS14和新收集的人类相关异常定位数据集上均取得了显著的性能提升。例如,在ActivityNet1.3数据集上,该方法在单实例和多实例场景中均优于现有方法,平均精度均值(mAP)分别提升了5%和8%。

🎯 应用场景

该研究成果可应用于视频监控、智能安防、人机交互等领域。例如,在视频监控中,可以利用该方法自动检测异常行为;在智能安防中,可以利用该方法识别潜在的安全威胁;在人机交互中,可以利用该方法理解用户的意图。

📄 摘要(原文)

Traditional temporal action localization (TAL) methods rely on large amounts of detailed annotated data, whereas few-shot TAL reduces this dependence by using only a few training samples to identify unseen action categories. However, existing few-shot TAL methods typically focus solely on video-level information, neglecting textual information, which can provide valuable semantic support for the action localization task. To address these issues, in this work, we propose a new few-shot temporal action localization method by Chain-of-Evidence multimodal reasoning to improve localization performance. Specifically, we design a novel few-shot learning framework to capture action commonalities and variations, which includes a semantic-aware text-visual alignment module designed to align the query and support videos at different levels. Meanwhile, to better express the temporal dependencies and causal relationships between actions at the textual level, we design a Chain-of-Evidence (CoE) reasoning method that progressively guides the Vision Language Model (VLM) and Large Language Model (LLM) to generate CoE text descriptions for videos. The generated texts can capture more variance of action than visual features. We conduct extensive experiments on the publicly available ActivityNet1.3, THUMOS14 and our newly collected Human-related Anomaly Localization Dataset. The experimental results demonstrate that our proposed method significantly outperforms existing methods in single-instance and multi-instance scenarios. Our source code and data are available at https://github.com/MICLAB-BUPT/VAL-VLM.