Training-Free Hierarchical Scene Understanding for Gaussian Splatting with Superpoint Graphs

作者: Shaohui Dai, Yansong Qu, Zheyan Li, Xinyang Li, Shengchuan Zhang, Liujuan Cao

分类: cs.CV

发布日期: 2025-04-17

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于超点图的无训练高斯溅射场景理解框架,提升语义一致性与效率。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 场景理解 超点图 开放词汇分割 无训练学习 3D语义一致性 层级场景理解

📋 核心要点

- 现有方法依赖于逐视角2D语义特征图的迭代优化,导致效率低下和跨视角3D语义不一致。

- 通过从高斯基元构建超点图,将场景分割成语义连贯的区域,实现视角一致的3D实体表示。

- 实验表明,该方法在开放词汇分割任务上达到SOTA,且语义场重建速度提升超过30倍。

📝 摘要(中文)

本文提出了一种无训练框架,用于高斯溅射(3DGS)的层级场景理解,旨在弥合自然语言和3D几何之间的差距。该框架直接从高斯基元构建超点图,将场景划分为空间紧凑且语义连贯的区域,形成视角一致的3D实体,为开放词汇理解提供结构化基础。基于图结构,设计了一种高效的重投影策略,将2D语义特征提升到超点上,避免了代价高昂的多视角迭代训练。由此产生的表示确保了强大的3D语义连贯性,并自然地支持层级理解,从而在统一的语义场中实现粗粒度和细粒度的开放词汇感知。实验表明,该方法实现了最先进的开放词汇分割性能,语义场重建速度提高了30倍以上。

🔬 方法详解

问题定义:现有基于3D高斯溅射的场景理解方法,特别是结合开放词汇语义理解的方法,通常需要对每个视角的2D语义特征图进行迭代优化。这种方法计算成本高昂,并且难以保证跨视角的3D语义一致性,导致最终的场景理解结果不够准确和高效。

核心思路:本文的核心思路是直接从3D高斯基元构建超点图,将场景分割成空间紧凑且语义连贯的区域。每个超点代表一个3D实体,通过图结构连接相邻的超点。这种基于图的表示方法能够有效地捕捉场景的结构信息,并促进跨视角的语义一致性。

技术框架:该框架主要包含以下几个阶段:1) 从3D高斯溅射重建的场景中提取高斯基元;2) 基于高斯基元之间的空间关系和特征相似性构建超点图;3) 利用设计的重投影策略,将2D语义特征提升到超点上,为每个超点赋予语义标签;4) 基于超点图进行层级场景理解,包括粗粒度和细粒度的开放词汇感知。

关键创新:该方法最关键的创新在于提出了一个无训练的框架,直接从3D高斯基元构建超点图,避免了耗时的多视角迭代训练。通过超点图结构,实现了视角一致的3D语义表示,并支持层级场景理解。与现有方法相比,该方法在效率和语义一致性方面都有显著提升。

关键设计:超点图的构建依赖于高斯基元之间的空间距离和特征相似度。具体来说,可以使用K-最近邻算法或基于距离的聚类算法来确定相邻的高斯基元,并将其合并成超点。重投影策略的设计需要考虑视角变换和遮挡关系,可以使用加权平均或投票机制来融合不同视角的2D语义特征。

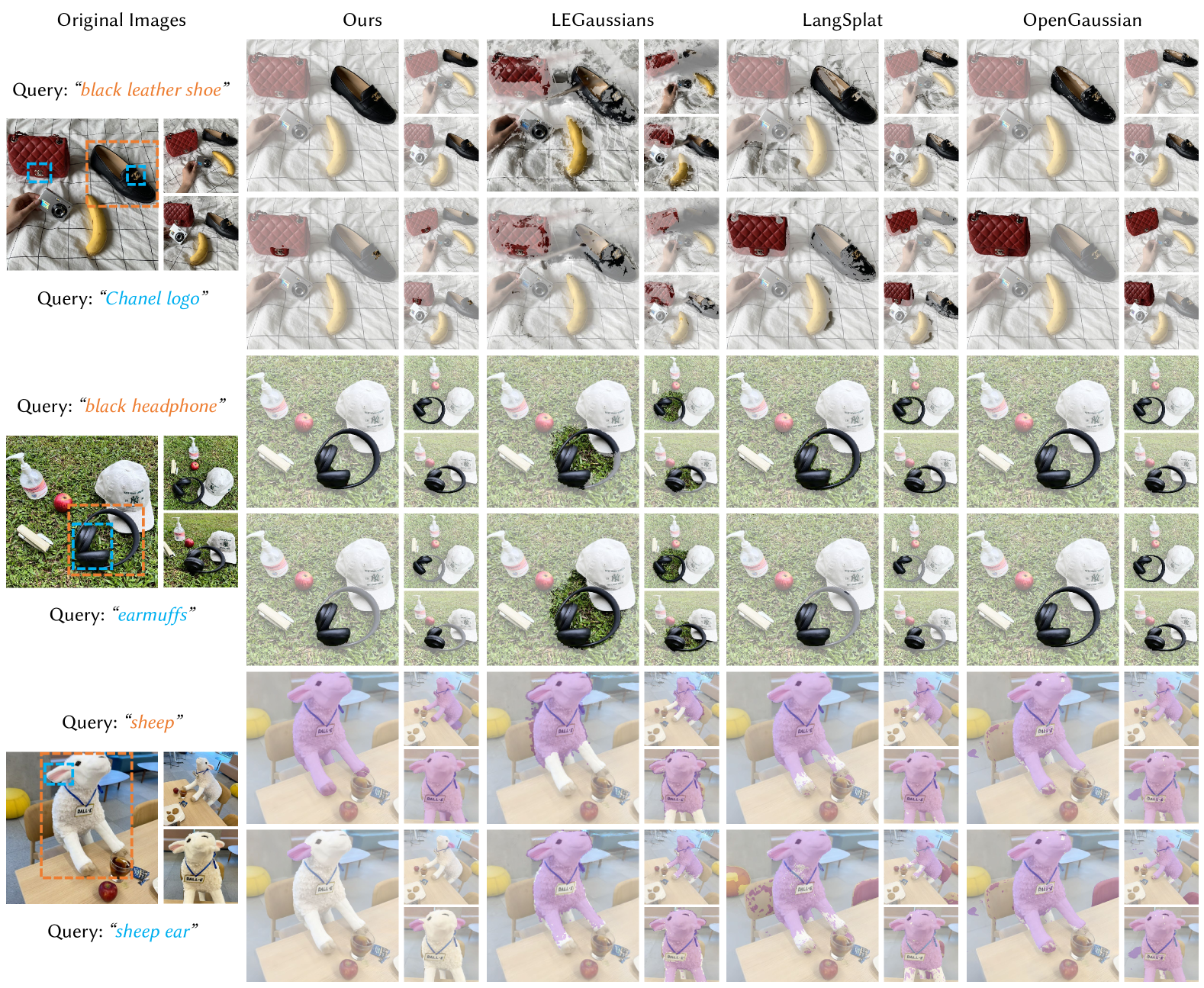

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在开放词汇分割任务上取得了state-of-the-art的性能,并且语义场重建速度比现有方法提高了30倍以上。这表明该方法在效率和准确性方面都具有显著优势,为3D场景理解领域带来了重要的进展。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、虚拟现实/增强现实等领域。通过对3D场景进行高效且语义一致的理解,机器人可以更好地感知周围环境,从而实现更智能的决策和行为。在VR/AR应用中,可以提供更逼真和交互性更强的体验。

📄 摘要(原文)

Bridging natural language and 3D geometry is a crucial step toward flexible, language-driven scene understanding. While recent advances in 3D Gaussian Splatting (3DGS) have enabled fast and high-quality scene reconstruction, research has also explored incorporating open-vocabulary understanding into 3DGS. However, most existing methods require iterative optimization over per-view 2D semantic feature maps, which not only results in inefficiencies but also leads to inconsistent 3D semantics across views. To address these limitations, we introduce a training-free framework that constructs a superpoint graph directly from Gaussian primitives. The superpoint graph partitions the scene into spatially compact and semantically coherent regions, forming view-consistent 3D entities and providing a structured foundation for open-vocabulary understanding. Based on the graph structure, we design an efficient reprojection strategy that lifts 2D semantic features onto the superpoints, avoiding costly multi-view iterative training. The resulting representation ensures strong 3D semantic coherence and naturally supports hierarchical understanding, enabling both coarse- and fine-grained open-vocabulary perception within a unified semantic field. Extensive experiments demonstrate that our method achieves state-of-the-art open-vocabulary segmentation performance, with semantic field reconstruction completed over $30\times$ faster. Our code will be available at https://github.com/Atrovast/THGS.