EchoWorld: Learning Motion-Aware World Models for Echocardiography Probe Guidance

作者: Yang Yue, Yulin Wang, Haojun Jiang, Pan Liu, Shiji Song, Gao Huang

分类: cs.CV

发布日期: 2025-04-17

备注: Accepted by CVPR 2025

🔗 代码/项目: GITHUB

💡 一句话要点

EchoWorld:学习运动感知世界模型,用于超声心动图探头引导

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 超声心动图 探头引导 世界模型 运动感知 注意力机制

📋 核心要点

- 超声心动图探头引导依赖专家经验,现有AI模型难以有效理解心脏解剖结构和探头运动的复杂关系。

- EchoWorld通过运动感知世界建模,编码解剖知识和运动引起的视觉动态,利用历史视觉-运动序列提升引导精度。

- 实验表明,EchoWorld在超过百万张超声图像上训练后,显著降低了引导误差,优于现有视觉骨干网络和引导框架。

📝 摘要(中文)

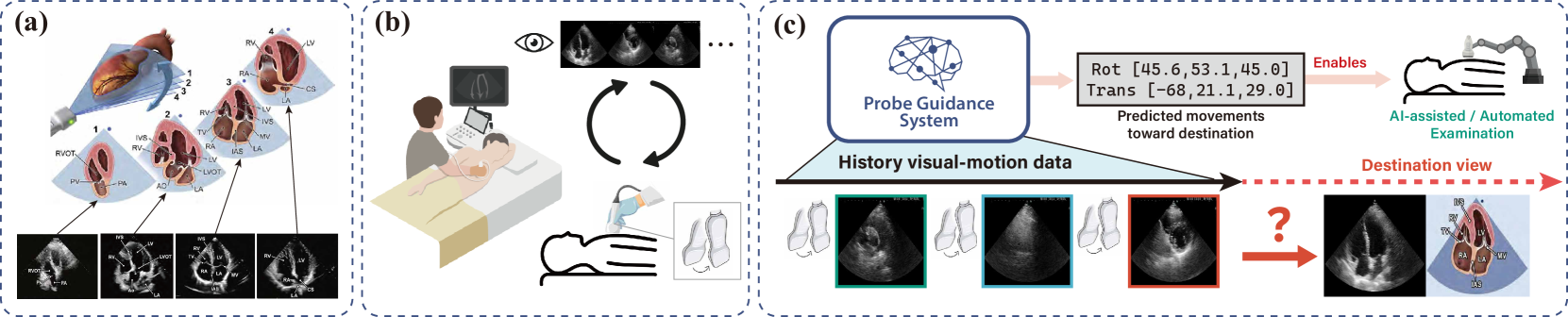

超声心动图对于心血管疾病的检测至关重要,但非常依赖经验丰富的超声医师。超声心动图探头引导系统为获取标准平面图像提供实时运动指导,为AI辅助或完全自主扫描提供了一种有前景的解决方案。然而,为此任务开发有效的机器学习模型仍然具有挑战性,因为它们必须掌握心脏解剖结构以及探头运动和视觉信号之间复杂的相互作用。为了解决这个问题,我们提出了EchoWorld,一个运动感知的世界建模框架,用于探头引导,它编码了解剖学知识和运动引起的视觉动态,同时有效地利用过去的视觉-运动序列来提高引导精度。EchoWorld采用了一种受世界建模原则启发的预训练策略,模型预测被掩盖的解剖区域并模拟探头调整的视觉结果。在此预训练模型的基础上,我们在微调阶段引入了一种运动感知的注意力机制,有效地整合了历史视觉-运动数据,从而实现精确和自适应的探头引导。EchoWorld在来自200多次常规扫描的超过一百万张超声图像上进行训练,有效地捕获了关键的超声心动图知识,并通过定性分析验证。此外,与现有的视觉骨干网络和引导框架相比,我们的方法显著降低了引导误差,在单帧和序列评估协议中均表现出色。

🔬 方法详解

问题定义:论文旨在解决超声心动图探头引导问题,现有方法难以有效建模探头运动与超声图像之间的复杂关系,导致引导精度不足,依赖于经验丰富的超声医师。现有方法的痛点在于缺乏对心脏解剖结构和探头运动引起视觉变化的有效建模。

核心思路:论文的核心思路是构建一个运动感知的世界模型,该模型能够编码心脏的解剖知识,并学习探头运动如何影响超声图像的视觉表现。通过预训练和微调,模型能够预测探头调整后的视觉结果,并利用历史视觉-运动数据来提高引导精度。这样设计的目的是为了让模型能够像人类专家一样,理解探头运动与图像变化之间的关系,从而实现更精确的引导。

技术框架:EchoWorld框架包含预训练和微调两个阶段。在预训练阶段,模型学习预测被掩盖的解剖区域和模拟探头调整的视觉结果。在微调阶段,引入运动感知的注意力机制,整合历史视觉-运动数据,用于精确的探头引导。整体流程是:输入超声图像和探头运动信息,经过预训练模型提取特征,然后通过运动感知注意力机制整合历史信息,最后输出探头引导指令。

关键创新:论文最重要的技术创新点在于提出了运动感知的世界建模框架,该框架能够同时编码解剖知识和运动引起的视觉动态。与现有方法相比,EchoWorld能够更有效地利用历史视觉-运动数据,从而实现更精确和自适应的探头引导。运动感知注意力机制是另一个关键创新,它能够有效地整合历史信息,提高引导的鲁棒性。

关键设计:预训练阶段采用掩码自编码器(Masked Autoencoder)结构,用于预测被掩盖的解剖区域。损失函数包括重建损失和对比学习损失,用于提高特征的表达能力。运动感知注意力机制采用Transformer结构,用于整合历史视觉-运动数据。微调阶段采用交叉熵损失函数,用于优化探头引导指令的预测。

🖼️ 关键图片

📊 实验亮点

EchoWorld在超过一百万张超声图像上进行了训练,实验结果表明,与现有的视觉骨干网络和引导框架相比,EchoWorld显著降低了引导误差。定性分析验证了EchoWorld能够有效地捕获关键的超声心动图知识。在单帧和序列评估协议中,EchoWorld均表现出色,证明了其在实际应用中的潜力。

🎯 应用场景

EchoWorld具有广泛的应用前景,可用于AI辅助超声心动图扫描,降低对超声医师经验的依赖,提高诊断效率和准确性。该技术还可以应用于远程医疗,使非专业人员能够在专家的指导下进行超声扫描。未来,EchoWorld有望实现完全自主的超声心动图扫描,为心血管疾病的早期筛查和诊断提供更便捷的解决方案。

📄 摘要(原文)

Echocardiography is crucial for cardiovascular disease detection but relies heavily on experienced sonographers. Echocardiography probe guidance systems, which provide real-time movement instructions for acquiring standard plane images, offer a promising solution for AI-assisted or fully autonomous scanning. However, developing effective machine learning models for this task remains challenging, as they must grasp heart anatomy and the intricate interplay between probe motion and visual signals. To address this, we present EchoWorld, a motion-aware world modeling framework for probe guidance that encodes anatomical knowledge and motion-induced visual dynamics, while effectively leveraging past visual-motion sequences to enhance guidance precision. EchoWorld employs a pre-training strategy inspired by world modeling principles, where the model predicts masked anatomical regions and simulates the visual outcomes of probe adjustments. Built upon this pre-trained model, we introduce a motion-aware attention mechanism in the fine-tuning stage that effectively integrates historical visual-motion data, enabling precise and adaptive probe guidance. Trained on more than one million ultrasound images from over 200 routine scans, EchoWorld effectively captures key echocardiographic knowledge, as validated by qualitative analysis. Moreover, our method significantly reduces guidance errors compared to existing visual backbones and guidance frameworks, excelling in both single-frame and sequential evaluation protocols. Code is available at https://github.com/LeapLabTHU/EchoWorld.