LAD-Reasoner: Tiny Multimodal Models are Good Reasoners for Logical Anomaly Detection

作者: Weijia Li, Guanglei Chu, Jiong Chen, Guo-Sen Xie, Caifeng Shan, Fang Zhao

分类: cs.CV

发布日期: 2025-04-17

💡 一句话要点

LAD-Reasoner:提出一种基于小型多模态模型的逻辑异常检测方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 逻辑异常检测 多模态学习 小型模型 可解释性 强化学习 视觉语言模型 工业异常检测

📋 核心要点

- 现有工业异常检测方法依赖大型推理模块或复杂流程,导致部署困难且缺乏可解释性。

- LAD-Reasoner基于小型多模态模型,通过两阶段训练,实现逻辑异常检测和可解释推理。

- 实验表明,LAD-Reasoner在精度和F1值上与大型模型相当,并能生成更简洁的解释。

📝 摘要(中文)

工业异常检测领域日益需要更深入的逻辑异常分析,即识别和解释对象、计数和空间配置之间意外关系。现有方法通常依赖于大规模外部推理模块或复杂的pipeline设计,限制了实际部署和可解释性。为解决这些局限,本文引入了一个新任务:推理逻辑异常检测(RLAD),它通过结合逻辑推理扩展了传统异常检测。我们提出了一个新框架LAD-Reasoner,这是一个基于Qwen2.5-VL 3B定制的小型多模态语言模型。我们的方法采用两阶段训练范式,首先使用监督微调(SFT)进行细粒度的视觉理解,然后使用组相对策略优化(GRPO)来改进逻辑异常检测并强制执行连贯的、人类可读的推理。至关重要的是,奖励信号来自检测精度和输出的结构质量,无需构建思维链(CoT)推理数据。在MVTec LOCO AD数据集上的实验表明,LAD-Reasoner虽然规模小得多,但在准确率和F1分数上与Qwen2.5-VL-72B的性能相匹配,并且在生成简洁且可解释的理由方面表现更出色。这种统一的设计减少了对大型模型和复杂pipeline的依赖,同时提供了对逻辑异常检测的透明且可解释的见解。代码和数据将会开源。

🔬 方法详解

问题定义:论文旨在解决工业场景中逻辑异常检测问题,即识别对象间、计数间以及空间配置间的不合理关系。现有方法依赖于大型外部推理模块或复杂的pipeline,导致部署困难,可解释性差,且计算成本高昂。

核心思路:论文的核心思路是利用小型多模态模型,通过定制化的训练方法,使其具备逻辑推理能力,从而在保证性能的同时,降低计算成本,提高可解释性。这种设计避免了对大型模型的依赖,并简化了推理流程。

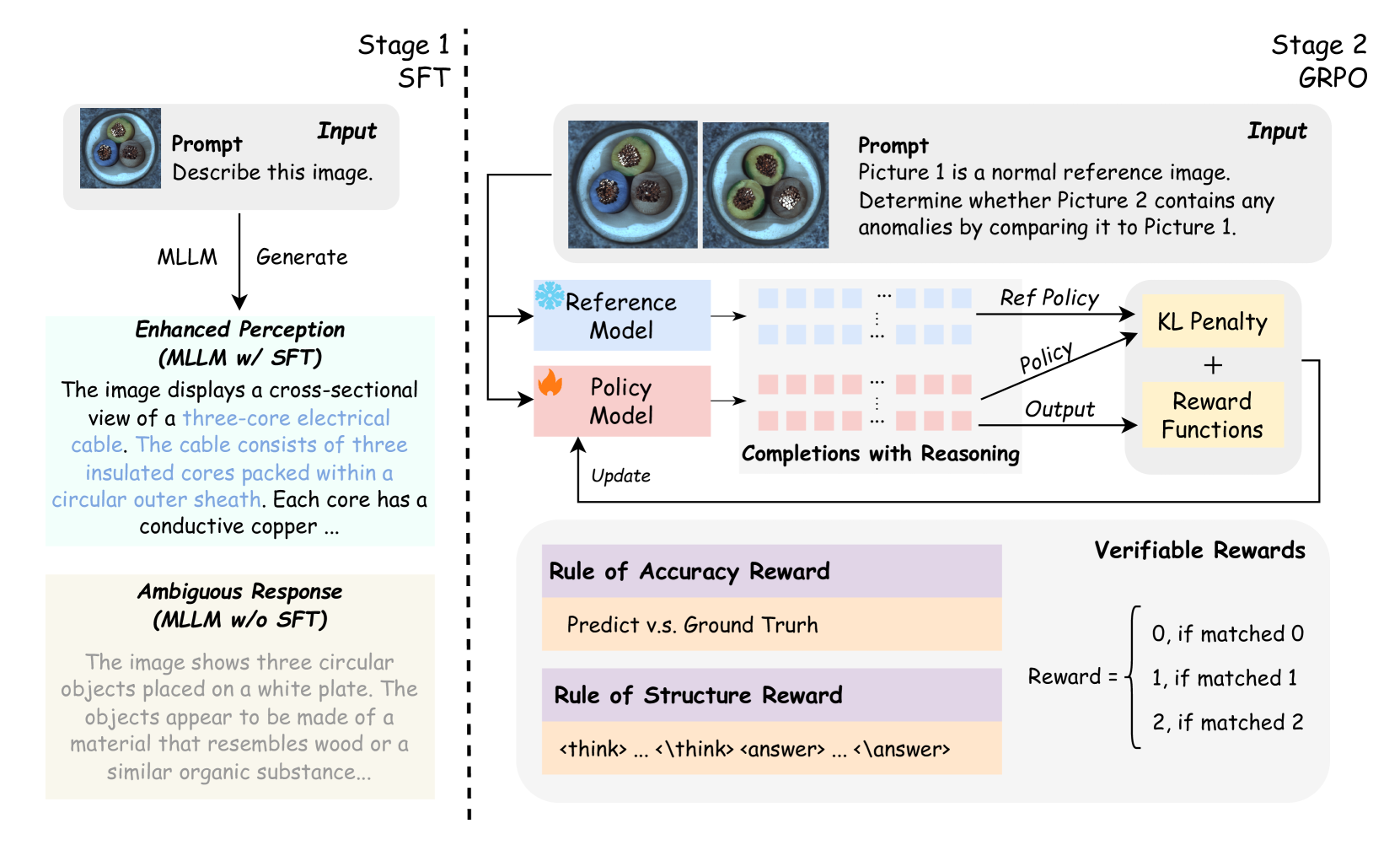

技术框架:LAD-Reasoner框架主要包含两个阶段:1) 监督微调(SFT):使用标注数据对Qwen2.5-VL 3B模型进行微调,使其具备细粒度的视觉理解能力。2) 组相对策略优化(GRPO):利用强化学习,优化模型的逻辑异常检测能力,并鼓励生成连贯、人类可读的推理过程。奖励信号来自检测准确率和输出结构的质量。

关键创新:该方法最重要的创新点在于使用小型多模态模型实现逻辑异常检测,并通过GRPO训练,在不需要构建CoT数据的情况下,提升模型的推理能力和可解释性。与现有方法相比,该方法降低了模型规模和计算成本,同时提高了推理过程的透明度。

关键设计:GRPO阶段的关键设计在于奖励函数的设计,它同时考虑了检测准确率和输出结构的质量。具体来说,奖励函数鼓励模型生成简洁、连贯的推理过程,避免冗余和不相关的解释。此外,论文还探索了不同的组相对策略,以提高训练的稳定性和效率。模型基于Qwen2.5-VL 3B,这是一个相对较小的视觉语言模型,易于部署和微调。

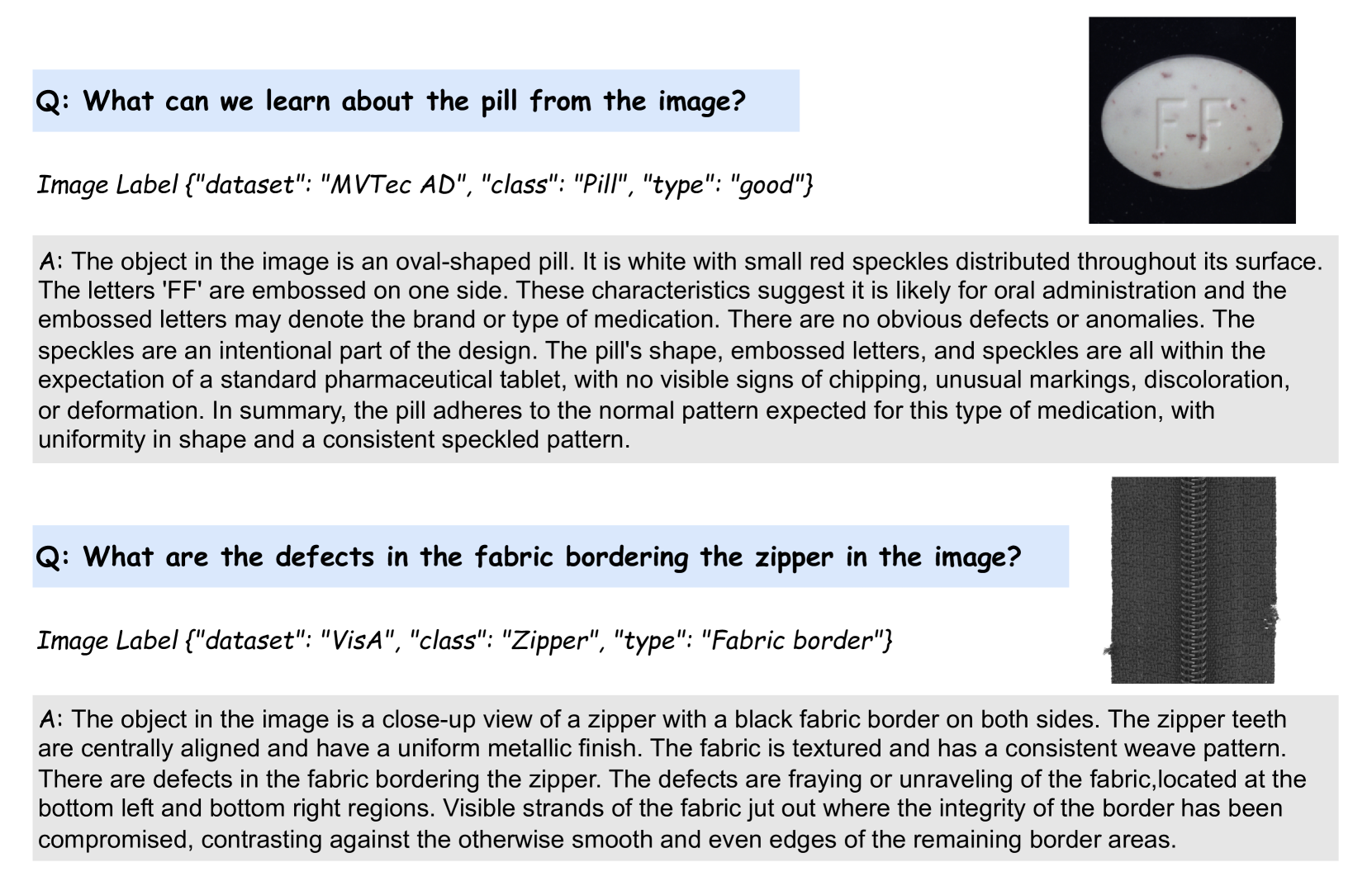

🖼️ 关键图片

📊 实验亮点

实验结果表明,LAD-Reasoner在MVTec LOCO AD数据集上,以远小于Qwen2.5-VL-72B的模型规模,达到了与其相当的准确率和F1分数。更重要的是,LAD-Reasoner能够生成更简洁、更易于理解的推理过程,显著提升了模型的可解释性。这表明小型多模态模型在逻辑异常检测任务中具有巨大的潜力。

🎯 应用场景

该研究成果可应用于工业生产线的质量检测、智能监控系统、医疗影像分析等领域。通过自动检测和解释逻辑异常,可以提高生产效率、降低错误率,并为决策提供更可靠的依据。未来,该方法有望扩展到更复杂的场景,例如智能交通、金融风控等。

📄 摘要(原文)

Recent advances in industrial anomaly detection have highlighted the need for deeper logical anomaly analysis, where unexpected relationships among objects, counts, and spatial configurations must be identified and explained. Existing approaches often rely on large-scale external reasoning modules or elaborate pipeline designs, hindering practical deployment and interpretability. To address these limitations, we introduce a new task, Reasoning Logical Anomaly Detection (RLAD), which extends traditional anomaly detection by incorporating logical reasoning. We propose a new framework, LAD-Reasoner, a customized tiny multimodal language model built on Qwen2.5-VL 3B. Our approach leverages a two-stage training paradigm that first employs Supervised Fine-Tuning (SFT) for fine-grained visual understanding, followed by Group Relative Policy Optimization (GRPO) to refine logical anomaly detection and enforce coherent, human-readable reasoning. Crucially, reward signals are derived from both the detection accuracy and the structural quality of the outputs, obviating the need for building chain of thought (CoT) reasoning data. Experiments on the MVTec LOCO AD dataset show that LAD-Reasoner, though significantly smaller, matches the performance of Qwen2.5-VL-72B in accuracy and F1 score, and further excels in producing concise and interpretable rationales. This unified design reduces reliance on large models and complex pipelines, while offering transparent and interpretable insights into logical anomaly detection. Code and data will be released.