TongUI: Internet-Scale Trajectories from Multimodal Web Tutorials for Generalized GUI Agents

作者: Bofei Zhang, Zirui Shang, Zhi Gao, Wang Zhang, Rui Xie, Xiaojian Ma, Tao Yuan, Xinxiao Wu, Song-Chun Zhu, Qing Li

分类: cs.CV

发布日期: 2025-04-17 (更新: 2025-12-04)

备注: AAAI 2026

💡 一句话要点

TongUI:利用多模态Web教程构建通用GUI代理,解决轨迹数据匮乏难题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GUI代理 多模态学习 Web教程 轨迹数据 自动化标注

📋 核心要点

- 构建通用GUI代理面临的主要挑战是缺乏足够的训练数据,特别是跨不同操作系统和应用程序的轨迹数据,而手动标注成本高昂。

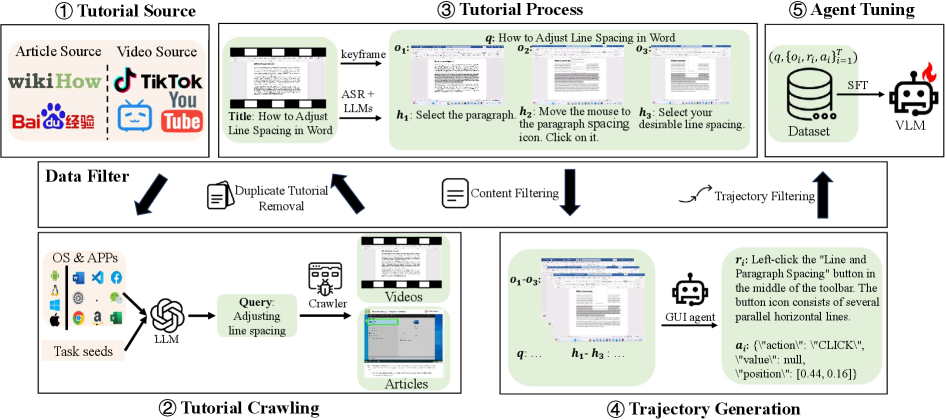

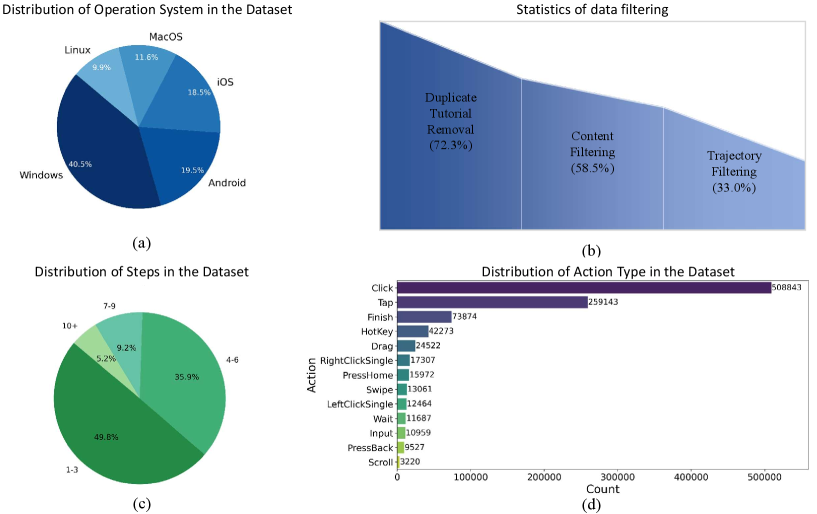

- TongUI框架的核心思想是从互联网上抓取并处理多模态GUI教程(如视频和文章),自动生成GUI代理的轨迹数据,从而低成本地扩充训练数据。

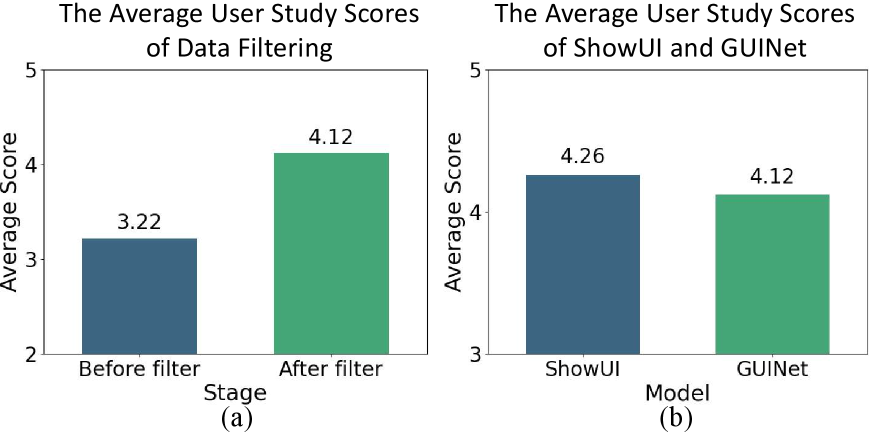

- 通过在GUI-Net数据集上微调Qwen2.5-VL模型,TongUI代理在多个GUI任务基准测试中取得了显著的性能提升,超越现有基线模型约10%。

📝 摘要(中文)

本文提出了TongUI框架,旨在通过学习丰富的多模态Web教程来构建通用的图形用户界面(GUI)代理。由于手动标注成本高昂,开发通用GUI代理的主要挑战在于缺乏跨操作系统和应用程序的充足轨迹数据。TongUI框架通过爬取和处理在线GUI教程(如视频和文章),将其转化为GUI代理的轨迹数据。由此,作者构建了GUI-Net数据集,包含跨五个操作系统和200多个应用程序的14.3万条轨迹数据。通过在GUI-Net上微调Qwen2.5-VL-3B/7B模型,开发了TongUI代理。实验结果表明,TongUI代理在常用的grounding和navigation基准测试中表现出显著的性能提升,在多个基准测试中优于基线代理约10%,验证了GUI-Net数据集的有效性,并突显了TongUI框架的重要性。代码、GUI-Net数据集和训练好的模型即将完全开源。

🔬 方法详解

问题定义:现有的GUI代理开发面临数据匮乏的问题,尤其缺乏跨平台、跨应用的轨迹数据。手动标注成本高昂,难以支撑通用GUI代理的训练。因此,如何低成本、大规模地获取高质量的GUI交互数据是亟待解决的问题。

核心思路:论文的核心思路是利用互联网上已有的丰富多模态GUI教程(例如视频、文章),通过自动化的方式将这些教程转化为GUI代理可以学习的轨迹数据。这种方法避免了高成本的人工标注,能够大规模地扩充训练数据。

技术框架:TongUI框架主要包含以下几个阶段:1) 数据爬取:从互联网上爬取GUI相关的教程,包括视频和文章。2) 数据处理:对爬取到的数据进行清洗、解析和结构化,提取出GUI操作的步骤和相关信息。3) 轨迹生成:将处理后的数据转化为GUI代理可以学习的轨迹数据,包括GUI状态、操作指令等。4) 模型训练:使用生成的轨迹数据训练GUI代理模型,例如Qwen2.5-VL。

关键创新:该论文的关键创新在于提出了一种利用互联网上已有的多模态数据来自动生成GUI代理训练数据的方法。与传统的依赖人工标注的方法相比,该方法能够显著降低数据获取的成本,并能够大规模地扩充训练数据。

关键设计:论文的关键设计包括:1) 如何有效地从视频和文章中提取GUI操作步骤和相关信息;2) 如何将提取到的信息转化为GUI代理可以学习的轨迹数据;3) 如何选择合适的模型(例如Qwen2.5-VL)并在生成的轨迹数据上进行微调。具体的数据处理和轨迹生成算法细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过在GUI-Net数据集上微调Qwen2.5-VL-3B/7B模型,TongUI代理在常用的grounding和navigation基准测试中表现出显著的性能提升,在多个基准测试中优于基线代理约10%。这验证了GUI-Net数据集的有效性,并突显了TongUI框架的重要性。

🎯 应用场景

该研究成果可应用于开发智能化的GUI代理,例如自动化测试工具、智能助手、以及能够辅助残疾人操作计算机的辅助技术。通过学习大量的GUI交互数据,GUI代理可以模拟人类的操作行为,自动完成各种GUI任务,提高工作效率和用户体验。未来,该技术有望应用于更广泛的领域,例如智能家居控制、自动驾驶等。

📄 摘要(原文)

Building Graphical User Interface (GUI) agents is a promising research direction, which simulates human interaction with computers or mobile phones to perform diverse GUI tasks. However, a major challenge in developing generalized GUI agents is the lack of sufficient trajectory data across various operating systems and applications, mainly due to the high cost of manual annotations. In this paper, we propose the TongUI framework that builds generalized GUI agents by learning from rich multimodal web tutorials. Concretely, we crawl and process online GUI tutorials (such as videos and articles) into GUI agent trajectory data, through which we produce the GUI-Net dataset containing 143K trajectory data across five operating systems and more than 200 applications. We develop the TongUI agent by fine-tuning Qwen2.5-VL-3B/7B models on GUI-Net, which show remarkable performance improvements on commonly used grounding and navigation benchmarks, outperforming baseline agents about 10\% on multiple benchmarks, showing the effectiveness of the GUI-Net dataset and underscoring the significance of our TongUI framework. We will fully open-source the code, the GUI-Net dataset, and the trained models soon.