WorldMem: Long-term Consistent World Simulation with Memory

作者: Zeqi Xiao, Yushi Lan, Yifan Zhou, Wenqi Ouyang, Shuai Yang, Yanhong Zeng, Xingang Pan

分类: cs.CV

发布日期: 2025-04-16 (更新: 2026-01-01)

备注: Project page at https://xizaoqu.github.io/worldmem/

💡 一句话要点

WorldMem:利用记忆机制实现长期一致的世界模拟

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 世界模拟 长期一致性 记忆机制 注意力机制 场景生成

📋 核心要点

- 现有世界模拟方法在长期时间跨度下难以保持场景一致性,尤其是在3D空间结构上。

- WorldMem通过引入记忆库,存储历史帧及其状态,利用注意力机制提取相关信息,实现长期一致性。

- 实验表明,WorldMem能够准确重建先前观察到的场景,并捕捉场景随时间的动态变化。

📝 摘要(中文)

世界模拟因其对虚拟环境建模和预测行为后果的能力而日益普及。然而,有限的时间上下文窗口常常导致在保持长期一致性方面的失败,尤其是在保持3D空间一致性方面。本文提出了WorldMem,一个通过记忆库增强场景生成的框架,该记忆库由存储记忆帧和状态(例如,姿势和时间戳)的记忆单元组成。通过采用一种记忆注意力机制,该机制能够根据记忆帧的状态有效地提取相关信息,我们的方法能够准确地重建先前观察到的场景,即使在显著的视点或时间间隔下也是如此。此外,通过将时间戳纳入状态,我们的框架不仅对静态世界进行建模,还捕捉其随时间的动态演变,从而实现模拟世界中的感知和交互。在虚拟和真实场景中的大量实验验证了我们方法的有效性。

🔬 方法详解

问题定义:现有世界模拟方法受限于时间上下文窗口,难以维持长期一致性,尤其是在视角变化或时间间隔较大时,容易出现3D空间结构的不一致。这限制了其在需要长期记忆和推理的应用中的潜力。

核心思路:WorldMem的核心在于引入一个记忆库,用于存储历史观测到的场景帧及其对应的状态信息(如姿态和时间戳)。通过记忆注意力机制,模型可以从记忆库中检索与当前场景最相关的历史信息,从而弥补时间上下文的不足,保持长期一致性。

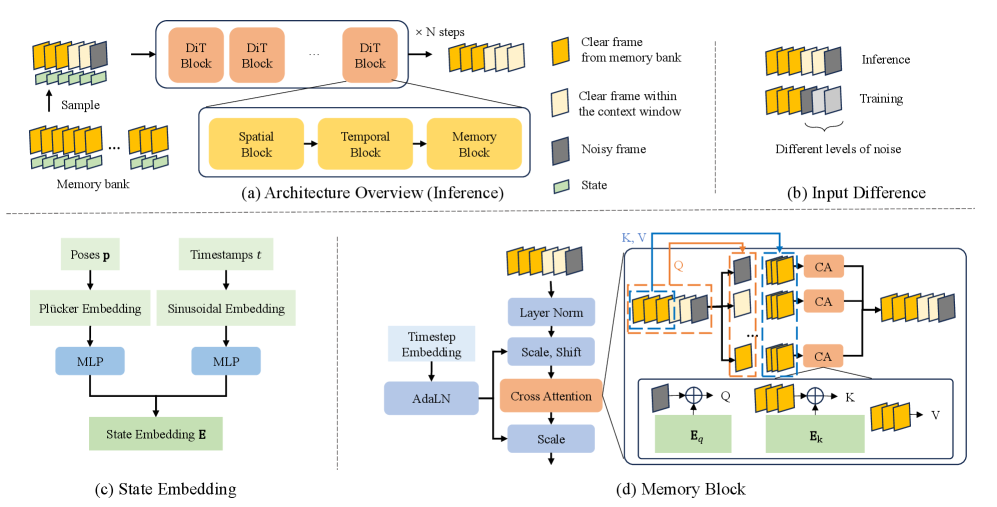

技术框架:WorldMem框架包含以下主要模块:1) 记忆库:存储历史帧及其状态信息;2) 记忆注意力机制:根据当前帧的状态,从记忆库中检索相关帧;3) 场景生成器:利用当前帧和检索到的记忆帧生成场景。整体流程是,首先将观测到的场景帧及其状态存入记忆库,然后利用记忆注意力机制从记忆库中检索相关帧,最后将当前帧和检索到的记忆帧输入到场景生成器中,生成最终的场景。

关键创新:WorldMem的关键创新在于将记忆机制引入到世界模拟中,并设计了记忆注意力机制,使得模型能够有效地利用历史信息,从而保持长期一致性。与现有方法相比,WorldMem能够处理更长的时间跨度,并更好地应对视角变化和时间间隔带来的挑战。

关键设计:记忆注意力机制的设计是关键。具体来说,模型使用当前帧的状态信息作为query,记忆库中存储的历史帧的状态信息作为key,通过计算query和key之间的相似度,得到注意力权重。然后,利用注意力权重对记忆库中的历史帧进行加权求和,得到最终的记忆表示。此外,时间戳的引入使得模型能够捕捉场景随时间的动态变化。

🖼️ 关键图片

📊 实验亮点

论文在虚拟和真实场景中进行了大量实验,验证了WorldMem的有效性。实验结果表明,WorldMem能够显著提高场景重建的准确性和一致性,尤其是在视角变化和时间间隔较大时。与现有方法相比,WorldMem在长期一致性方面取得了显著的提升,能够更好地捕捉场景随时间的动态变化。

🎯 应用场景

WorldMem可应用于增强现实、虚拟现实、机器人导航、自动驾驶等领域。例如,在增强现实中,WorldMem可以帮助用户在长时间内保持对虚拟对象的空间感知;在机器人导航中,WorldMem可以帮助机器人记住之前探索过的环境,从而更好地规划路径。该研究的潜在价值在于提升了世界模拟的真实感和实用性,为未来的智能应用奠定了基础。

📄 摘要(原文)

World simulation has gained increasing popularity due to its ability to model virtual environments and predict the consequences of actions. However, the limited temporal context window often leads to failures in maintaining long-term consistency, particularly in preserving 3D spatial consistency. In this work, we present WorldMem, a framework that enhances scene generation with a memory bank consisting of memory units that store memory frames and states (e.g., poses and timestamps). By employing a memory attention mechanism that effectively extracts relevant information from these memory frames based on their states, our method is capable of accurately reconstructing previously observed scenes, even under significant viewpoint or temporal gaps. Furthermore, by incorporating timestamps into the states, our framework not only models a static world but also captures its dynamic evolution over time, enabling both perception and interaction within the simulated world. Extensive experiments in both virtual and real scenarios validate the effectiveness of our approach.