Hearing Anywhere in Any Environment

作者: Xiulong Liu, Anurag Kumar, Paul Calamia, Sebastia V. Amengual, Calvin Murdock, Ishwarya Ananthabhotla, Philip Robinson, Eli Shlizerman, Vamsi Krishna Ithapu, Ruohan Gao

分类: cs.CV, cs.AI, cs.LG, cs.SD, eess.AS

发布日期: 2025-04-14 (更新: 2025-06-04)

备注: CVPR 2025; Project Page: https://dragonliu1995.github.io/hearinganywhereinanyenvironment/

💡 一句话要点

提出xRIR框架,利用几何与声学特征,实现任意环境下的房间脉冲响应预测

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱八:物理动画 (Physics-based Animation)

关键词: 房间脉冲响应 RIR预测 空间声学 混合现实 几何特征提取 声学特征提取 跨房间泛化 深度学习

📋 核心要点

- 现有RIR估计方法泛化性不足,难以适应不同几何和材料的房间,限制了混合现实的沉浸感。

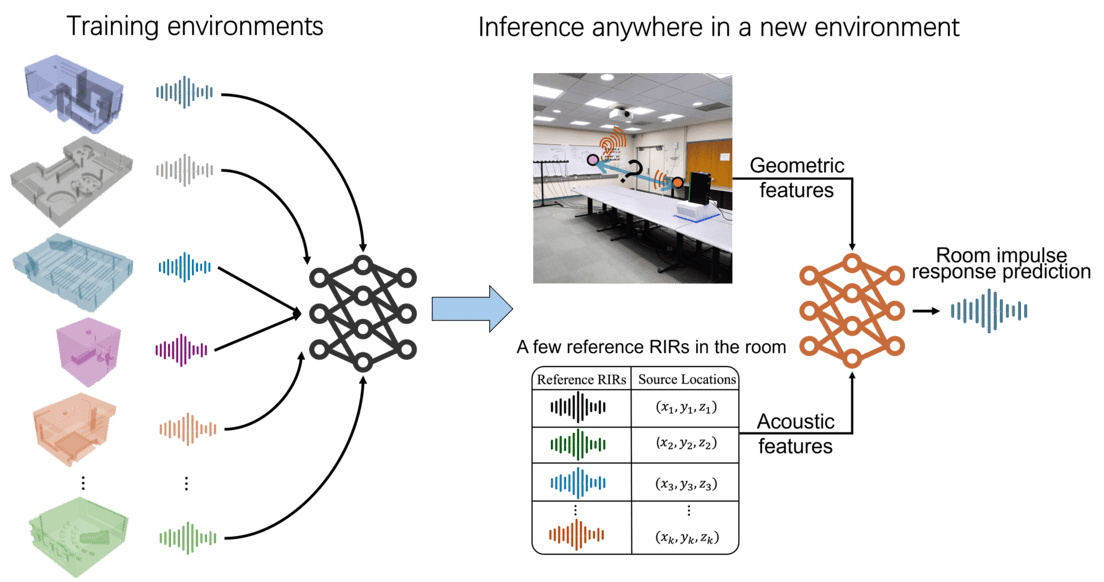

- xRIR框架结合几何特征提取器和RIR编码器,利用全景深度图像和少量参考RIR样本预测空间声学体验。

- ACOUSTICROOMS数据集包含30万+ RIR,实验表明xRIR优于基线,并在真实环境中成功完成sim-to-real迁移。

📝 摘要(中文)

在混合现实应用中,逼真的空间声学体验与视觉体验同样重要,以实现真正的沉浸感。尽管房间脉冲响应(RIR)估计的神经方法取得了进展,但现有方法大多局限于训练环境,缺乏对不同几何形状和表面材料的新房间的泛化能力。本文旨在开发一个统一的模型,能够以最少的额外测量重建任何环境的空间声学体验。为此,我们提出了xRIR,一个跨房间RIR预测框架。该方法的核心在于结合几何特征提取器(从全景深度图像中捕获空间上下文)和一个RIR编码器(仅从少量参考RIR样本中提取详细的声学特征)。为了评估我们的方法,我们引入了ACOUSTICROOMS,一个包含来自260个房间的超过30万个RIR的高保真模拟数据集。实验表明,我们的方法明显优于一系列基线方法。此外,我们通过在四个真实环境中评估我们的模型,成功地进行了sim-to-real迁移,证明了我们方法的泛化能力和数据集的真实性。

🔬 方法详解

问题定义:现有房间脉冲响应(RIR)估计方法通常依赖于特定环境的数据进行训练,导致模型在新环境下的泛化能力较差。这些方法难以适应不同几何形状和表面材料的房间,限制了混合现实应用中空间声学体验的真实感。因此,需要一种能够跨房间泛化的RIR预测方法,以实现任意环境下的逼真声学体验。

核心思路:xRIR的核心思路是将房间的几何信息和声学信息相结合,利用几何特征提取器从全景深度图像中提取房间的空间上下文信息,并使用RIR编码器从少量参考RIR样本中提取详细的声学特征。通过融合这两种信息,模型能够更好地理解房间的声学特性,从而实现跨房间的RIR预测。这种设计思路的关键在于利用几何信息作为声学信息的补充,从而提高模型的泛化能力。

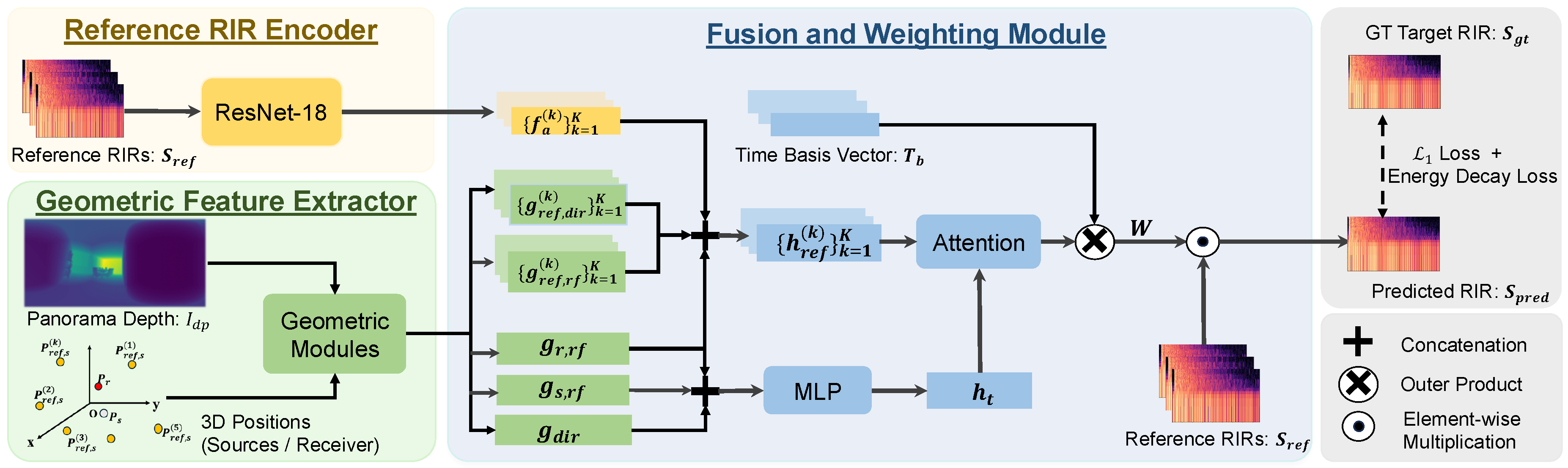

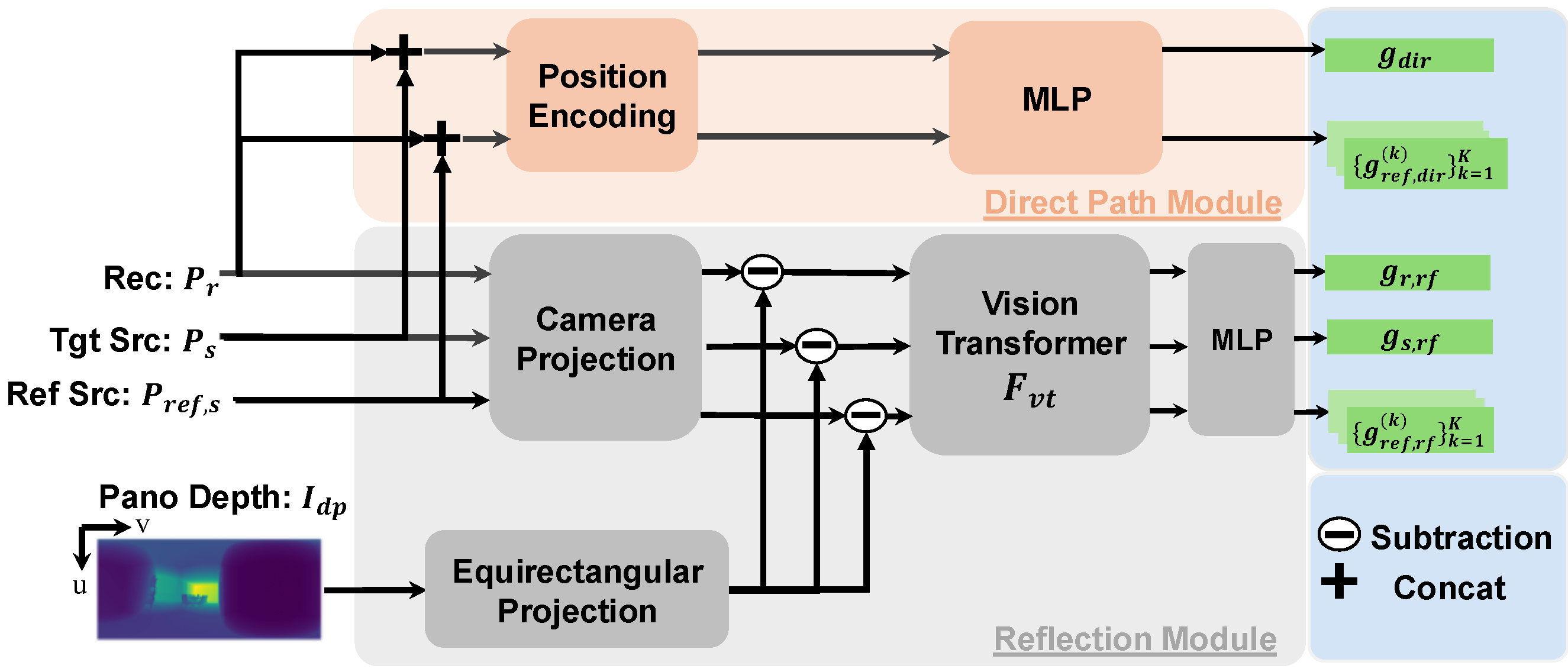

技术框架:xRIR框架主要包含两个核心模块:几何特征提取器和RIR编码器。首先,几何特征提取器接收全景深度图像作为输入,提取房间的空间几何信息。然后,RIR编码器接收少量参考RIR样本作为输入,提取房间的声学特征。最后,模型将几何特征和声学特征进行融合,预测目标位置的RIR。整个框架采用端到端的训练方式,通过最小化预测RIR与真实RIR之间的差异来优化模型参数。

关键创新:xRIR的关键创新在于其跨房间泛化的能力。与现有方法相比,xRIR不需要针对每个房间进行单独训练,而是能够利用少量参考RIR样本和全景深度图像,预测任意房间的RIR。这种跨房间泛化能力使得xRIR能够应用于更广泛的场景,例如混合现实、虚拟现实和声学模拟等。此外,ACOUSTICROOMS数据集的构建也为该领域的研究提供了有力支持。

关键设计:几何特征提取器可以使用卷积神经网络(CNN)或Transformer等模型,用于提取全景深度图像中的空间几何信息。RIR编码器可以使用循环神经网络(RNN)或Transformer等模型,用于提取参考RIR样本中的声学特征。融合模块可以使用注意力机制或简单的连接操作,将几何特征和声学特征进行融合。损失函数可以使用均方误差(MSE)或感知损失等,用于衡量预测RIR与真实RIR之间的差异。具体的网络结构、参数设置和损失函数需要根据实际情况进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,xRIR框架在ACOUSTICROOMS数据集上显著优于一系列基线方法,证明了其跨房间泛化能力。此外,通过在四个真实环境中进行sim-to-real迁移实验,验证了xRIR在真实场景中的有效性。这些实验结果表明,xRIR具有很强的实用价值和应用潜力。

🎯 应用场景

xRIR框架在混合现实、虚拟现实、声学模拟等领域具有广泛的应用前景。它可以用于增强虚拟环境的声学真实感,提高用户沉浸式体验。此外,xRIR还可以应用于声学设计、房间声学优化等领域,为建筑师和声学工程师提供有力的工具。未来,xRIR有望成为构建逼真空间声学体验的关键技术。

📄 摘要(原文)

In mixed reality applications, a realistic acoustic experience in spatial environments is as crucial as the visual experience for achieving true immersion. Despite recent advances in neural approaches for Room Impulse Response (RIR) estimation, most existing methods are limited to the single environment on which they are trained, lacking the ability to generalize to new rooms with different geometries and surface materials. We aim to develop a unified model capable of reconstructing the spatial acoustic experience of any environment with minimum additional measurements. To this end, we present xRIR, a framework for cross-room RIR prediction. The core of our generalizable approach lies in combining a geometric feature extractor, which captures spatial context from panorama depth images, with a RIR encoder that extracts detailed acoustic features from only a few reference RIR samples. To evaluate our method, we introduce ACOUSTICROOMS, a new dataset featuring high-fidelity simulation of over 300,000 RIRs from 260 rooms. Experiments show that our method strongly outperforms a series of baselines. Furthermore, we successfully perform sim-to-real transfer by evaluating our model on four real-world environments, demonstrating the generalizability of our approach and the realism of our dataset.