ESCT3D: Efficient and Selectively Controllable Text-Driven 3D Content Generation with Gaussian Splatting

作者: Huiqi Wu, Jianbo Mei, Yingjie Huang, Yining Xu, Jingjiao You, Yilong Liu, Li Yao

分类: cs.CV

发布日期: 2025-04-14

DOI: 10.1145/3728305

💡 一句话要点

ESCT3D:基于高斯溅射的高效且可控的文本驱动3D内容生成

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 文本驱动3D内容生成 高斯溅射 GPT-4V 多条件控制 Janus问题 多视角信息整合 可控生成

📋 核心要点

- 现有文本到3D模型依赖高质量文本提示,简单文本输入难以生成高质量3D内容,且生成过程可控性差,效率低。

- 提出利用GPT-4V进行自我优化,提升单次生成满意内容效率,并支持用户通过多种条件组合精确控制3D内容生成。

- 通过整合多视角信息,有效解决3D内容生成中常见的Janus问题,实验证明方法具有强大的泛化能力。

📝 摘要(中文)

近年来,文本驱动的3D内容生成取得了显著进展。然而,仍然存在一些挑战。在实际应用中,用户通常提供极其简单的文本输入,但期望获得高质量的3D内容。由于文本到3D模型的生成质量高度依赖于输入提示词的质量,因此从这种最简文本中生成最佳结果是一项艰巨的任务。此外,生成过程表现出高度的可变性,难以控制。因此,通常需要多次迭代才能生成满足用户期望的内容,从而降低了生成效率。为了解决这个问题,我们提出了GPT-4V用于自我优化,这显著提高了单次尝试生成令人满意的内容的效率。此外,文本到3D生成方法的可控性尚未得到充分探索。我们的方法使用户不仅可以提供文本描述,还可以指定额外的条件,例如风格、边缘、涂鸦、姿势或多个条件的组合,从而可以更精确地控制生成的3D内容。此外,在训练期间,我们有效地整合了多视角信息,包括多视角深度、掩码、特征和图像,以解决3D内容生成中常见的Janus问题。大量的实验表明,我们的方法实现了强大的泛化能力,从而促进了高质量3D内容的高效和可控生成。

🔬 方法详解

问题定义:论文旨在解决文本驱动的3D内容生成中,用户提供简单文本描述时,难以生成高质量、可控性强的3D模型的问题。现有方法对文本提示词质量依赖性高,生成过程随机性大,需要多次迭代才能达到用户期望,效率低下。此外,现有方法在可控性方面存在不足,用户难以通过多种条件组合来精确控制生成结果。

核心思路:论文的核心思路是利用GPT-4V进行自我优化,提升生成效率和质量。同时,引入多种条件控制机制,使用户可以通过文本描述以及风格、边缘、姿势等多种条件组合来精确控制生成结果。此外,通过整合多视角信息,解决3D生成中常见的Janus问题,提高生成模型的鲁棒性和泛化能力。

技术框架:ESCT3D的整体框架包含以下几个主要模块:1) 文本提示词优化模块:利用GPT-4V对用户输入的简单文本提示词进行优化,生成更详细、更具描述性的提示词。2) 多条件控制模块:允许用户输入文本描述以及风格、边缘、姿势等多种条件,作为生成过程的约束。3) 3D内容生成模块:基于高斯溅射技术,根据优化后的文本提示词和多条件约束,生成3D模型。4) 多视角信息整合模块:在训练过程中,整合多视角深度、掩码、特征和图像信息,以解决Janus问题。

关键创新:论文的关键创新点在于:1) 提出使用GPT-4V进行文本提示词的自我优化,显著提升了生成效率和质量。2) 引入多条件控制机制,使用户可以通过多种条件组合来精确控制生成结果,提高了生成过程的可控性。3) 有效整合多视角信息,解决了3D内容生成中常见的Janus问题,提高了生成模型的鲁棒性和泛化能力。

关键设计:论文的关键设计包括:1) 使用GPT-4V进行文本提示词优化,具体提示词工程细节未知。2) 多条件控制模块的具体实现方式未知,可能涉及到条件编码和融合等技术。3) 多视角信息整合模块的具体实现方式未知,可能涉及到多视角一致性损失函数的设计。

🖼️ 关键图片

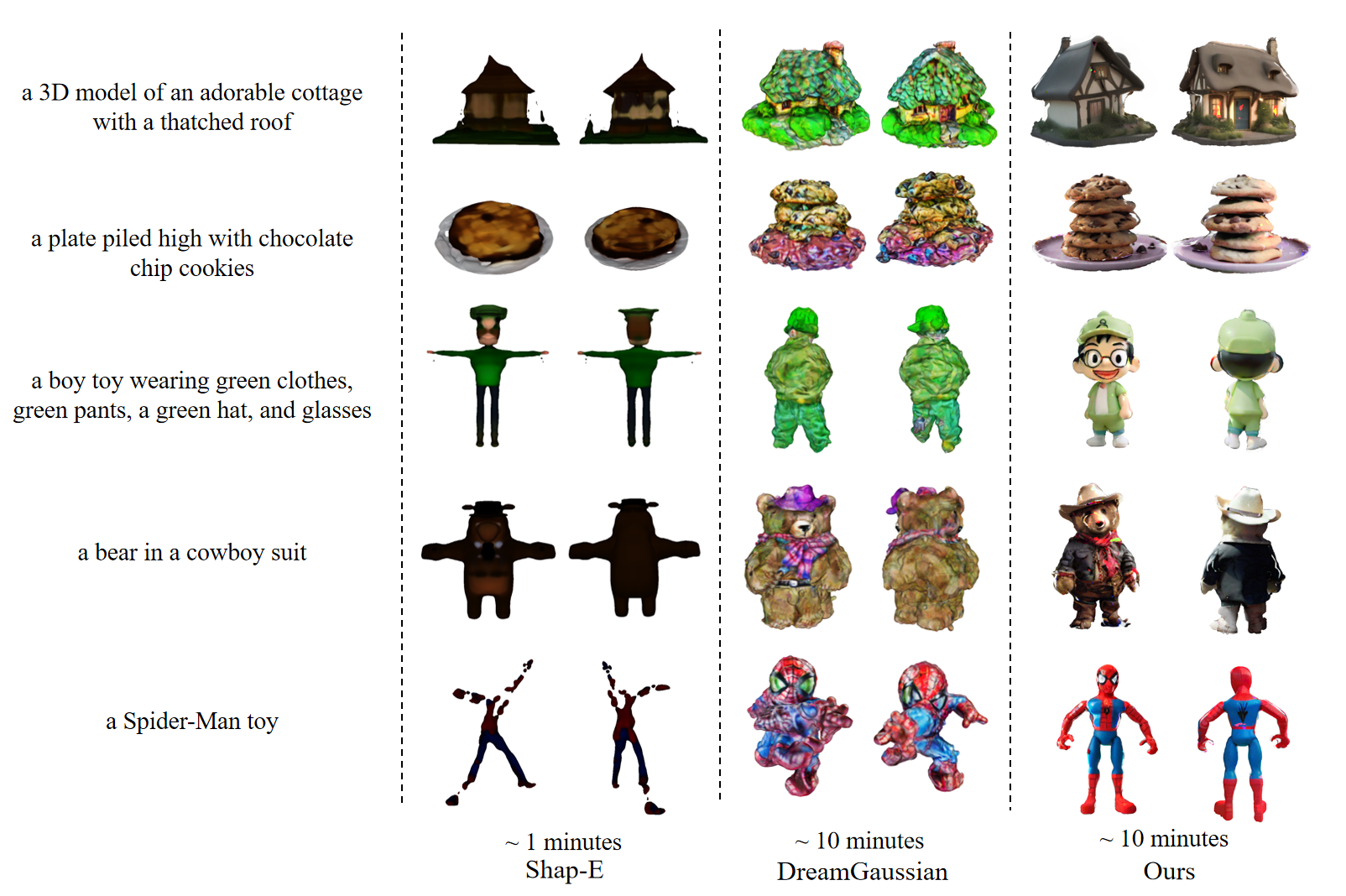

📊 实验亮点

论文通过实验验证了ESCT3D方法的有效性。实验结果表明,该方法在生成质量、可控性和效率方面均优于现有方法。具体性能数据和对比基线未知,但论文强调该方法实现了强大的泛化能力,能够高效且可控地生成高质量的3D内容。

🎯 应用场景

该研究成果可广泛应用于游戏开发、虚拟现实、增强现实、工业设计、电商展示等领域。用户可以通过简单的文本描述和多种条件组合,快速生成高质量、可控性强的3D模型,降低3D内容创作的门槛,提高创作效率。未来,该技术有望进一步发展,实现更加智能、高效、个性化的3D内容生成。

📄 摘要(原文)

In recent years, significant advancements have been made in text-driven 3D content generation. However, several challenges remain. In practical applications, users often provide extremely simple text inputs while expecting high-quality 3D content. Generating optimal results from such minimal text is a difficult task due to the strong dependency of text-to-3D models on the quality of input prompts. Moreover, the generation process exhibits high variability, making it difficult to control. Consequently, multiple iterations are typically required to produce content that meets user expectations, reducing generation efficiency. To address this issue, we propose GPT-4V for self-optimization, which significantly enhances the efficiency of generating satisfactory content in a single attempt. Furthermore, the controllability of text-to-3D generation methods has not been fully explored. Our approach enables users to not only provide textual descriptions but also specify additional conditions, such as style, edges, scribbles, poses, or combinations of multiple conditions, allowing for more precise control over the generated 3D content. Additionally, during training, we effectively integrate multi-view information, including multi-view depth, masks, features, and images, to address the common Janus problem in 3D content generation. Extensive experiments demonstrate that our method achieves robust generalization, facilitating the efficient and controllable generation of high-quality 3D content.