Ges3ViG: Incorporating Pointing Gestures into Language-Based 3D Visual Grounding for Embodied Reference Understanding

作者: Atharv Mahesh Mane, Dulanga Weerakoon, Vigneshwaran Subbaraju, Sougata Sen, Sanjay E. Sarma, Archan Misra

分类: cs.CV, cs.AI, cs.MM

发布日期: 2025-04-13

备注: Accepted to the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) 2025

🔗 代码/项目: GITHUB

💡 一句话要点

Ges3ViG:融合指向手势的语言3D视觉定位,提升具身引用理解

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D视觉定位 具身引用理解 指向手势 多模态融合 数据增强

📋 核心要点

- 现有3D视觉定位方法主要依赖语言描述,忽略了人类交互中重要的指向手势信息,限制了具身引用理解的准确性。

- 论文提出Ges3ViG模型,通过融合语言描述和指向手势信息,更准确地定位3D场景中的目标对象,提升具身引用理解能力。

- 实验结果表明,Ges3ViG模型在3D-ERU任务上显著优于现有模型,验证了融合指向手势信息的有效性,并构建了新的基准数据集。

📝 摘要(中文)

本文针对3D具身引用理解(3D-ERU)问题,该问题结合语言描述和指向手势来识别3D场景中最相关的目标对象。现有工作主要集中于纯语言的3D定位,对结合人类指向手势的3D-ERU研究较少。为了弥补这一差距,我们提出了一个数据增强框架Imputer,并利用它创建了一个新的基准数据集ImputeRefer,通过将人类指向手势融入到现有的仅包含语言指令的3D场景数据集中。此外,我们还提出了一个名为Ges3ViG的3D-ERU模型,与其他的3D-ERU模型相比,其准确率提高了约30%,与其他的纯语言3D定位模型相比,准确率提高了约9%。我们的代码和数据集可在https://github.com/AtharvMane/Ges3ViG 获取。

🔬 方法详解

问题定义:现有3D视觉定位方法主要依赖于语言描述,忽略了人类交互中常用的指向手势信息。这导致模型在理解具身引用时,无法充分利用人类的交互意图,从而降低了定位的准确性。此外,缺乏包含指向手势信息的3D场景数据集,也限制了相关研究的进展。

核心思路:论文的核心思路是将指向手势信息融入到3D视觉定位任务中,从而更准确地理解人类的引用意图。通过设计合适的模型结构,有效地融合语言描述和指向手势信息,提升模型在3D场景中定位目标对象的能力。

技术框架:Ges3ViG模型包含以下主要模块:1) 语言编码器:用于提取语言描述的特征;2) 手势编码器:用于提取指向手势的特征;3) 3D场景编码器:用于提取3D场景的几何和语义特征;4) 融合模块:将语言、手势和场景特征进行融合;5) 定位模块:根据融合后的特征,预测目标对象在3D场景中的位置。整体流程是,首先分别对语言描述、指向手势和3D场景进行编码,然后通过融合模块将这些特征进行整合,最后利用定位模块预测目标对象的位置。

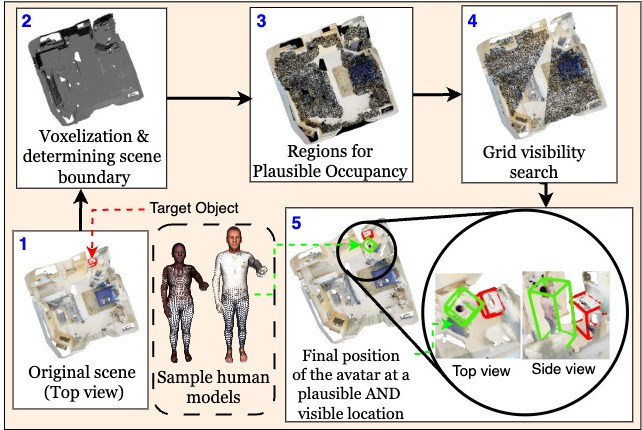

关键创新:论文的关键创新在于:1) 提出了一个数据增强框架Imputer,用于生成包含指向手势信息的3D场景数据集;2) 设计了一个新的3D-ERU模型Ges3ViG,能够有效地融合语言描述和指向手势信息,提升定位准确性。与现有方法相比,Ges3ViG模型能够更好地利用人类的交互意图,从而更准确地定位目标对象。

关键设计:在数据增强方面,Imputer框架利用现有的3D场景数据集和语言描述,通过算法生成合理的指向手势信息。在模型设计方面,Ges3ViG模型采用了Transformer结构,用于编码语言描述和指向手势信息。融合模块采用了注意力机制,用于自适应地融合不同模态的特征。损失函数采用了交叉熵损失,用于优化模型的定位性能。具体的参数设置和网络结构细节可以在论文原文中找到。

🖼️ 关键图片

📊 实验亮点

Ges3ViG模型在ImputeRefer数据集上取得了显著的性能提升。与其他的3D-ERU模型相比,Ges3ViG的准确率提高了约30%。与其他的纯语言3D定位模型相比,Ges3ViG的准确率提高了约9%。这些结果表明,融合指向手势信息能够显著提升3D视觉定位的准确性。

🎯 应用场景

该研究成果可应用于机器人人机交互、虚拟现实、增强现实等领域。例如,在机器人人机交互中,机器人可以通过理解人类的语言描述和指向手势,更准确地识别目标对象,从而完成更复杂的任务。在虚拟现实和增强现实中,用户可以通过语言和手势与虚拟环境进行交互,提升用户体验。

📄 摘要(原文)

3-Dimensional Embodied Reference Understanding (3D-ERU) combines a language description and an accompanying pointing gesture to identify the most relevant target object in a 3D scene. Although prior work has explored pure language-based 3D grounding, there has been limited exploration of 3D-ERU, which also incorporates human pointing gestures. To address this gap, we introduce a data augmentation framework-Imputer, and use it to curate a new benchmark dataset-ImputeRefer for 3D-ERU, by incorporating human pointing gestures into existing 3D scene datasets that only contain language instructions. We also propose Ges3ViG, a novel model for 3D-ERU that achieves ~30% improvement in accuracy as compared to other 3D-ERU models and ~9% compared to other purely language-based 3D grounding models. Our code and dataset are available at https://github.com/AtharvMane/Ges3ViG.