RealCam-Vid: High-resolution Video Dataset with Dynamic Scenes and Metric-scale Camera Movements

作者: Guangcong Zheng, Teng Li, Xianpan Zhou, Xi Li

分类: cs.CV

发布日期: 2025-04-11

🔗 代码/项目: GITHUB

💡 一句话要点

提出RealCam-Vid:首个具有动态场景和度量尺度相机运动的高分辨率视频数据集。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 动态场景 视频数据集 相机可控视频生成 度量尺度 相机标注

📋 核心要点

- 现有相机可控视频生成方法依赖静态场景数据集,缺乏动态交互和度量尺度几何一致性。

- RealCam-Vid数据集提供动态场景和度量尺度相机标注,旨在弥补现有数据集的不足。

- 该数据集是首个完全开源的高分辨率动态场景数据集,促进更逼真的视频生成研究。

📝 摘要(中文)

相机可控视频生成领域的最新进展受到静态场景数据集的限制,这些数据集通常使用相对尺度的相机标注,例如RealEstate10K。虽然这些数据集能够实现基本的视点控制,但它们无法捕捉动态场景交互,并且缺乏度量尺度的几何一致性,这对于在复杂环境中合成逼真的物体运动和精确的相机轨迹至关重要。为了弥合这一差距,我们推出了首个完全开源的、高分辨率动态场景数据集RealCam-Vid,该数据集具有度量尺度的相机标注,可在https://github.com/ZGCTroy/RealCam-Vid获取。

🔬 方法详解

问题定义:现有的相机可控视频生成方法主要依赖于静态场景数据集,例如RealEstate10K。这些数据集虽然可以实现基本的视点控制,但是无法捕捉到动态场景中的物体交互,并且缺乏度量尺度的几何一致性。这意味着生成的视频在物体运动和相机轨迹方面不够真实,难以应用于需要精确几何信息的场景。

核心思路:RealCam-Vid数据集的核心思路是提供一个包含动态场景和度量尺度相机标注的高质量视频数据集。通过引入动态场景,可以更好地模拟真实世界的复杂环境,从而提高生成视频的真实感。度量尺度的相机标注则可以保证生成的视频在几何上的一致性,使得物体运动和相机轨迹更加精确。

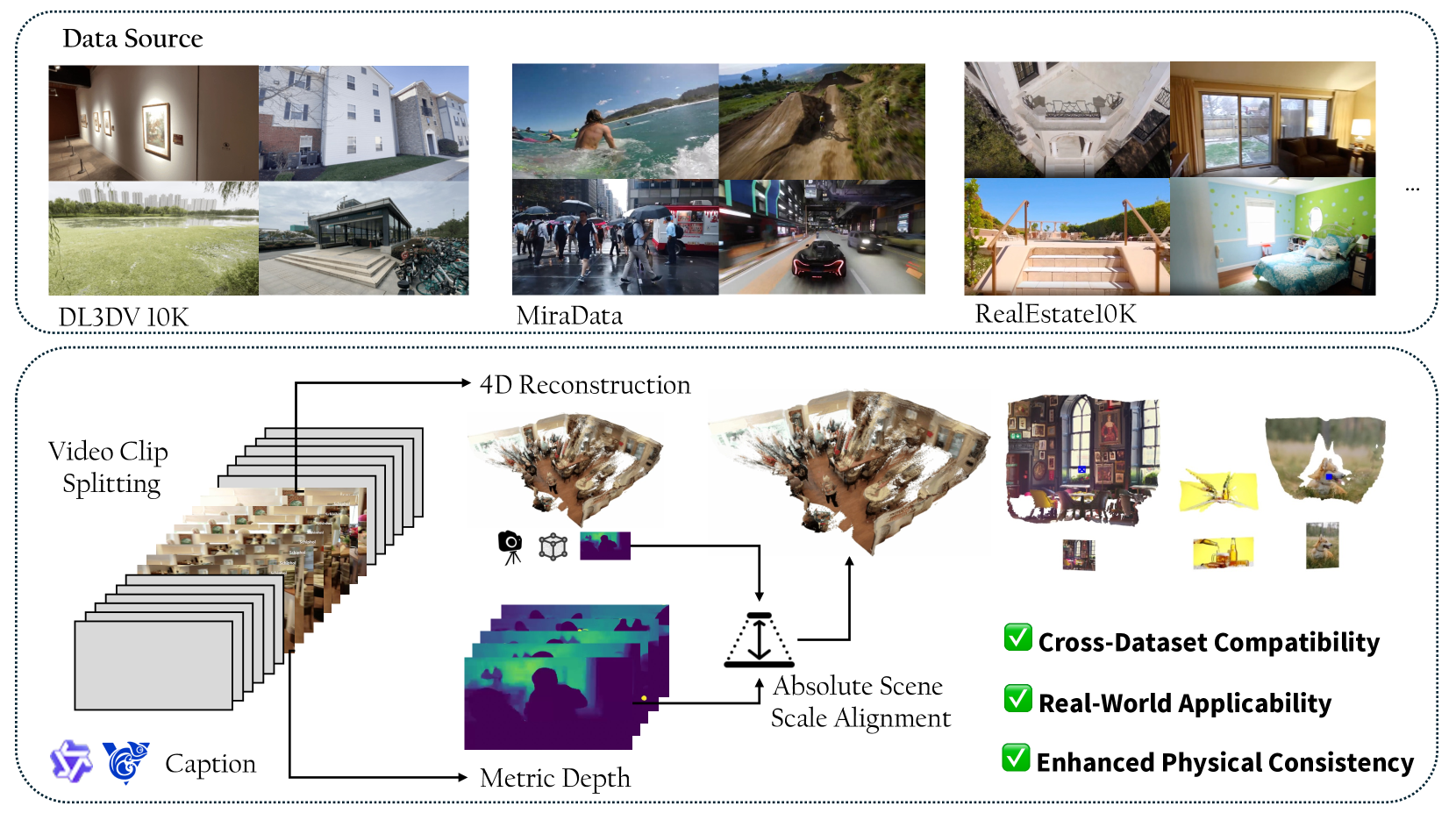

技术框架:RealCam-Vid数据集的构建涉及多个阶段,包括场景选择、视频拍摄、相机标定和数据标注。首先,选择具有代表性的动态场景,例如室内环境、街道场景等。然后,使用高分辨率相机拍摄视频,并记录相机的运动轨迹。接下来,使用相机标定技术获取相机的内外参数,并将相机运动轨迹转换为度量尺度。最后,对视频中的物体进行标注,包括物体的位置、姿态和类别等。

关键创新:RealCam-Vid数据集的关键创新在于它是首个完全开源的、高分辨率动态场景数据集,并且提供了度量尺度的相机标注。这使得研究人员可以更加方便地获取高质量的训练数据,从而推动相机可控视频生成领域的发展。此外,该数据集还包含了丰富的动态场景,可以用于训练更加逼真的视频生成模型。

关键设计:RealCam-Vid数据集的关键设计包括:1) 使用高分辨率相机拍摄视频,保证视频的清晰度;2) 使用精确的相机标定技术获取相机的内外参数,保证相机运动轨迹的准确性;3) 对视频中的物体进行详细标注,提供丰富的语义信息;4) 完全开源,方便研究人员使用和扩展。

🖼️ 关键图片

📊 实验亮点

RealCam-Vid是首个开源的、具有度量尺度相机标注的高分辨率动态场景数据集。它填补了现有数据集在动态场景和几何一致性方面的空白,为相机可控视频生成领域的研究提供了新的资源。该数据集的发布有望促进更逼真的视频生成模型的发展,并推动相关领域的应用。

🎯 应用场景

RealCam-Vid数据集可广泛应用于相机可控视频生成、虚拟现实、增强现实、机器人导航等领域。它能够帮助研究人员训练更逼真的视频生成模型,提升虚拟现实和增强现实的沉浸感,并为机器人提供更精确的环境感知能力。未来,该数据集有望推动这些领域的技术进步和应用创新。

📄 摘要(原文)

Recent advances in camera-controllable video generation have been constrained by the reliance on static-scene datasets with relative-scale camera annotations, such as RealEstate10K. While these datasets enable basic viewpoint control, they fail to capture dynamic scene interactions and lack metric-scale geometric consistency-critical for synthesizing realistic object motions and precise camera trajectories in complex environments. To bridge this gap, we introduce the first fully open-source, high-resolution dynamic-scene dataset with metric-scale camera annotations in https://github.com/ZGCTroy/RealCam-Vid.