A Multicore and Edge TPU-Accelerated Multimodal TinyML System for Livestock Behavior Recognition

作者: Qianxue Zhang, Eiman Kanjo

分类: cs.CV, eess.IV

发布日期: 2025-04-10 (更新: 2025-12-24)

备注: 12 pages, 10 figures

期刊: IEEE Internet of Things Journal, vol. 13, no. 1, pp. 666-677, 1 Jan.1, 2026

DOI: 10.1109/JIOT.2025.3624811

💡 一句话要点

提出一种基于多核和Edge TPU加速的多模态TinyML牲畜行为识别系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: TinyML 多模态融合 牲畜行为识别 边缘计算 微控制器 Edge TPU 无线通信 智慧农业

📋 核心要点

- 现有牲畜监测方案成本高昂、计算资源需求大,难以在资源受限的边缘设备上部署。

- 该研究融合加速度计和视觉数据,利用TinyML技术在微控制器上实现高效的牲畜行为识别。

- 实验结果表明,该系统在保证性能的同时,显著降低了模型尺寸和推理延迟。

📝 摘要(中文)

本文提出了一种新颖的动物活动识别和运动跟踪方法,利用TinyML技术、无线通信框架和微控制器平台,开发了一种高效、经济的牲畜传感系统。该系统收集并融合加速度计数据和视觉输入,构建了一个用于图像分类、目标检测和行为识别的多模态网络。该系统部署在商用微控制器上,并使用嵌入式应用程序进行实时推理,模型尺寸最多可减少270倍,响应延迟小于80毫秒,性能与现有方法相当。无线通信技术的结合实现了设备之间无缝的数据传输,有利于互联网连接较差的偏远地区的使用场景。这项工作提供了一个稳健、可扩展的IoT边缘牲畜监测解决方案,可适应不同的农业需求,并为未来的扩展提供了灵活性。

🔬 方法详解

问题定义:论文旨在解决牲畜行为识别问题,现有方法通常依赖于云计算或高性能设备,成本高昂且功耗大,难以在资源受限的边缘环境中部署。此外,单一模态的信息可能不足以准确识别复杂的牲畜行为。

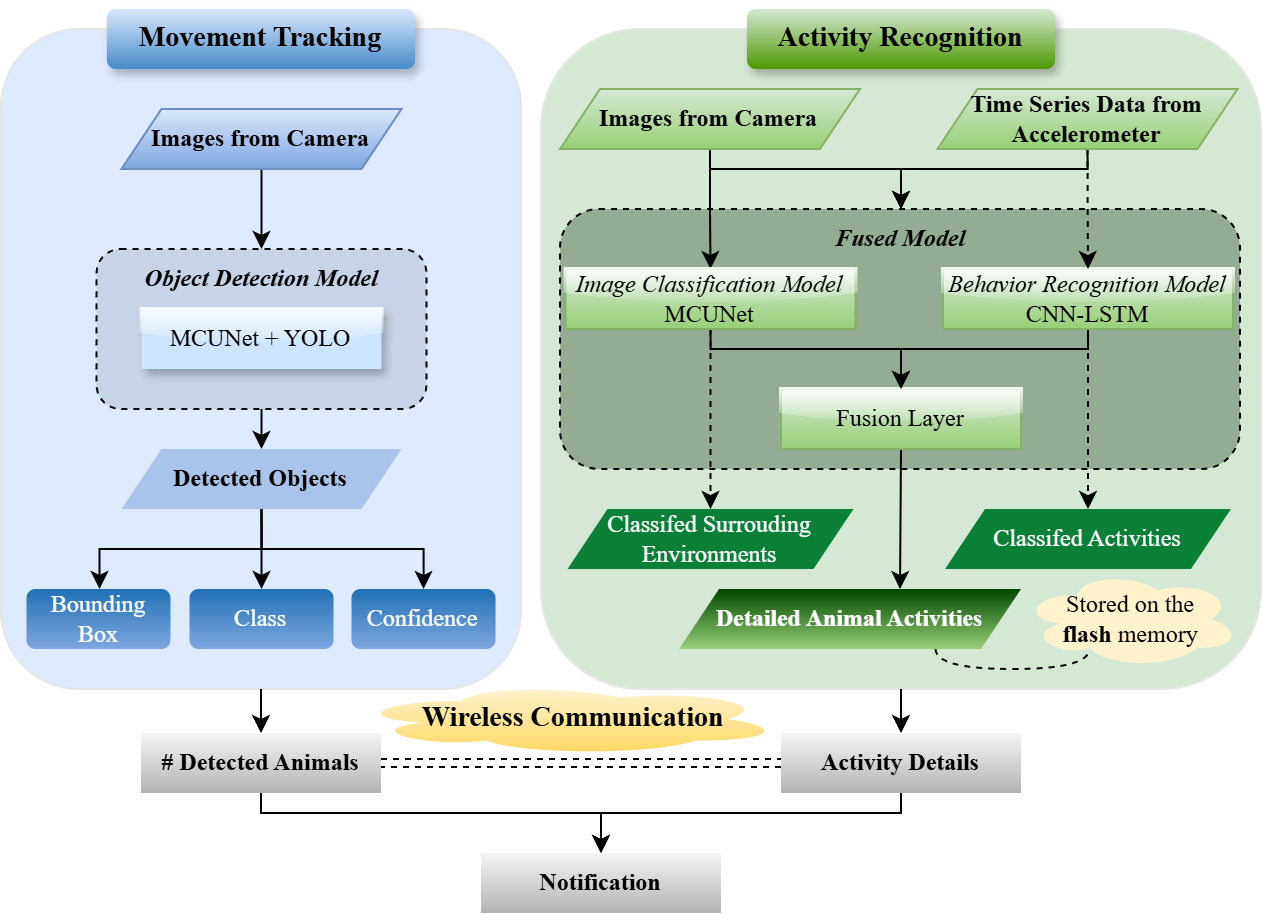

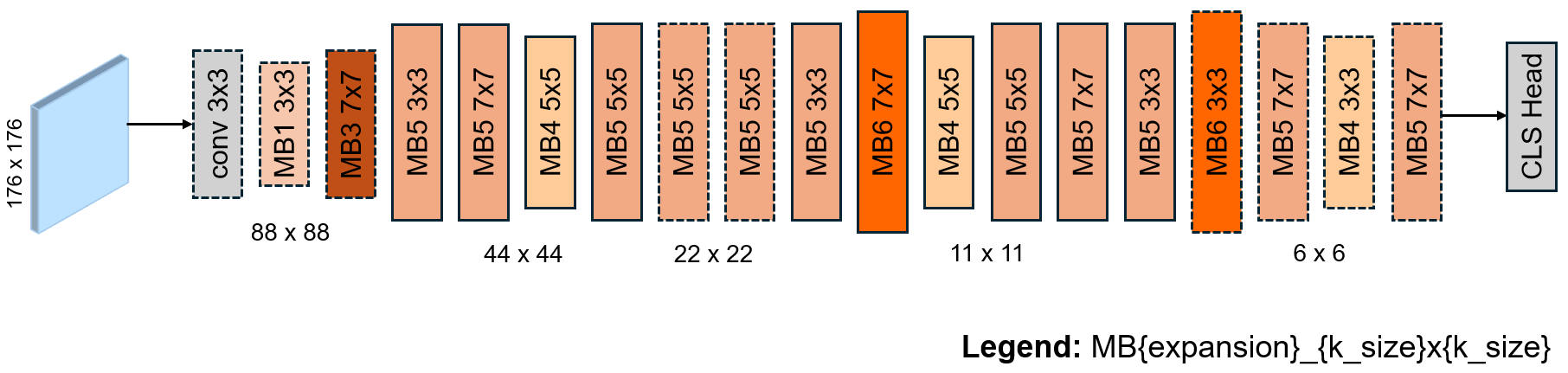

核心思路:论文的核心思路是利用TinyML技术,将深度学习模型压缩并部署到微控制器上,实现低功耗、低延迟的边缘推理。同时,融合加速度计和视觉数据,利用多模态信息提升行为识别的准确性。

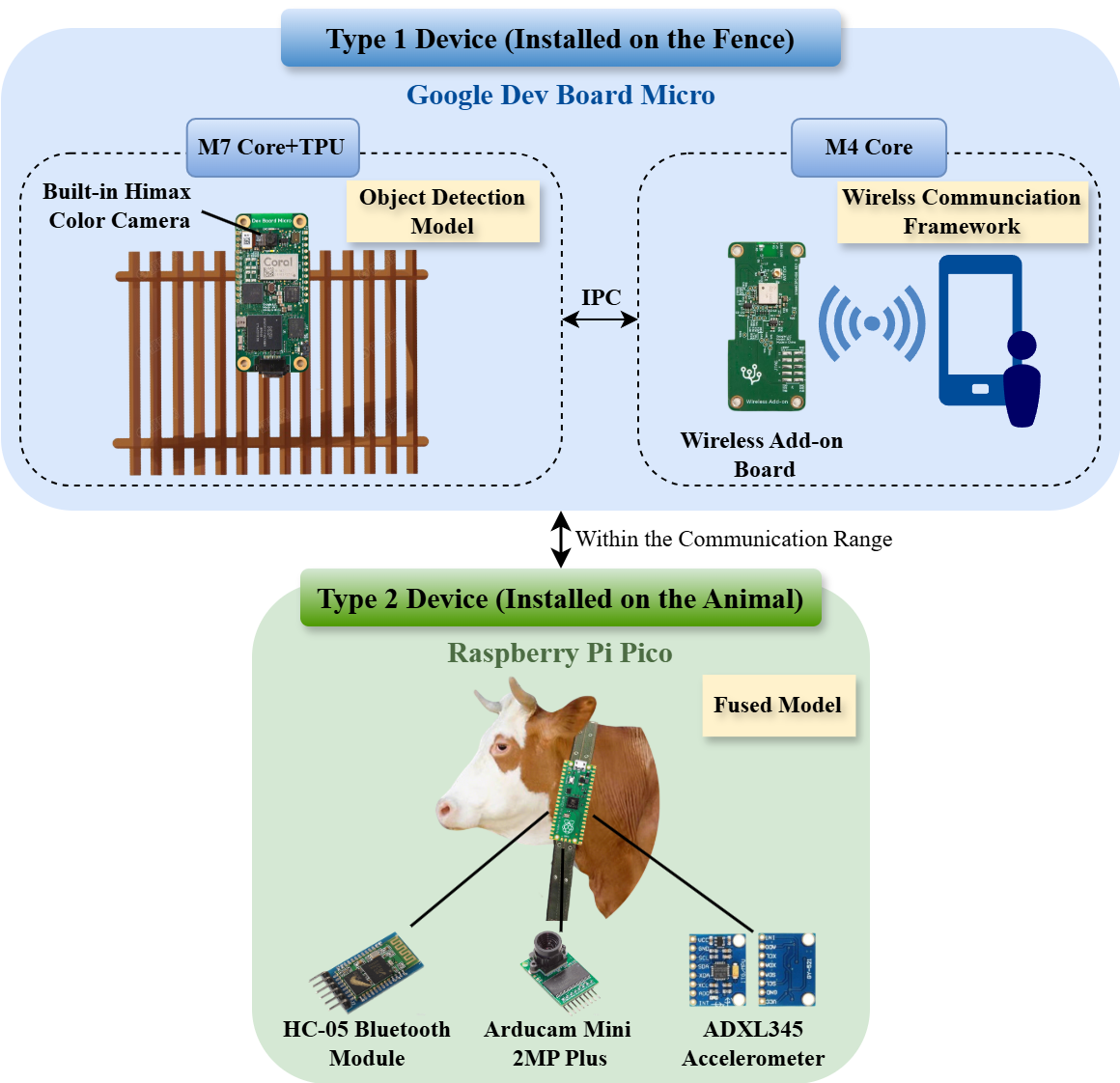

技术框架:该系统主要包含三个模块:数据采集模块(加速度计和摄像头)、数据融合与模型推理模块(微控制器和Edge TPU)以及无线通信模块。加速度计和摄像头采集到的数据经过预处理后,输入到多模态TinyML模型中进行推理,识别牲畜的行为。识别结果通过无线通信模块传输到云端或用户终端。

关键创新:该研究的关键创新在于将多模态TinyML技术应用于牲畜行为识别,并成功部署在资源受限的微控制器上。通过模型压缩和硬件加速,实现了低功耗、低延迟的实时推理。此外,融合加速度计和视觉数据,提升了行为识别的准确性。

关键设计:论文采用了TensorFlow Lite Micro框架进行模型压缩和优化。针对不同的任务(图像分类、目标检测和行为识别),设计了不同的网络结构,并进行了针对性的训练和优化。使用了Edge TPU进行硬件加速,提升了推理速度。无线通信模块采用了LoRaWAN技术,实现了远距离、低功耗的数据传输。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该系统可以将模型尺寸最多减少270倍,响应延迟小于80毫秒,并且性能与现有方法相当。这表明该系统可以在资源受限的边缘设备上实现高效的牲畜行为识别,具有很高的实用价值。

🎯 应用场景

该研究成果可应用于智慧农业领域,实现对牲畜行为的实时监测和预警,提高养殖效率和管理水平。例如,可以用于监测牲畜的健康状况、活动状态和异常行为,及时发现疾病或受伤情况,减少损失。此外,还可以用于优化饲养管理,提高牲畜的生长速度和产量。

📄 摘要(原文)

The advancement of technology has revolutionized the agricultural industry, transitioning it from labor-intensive farming practices to automated, AI-powered management systems. In recent years, more intelligent livestock monitoring solutions have been proposed to enhance farming efficiency and productivity. This work presents a novel approach to animal activity recognition and movement tracking, leveraging tiny machine learning (TinyML) techniques, wireless communication framework, and microcontroller platforms to develop an efficient, cost-effective livestock sensing system. It collects and fuses accelerometer data and vision inputs to build a multimodal network for three tasks: image classification, object detection, and behavior recognition. The system is deployed and evaluated on commercial microcontrollers for real-time inference using embedded applications, demonstrating up to 270$\times$ model size reduction, less than 80ms response latency, and on-par performance comparable to existing methods. The incorporation of the wireless communication technique allows for seamless data transmission between devices, benefiting use cases in remote locations with poor Internet connectivity. This work delivers a robust, scalable IoT-edge livestock monitoring solution adaptable to diverse farming needs, offering flexibility for future extensions.